Spec-TOD: A Specialized Instruction-Tuned LLM Framework for Efficient Task-Oriented Dialogue Systems

作者: Quang-Vinh Nguyen, Quang-Chieu Nguyen, Hoang Pham, Khac-Hoai Nam Bui

分类: cs.CL

发布日期: 2025-07-07

备注: Accepted at SIGdial 2025

💡 一句话要点

Spec-TOD:面向任务型对话系统的高效指令调优LLM框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 任务型对话系统 指令调优 大型语言模型 低资源学习 端到端训练

📋 核心要点

- 现有TOD系统在低资源场景下,由于缺乏足够的标注数据,性能受到严重限制。

- Spec-TOD通过引入显式任务指令和轻量级LLM,实现了在少量数据下的高效训练。

- 实验表明,Spec-TOD在MultiWOZ数据集上取得了竞争力的结果,显著降低了对标注数据的需求。

📝 摘要(中文)

任务型对话(TOD)系统旨在促进用户与机器之间以目标为导向的交互。尽管深度学习的最新进展提高了性能,但TOD系统在标记数据有限的低资源场景中仍然面临挑战。为了解决这个问题,我们提出了Spec-TOD,一种新颖的框架,旨在用有限的数据训练端到端TOD系统。Spec-TOD引入了两项主要创新:(i)一种新颖的专用端到端TOD框架,该框架结合了用于指令调优大型语言模型(LLM)的显式任务指令;(ii)一种高效的训练策略,该策略利用轻量级的专用LLM,以最少的监督来实现强大的性能。在广泛使用的TOD基准数据集MultiWOZ上的实验表明,Spec-TOD在显著减少标记数据需求的同时,实现了具有竞争力的结果。这些发现突出了所提出的框架在推进低资源环境中高效且有效的TOD系统方面的潜力。

🔬 方法详解

问题定义:论文旨在解决任务型对话系统在低资源场景下,由于缺乏足够的标注数据而导致的性能瓶颈问题。现有的端到端TOD系统通常需要大量的标注数据进行训练,这在实际应用中往往难以满足。因此,如何在少量数据下训练出高性能的TOD系统是本论文要解决的核心问题。

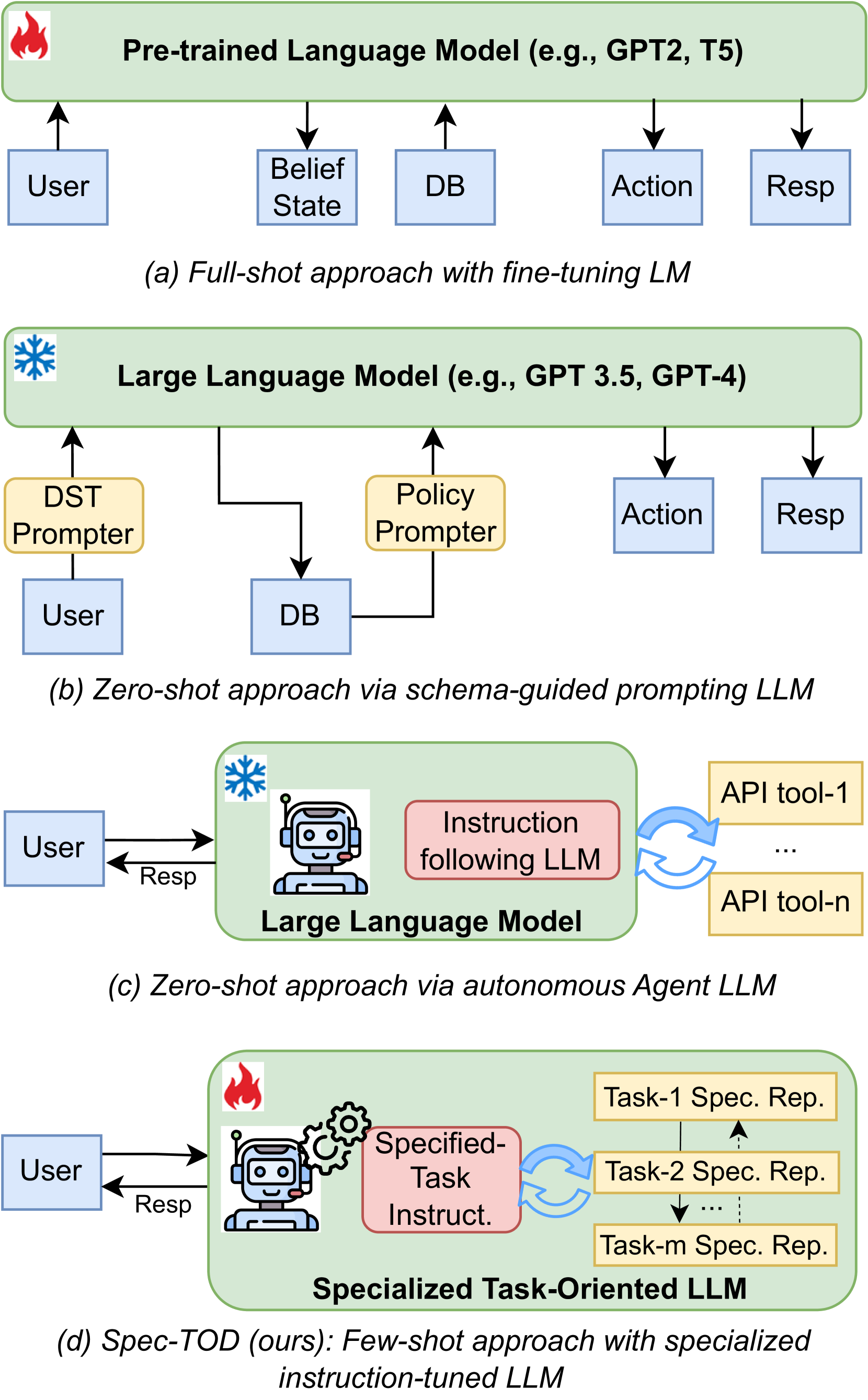

核心思路:论文的核心思路是利用指令调优(Instruction Tuning)技术,通过显式地将任务指令融入到LLM的训练过程中,使模型能够更好地理解和执行对话任务。同时,采用轻量级的专用LLM,以减少计算资源的需求,并提高训练效率。这种设计使得模型能够在少量数据下快速学习到对话策略,从而提高在低资源场景下的性能。

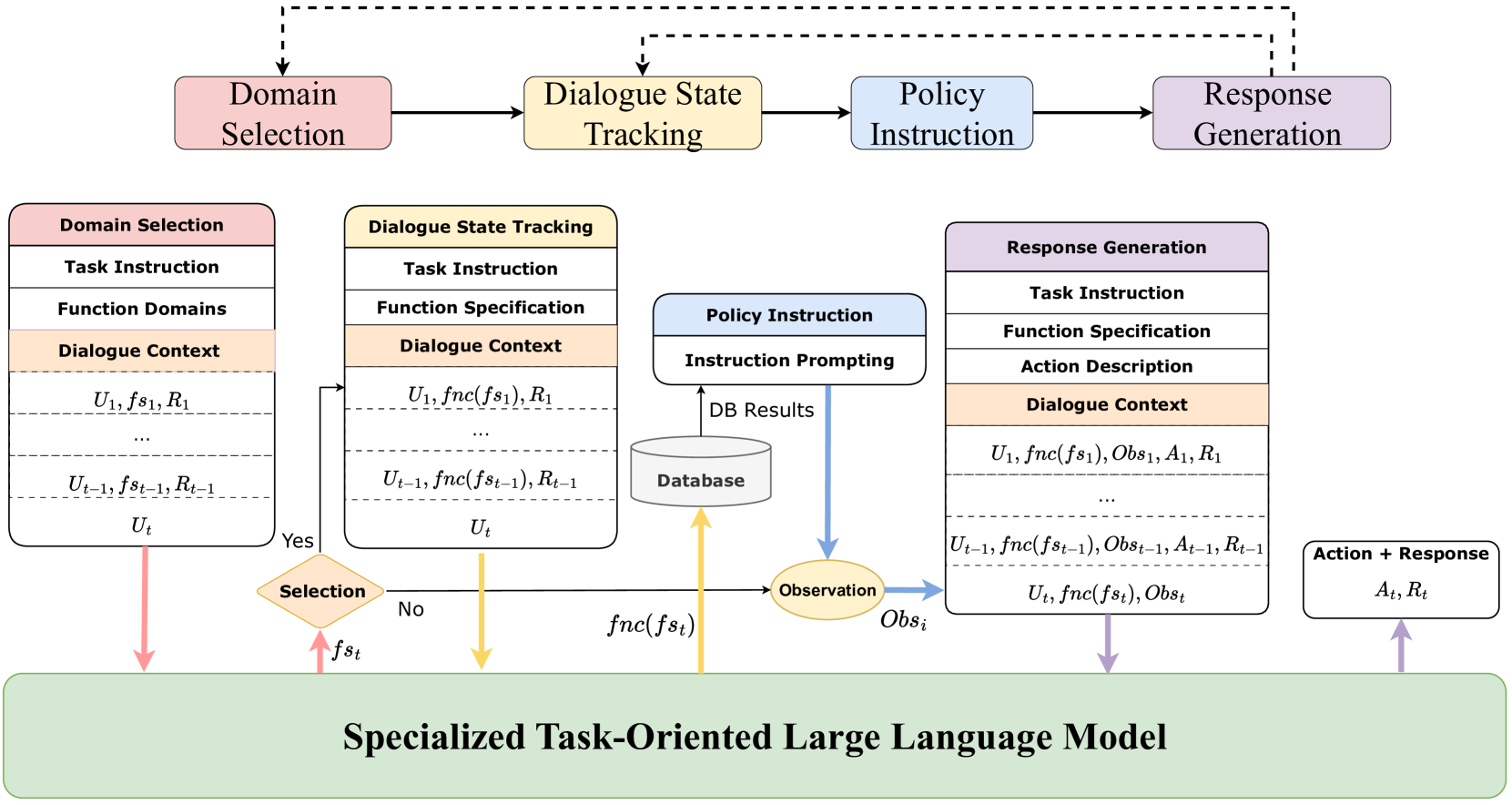

技术框架:Spec-TOD框架包含以下主要模块:1) 指令生成模块:负责生成针对特定对话任务的指令;2) LLM训练模块:使用生成的指令和少量标注数据对轻量级LLM进行指令调优;3) 对话管理模块:负责根据用户输入和模型输出,维护对话状态并生成回复。整个流程是端到端的,用户输入经过对话管理模块处理后,传递给LLM,LLM根据指令和对话历史生成回复,再由对话管理模块返回给用户。

关键创新:Spec-TOD的关键创新在于:1) 提出了一个专门为TOD系统设计的指令调优框架,通过显式地将任务指令融入到LLM的训练中,提高了模型对对话任务的理解能力;2) 采用轻量级的专用LLM,降低了计算资源的需求,并提高了训练效率。与现有方法相比,Spec-TOD能够在少量数据下取得更好的性能,并且更易于部署和应用。

关键设计:论文中关键的设计包括:1) 指令的设计:指令需要清晰、简洁地描述对话任务的目标和约束,以便LLM能够准确理解;2) LLM的选择:选择轻量级的LLM,以减少计算资源的需求,并提高训练效率;3) 损失函数的设计:采用合适的损失函数,以优化LLM的训练过程,使其能够更好地生成符合任务要求的回复。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Spec-TOD在MultiWOZ数据集上取得了显著的性能提升,尤其是在数据量较少的情况下。与传统的端到端TOD系统相比,Spec-TOD在相同数据量下能够取得更高的对话成功率和更低的错误率。这些结果验证了Spec-TOD框架在低资源场景下的有效性和优越性。

🎯 应用场景

Spec-TOD框架可应用于各种低资源场景下的任务型对话系统,例如:特定领域的客户服务、智能助手、教育辅导等。该框架能够降低对大量标注数据的依赖,使得在数据匮乏的领域也能快速构建高效的对话系统。未来,该研究可以进一步扩展到多语言环境和更复杂的对话任务中,具有广阔的应用前景。

📄 摘要(原文)

Task-oriented dialogue (TOD) systems facilitate goal-driven interactions between users and machines. While recent advances in deep learning have improved the performance, TOD systems often struggle in low-resource scenarios with limited labeled data. To address this challenge, we propose Spec-TOD, a novel framework designed to train an end-to-end TOD system with limited data. Spec-TOD introduces two main innovations: (i) a novel specialized end-to-end TOD framework that incorporates explicit task instructions for instruction-tuned large language models (LLMs), and (ii) an efficient training strategy that leverages lightweight, specialized LLMs to achieve strong performance with minimal supervision. Experiments on the MultiWOZ dataset, a widely used TOD benchmark, demonstrate that Spec-TOD achieves competitive results while significantly reducing the need for labeled data. These findings highlight the potential of the proposed framework in advancing efficient and effective TOD systems in low-resource settings.