Reason to Rote: Rethinking Memorization in Reasoning

作者: Yupei Du, Philipp Mondorf, Silvia Casola, Yuekun Yao, Robert Litschko, Barbara Plank

分类: cs.CL, cs.LG

发布日期: 2025-07-07 (更新: 2025-10-02)

备注: EMNLP 2025 Main. 21 pages, 14 figures

💡 一句话要点

探究LLM中记忆噪声标签与推理能力的关系,揭示良性记忆的机理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 噪声标签 记忆机制 推理能力 分布式编码

📋 核心要点

- 现有研究对大型语言模型(LLM)在推理任务中记忆噪声标签的机制理解不足,缺乏对记忆与推理之间关系的深入探讨。

- 该研究的核心思想是探究LLM在记忆噪声标签时,是否以及如何利用其内在的推理机制,而非简单地进行查找表式的记忆。

- 通过在可控的合成数据集上进行实验,发现LLM在记忆噪声标签时,会继续进行中间推理步骤,并且推理过程会影响记忆效果。

📝 摘要(中文)

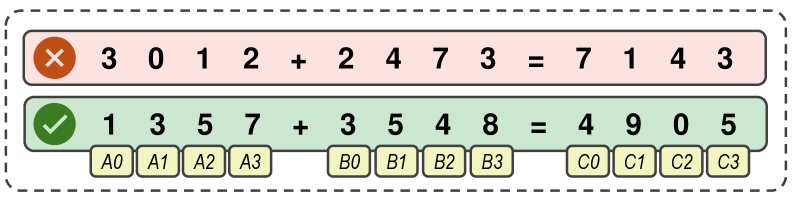

大型语言模型很容易记住任意训练实例,例如标签噪声,但它们在推理任务中表现出色。本文研究了语言模型如何记忆标签噪声,以及为什么这种记忆在许多情况下不会严重影响可泛化的推理能力。通过使用两个带有噪声标签的可控合成推理数据集,即四位数加法(FDA)和两跳关系推理(THR),我们发现记忆依赖于可泛化的推理机制:即使在检索记忆的噪声标签时,模型也会继续计算中间推理输出,并且干预推理会不利地影响记忆。我们进一步表明,记忆通过分布式编码进行操作,即聚合各种输入和中间结果,而不是构建从输入到噪声标签的查找机制。此外,我们的FDA案例研究表明,记忆是通过异常值启发式发生的,其中现有的神经元激活模式略有移动以适应噪声标签。总之,我们的研究结果表明,语言模型中标签噪声的记忆建立在底层推理机制之上,而不是覆盖它们,从而揭示了良性记忆的有趣现象。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在训练过程中记忆噪声标签的问题,并探究这种记忆行为对模型推理能力的影响。现有方法通常将记忆视为与推理能力相悖的现象,认为过度记忆会导致泛化能力下降。然而,LLM在存在大量噪声标签的情况下仍然表现出强大的推理能力,这表明记忆和推理之间可能存在更复杂的联系。

核心思路:论文的核心思路是,LLM对噪声标签的记忆并非简单的查找表式记忆,而是与模型的推理机制紧密相关。模型在记忆噪声标签时,会利用其内在的推理能力来处理输入,并对中间推理结果进行编码,从而实现对噪声标签的记忆。这种记忆方式可以避免对噪声标签的过度依赖,从而保持模型的泛化能力。

技术框架:论文的技术框架主要包括以下几个部分:1)构建带有噪声标签的可控合成推理数据集,包括四位数加法(FDA)和两跳关系推理(THR);2)训练LLM在这些数据集上进行推理;3)设计实验来探究LLM在记忆噪声标签时的行为,例如,通过干预中间推理步骤来观察对记忆效果的影响;4)分析LLM的内部表示,例如神经元激活模式,来理解记忆的机制。

关键创新:论文最重要的技术创新点在于,揭示了LLM对噪声标签的记忆并非简单的查找表式记忆,而是与模型的推理机制紧密相关。具体来说,论文发现LLM在记忆噪声标签时,会继续进行中间推理步骤,并且推理过程会影响记忆效果。此外,论文还发现记忆是通过分布式编码实现的,而不是通过构建从输入到噪声标签的直接映射。

关键设计:论文的关键设计包括:1)使用可控的合成数据集,可以精确控制噪声标签的比例和类型;2)设计干预实验,通过改变中间推理步骤来观察对记忆效果的影响;3)分析神经元激活模式,来理解记忆的机制。论文没有特别提及损失函数和网络结构的特殊设计,而是侧重于实验设计和结果分析。

🖼️ 关键图片

📊 实验亮点

研究表明,即使存在噪声标签,LLM仍然会计算中间推理步骤,并且干预推理会影响记忆效果。FDA案例研究揭示,记忆是通过异常值启发式实现的,即通过轻微调整神经元激活模式来适应噪声标签。这些发现表明,LLM对噪声标签的记忆建立在推理机制之上,而非取代它。

🎯 应用场景

该研究成果有助于更好地理解大型语言模型的记忆机制,并为提高模型的鲁棒性和泛化能力提供指导。潜在应用领域包括:开发更可靠的自然语言处理系统,减少噪声数据对模型性能的影响;设计更有效的训练方法,提高模型在真实世界场景中的适应性;改进模型的解释性,更好地理解模型的内部工作机制。

📄 摘要(原文)

Large language models readily memorize arbitrary training instances, such as label noise, yet they perform strikingly well on reasoning tasks. In this work, we investigate how language models memorize label noise, and why such memorization in many cases does not heavily affect generalizable reasoning capabilities. Using two controllable synthetic reasoning datasets with noisy labels, four-digit addition (FDA) and two-hop relational reasoning (THR), we discover a reliance of memorization on generalizable reasoning mechanisms: models continue to compute intermediate reasoning outputs even when retrieving memorized noisy labels, and intervening reasoning adversely affects memorization. We further show that memorization operates through distributed encoding, i.e., aggregating various inputs and intermediate results, rather than building a look-up mechanism from inputs to noisy labels. Moreover, our FDA case study reveals memorization occurs via outlier heuristics, where existing neuron activation patterns are slightly shifted to fit noisy labels. Together, our findings suggest that memorization of label noise in language models builds on, rather than overrides, the underlying reasoning mechanisms, shedding lights on the intriguing phenomenon of benign memorization.