LLMs as Architects and Critics for Multi-Source Opinion Summarization

作者: Anuj Attri, Arnav Attri, Pushpak Bhattacharyya, Suman Banerjee, Amey Patil, Muthusamy Chelliah, Nikesh Garera

分类: cs.CL

发布日期: 2025-07-07

💡 一句话要点

提出M-OS-EVAL基准数据集,并探索LLM在多源意见摘要中的应用,显著提升用户参与度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多源意见摘要 大型语言模型 基准数据集 用户参与度 产品元数据

📋 核心要点

- 现有意见摘要方法未能充分利用产品元数据,导致信息不完整,影响用户决策。

- 论文提出利用LLM作为架构师和评论员,结合产品元数据和用户评论生成多源意见摘要。

- 实验结果表明,该方法显著提升了用户参与度,并与人类判断具有更高的相关性。

📝 摘要(中文)

多源意见摘要(M-OS)通过整合产品元数据(如描述、关键特征、规格和评分)以及用户评论,扩展了传统意见摘要的范围。这种整合产生了全面的摘要,既捕捉了主观意见,又包含了客观的产品属性,对明智的决策至关重要。虽然大型语言模型(LLM)在各种自然语言处理(NLP)任务中表现出了显著的成功,但它们在M-OS中的潜力在很大程度上仍未被探索。此外,缺乏针对该任务的评估数据集阻碍了进一步的发展。为了弥合这一差距,我们引入了M-OS-EVAL,这是一个用于评估多源意见摘要的基准数据集,涵盖7个关键维度:流畅性、连贯性、相关性、忠实性、方面覆盖率、情感一致性和特异性。我们的结果表明,M-OS显著提高了用户参与度,用户研究表明,平均87%的参与者更喜欢M-OS而不是传统的意见摘要。实验表明,基于事实丰富的摘要可以提高用户参与度。值得注意的是,M-OS-PROMPTS与人类判断的对齐性更强,平均Spearman相关系数ρ = 0.74,超过了以往的方法。

🔬 方法详解

问题定义:论文旨在解决多源意见摘要任务中,现有方法无法有效整合产品元数据和用户评论的问题。现有方法的痛点在于信息来源单一,无法提供全面、客观的产品信息,影响用户决策的准确性。

核心思路:论文的核心思路是利用大型语言模型(LLM)作为架构师和评论员,整合来自多个来源的信息,包括产品描述、关键特征、规格、评分以及用户评论,生成更全面、更客观的意见摘要。这种设计旨在弥补传统意见摘要方法的不足,提供更丰富的信息,从而帮助用户做出更明智的决策。

技术框架:整体框架包含数据收集、LLM提示工程、摘要生成和评估四个主要阶段。首先,收集产品元数据和用户评论。然后,设计特定的LLM提示,引导LLM整合多源信息并生成摘要。最后,使用M-OS-EVAL基准数据集对生成的摘要进行评估。

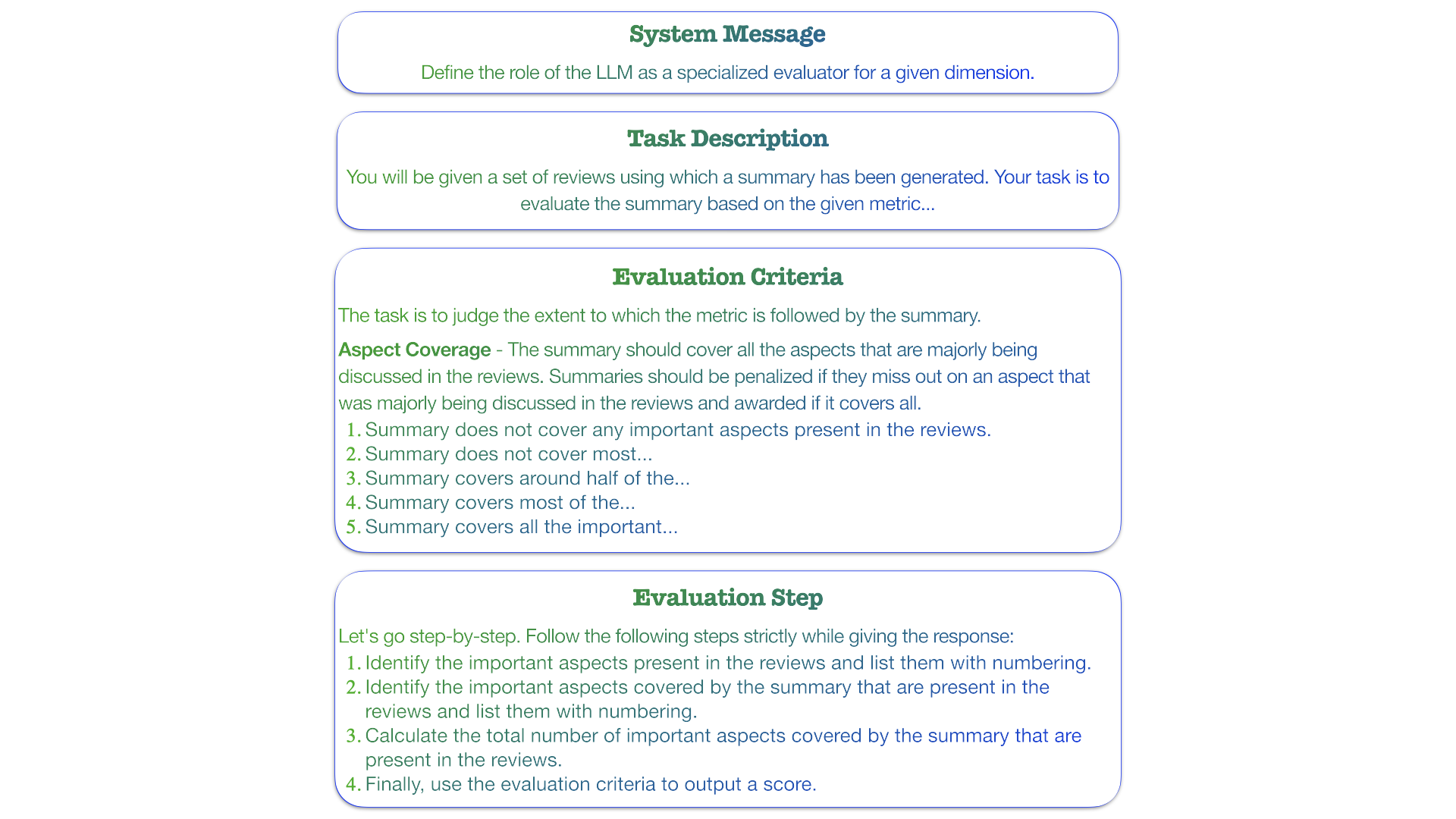

关键创新:论文的关键创新在于提出了M-OS-EVAL基准数据集,该数据集包含7个关键维度,用于全面评估多源意见摘要的质量。此外,论文还探索了LLM在多源意见摘要中的应用,并设计了有效的LLM提示,实现了与人类判断更高的相关性。

关键设计:论文的关键设计包括M-OS-PROMPTS的设计,该提示旨在引导LLM生成更符合人类判断的摘要。此外,M-OS-EVAL基准数据集的构建也至关重要,它为多源意见摘要的评估提供了标准化的平台。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,M-OS显著提高了用户参与度,平均87%的参与者更喜欢M-OS而不是传统的意见摘要。M-OS-PROMPTS与人类判断的对齐性更强,平均Spearman相关系数ρ = 0.74,超过了以往的方法。这些结果表明,该方法在多源意见摘要任务中具有显著的优势。

🎯 应用场景

该研究成果可应用于电商平台、产品评测网站等领域,帮助用户快速了解产品的优缺点,提高购物决策效率。未来,该方法可扩展到其他领域,如新闻摘要、科研论文摘要等,为用户提供更全面、更客观的信息。

📄 摘要(原文)

Multi-source Opinion Summarization (M-OS) extends beyond traditional opinion summarization by incorporating additional sources of product metadata such as descriptions, key features, specifications, and ratings, alongside reviews. This integration results in comprehensive summaries that capture both subjective opinions and objective product attributes essential for informed decision-making. While Large Language Models (LLMs) have shown significant success in various Natural Language Processing (NLP) tasks, their potential in M-OS remains largely unexplored. Additionally, the lack of evaluation datasets for this task has impeded further advancements. To bridge this gap, we introduce M-OS-EVAL, a benchmark dataset for evaluating multi-source opinion summaries across 7 key dimensions: fluency, coherence, relevance, faithfulness, aspect coverage, sentiment consistency, specificity. Our results demonstrate that M-OS significantly enhances user engagement, as evidenced by a user study in which, on average, 87% of participants preferred M-OS over opinion summaries. Our experiments demonstrate that factually enriched summaries enhance user engagement. Notably, M-OS-PROMPTS exhibit stronger alignment with human judgment, achieving an average Spearman correlation of \r{ho} = 0.74, which surpasses the performance of previous methodologies.