MemOS: A Memory OS for AI System

作者: Zhiyu Li, Chenyang Xi, Chunyu Li, Ding Chen, Boyu Chen, Shichao Song, Simin Niu, Hanyu Wang, Jiawei Yang, Chen Tang, Qingchen Yu, Jihao Zhao, Yezhaohui Wang, Peng Liu, Zehao Lin, Pengyuan Wang, Jiahao Huo, Tianyi Chen, Kai Chen, Kehang Li, Zhen Tao, Huayi Lai, Hao Wu, Bo Tang, Zhengren Wang, Zhaoxin Fan, Ningyu Zhang, Linfeng Zhang, Junchi Yan, Mingchuan Yang, Tong Xu, Wei Xu, Huajun Chen, Haofen Wang, Hongkang Yang, Wentao Zhang, Zhi-Qin John Xu, Siheng Chen, Feiyu Xiong

分类: cs.CL

发布日期: 2025-07-04 (更新: 2025-12-03)

备注: 36 pages, 10 figures, 5 tables

💡 一句话要点

提出MemOS:面向AI系统的内存操作系统,解决LLM长期记忆管理难题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 内存操作系统 大型语言模型 长期记忆 知识管理 持续学习

📋 核心要点

- 现有LLM缺乏有效的长期记忆管理机制,难以实现长上下文推理和知识的持续更新。

- MemOS将内存视为可管理的系统资源,统一管理不同类型的记忆,实现高效存储和检索。

- MemOS通过MemCube封装记忆单元,支持记忆的组合、迁移和融合,实现记忆类型的灵活转换。

📝 摘要(中文)

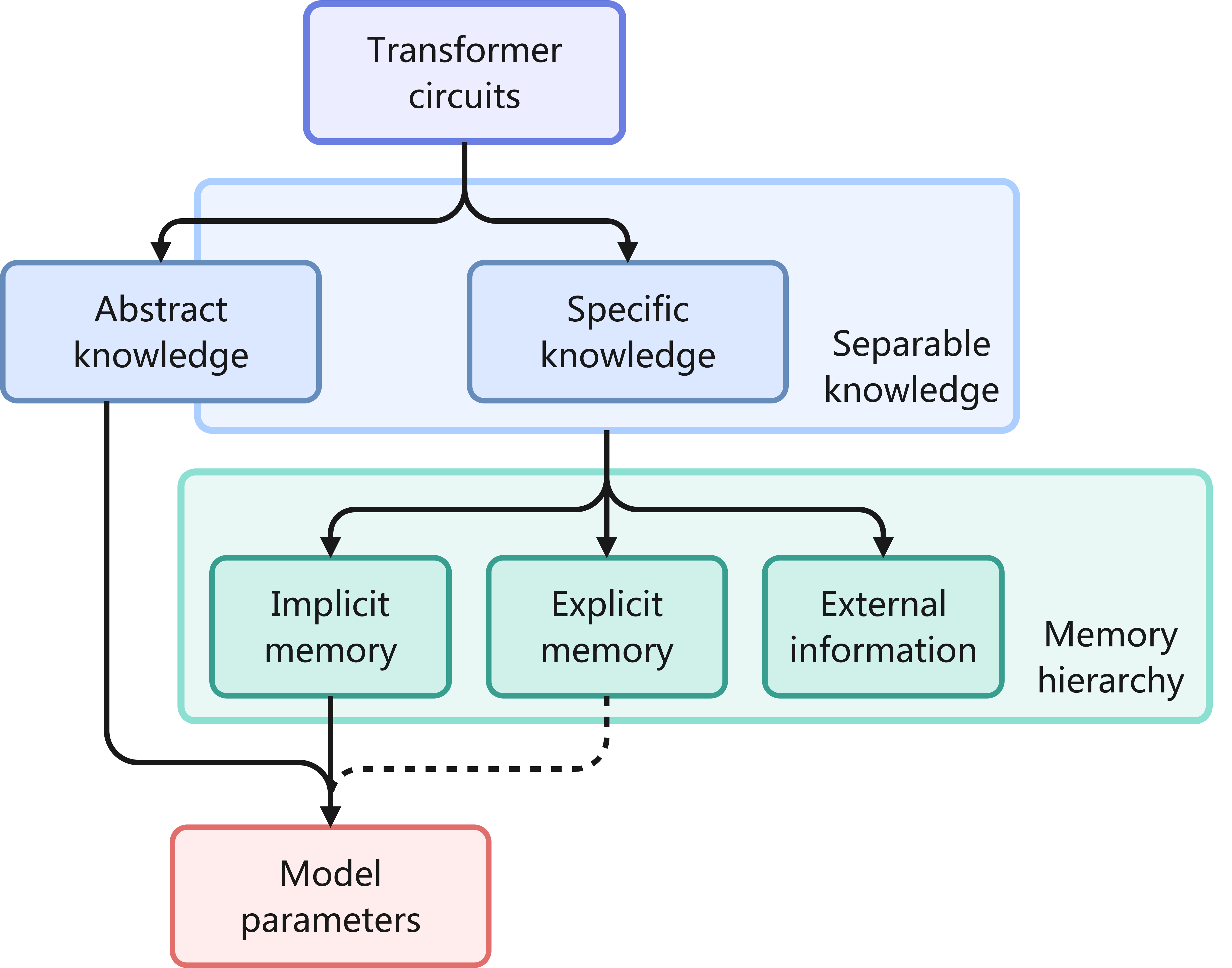

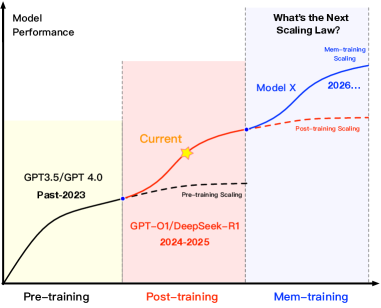

大型语言模型(LLM)已成为通用人工智能(AGI)的重要基础设施,但缺乏完善的内存管理系统阻碍了长上下文推理、持续个性化和知识一致性的发展。现有模型主要依赖静态参数和短暂的上下文状态,限制了它们跟踪用户偏好或在较长时间内更新知识的能力。检索增强生成(RAG)虽然引入了外部知识,但仍然是一种无状态的变通方法,缺乏生命周期控制或与持久表示的集成。最近的研究从内存层次结构的角度对LLM的训练和推理成本进行了建模,表明在参数记忆和外部检索之间引入显式内存层可以显著降低这些成本。除了计算效率之外,LLM还面临着信息随时间和上下文分布的挑战,需要能够管理跨不同时间尺度和来源的异构知识的系统。为了应对这一挑战,我们提出了MemOS,一种将内存视为可管理系统资源的内存操作系统。它统一了明文、基于激活和参数级内存的表示、调度和演化,从而实现经济高效的存储和检索。作为基本单元,MemCube封装了内存内容和元数据,如来源和版本控制。MemCube可以随时间推移进行组合、迁移和融合,从而实现内存类型之间的灵活转换,并将检索与基于参数的学习联系起来。MemOS建立了一个以内存为中心的系统框架,为LLM带来了可控性、可塑性和可进化性,为持续学习和个性化建模奠定了基础。

🔬 方法详解

问题定义:现有大型语言模型(LLM)在处理长上下文、持续学习和个性化建模时,面临着记忆管理的挑战。传统的LLM主要依赖于静态参数和短暂的上下文状态,无法有效地跟踪用户偏好或长期积累知识。检索增强生成(RAG)虽然引入了外部知识,但缺乏生命周期管理和与模型参数的深度集成。因此,如何构建一个高效、可控、可演化的记忆系统,成为提升LLM能力的关键问题。

核心思路:MemOS的核心思路是将内存视为一个可管理的系统资源,类似于操作系统管理硬件资源的方式。通过统一的表示、调度和演化机制,MemOS能够有效地管理不同类型的记忆(明文、激活、参数),并实现它们之间的灵活转换。这种以内存为中心的系统框架,旨在为LLM带来可控性、可塑性和可进化性,从而支持持续学习和个性化建模。

技术框架:MemOS的整体架构包含以下几个主要模块:1) 统一的记忆表示:使用MemCube作为基本单元,封装记忆内容和元数据(来源、版本等)。2) 记忆调度:根据需求和资源情况,动态地分配和管理不同类型的记忆。3) 记忆演化:支持记忆的组合、迁移和融合,实现记忆类型的灵活转换。4) 记忆检索:提供高效的记忆检索机制,支持基于内容的检索和基于元数据的过滤。

关键创新:MemOS的关键创新在于其以内存为中心的系统设计,将内存视为一个可管理的资源。与传统的LLM相比,MemOS能够更有效地管理和利用不同类型的记忆,从而提升模型的长期记忆能力和适应性。此外,MemOS还引入了MemCube的概念,作为统一的记忆表示单元,简化了记忆的管理和操作。

关键设计:MemOS的关键设计包括:1) MemCube的结构:MemCube包含记忆内容和元数据,元数据用于记录记忆的来源、版本、重要性等信息。2) 记忆调度算法:根据记忆的类型、重要性和访问频率,动态地分配和管理记忆资源。3) 记忆演化机制:支持记忆的组合、迁移和融合,例如将明文记忆转化为参数记忆,或将多个MemCube合并为一个。4) 记忆检索算法:采用高效的索引结构和检索算法,支持快速的记忆检索。

🖼️ 关键图片

📊 实验亮点

论文尚未提供具体的实验结果和性能数据。但其提出的MemOS架构,为解决LLM的长期记忆管理问题提供了一个新的思路。未来的研究可以基于MemOS框架,设计具体的记忆管理算法和策略,并通过实验验证其有效性。

🎯 应用场景

MemOS有望应用于需要长期记忆和知识更新的各种场景,例如:个性化推荐系统、智能客服、持续学习的机器人、以及需要长期上下文理解的对话系统。通过提供可控、可塑和可进化的记忆管理能力,MemOS能够显著提升这些应用的用户体验和智能化水平,并为通用人工智能的发展奠定基础。

📄 摘要(原文)

Large Language Models (LLMs) have become an essential infrastructure for Artificial General Intelligence (AGI), yet their lack of well-defined memory management systems hinders the development of long-context reasoning, continual personalization, and knowledge consistency.Existing models mainly rely on static parameters and short-lived contextual states, limiting their ability to track user preferences or update knowledge over extended periods.While Retrieval-Augmented Generation (RAG) introduces external knowledge in plain text, it remains a stateless workaround without lifecycle control or integration with persistent representations.Recent work has modeled the training and inference cost of LLMs from a memory hierarchy perspective, showing that introducing an explicit memory layer between parameter memory and external retrieval can substantially reduce these costs by externalizing specific knowledge. Beyond computational efficiency, LLMs face broader challenges arising from how information is distributed over time and context, requiring systems capable of managing heterogeneous knowledge spanning different temporal scales and sources. To address this challenge, we propose MemOS, a memory operating system that treats memory as a manageable system resource. It unifies the representation, scheduling, and evolution of plaintext, activation-based, and parameter-level memories, enabling cost-efficient storage and retrieval. As the basic unit, a MemCube encapsulates both memory content and metadata such as provenance and versioning. MemCubes can be composed, migrated, and fused over time, enabling flexible transitions between memory types and bridging retrieval with parameter-based learning. MemOS establishes a memory-centric system framework that brings controllability, plasticity, and evolvability to LLMs, laying the foundation for continual learning and personalized modeling.