Dissecting the Impact of Mobile DVFS Governors on LLM Inference Performance and Energy Efficiency

作者: Zongpu Zhang, Pranab Dash, Y. Charlie Hu, Qiang Xu, Jian Li, Haibing Guan

分类: cs.OS, cs.CL

发布日期: 2025-07-02

备注: equal contribution between Zhang and Dash

💡 一句话要点

针对移动端LLM推理能效问题,提出统一的能量感知DVFS调控器FUSE。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动设备 大语言模型 LLM推理 能效优化 DVFS调控 能量感知 性能优化

📋 核心要点

- 现有移动设备上的LLM推理能效低,原因是CPU、GPU和内存的DVFS调控器独立运行,缺乏协同优化。

- 论文提出FUSE,一种统一的能量感知调控器,通过协同优化CPU、GPU和内存频率来提升LLM推理能效。

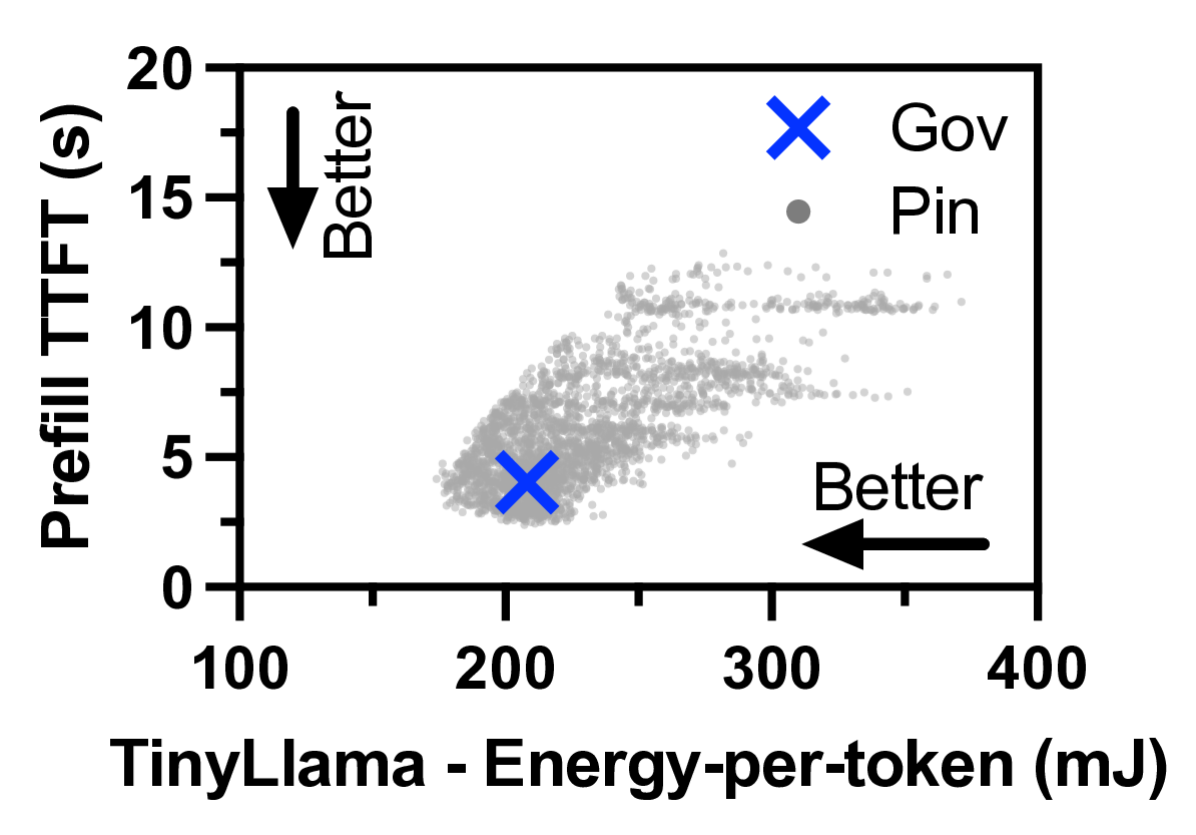

- 实验结果表明,FUSE在相同能耗下,显著降低了首token延迟和每输出token延迟,提升了LLM推理性能。

📝 摘要(中文)

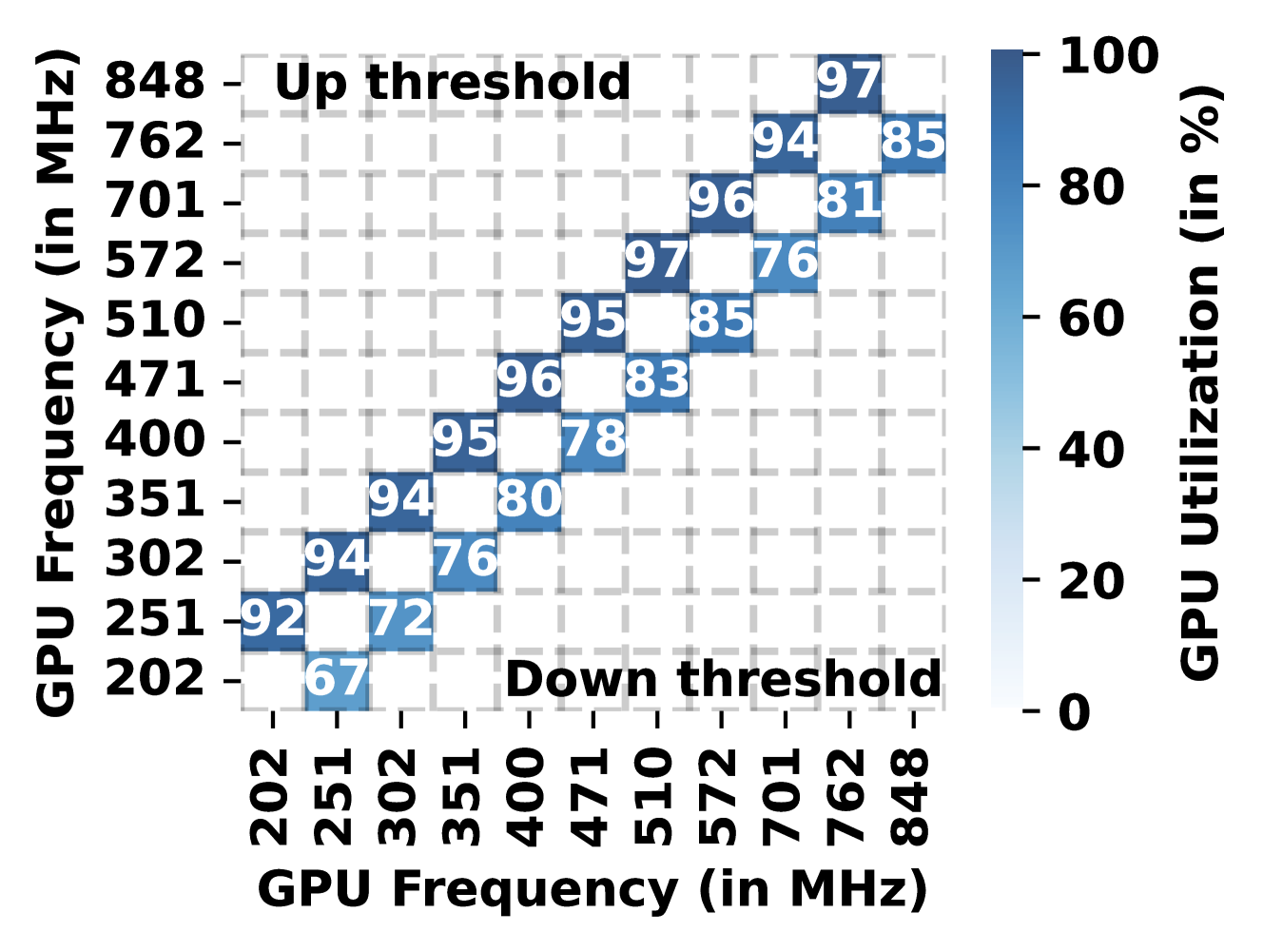

大型语言模型(LLM)正日益集成到运行于数十亿移动设备上的各种应用和服务中。然而,由于LLM对计算、内存和能量的高需求,在资源受限的移动设备上部署LLM面临着重大挑战。目前移动LLM框架即使在运行主要基于GPU的LLM模型时,也会使用CPU、GPU和内存这三个耗电组件。现代移动设备中针对CPU、GPU和内存的优化DVFS调控器独立运行,彼此之间没有感知。基于此,本文首先测量了移动电话上包含各种LLM模型的SOTA LLM框架的能效,结果表明,对于采样的预填充和解码长度,三元组移动调控器导致预填充和解码延迟比CPU、GPU和内存频率的最佳组合长达40.4%,且能量消耗相同。其次,我们进行了一项深入的测量研究,以揭示移动调控器之间复杂的相互作用(或缺乏相互作用)如何导致LLM推理效率低下。最后,基于这些见解,我们设计了FUSE——一种统一的能量感知调控器,用于优化移动设备上LLM推理的能效。使用ShareGPT数据集的评估表明,对于各种移动LLM模型,FUSE在相同的每token能量下,平均降低了7.0%-16.9%的首token延迟和25.4%-36.8%的每输出token延迟。

🔬 方法详解

问题定义:论文旨在解决移动设备上LLM推理能效低下的问题。现有方法中,CPU、GPU和内存的DVFS(动态电压频率调整)调控器各自独立运行,无法感知彼此的状态,导致在LLM推理过程中,可能出现某个组件过载而其他组件空闲的情况,从而造成能量浪费和性能瓶颈。现有方法缺乏对LLM推理过程中不同组件之间相互依赖关系的建模和优化。

核心思路:论文的核心思路是设计一个统一的能量感知DVFS调控器,即FUSE,该调控器能够同时考虑CPU、GPU和内存的负载情况,并根据LLM推理的特点,动态调整它们的频率,从而在满足性能需求的前提下,最小化能量消耗。FUSE的设计目标是实现全局优化,避免局部最优。

技术框架:FUSE的整体架构包含以下几个主要模块:1) 性能监控模块:实时监控CPU、GPU和内存的利用率和延迟等性能指标。2) 能量模型模块:建立CPU、GPU和内存的能量消耗模型,用于预测不同频率下的能量消耗。3) 优化决策模块:基于性能监控数据和能量模型,使用优化算法(具体算法未知)确定CPU、GPU和内存的最佳频率组合。4) DVFS控制模块:将优化决策模块的输出应用到实际的DVFS控制器上,调整CPU、GPU和内存的频率。

关键创新:论文的关键创新在于提出了统一的能量感知调控器FUSE,打破了传统DVFS调控器各自独立的模式。FUSE能够全局优化CPU、GPU和内存的频率,从而更好地适应LLM推理的需求。与现有方法相比,FUSE能够更有效地利用硬件资源,降低能量消耗,提升推理性能。

关键设计:论文中没有详细描述FUSE的关键参数设置、损失函数或网络结构等技术细节。但是,可以推测,FUSE的优化决策模块可能使用了某种强化学习或模型预测控制算法,以实现动态频率调整。能量模型的准确性对FUSE的性能至关重要,可能需要进行精细的校准和验证。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在ShareGPT数据集上,FUSE能够显著降低移动LLM模型的推理延迟。具体而言,FUSE在相同的每token能量下,平均降低了7.0%-16.9%的首token延迟和25.4%-36.8%的每输出token延迟。这些数据表明,FUSE能够有效地提升移动设备上LLM推理的性能,同时保持较低的能量消耗。

🎯 应用场景

该研究成果可广泛应用于移动设备上的LLM应用,例如智能助手、机器翻译、图像识别等。通过优化LLM推理的能效,可以延长移动设备的电池续航时间,提升用户体验。此外,该研究思路也可以推广到其他计算密集型应用,例如游戏、视频处理等,具有重要的实际价值和广泛的应用前景。

📄 摘要(原文)

Large Language Models (LLMs) are increasingly being integrated into various applications and services running on billions of mobile devices. However, deploying LLMs on resource-limited mobile devices faces a significant challenge due to their high demand for computation, memory, and ultimately energy. While current LLM frameworks for mobile use three power-hungry components-CPU, GPU, and Memory-even when running primarily-GPU LLM models, optimized DVFS governors for CPU, GPU, and memory featured in modern mobile devices operate independently and are oblivious of each other. Motivated by the above observation, in this work, we first measure the energy-efficiency of a SOTA LLM framework consisting of various LLM models on mobile phones which showed the triplet mobile governors result in up to 40.4% longer prefilling and decoding latency compared to optimal combinations of CPU, GPU, and memory frequencies with the same energy consumption for sampled prefill and decode lengths. Second, we conduct an in-depth measurement study to uncover how the intricate interplay (or lack of) among the mobile governors cause the above inefficiency in LLM inference. Finally, based on these insights, we design FUSE - a unified energy-aware governor for optimizing the energy efficiency of LLM inference on mobile devices. Our evaluation using a ShareGPT dataset shows FUSE reduces the time-to-first-token and time-per-output-token latencies by 7.0%-16.9% and 25.4%-36.8% on average with the same energy-per-token for various mobile LLM models.