Eka-Eval: An Evaluation Framework for Low-Resource Multilingual Large Language Models

作者: Samridhi Raj Sinha, Rajvee Sheth, Abhishek Upperwal, Mayank Singh

分类: cs.CL

发布日期: 2025-07-02 (更新: 2025-12-02)

🔗 代码/项目: GITHUB

💡 一句话要点

Eka-Eval:一个面向低资源多语言大语言模型的评估框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型评估 低资源语言 多语言模型 评估框架 基准测试

📋 核心要点

- 现有大语言模型评估框架缺乏对低资源多语言的全面支持,限制了其全球适用性。

- EKA-EVAL通过统一的平台,集成多语言基准和模块化架构,提供可扩展的低资源语言评估能力。

- 实验表明,EKA-EVAL在用户满意度、设置时间和基准可重复性方面优于现有基线至少2倍。

📝 摘要(中文)

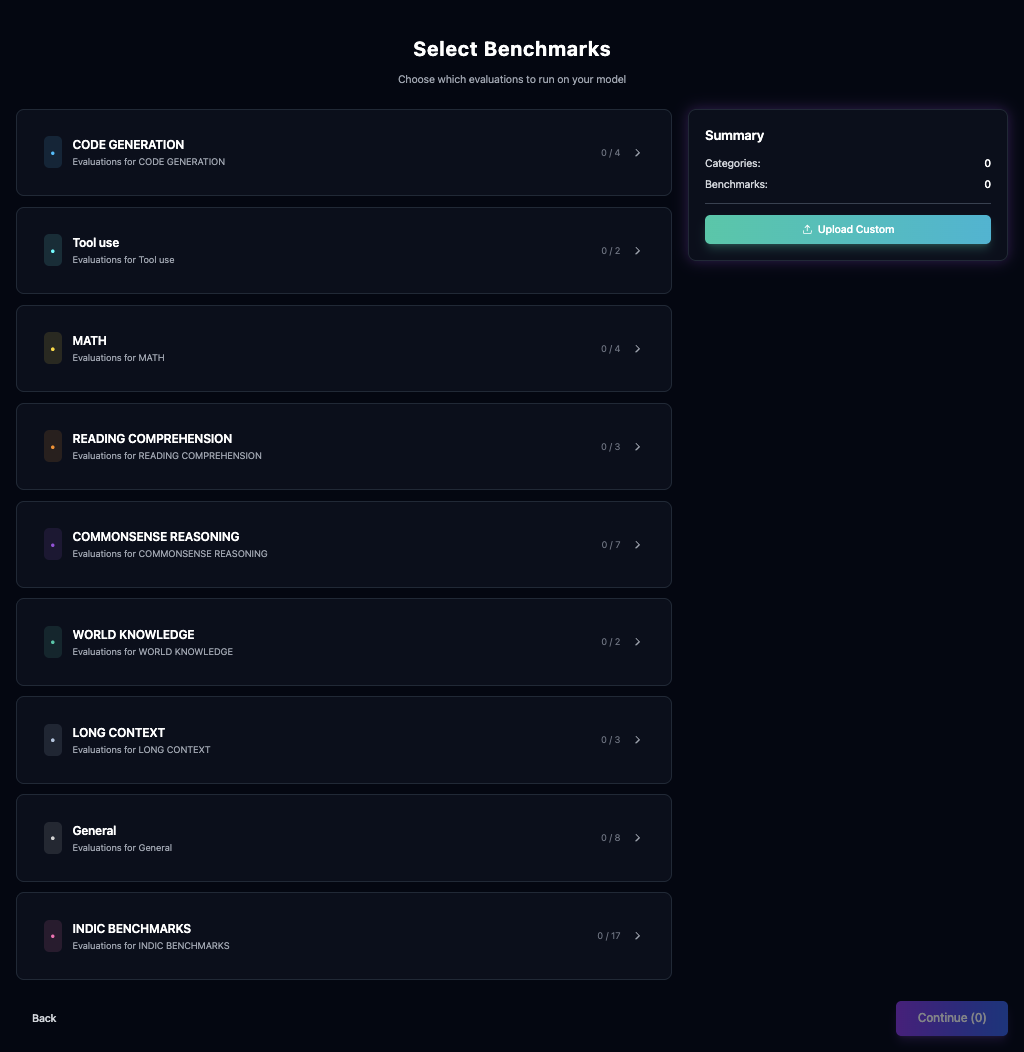

大语言模型(LLM)的快速发展凸显了对全球适用、灵活和模块化的评估框架的需求,这些框架应支持广泛的任务、模型类型和语言环境。我们推出了EKA-EVAL,一个统一的端到端框架,它结合了零代码Web界面和交互式CLI,以确保广泛的可访问性。它集成了跨九个评估类别的50多个多语言基准,支持本地和专有模型,并通过模块化、即插即用架构提供11个核心功能。EKA-EVAL专为可扩展的多语言评估而设计,并支持低资源多语言,据我们所知,它是第一个在单个平台上提供全面覆盖的套件。与五个现有基线的比较表明,在关键可用性指标上至少提高了2倍,具有最高的用户满意度、更快的设置时间和一致的基准可重复性。该框架是开源的,可在https://github.com/lingo-iitgn/eka-eval公开获得。

🔬 方法详解

问题定义:现有的大语言模型评估框架在全球适用性、灵活性和模块化方面存在不足,尤其是在对低资源多语言的支持上。这限制了这些模型在更广泛的语言环境中的应用和发展。现有的评估工具通常难以覆盖大量的多语言基准,并且缺乏对本地和专有模型的支持。此外,设置复杂、可重复性差也是现有评估框架的痛点。

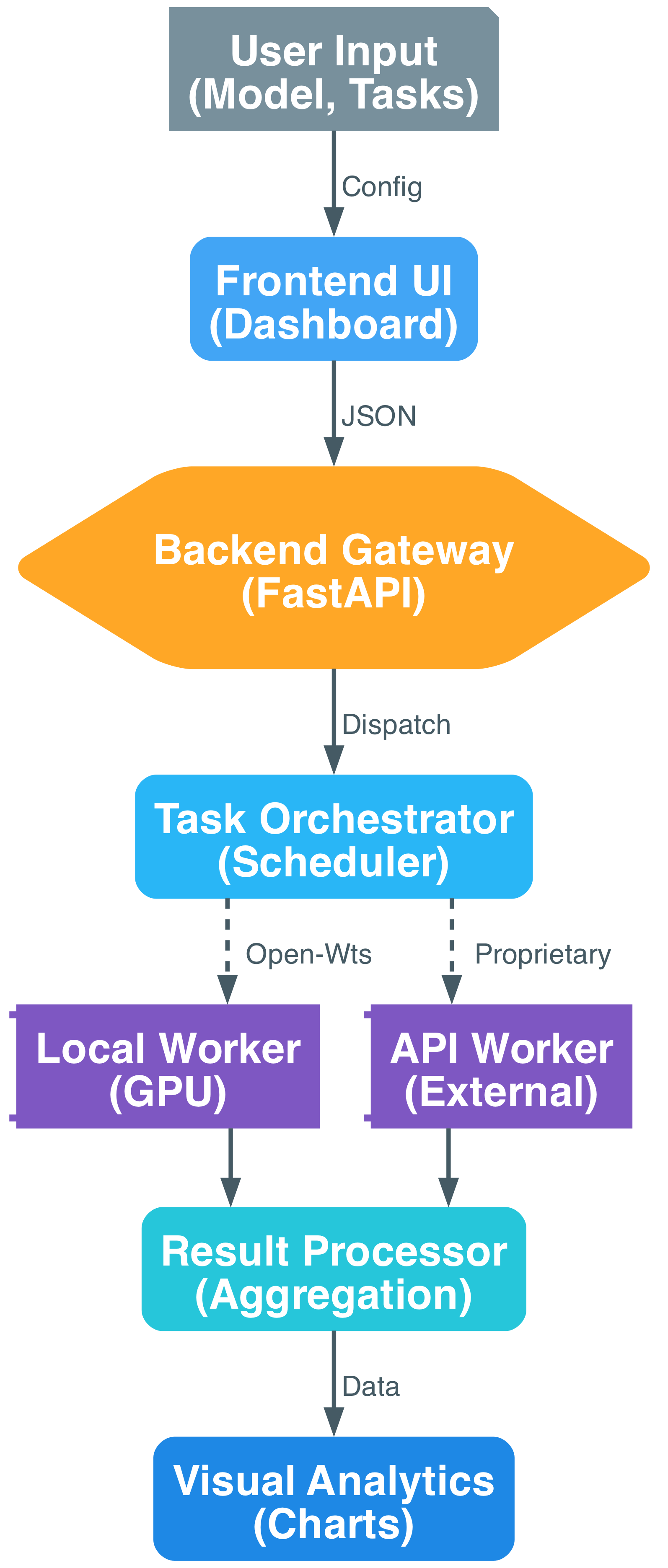

核心思路:EKA-EVAL的核心思路是构建一个统一、端到端的评估框架,该框架能够支持广泛的多语言基准,并提供灵活的模块化架构,从而简化评估流程并提高可重复性。通过提供零代码Web界面和交互式CLI,EKA-EVAL旨在降低使用门槛,使更多的研究人员和开发者能够方便地评估其模型在不同语言环境下的性能。

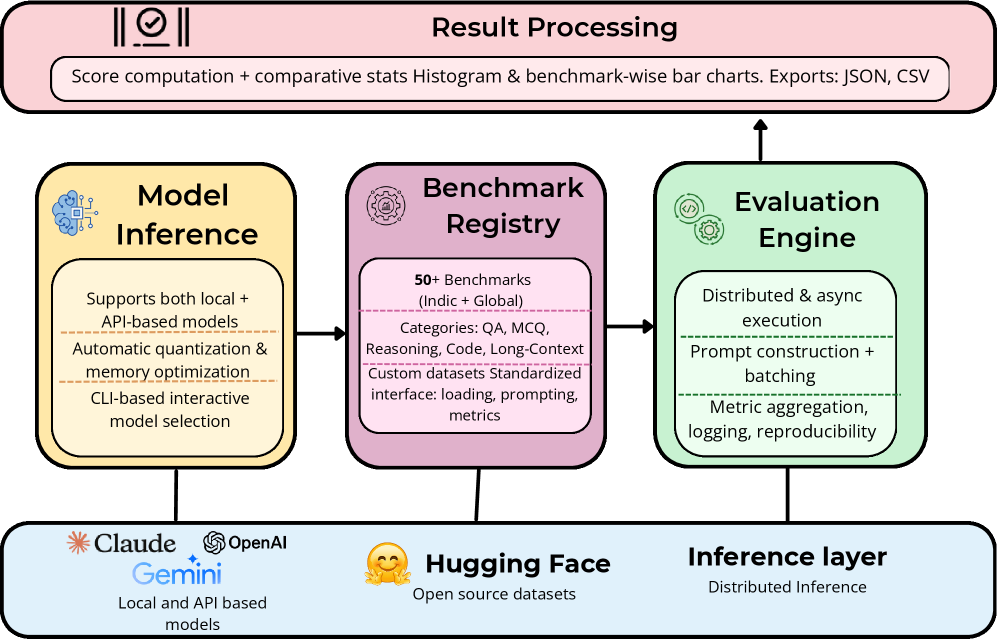

技术框架:EKA-EVAL的技术框架包括以下几个主要模块:1) 数据集集成模块,负责集成50+多语言基准数据集;2) 模型支持模块,支持本地和专有模型;3) 评估指标计算模块,提供多种评估指标的计算;4) 用户界面模块,包括零代码Web界面和交互式CLI;5) 模块化架构,允许用户根据需要选择和组合不同的功能模块。整体流程是从数据集集成开始,然后加载待评估的模型,选择评估指标,最后通过用户界面进行评估并生成报告。

关键创新:EKA-EVAL最重要的技术创新点在于其统一性和全面性。它是第一个在单个平台上提供对低资源多语言大语言模型进行全面评估的框架。与现有方法相比,EKA-EVAL集成了更多的多语言基准,提供了更灵活的模块化架构,并简化了评估流程。此外,EKA-EVAL的零代码Web界面和交互式CLI也降低了使用门槛,使得更多的研究人员和开发者能够方便地使用该框架。

关键设计:EKA-EVAL的关键设计包括:1) 模块化架构,允许用户根据需要选择和组合不同的功能模块;2) 零代码Web界面和交互式CLI,降低使用门槛;3) 对低资源多语言的全面支持,包括数据集和评估指标;4) 可扩展性设计,支持大规模的评估任务;5) 可重复性设计,确保评估结果的一致性。

🖼️ 关键图片

📊 实验亮点

EKA-EVAL与五个现有基线的比较表明,在关键可用性指标上至少提高了2倍,具有最高的用户满意度、更快的设置时间和一致的基准可重复性。这些结果表明,EKA-EVAL在简化评估流程、提高评估效率和确保评估结果的可靠性方面具有显著优势。

🎯 应用场景

EKA-EVAL可应用于评估和改进低资源多语言大语言模型,推动这些模型在更广泛的语言环境中的应用。它能够帮助研究人员和开发者更好地了解其模型在不同语言下的性能,并针对性地进行优化。此外,EKA-EVAL还可以用于比较不同模型的性能,从而促进该领域的发展。未来,EKA-EVAL有望成为低资源多语言大语言模型评估的标准工具。

📄 摘要(原文)

The rapid evolution of Large Language Models' has underscored the need for evaluation frameworks that are globally applicable, flexible, and modular, and that support a wide range of tasks, model types, and linguistic settings. We introduce EKA-EVAL, a unified, end- to-end framework that combines a zero-code web interface and an interactive CLI to ensure broad accessibility. It integrates 50+ multilingual benchmarks across nine evaluation categories, supports local and proprietary models, and provides 11 core capabilities through a modular, plug-and-play architecture. Designed for scalable, multilingual evaluation with support for low-resource multilingual languages, EKA-EVAL is, to the best of our knowledge, the first suite to offer comprehensive coverage in a single platform. Comparisons against five existing baselines indicate improvements of at least 2x better on key usability measures, with the highest user satisfaction, faster setup times, and consistent benchmark reproducibility. The framework is open-source and publicly available at https://github.com/lingo-iitgn/eka-eval.