MuRating: A High Quality Data Selecting Approach to Multilingual Large Language Model Pretraining

作者: Zhixun Chen, Ping Guo, Wenhan Han, Yifan Zhang, Binbin Liu, Haobin Lin, Fengze Liu, Yan Zhao, Bingni Zhang, Taifeng Wang, Yin Zheng, Meng Fang

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-07-02 (更新: 2025-12-30)

备注: NeurIPS 2025 poster

💡 一句话要点

MuRating:一种高质量多语言大语言模型预训练数据选择方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言大语言模型 数据选择 预训练 迁移学习 数据质量评估

📋 核心要点

- 现有基于模型的选择方法主要集中于英语,忽略了多语言数据质量评估的挑战。

- MuRating通过将高质量英语数据质量信号迁移到多种目标语言,构建统一的多语言评估器。

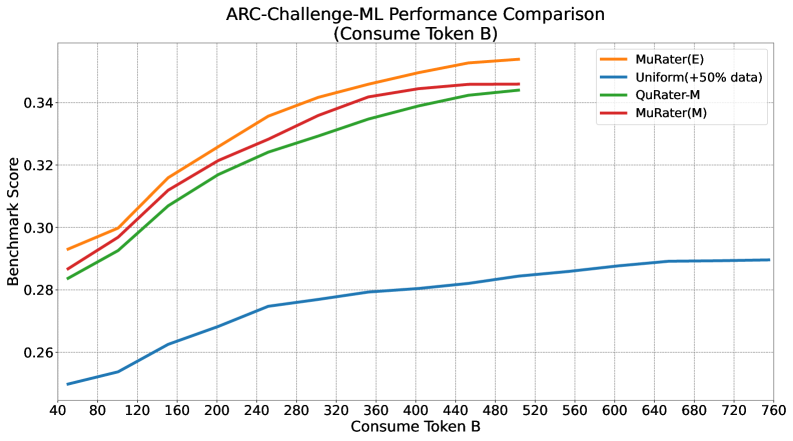

- 实验表明,MuRating在英语和多语言基准测试中均优于现有方法,尤其在知识密集型任务上提升显著。

📝 摘要(中文)

数据质量是大型语言模型性能的关键驱动因素,但现有的基于模型的选择方法几乎完全侧重于英语。我们介绍了MuRating,这是一个可扩展的框架,可将高质量的英语数据质量信号转移到17种目标语言的单个评估器中。MuRating通过成对比较聚合多个英语“评估器”,以学习统一的文档质量分数,然后通过翻译投影这些判断,以在单语、跨语言和并行文本对上训练多语言评估器。应用于网络数据时,MuRating选择英语和多语言内容的平衡子集来预训练一个12亿参数的LLaMA模型。与包括QuRater、AskLLM、DCLM等在内的强大基线相比,我们的方法提高了英语基准和多语言评估的平均准确率,尤其是在知识密集型任务上。我们进一步分析了翻译的保真度、选择偏差以及叙事材料的代表性不足,概述了未来工作的方向。

🔬 方法详解

问题定义:现有的大语言模型预训练数据选择方法,尤其是基于模型的方法,主要集中在英语数据上,缺乏对多语言数据质量的有效评估和选择机制。这导致多语言大语言模型在预训练阶段无法充分利用高质量的多语言数据,影响了模型的性能和泛化能力。现有方法难以直接应用于多语言环境,因为它们依赖于特定语言的特征或资源,并且忽略了不同语言之间的差异和关联。

核心思路:MuRating的核心思路是将高质量的英语数据质量信号迁移到其他目标语言,从而构建一个统一的多语言数据质量评估框架。该方法利用英语数据质量评估的现有成果,通过翻译和跨语言学习,将这些知识迁移到其他语言,从而避免了为每种语言单独构建评估器的复杂性和成本。通过这种迁移学习的方法,MuRating能够有效地评估和选择多语言数据,从而提高多语言大语言模型的预训练效果。

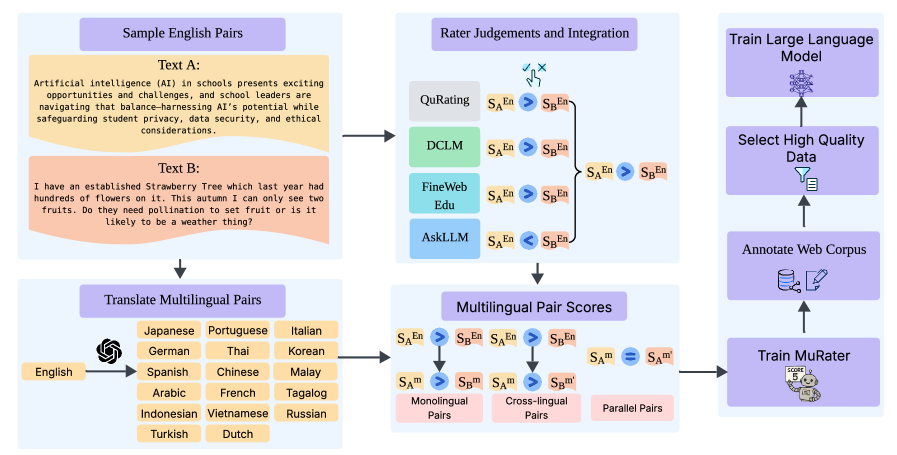

技术框架:MuRating的技术框架主要包括以下几个阶段:1) 英语评估器聚合:通过成对比较多个英语“评估器”,学习统一的文档质量分数。2) 翻译投影:通过翻译将英语评估器的判断投影到其他目标语言。3) 多语言评估器训练:利用单语、跨语言和并行文本对,训练多语言评估器。4) 数据选择:使用训练好的多语言评估器,选择高质量的英语和多语言数据子集用于预训练。

关键创新:MuRating的最重要的技术创新点在于其跨语言数据质量评估的迁移学习方法。与现有方法相比,MuRating不需要为每种语言单独构建评估器,而是通过将英语数据质量信号迁移到其他语言,实现了高效且可扩展的多语言数据质量评估。这种方法充分利用了英语数据质量评估的现有成果,并避免了为每种语言收集和标注大量数据的成本。

关键设计:MuRating的关键设计包括:1) 英语评估器的选择和聚合策略,以确保高质量的英语数据质量信号。2) 翻译模型的选择和优化,以确保翻译的准确性和保真度。3) 多语言评估器的网络结构和训练策略,以确保模型能够有效地学习和泛化到不同的语言。4) 数据选择的平衡策略,以确保预训练数据集中英语和多语言数据的比例适当。

🖼️ 关键图片

📊 实验亮点

MuRating在1.2B参数的LLaMA模型上进行了验证,实验结果表明,与QuRater、AskLLM、DCLM等基线方法相比,MuRating在英语和多语言基准测试中均取得了显著的性能提升,尤其是在知识密集型任务上。具体性能数据未知,但摘要强调了其优越性。

🎯 应用场景

MuRating可应用于多语言大语言模型的预训练数据选择,提高模型在各种语言任务上的性能。该方法能够有效提升机器翻译、跨语言信息检索、多语言文本生成等任务的效果。此外,MuRating还可用于构建高质量的多语言数据集,促进多语言自然语言处理领域的发展。未来,该技术有望应用于更多低资源语言,助力实现更加公平和普惠的语言技术。

📄 摘要(原文)

Data quality is a critical driver of large language model performance, yet existing model-based selection methods focus almost exclusively on English. We introduce MuRating, a scalable framework that transfers high-quality English data-quality signals into a single rater for 17 target languages. MuRating aggregates multiple English "raters" via pairwise comparisons to learn unified document-quality scores,then projects these judgments through translation to train a multilingual evaluator on monolingual, cross-lingual, and parallel text pairs. Applied to web data, MuRating selects balanced subsets of English and multilingual content to pretrain a 1.2 B-parameter LLaMA model. Compared to strong baselines, including QuRater, AskLLM, DCLM and so on, our approach boosts average accuracy on both English benchmarks and multilingual evaluations, with especially large gains on knowledge-intensive tasks. We further analyze translation fidelity, selection biases, and underrepresentation of narrative material, outlining directions for future work.