GAF-Guard: An Agentic Framework for Risk Management and Governance in Large Language Models

作者: Seshu Tirupathi, Dhaval Salwala, Elizabeth Daly, Inge Vejsbjerg

分类: cs.CL

发布日期: 2025-07-01 (更新: 2025-07-08)

🔗 代码/项目: GITHUB

💡 一句话要点

GAF-Guard:面向大语言模型风险管理与治理的Agent框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 风险管理 AI治理 Agent框架 安全监控

📋 核心要点

- 现有LLM监控系统主要关注模型本身的问题,忽略了特定用例和用户偏好的需求。

- GAF-Guard提出了一种以用户、用例和模型为中心的Agent框架,用于LLM风险管理和治理。

- 该框架通过自主Agent识别风险并激活风险检测工具,实现持续监控和报告,提升AI安全。

📝 摘要(中文)

随着大语言模型(LLMs)在各个领域的应用日益广泛,为了防止意外的负面影响并确保其稳健性,对其进行严格的监控变得至关重要。此外,LLM的设计必须与人类价值观保持一致,例如防止有害内容和确保负责任的使用。目前用于监控生产环境中LLM的自动化系统和解决方案主要集中在特定于LLM的问题上,如幻觉等,很少考虑特定用例和用户偏好的需求。本文介绍了一种新颖的LLM治理Agent框架GAF-Guard,该框架将用户、用例和模型本身置于中心位置。该框架旨在检测和监控与基于LLM的应用程序部署相关的风险。该方法对自主Agent进行建模,这些Agent识别风险,激活特定用例中的风险检测工具,并促进持续监控和报告,以提高AI安全性和用户期望。

🔬 方法详解

问题定义:当前大语言模型(LLM)的监控方案主要关注模型自身的缺陷,例如幻觉问题,而忽略了不同应用场景下用户特定的需求和偏好。这导致LLM在实际部署时,难以有效应对各种潜在风险,无法保证AI安全和满足用户期望。现有方法缺乏针对特定用例的风险识别和管理机制。

核心思路:GAF-Guard的核心思想是构建一个以Agent为中心的框架,将用户、用例和模型本身纳入考虑范围。通过模拟自主Agent的行为,实现对LLM应用风险的动态识别、检测和监控。这种以Agent为中心的治理方法,能够更好地适应不同应用场景的需求,提升LLM的安全性。

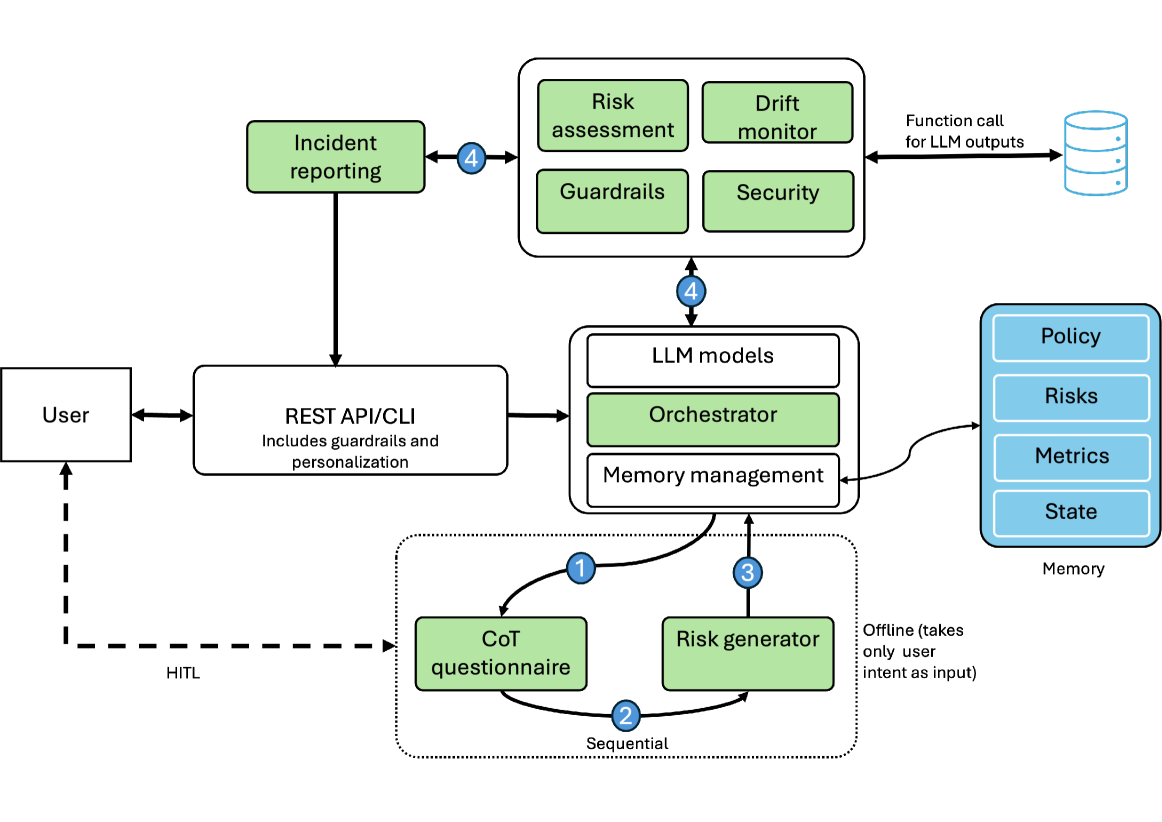

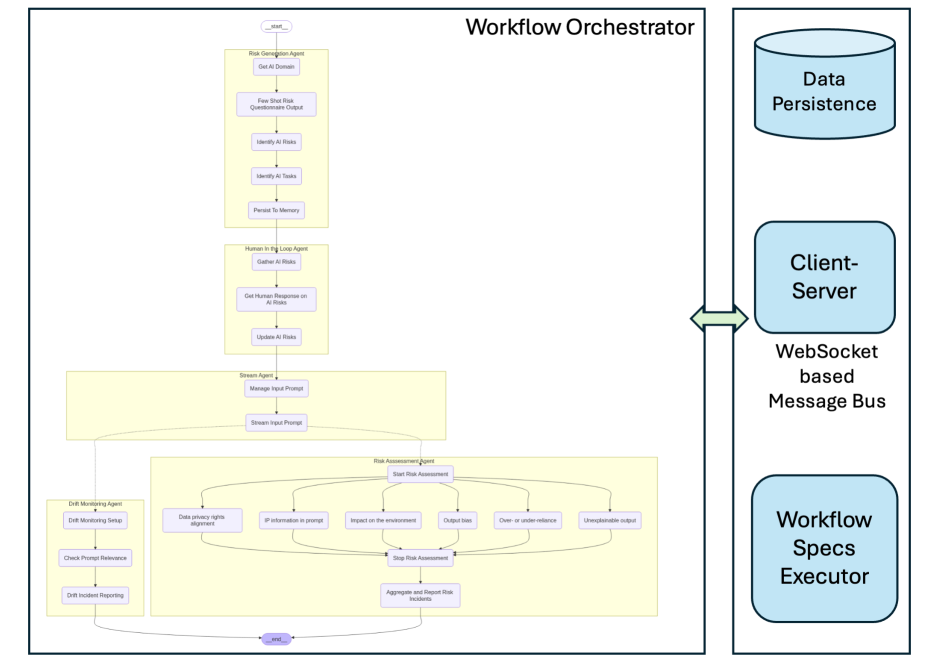

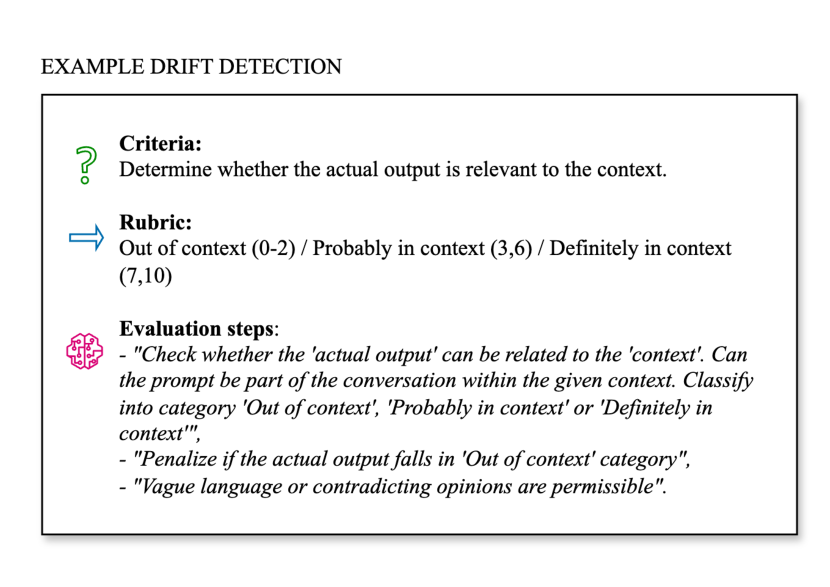

技术框架:GAF-Guard框架包含以下主要模块:1) 风险识别Agent:负责识别特定用例中可能存在的风险。2) 风险检测工具:根据识别出的风险,激活相应的检测工具。3) 监控与报告模块:持续监控LLM的行为,并生成报告,以便进行风险评估和管理。整个流程是循环迭代的,Agent不断学习和适应新的风险。

关键创新:GAF-Guard的关键创新在于其Agentic的设计理念,将LLM的治理过程视为一个由多个自主Agent协同完成的任务。与传统的静态监控方法相比,GAF-Guard能够动态地适应不同的应用场景和用户需求,更有效地识别和管理LLM的风险。此外,该框架强调用户参与,将用户偏好纳入风险评估过程。

关键设计:GAF-Guard框架中,Agent的设计至关重要。每个Agent都具有特定的角色和职责,例如风险识别、风险检测等。Agent之间通过消息传递进行协作。风险检测工具的选择取决于识别出的风险类型,可以使用现有的LLM安全工具,也可以根据特定用例定制新的工具。框架的具体实现细节(例如Agent的内部结构、消息传递机制等)在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文提供了一个开源代码库,展示了GAF-Guard框架的初步实现。虽然论文中没有提供具体的性能数据或与其他基线的详细对比,但该框架的设计理念和初步实现为LLM的风险管理和治理提供了一个新的思路。未来的研究可以进一步完善该框架,并进行更全面的实验评估。

🎯 应用场景

GAF-Guard框架可应用于各种基于LLM的应用程序,例如智能客服、内容生成、代码生成等。通过持续监控和风险管理,可以有效防止LLM生成有害内容、泄露用户隐私或产生其他负面影响。该研究有助于提升LLM的安全性、可靠性和用户满意度,促进LLM在各个领域的广泛应用。

📄 摘要(原文)

As Large Language Models (LLMs) continue to be increasingly applied across various domains, their widespread adoption necessitates rigorous monitoring to prevent unintended negative consequences and ensure robustness. Furthermore, LLMs must be designed to align with human values, like preventing harmful content and ensuring responsible usage. The current automated systems and solutions for monitoring LLMs in production are primarily centered on LLM-specific concerns like hallucination etc, with little consideration given to the requirements of specific use-cases and user preferences. This paper introduces GAF-Guard, a novel agentic framework for LLM governance that places the user, the use-case, and the model itself at the center. The framework is designed to detect and monitor risks associated with the deployment of LLM based applications. The approach models autonomous agents that identify risks, activate risk detection tools, within specific use-cases and facilitate continuous monitoring and reporting to enhance AI safety, and user expectations. The code is available at https://github.com/IBM/risk-atlas-nexus-demos/tree/main/gaf-guard.