The Evolution of Natural Language Processing: How Prompt Optimization and Language Models are Shaping the Future

作者: Summra Saleem, Muhammad Nabeel Asim, Shaista Zulfiqar, Andreas Dengel

分类: cs.CL, cs.AI

发布日期: 2025-06-21

💡 一句话要点

综述提示优化策略:提升大型语言模型在自然语言处理任务中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 自然语言处理 提示工程 提示优化 模型微调

📋 核心要点

- 现有自然语言处理方法依赖人工特征工程,效率低且泛化性差,大型语言模型虽有潜力,但缺乏有效的提示优化策略。

- 本文核心在于对现有提示优化策略进行系统性分析和分类,并深入理解其工作原理,为后续研究提供理论基础。

- 论文详细分析了11种不同的提示优化策略,并探讨了它们在不同NLP任务中的应用,为未来研究提供参考。

📝 摘要(中文)

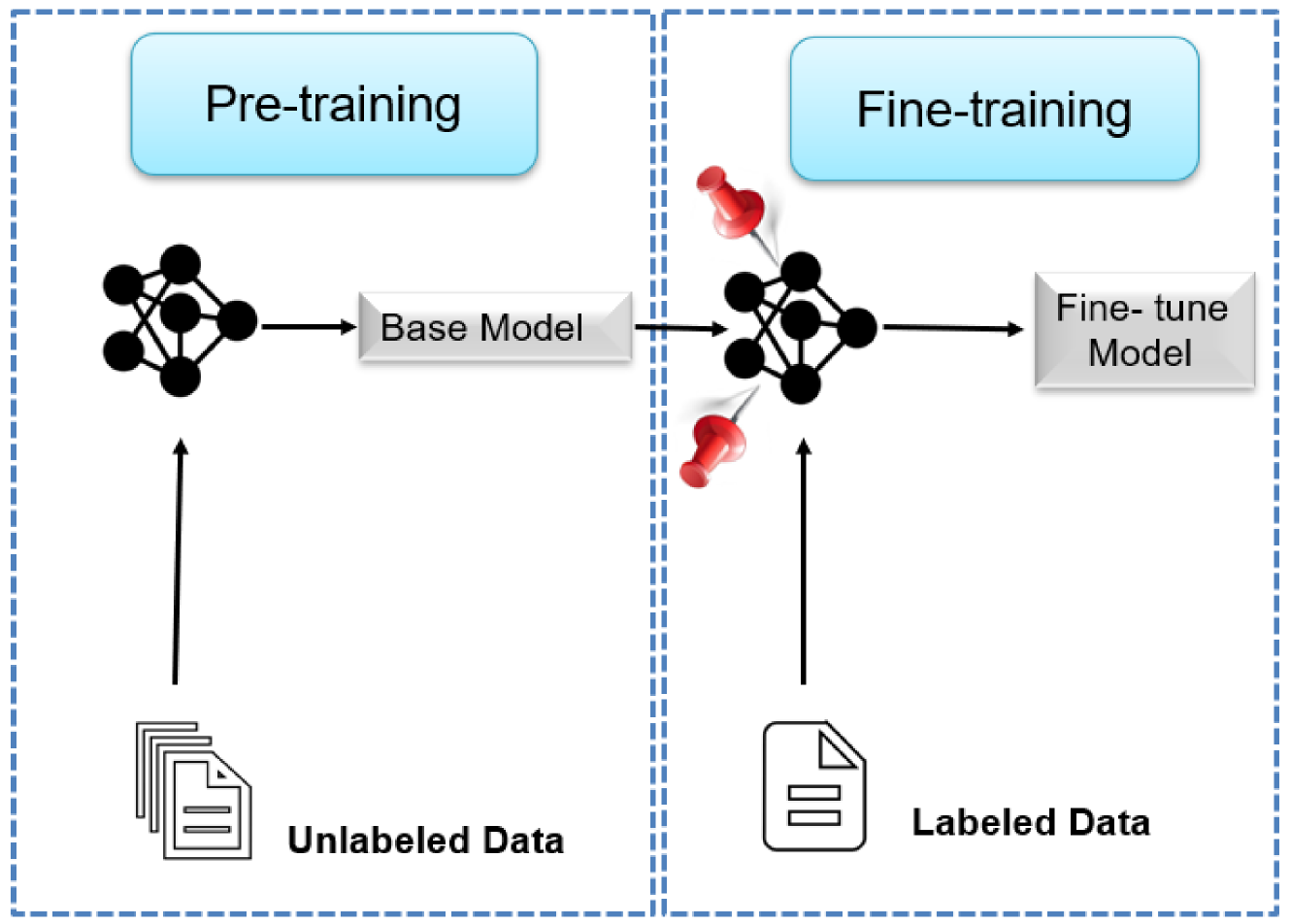

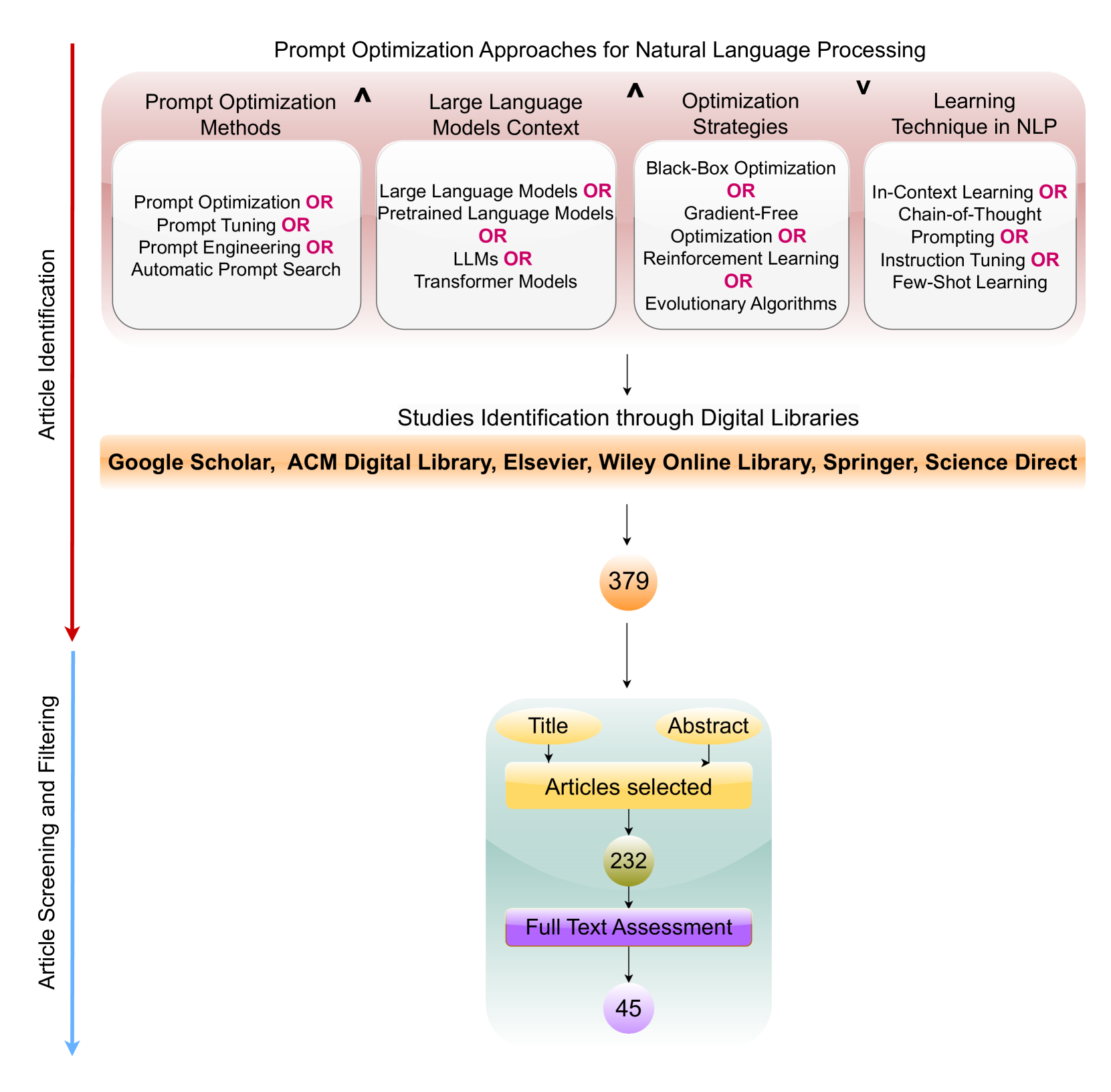

大型语言模型(LLMs)通过自动化传统的人工密集型任务,彻底改变了自然语言处理(NLP)领域,并加速了计算机辅助应用程序的开发。随着研究人员不断推进该领域,引入新的语言模型和更有效的训练/微调方法,提示工程以及随后的LLM优化策略已成为一种特别有影响力的趋势,可以在各种NLP任务中产生显著的性能提升。据我们所知,许多评论文章已经探讨了提示工程,但是,在对提示优化策略进行全面分析方面存在一个关键的空白。为了弥合这一差距,本文提供了关于各种提示优化策略的潜力的独特而全面的见解。它分析了它们的基本工作范式,并基于这些原则,将它们分为11个不同的类别。此外,本文还提供了有关已采用这些提示优化策略的各种NLP任务的详细信息,以及用于评估的不同LLM和基准数据集的详细信息。这种全面的汇编为未来的比较研究奠定了坚实的基础,并能够在一致的实验设置下严格评估基于提示优化和LLM的预测管道:这是当前形势下的关键需求。最终,这项研究将集中各种战略知识,以促进现有提示优化策略的调整,从而为未开发的任务开发创新的预测器。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在自然语言处理(NLP)任务中,由于缺乏系统性的提示优化策略而导致的性能瓶颈问题。现有方法依赖人工设计提示,效率低下且难以泛化到不同的任务和模型上。

核心思路:论文的核心思路是对现有的各种提示优化策略进行全面的梳理、分析和分类,从而揭示这些策略背后的共性原理和适用场景。通过理解这些原理,研究人员可以更好地选择、组合和改进提示优化策略,从而提升LLMs在各种NLP任务中的性能。

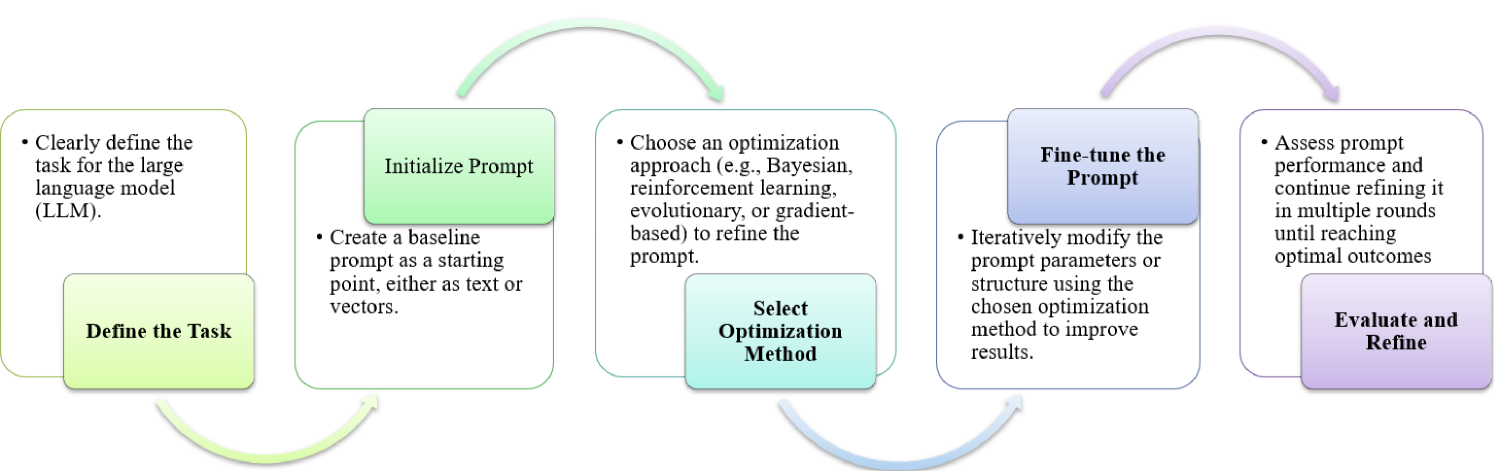

技术框架:论文构建了一个关于提示优化策略的分类框架,将现有策略归纳为11个不同的类别。该框架基于对这些策略底层工作原理的分析,并考虑了它们在不同NLP任务中的应用。论文还详细描述了每个类别的策略,并提供了相应的例子和参考文献。

关键创新:论文的关键创新在于对提示优化策略进行了系统性的分类和分析,弥补了现有研究中对这些策略缺乏全面理解的不足。通过揭示这些策略背后的共性原理,论文为未来的研究提供了理论基础和指导。

关键设计:论文的关键设计在于其分类框架,该框架基于对提示优化策略底层工作原理的分析。具体的分类标准和类别划分未知,但可以推断其考虑了策略的优化目标、优化方法和适用场景等因素。此外,论文还详细描述了每个类别的策略,并提供了相应的例子和参考文献,方便读者理解和应用。

🖼️ 关键图片

📊 实验亮点

论文对11种不同的提示优化策略进行了分类和分析,并探讨了它们在不同NLP任务中的应用。具体性能数据未知,但论文强调这些策略可以显著提升LLMs的性能。该研究为未来的比较研究奠定了基础,并为评估基于提示优化和LLM的预测管道提供了依据。

🎯 应用场景

该研究成果可广泛应用于各种自然语言处理任务,例如文本分类、情感分析、机器翻译、问答系统等。通过选择合适的提示优化策略,可以显著提升LLMs在这些任务中的性能,从而提高自动化系统的效率和准确性。该研究还有助于开发更智能、更人性化的计算机辅助应用程序。

📄 摘要(原文)

Large Language Models (LLMs) have revolutionized the field of Natural Language Processing (NLP) by automating traditional labor-intensive tasks and consequently accelerated the development of computer-aided applications. As researchers continue to advance this field with the introduction of novel language models and more efficient training/finetuning methodologies, the idea of prompt engineering and subsequent optimization strategies with LLMs has emerged as a particularly impactful trend to yield a substantial performance boost across diverse NLP tasks. To best of our knowledge numerous review articles have explored prompt engineering, however, a critical gap exists in comprehensive analyses of prompt optimization strategies. To bridge this gap this paper provides unique and comprehensive insights about the potential of diverse prompt optimization strategies. It analyzes their underlying working paradigms and based on these principles, categorizes them into 11 distinct classes. Moreover, the paper provides details about various NLP tasks where these prompt optimization strategies have been employed, along with details of different LLMs and benchmark datasets used for evaluation. This comprehensive compilation lays a robust foundation for future comparative studies and enables rigorous assessment of prompt optimization and LLM-based predictive pipelines under consistent experimental settings: a critical need in the current landscape. Ultimately, this research will centralize diverse strategic knowledge to facilitate the adaptation of existing prompt optimization strategies for development of innovative predictors across unexplored tasks.