Fast or Slow? Integrating Fast Intuition and Deliberate Thinking for Enhancing Visual Question Answering

作者: Songtao Jiang, Chenyi Zhou, Yan Zhang, Yeying Jin, Zuozhu Liu

分类: cs.CL

发布日期: 2025-06-01

💡 一句话要点

提出FOCUS,结合快速直觉与审慎思考增强视觉问答能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉问答 多模态学习 大型语言模型 双过程理论 视觉提示 认知推理 零样本学习

📋 核心要点

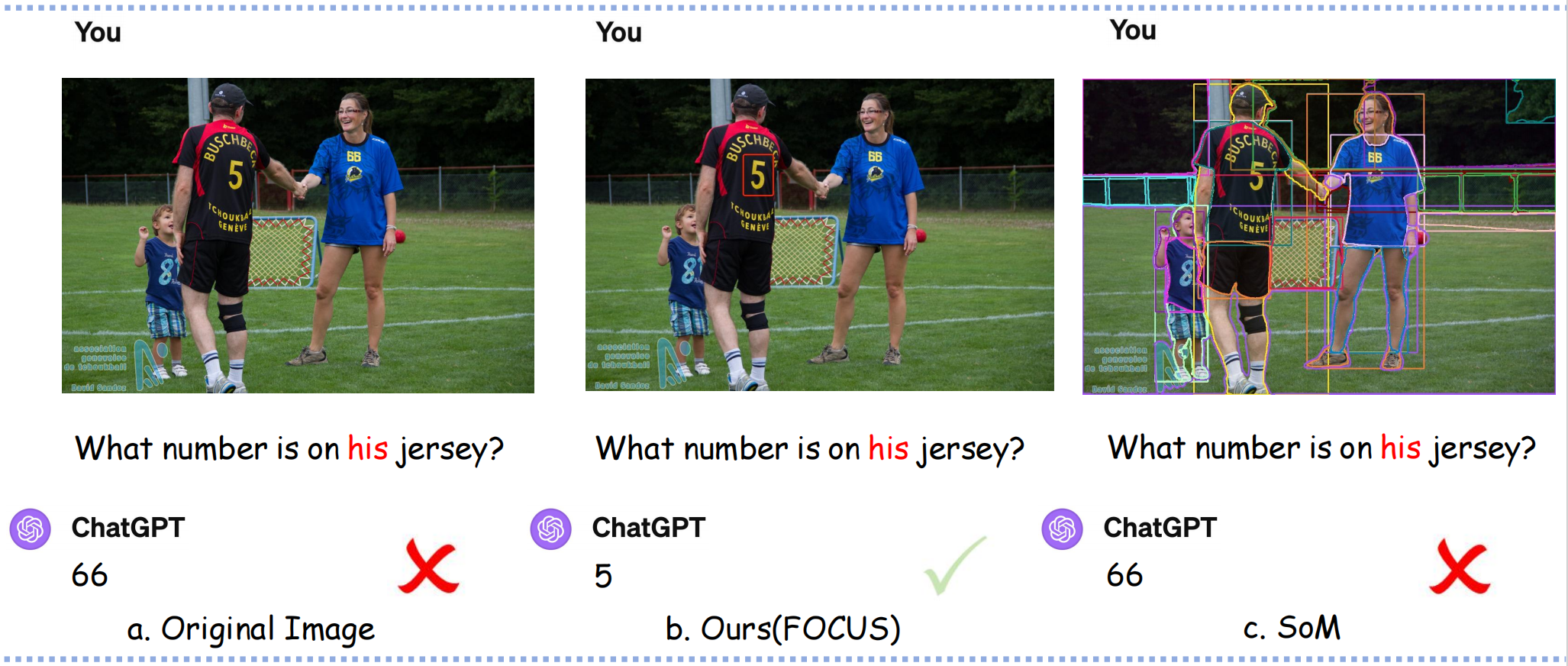

- 现有VQA方法对所有检测到的对象进行无差别标注,导致视觉信息冗余,降低了复杂推理任务的性能。

- FOCUS方法模仿人类双过程认知,结合快速直觉和审慎思考,动态适应问题复杂度,提升视觉-语言推理能力。

- 在多个VQA基准测试中,FOCUS显著提升了开源和黑盒MLLM的性能,验证了其有效性。

📝 摘要(中文)

多模态大型语言模型(MLLMs)在视觉问答(VQA)中仍然难以处理复杂的推理任务。现有方法通过结合视觉提示取得了进展,但我们的研究揭示了关键的局限性:这些方法不加区分地为每个视觉问题注释所有检测到的对象,产生过多的视觉标记,从而降低了任务性能。这个问题主要源于缺乏对关键视觉元素的关注,引发了两个重要问题:所有对象都同等重要吗?所有问题都需要视觉提示吗?受双过程理论的启发,该理论区分了人类推理中的本能和审慎认知模式,我们提出FOCUS,一种即插即用的方法,动态适应问题的复杂性,结合快速直觉判断与审慎分析推理,以增强MLLM的视觉-语言推理能力。对于简单的问题,FOCUS支持高效的零样本推理。对于更复杂的任务,它采用观察前概念化策略来突出关键元素。在ScienceQA、TextQA、VizWiz和MME四个基准上的大量实验表明,FOCUS始终如一地提高了开源和黑盒MLLM的性能,并在所有数据集上取得了显著的收益。消融研究进一步验证了结合多样化认知策略与精细化视觉信息对于卓越性能的重要性。

🔬 方法详解

问题定义:论文旨在解决视觉问答(VQA)任务中,多模态大型语言模型(MLLMs)在处理复杂推理问题时表现不佳的问题。现有方法通常通过引入视觉提示来增强模型性能,但它们存在一个主要痛点:对所有检测到的对象进行无差别标注,导致视觉信息冗余,干扰模型对关键信息的提取,降低了推理准确性。此外,现有方法忽略了不同问题的复杂性,对所有问题都采用视觉提示,效率较低。

核心思路:论文的核心思路是模仿人类的双过程认知理论,将快速直觉和审慎思考相结合。对于简单问题,模型可以直接利用快速直觉进行零样本推理,避免不必要的视觉信息干扰。对于复杂问题,模型则采用“观察前概念化”策略,即先对问题进行理解和分析,确定需要关注的关键视觉元素,然后再进行视觉提示,从而提高推理的准确性和效率。这样,模型可以根据问题的复杂程度动态调整推理策略,实现更高效和准确的视觉问答。

技术框架:FOCUS方法是一个即插即用的模块,可以集成到现有的MLLM中。其整体流程如下:1) 问题理解:分析输入问题,判断其复杂程度。2) 策略选择:根据问题复杂程度,选择快速直觉或审慎思考策略。3) 视觉提示(仅在审慎思考模式下):采用“观察前概念化”策略,确定需要关注的关键视觉元素,并生成相应的视觉提示。4) 推理:将问题和视觉提示(如果存在)输入MLLM进行推理,得到答案。

关键创新:该论文最重要的技术创新点在于提出了基于双过程认知理论的动态推理策略。与现有方法对所有问题都采用相同的视觉提示策略不同,FOCUS方法能够根据问题的复杂程度自适应地选择推理策略,从而提高了推理的效率和准确性。此外,“观察前概念化”策略能够有效地减少视觉信息的冗余,帮助模型更好地关注关键视觉元素。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。但是,可以推断,问题复杂程度的判断可能依赖于某种分类器或阈值,而“观察前概念化”策略可能涉及到某种注意力机制或目标检测算法,用于确定需要关注的关键视觉元素。这些具体实现细节需要在论文的后续版本或代码中进一步了解。

🖼️ 关键图片

📊 实验亮点

FOCUS在ScienceQA、TextQA、VizWiz和MME四个基准测试中均取得了显著的性能提升。例如,在ScienceQA数据集上,FOCUS将MLLM的准确率提高了多个百分点。消融实验表明,快速直觉和审慎思考两种策略的结合,以及“观察前概念化”策略的有效性,是取得优异性能的关键。

🎯 应用场景

该研究成果可应用于各种视觉问答场景,例如智能客服、教育辅助、医疗诊断等。通过提升MLLM的视觉-语言推理能力,可以使机器更好地理解图像内容,并回答用户提出的问题,从而提供更智能、更便捷的服务。未来,该方法还可以扩展到其他多模态任务中,例如图像描述、视频理解等。

📄 摘要(原文)

Multimodal large language models (MLLMs) still struggle with complex reasoning tasks in Visual Question Answering (VQA). While current methods have advanced by incorporating visual prompts, our study uncovers critical limitations: these approaches indiscriminately annotate all detected objects for every visual question, generating excessive visual markers that degrade task performance. This issue stems primarily from a lack of focus on key visual elements, raising two important questions: Are all objects equally important, and do all questions require visual prompts? Motivated by Dual Process Theory, which distinguishes between instinctive and deliberate cognitive modes in human reasoning, we propose FOCUS, a plug-and-play approach that dynamically adapts to the complexity of questions, combining fast intuitive judgments with deliberate analytical reasoning to enhance the vision-language reasoning capability of the MLLM. For straightforward questions, FOCUS supports efficient zero-shot reasoning. For more complex tasks, it employs the conceptualizing before observation strategy to highlight critical elements. Extensive experiments on four benchmarks, ScienceQA, TextQA, VizWiz, and MME, demonstrate that FOCUS consistently improves the performance of both open-source and black-box MLLMs, achieving significant gains across all datasets. Ablation studies further validate the importance of combining diverse cognitive strategies with refined visual information for superior performance. Code will be released.