KG-TRACES: Enhancing Large Language Models with Knowledge Graph-constrained Trajectory Reasoning and Attribution Supervision

作者: Rong Wu, Pinlong Cai, Jianbiao Mei, Licheng Wen, Tao Hu, Xuemeng Yang, Daocheng Fu, Botian Shi

分类: cs.CL, cs.AI

发布日期: 2025-06-01 (更新: 2025-10-20)

备注: 24 pages, 13 figures

🔗 代码/项目: GITHUB

💡 一句话要点

KG-TRACES:通过知识图谱约束的轨迹推理和归因监督增强大型语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 知识图谱 推理 可解释性 归因 轨迹推理 监督学习

📋 核心要点

- 现有LLM在复杂推理中缺乏可解释性,易产生幻觉,限制了其应用。

- KG-TRACES通过显式监督推理路径和过程,提升LLM的推理能力和可信度。

- 实验表明,KG-TRACES在WebQSP和CWQ等数据集上显著优于现有方法,并具有领域迁移能力。

📝 摘要(中文)

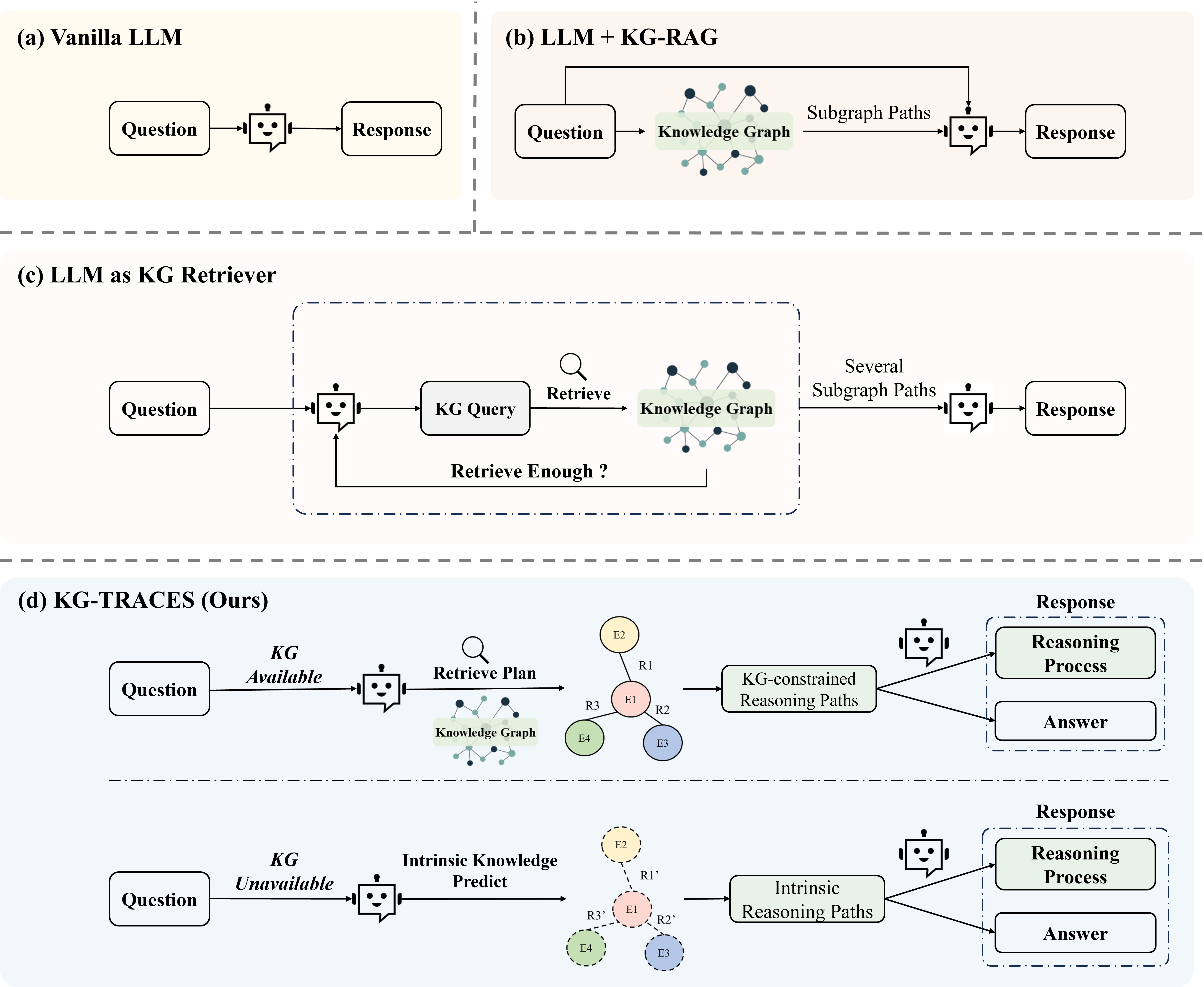

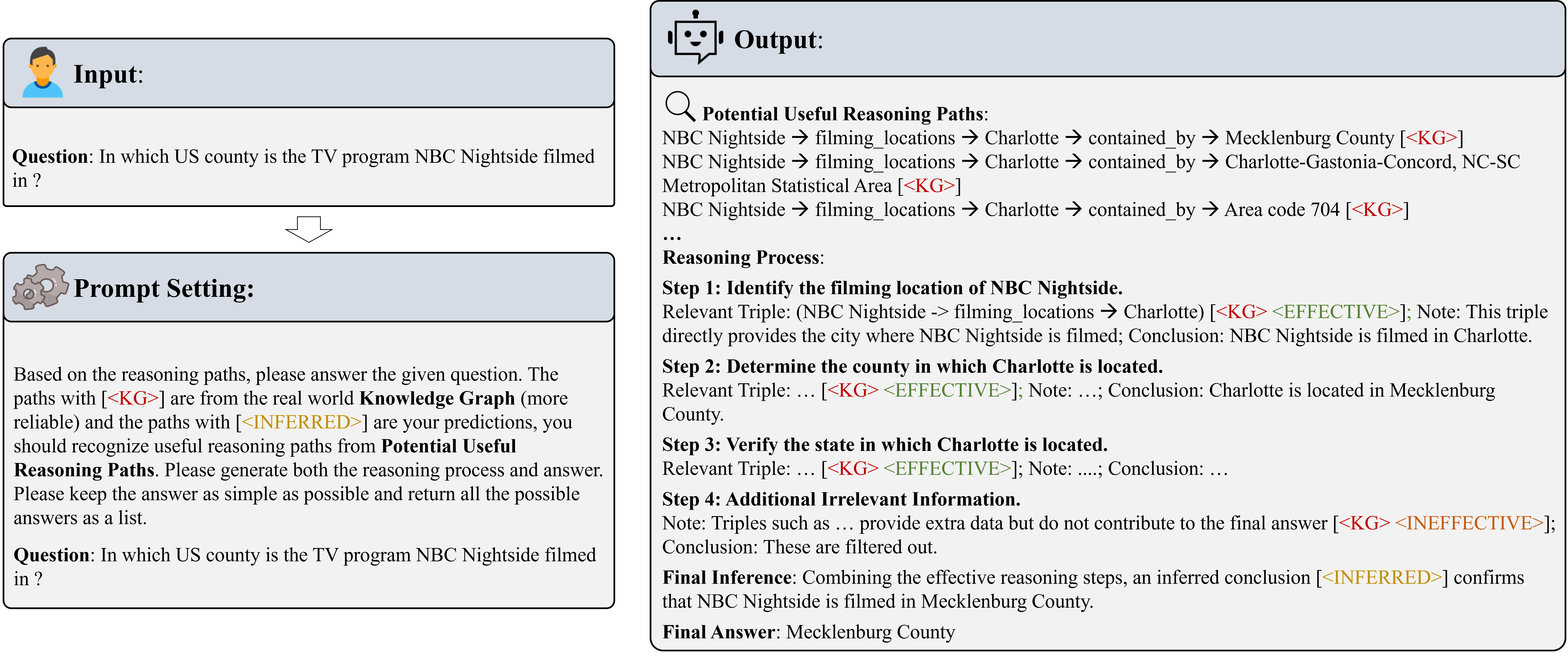

大型语言模型(LLM)在各种自然语言处理任务中取得了显著进展,但其在复杂推理问题上的表现仍然受到缺乏可解释性和可信度的限制。这个问题通常表现为幻觉或无法归因的推理过程,限制了它们在复杂推理场景中的适用性。为了解决这个问题,我们提出了知识图谱约束的轨迹推理归因和链式解释监督(KG-TRACES),这是一个新颖的框架,通过对推理路径和过程的显式监督来增强LLM的推理能力。KG-TRACES联合监督模型以:(1)预测符号关系路径,(2)预测完整的三元组级别推理路径,以及(3)生成基于推理路径的、具有归因意识的推理过程。在推理阶段,该模型适应KG可用和KG不可用的场景,在可能的情况下从KG检索推理路径,或者在没有KG的情况下仅使用内在知识预测合理的推理路径。这种设计使模型能够以可解释和源可归属的模式进行推理。通过在复杂推理任务上的大量实验,我们证明了KG-TRACES显著优于现有的SOTA:在WebQSP上,Hits@1提高了1.6%,F1提高了4.7%,在CWQ上,Hits@1提高了4.8%,F1提高了2.1%。此外,我们展示了其在医学等专业领域的迁移能力。通过可视化推理过程的中间步骤,我们进一步表明,KG-TRACES引入的显式监督导致了更稳定和目标导向的推理过程,与正确的答案紧密对齐。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在复杂推理任务中缺乏可解释性和可信度的问题。现有方法常常产生幻觉或无法追溯的推理过程,导致结果不可靠。这限制了LLM在需要高可靠性的场景中的应用,例如医疗诊断和金融分析。

核心思路:KG-TRACES的核心思路是通过知识图谱(KG)来约束LLM的推理过程,并对推理路径进行显式监督。通过让LLM学习预测符号关系路径、三元组级别的推理路径,并生成具有归因意识的推理过程,从而提高推理的可解释性和准确性。这种设计使得模型在推理时可以利用KG中的知识,并在KG不可用时也能基于内在知识进行合理的推理。

技术框架:KG-TRACES框架包含三个主要模块:1) 符号关系路径预测模块:预测推理过程中涉及的知识图谱中的关系路径。2) 三元组级别推理路径预测模块:预测完整的推理路径,包括实体和关系。3) 归因感知推理过程生成模块:生成基于推理路径的、具有归因意识的推理过程,解释推理的每一步。在推理阶段,模型首先判断KG是否可用。如果KG可用,则从KG中检索推理路径;否则,模型基于内在知识预测推理路径。最后,模型根据推理路径生成答案。

关键创新:KG-TRACES的关键创新在于其对推理路径和过程的显式监督。与以往的方法不同,KG-TRACES不仅关注最终的答案,还关注推理的中间步骤,并利用知识图谱来约束这些步骤。这种显式监督使得模型能够学习到更加可靠和可解释的推理模式。此外,KG-TRACES还能够适应KG可用和KG不可用的场景,提高了模型的泛化能力。

关键设计:KG-TRACES使用交叉熵损失函数来监督符号关系路径和三元组级别推理路径的预测。对于归因感知推理过程生成模块,使用序列到序列模型,并采用teacher forcing策略进行训练。在推理阶段,使用beam search算法来生成推理路径。具体参数设置(如学习率、batch size、beam size等)在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

KG-TRACES在WebQSP数据集上,Hits@1指标提升了1.6%,F1指标提升了4.7%。在CWQ数据集上,Hits@1指标提升了4.8%,F1指标提升了2.1%。此外,实验还表明KG-TRACES具有良好的领域迁移能力,在医学领域也取得了显著的性能提升。可视化结果表明,KG-TRACES能够生成更稳定和目标导向的推理过程。

🎯 应用场景

KG-TRACES具有广泛的应用前景,例如问答系统、知识图谱补全、医疗诊断、金融分析等。通过提高LLM推理的可解释性和可信度,KG-TRACES可以帮助人们更好地理解和信任LLM的输出,从而在更多领域应用LLM技术。未来,该方法可以进一步扩展到其他复杂推理任务中,例如常识推理和因果推理。

📄 摘要(原文)

Large language models (LLMs) have made remarkable strides in various natural language processing tasks, but their performance on complex reasoning problems remains hindered by a lack of explainability and trustworthiness. This issue, often manifesting as hallucinations or unattributable reasoning processes, limits their applicability in complex reasoning scenarios. To address this, we propose Knowledge Graph-constrained Trajectory Reasoning Attribution and Chain Explanation Supervision (KG-TRACES), a novel framework that enhances the reasoning ability of LLMs through explicit supervision over reasoning paths and processes. KG-TRACES jointly supervises the model to: (1) predict symbolic relation paths, (2) predict full triple-level reasoning paths, and (3) generate attribution-aware reasoning processes grounded in the reasoning paths. At inference phase, the model adapts to both KG-available and KG-unavailable scenarios, retrieving reasoning paths from a KG when possible or predicting plausible reasoning paths with only intrinsic knowledge when not. This design enables the model to reason in an explainable and source-attributable pattern. Through extensive experiments on complex reasoning tasks, we demonstrate that KG-TRACES significantly outperforms existing SOTA: it improves Hits@1 by 1.6% and F1 by 4.7% on WebQSP, and achieves improvements of 4.8% in Hits@1 and 2.1% in F1 on CWQ. Moreover, we show its transferability to specialized domains such as medicine. By visualizing the intermediate steps of reasoning processes, we further show that the explicit supervision introduced by KG-TRACES leads to more stable and goal-directed reasoning processes, aligning closely with correct answers. Code is available at https://github.com/Edaizi/KG-TRACES.