Improving Automatic Evaluation of Large Language Models (LLMs) in Biomedical Relation Extraction via LLMs-as-the-Judge

作者: Md Tahmid Rahman Laskar, Israt Jahan, Elham Dolatabadi, Chun Peng, Enamul Hoque, Jimmy Huang

分类: cs.CL

发布日期: 2025-06-01

备注: Accepted at ACL 2025 (Main Conference)

🔗 代码/项目: GITHUB

💡 一句话要点

提出结构化输出和领域自适应方法,提升LLM作为评判者在生物医学关系抽取中的自动评估性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生物医学关系抽取 大型语言模型 自动评估 LLM作为评判者 结构化输出 领域自适应 知识发现 自然语言处理

📋 核心要点

- 现有生物医学关系抽取任务中,传统自动评估指标难以准确评估LLM的生成结果,人工评估成本高昂。

- 论文提出利用LLM作为评判者进行自动评估,并通过结构化输出格式和领域自适应技术提升其性能。

- 实验表明,结构化输出格式平均提升LLM评判者性能约15%,领域自适应技术进一步增强了评估效果。

📝 摘要(中文)

大型语言模型(LLM)在生物医学关系抽取方面表现出令人印象深刻的性能,即使在零样本场景下也是如此。然而,由于LLM能够生成类似人类的文本,经常产生黄金标准答案的同义词或缩写,使得传统的自动评估指标变得不可靠,因此评估LLM在该任务中的表现仍然具有挑战性。另一方面,虽然人工评估更可靠,但成本高且耗时,使其在实际应用中不切实际。本文研究了使用LLM作为评判者作为生物医学关系抽取的替代评估方法。我们对8个LLM作为评判者进行了基准测试,以评估其他5个LLM在3个生物医学关系抽取数据集上生成的响应。与其他文本生成任务不同,我们观察到基于LLM的评判者在生物医学关系抽取任务中表现相当差(通常低于50%的准确率)。我们的研究结果表明,这主要是因为LLM提取的关系不符合任何标准格式。为了解决这个问题,我们为LLM生成的响应提出了结构化输出格式,这有助于LLM评判者将其性能提高约15%(平均)。我们还引入了一种领域自适应技术,通过有效地在数据集之间转移知识来进一步提高LLM评判者的性能。我们发布了我们的人工标注和LLM标注的判断数据(总共36k个样本),供公众使用。

🔬 方法详解

问题定义:生物医学关系抽取任务中,如何有效评估LLM的生成结果是一个关键问题。传统评估指标无法处理LLM生成的同义词或缩写,而人工评估成本过高。因此,需要一种自动且可靠的评估方法。

核心思路:利用LLM本身作为评判者,评估其他LLM在生物医学关系抽取任务中的表现。通过改进LLM评判者的评估能力,实现更准确的自动评估。

技术框架:整体流程包括:1) 使用LLM生成生物医学关系抽取结果;2) 使用另一个LLM作为评判者,评估生成结果的质量;3) 通过结构化输出格式和领域自适应技术,提升LLM评判者的评估性能。

关键创新:主要创新在于:1) 提出结构化输出格式,规范LLM生成的关系抽取结果,使其更易于LLM评判者理解和评估;2) 引入领域自适应技术,将不同生物医学数据集的知识迁移到LLM评判者,提升其泛化能力。

关键设计:结构化输出格式的具体设计未知,但其目标是使LLM生成的结果更易于解析和比较。领域自适应技术的具体实现细节未知,但可能涉及微调LLM评判者在目标数据集上的表现。

🖼️ 关键图片

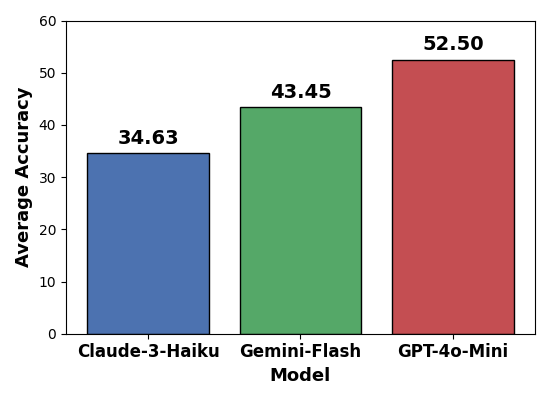

📊 实验亮点

实验结果表明,结构化输出格式能够平均提升LLM评判者约15%的性能。此外,领域自适应技术进一步增强了LLM评判者的评估能力。研究团队公开了包含36k样本的人工标注和LLM标注的判断数据,为后续研究提供了宝贵资源。

🎯 应用场景

该研究成果可应用于生物医学领域的知识发现、药物研发、疾病诊断等场景。通过自动评估LLM在关系抽取任务中的性能,可以加速相关研究的进展,并降低人工评估的成本。未来,该方法可以推广到其他自然语言处理任务的自动评估中。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated impressive performance in biomedical relation extraction, even in zero-shot scenarios. However, evaluating LLMs in this task remains challenging due to their ability to generate human-like text, often producing synonyms or abbreviations of gold-standard answers, making traditional automatic evaluation metrics unreliable. On the other hand, while human evaluation is more reliable, it is costly and time-consuming, making it impractical for real-world applications. This paper investigates the use of LLMs-as-the-Judge as an alternative evaluation method for biomedical relation extraction. We benchmark 8 LLMs as judges to evaluate the responses generated by 5 other LLMs across 3 biomedical relation extraction datasets. Unlike other text-generation tasks, we observe that LLM-based judges perform quite poorly (usually below 50% accuracy) in the biomedical relation extraction task. Our findings reveal that it happens mainly because relations extracted by LLMs do not adhere to any standard format. To address this, we propose structured output formatting for LLM-generated responses that helps LLM-Judges to improve their performance by about 15% (on average). We also introduce a domain adaptation technique to further enhance LLM-Judge performance by effectively transferring knowledge between datasets. We release both our human-annotated and LLM-annotated judgment data (36k samples in total) for public use here: https://github.com/tahmedge/llm_judge_biomedical_re.