Massively Multilingual Adaptation of Large Language Models Using Bilingual Translation Data

作者: Shaoxiong Ji, Zihao Li, Jaakko Paavola, Hengyu Luo, Jörg Tiedemann

分类: cs.CL

发布日期: 2025-05-31 (更新: 2025-12-04)

备注: EMMA-500 Gen 2; refer to Gen 1 in arXiv:2409.17892

💡 一句话要点

EMMA-500:利用双语翻译数据实现LLaMA3模型的大规模多语言适配

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言模型 持续预训练 双语翻译数据 低资源语言 语言迁移

📋 核心要点

- 现有大规模多语言模型在低资源语言上的性能仍有提升空间,缺乏有效利用平行语料的方法。

- 论文提出利用双语翻译数据进行持续预训练,增强模型跨语言迁移能力,尤其关注低资源语言的性能提升。

- 实验结果表明,使用双语数据进行持续预训练可以显著提升模型在多种任务上的性能,尤其是在低资源语言上。

📝 摘要(中文)

本文研究了大规模多语言持续预训练中的一个关键设计决策——是否包含平行语料。具体而言,我们研究了双语翻译数据对Llama3系列模型进行大规模多语言语言适配(500种语言)的影响。为此,我们构建了MaLA双语翻译语料库,其中包含来自2500多个语言对的数据。随后,我们开发了EMMA-500 Llama 3套件,包含四个大规模多语言模型,这些模型基于Llama 3系列基础模型,在各种数据组合上进行了广泛的持续预训练,总计达到6710亿个token。我们探讨了使用或不使用双语翻译数据进行持续预训练的效果。在7个任务和12个基准上的全面评估表明,双语数据倾向于增强语言迁移和性能,特别是对于低资源语言。我们开源了MaLA语料库、EMMA-500 Llama 3套件的工件、代码和模型生成结果。

🔬 方法详解

问题定义:现有的大规模多语言模型在处理低资源语言时,性能往往不如高资源语言。如何有效地利用现有的双语平行语料,提升模型在低资源语言上的表现,是一个重要的研究问题。现有的方法可能未能充分利用双语数据中的跨语言信息,导致模型在低资源语言上的泛化能力不足。

核心思路:论文的核心思路是利用双语翻译数据进行大规模多语言模型的持续预训练。通过让模型接触大量的平行语料,使其学习到不同语言之间的对应关系,从而增强其跨语言迁移能力。这种方法尤其适用于低资源语言,因为双语数据可以为这些语言提供额外的监督信息。

技术框架:整体框架包括以下几个主要步骤:1) 构建MaLA双语翻译语料库,包含大量语言对的数据。2) 基于Llama 3系列模型,使用MaLA语料库进行持续预训练,得到EMMA-500模型。3) 在多个任务和基准上评估EMMA-500模型的性能,并与不使用双语数据的模型进行比较。

关键创新:该论文的关键创新在于系统性地研究了双语翻译数据对大规模多语言模型持续预训练的影响。通过构建大规模的MaLA语料库和训练EMMA-500模型,证明了双语数据可以有效提升模型在低资源语言上的性能。此外,论文还开源了相关资源,为后续研究提供了便利。

关键设计:MaLA语料库包含了来自2500多个语言对的数据,涵盖了多种语言和领域。EMMA-500模型基于Llama 3系列模型,并使用了多种数据组合进行持续预训练,总计达到6710亿个token。在训练过程中,论文可能使用了特定的损失函数或优化策略,以更好地利用双语数据中的信息。具体的参数设置和网络结构细节需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

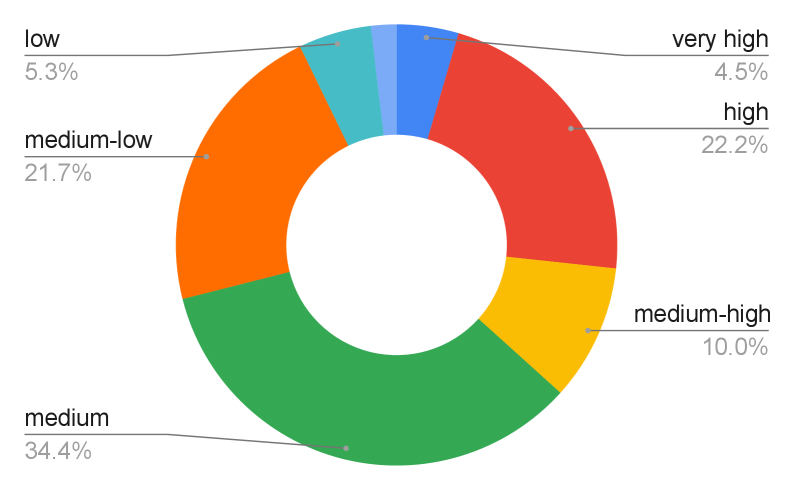

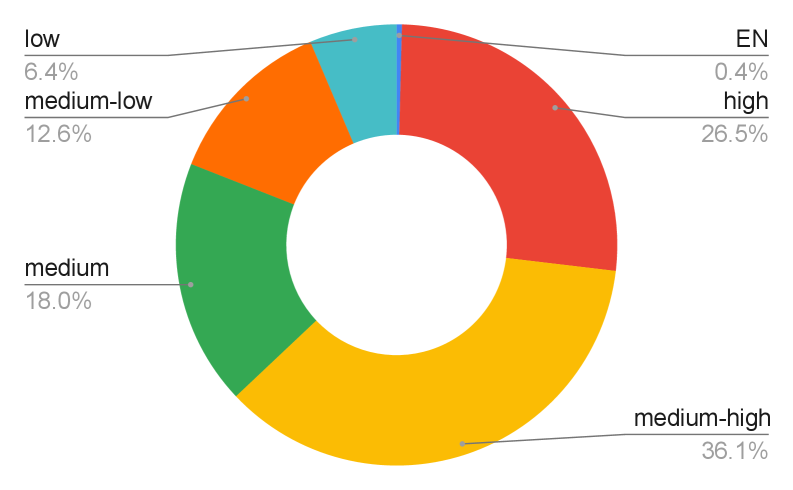

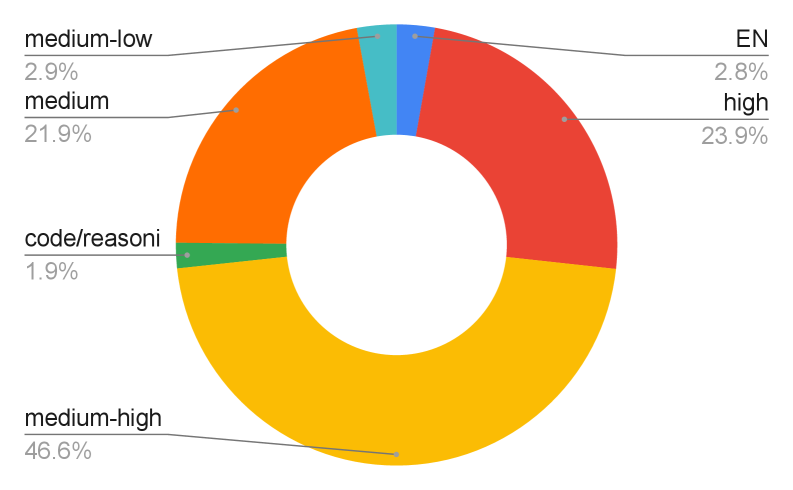

实验结果表明,使用双语数据进行持续预训练的EMMA-500模型在多个任务和基准上取得了显著的性能提升,尤其是在低资源语言上。具体的数据提升幅度需要在论文中查找。该研究证明了双语数据在提升大规模多语言模型性能方面的有效性。

🎯 应用场景

该研究成果可应用于机器翻译、跨语言信息检索、多语言对话系统等领域。通过提升低资源语言的处理能力,有助于打破语言障碍,促进全球范围内的信息交流和文化传播。未来,该方法有望应用于更多语言和领域,推动多语言自然语言处理技术的发展。

📄 摘要(原文)

This paper investigates a critical design decision in the practice of massively multilingual continual pre-training -- the inclusion of parallel data. Specifically, we study the impact of bilingual translation data for massively multilingual language adaptation of the Llama3 family of models to 500 languages. To this end, we construct the MaLA bilingual translation corpus, containing data from more than 2,500 language pairs. Subsequently, we develop the EMMA-500 Llama 3 suite of four massively multilingual models -- continually pre-trained from the Llama 3 family of base models extensively on diverse data mixes up to 671B tokens -- and explore the effect of continual pre-training with or without bilingual translation data. Comprehensive evaluation across 7 tasks and 12 benchmarks demonstrates that bilingual data tends to enhance language transfer and performance, particularly for low-resource languages. We open-source the MaLA corpus, EMMA-500 Llama 3 suite artefacts, code, and model generations.