Don't Reinvent the Wheel: Efficient Instruction-Following Text Embedding based on Guided Space Transformation

作者: Yingchaojie Feng, Yiqun Sun, Yandong Sun, Minfeng Zhu, Qiang Huang, Anthony K. H. Tung, Wei Chen

分类: cs.CL, cs.AI, cs.IR

发布日期: 2025-05-30

备注: Accepted to ACL 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出GSTransform,通过引导空间变换实现高效的指令跟随文本嵌入。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 指令跟随文本嵌入 空间变换 文本表示学习 高效计算 实时处理

📋 核心要点

- 现有指令跟随文本嵌入方法计算开销大,需为每个指令重新编码整个语料库。

- GSTransform通过引导空间变换,实时调整预计算的嵌入以适应用户指令。

- 实验表明,GSTransform在提高嵌入质量的同时,显著提升了大规模数据集上的处理速度。

📝 摘要(中文)

本文研究了指令跟随文本嵌入这一重要任务,该任务旨在生成能够适应用户指令并突出文本特定属性的动态文本嵌入。现有方法需要为每个新指令重新编码整个语料库,导致计算开销巨大。为了解决这一挑战,我们提出了一种基于引导空间变换的指令跟随文本嵌入框架GSTransform。我们的关键观察是,指令相关信息固有地编码在通用嵌入中,但未得到充分利用。GSTransform是一种轻量级转换机制,无需为每个指令重复编码语料库,而是实时调整预计算的嵌入以符合用户指令,并由少量带有指令聚焦标签注释的文本数据引导。我们在九个真实世界数据集上进行了广泛的指令感知下游任务实验,结果表明,GSTransform在提高指令跟随文本嵌入质量的同时,在大规模数据集上的实时处理速度提高了6~300倍。

🔬 方法详解

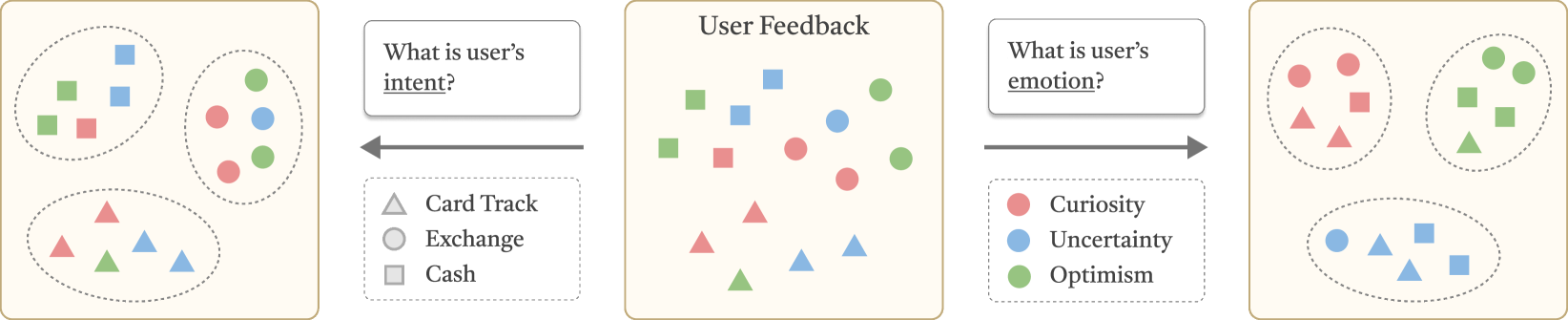

问题定义:指令跟随文本嵌入旨在根据用户给定的指令,动态地调整文本的嵌入表示,从而突出文本中与指令相关的特定属性。现有方法的主要痛点在于,对于每一个新的指令,都需要重新对整个文本语料库进行编码,这导致了巨大的计算开销,尤其是在处理大规模数据集时,效率低下。

核心思路:论文的核心思路是,指令相关的信息实际上已经蕴含在通用的文本嵌入中,只是没有被有效地利用。因此,与其每次都重新编码整个语料库,不如设计一种轻量级的转换机制,能够根据用户指令,对预先计算好的通用嵌入进行调整,从而得到指令相关的嵌入表示。这种方法避免了重复编码的开销,大大提高了效率。

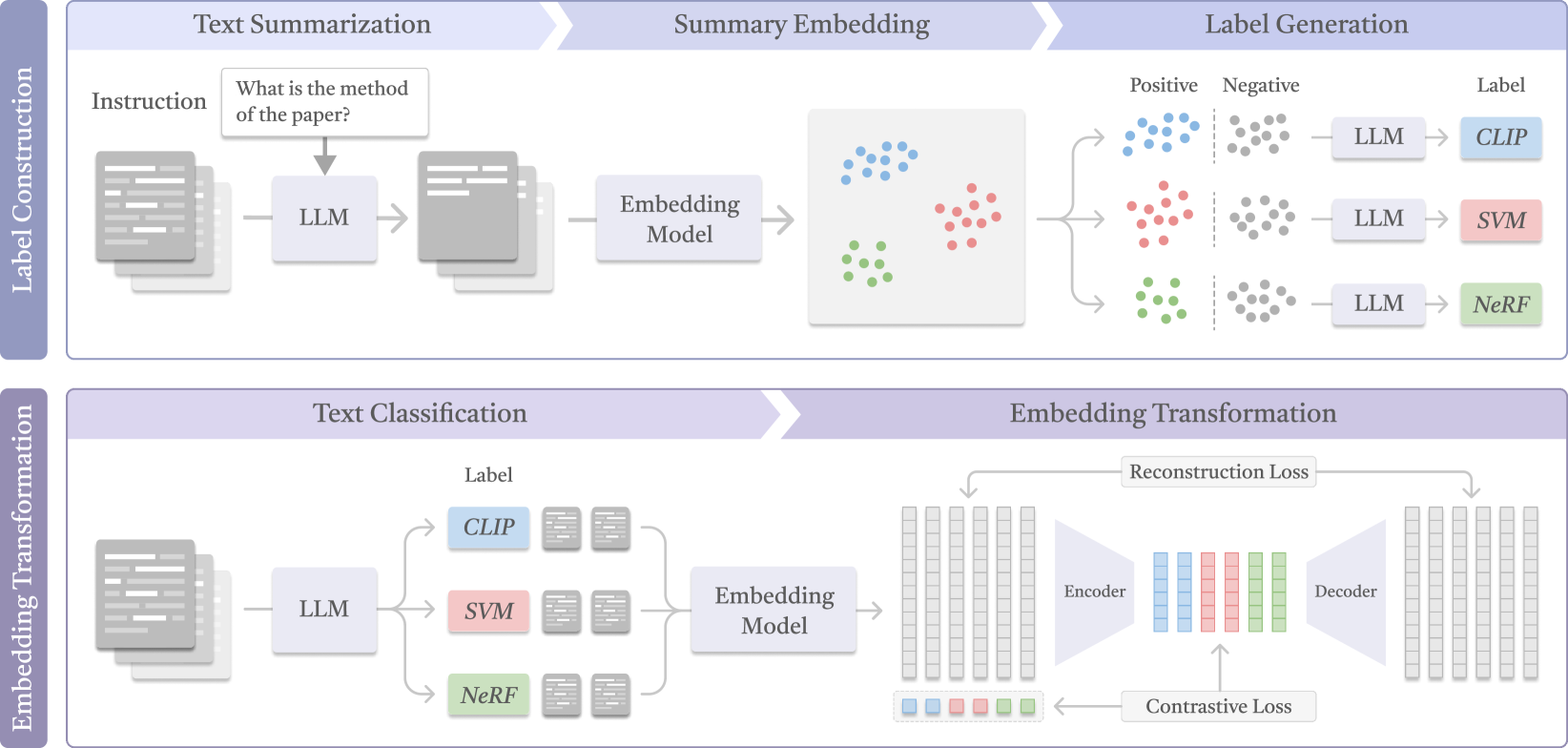

技术框架:GSTransform框架主要包含以下几个阶段:1) 首先,使用预训练的通用文本嵌入模型(如BERT、RoBERTa等)对文本语料库进行编码,得到通用的文本嵌入表示。2) 接着,利用少量带有指令聚焦标签注释的文本数据,训练一个引导空间变换模型。3) 当接收到新的用户指令时,该模型会根据指令,对预计算的通用嵌入进行变换,得到指令相关的嵌入表示。这个变换过程是实时的,无需重新编码整个语料库。

关键创新:GSTransform的关键创新在于,它避免了对整个语料库的重复编码,而是通过学习一个引导空间变换模型,来实现指令跟随的文本嵌入。与现有方法相比,GSTransform的本质区别在于,它将指令跟随文本嵌入问题,转化为了一个嵌入空间的变换问题,从而大大降低了计算复杂度。

关键设计:引导空间变换模型的具体结构未知,论文中可能使用了某种神经网络结构来实现这个变换。损失函数的设计也至关重要,需要确保变换后的嵌入能够准确地反映指令相关的信息。此外,如何选择和标注少量带有指令聚焦标签注释的文本数据,也是一个关键的设计问题。具体参数设置在论文中有详细描述,此处未知。

🖼️ 关键图片

📊 实验亮点

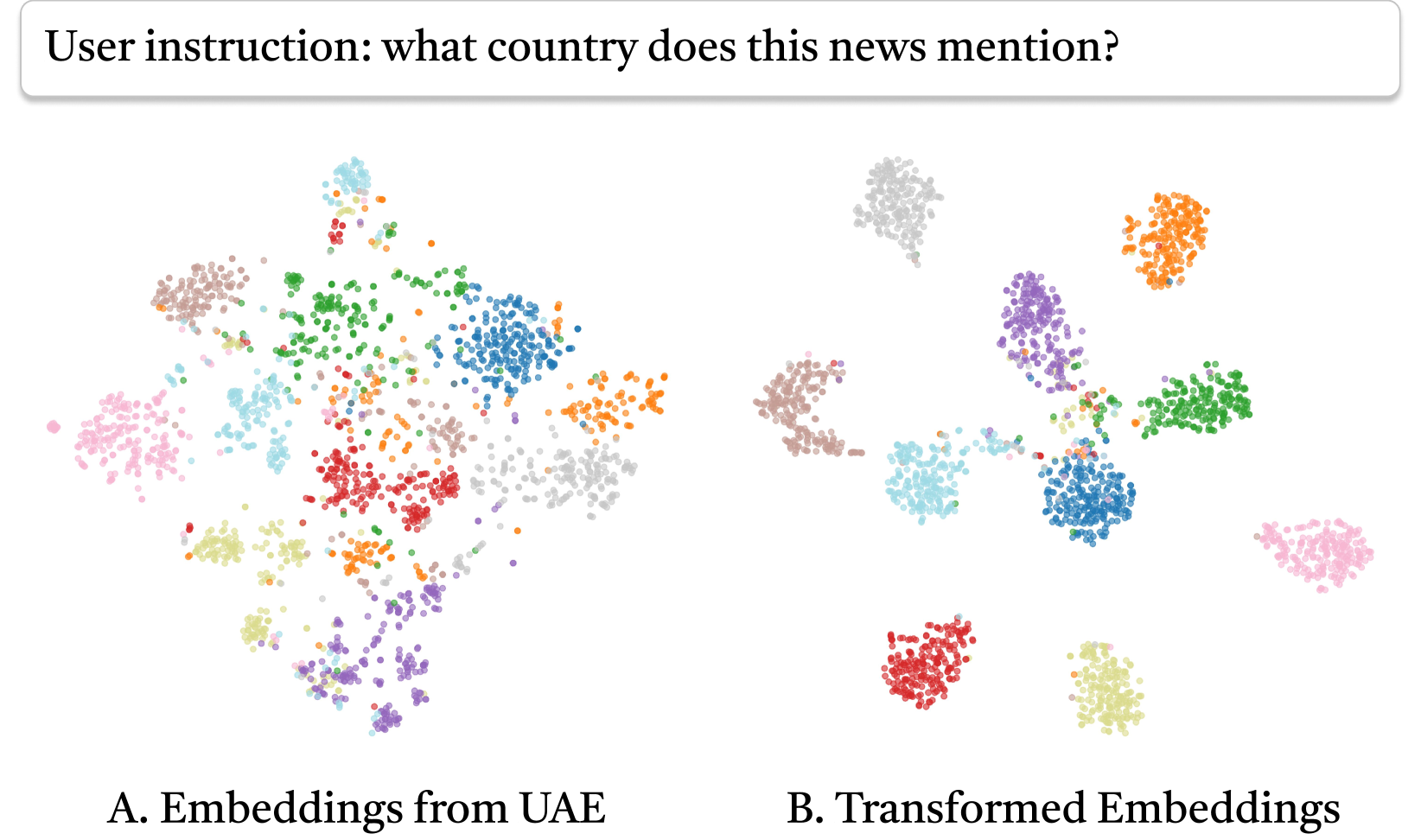

实验结果表明,GSTransform在三个指令感知下游任务和九个真实世界数据集上,显著提高了指令跟随文本嵌入的质量。与现有最先进的方法相比,GSTransform在保持或提高性能的同时,实现了6~300倍的实时处理速度提升,尤其是在大规模数据集上,优势更加明显。

🎯 应用场景

该研究成果可广泛应用于信息检索、问答系统、文本摘要、情感分析等领域。通过指令跟随文本嵌入,可以使这些应用更好地理解用户的意图,并提供更个性化、更精准的服务。例如,在信息检索中,可以根据用户的查询指令,动态地调整文本的嵌入表示,从而提高检索的准确率和召回率。

📄 摘要(原文)

In this work, we investigate an important task named instruction-following text embedding, which generates dynamic text embeddings that adapt to user instructions, highlighting specific attributes of text. Despite recent advancements, existing approaches suffer from significant computational overhead, as they require re-encoding the entire corpus for each new instruction. To address this challenge, we propose GSTransform, a novel instruction-following text embedding framework based on Guided Space Transformation. Our key observation is that instruction-relevant information is inherently encoded in generic embeddings but remains underutilized. Instead of repeatedly encoding the corpus for each instruction, GSTransform is a lightweight transformation mechanism that adapts pre-computed embeddings in real time to align with user instructions, guided by a small amount of text data with instruction-focused label annotation. We conduct extensive experiments on three instruction-awareness downstream tasks across nine real-world datasets, demonstrating that GSTransform improves instruction-following text embedding quality over state-of-the-art methods while achieving dramatic speedups of 6~300x in real-time processing on large-scale datasets. The source code is available at https://github.com/YingchaojieFeng/GSTransform.