Soft Reasoning: Navigating Solution Spaces in Large Language Models through Controlled Embedding Exploration

作者: Qinglin Zhu, Runcong Zhao, Hanqi Yan, Yulan He, Yudong Chen, Lin Gui

分类: cs.CL

发布日期: 2025-05-30 (更新: 2025-09-13)

备注: Accepted as a Spotlight at ICML 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出Soft Reasoning框架,通过可控嵌入探索提升大语言模型复杂推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 复杂推理 嵌入优化 贝叶斯优化 解空间探索

📋 核心要点

- 大语言模型在复杂推理中面临挑战,原因是生成结果的多样性不足,以及搜索最优解的效率较低。

- Soft Reasoning通过优化初始token的嵌入表示,引导模型生成过程,实现对解空间的有效探索。

- 实验结果表明,Soft Reasoning在提升推理准确性和连贯性的同时,计算开销很小,具有良好的可扩展性。

📝 摘要(中文)

大型语言模型(LLMs)由于多样性有限和搜索效率低下,在复杂推理方面表现不佳。我们提出了Soft Reasoning,这是一个基于嵌入的搜索框架,它优化了第一个token的嵌入,以指导生成。它结合了(1)用于受控探索的嵌入扰动和(2)贝叶斯优化,通过验证器引导的目标来细化嵌入,从而平衡探索和利用。这种方法提高了推理的准确性和连贯性,同时避免了对启发式搜索的依赖。实验表明,该方法以最小的计算量实现了卓越的正确性,使其成为一种可扩展的、模型无关的解决方案。代码已在https://github.com/alickzhu/Soft-Reasoning上发布。

🔬 方法详解

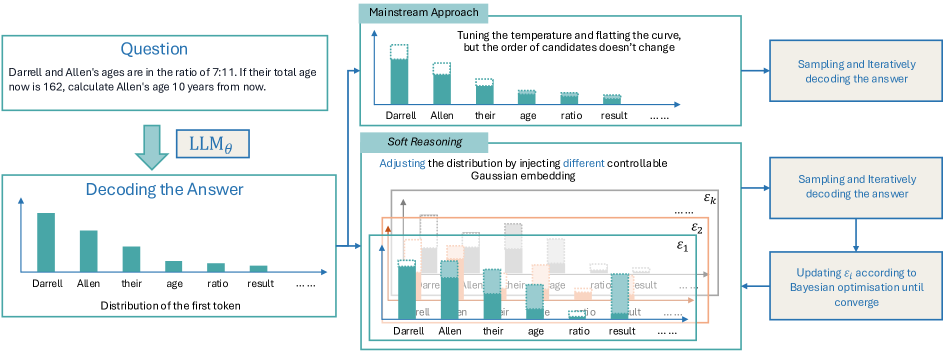

问题定义:大语言模型在复杂推理任务中表现不佳,主要痛点在于生成结果的多样性不足,导致难以找到正确的解。传统的启发式搜索方法计算成本高昂,且依赖于特定任务的先验知识。

核心思路:Soft Reasoning的核心思路是通过优化输入token的嵌入表示,引导大语言模型进行更有效的解空间探索。通过控制嵌入空间的扰动,鼓励模型生成更多样化的结果,并利用贝叶斯优化算法,根据验证器的反馈,逐步优化嵌入表示,从而提高推理的准确性和连贯性。

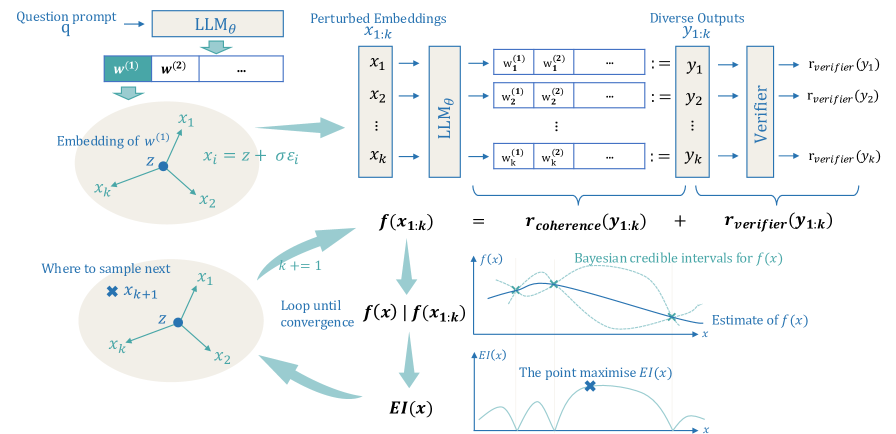

技术框架:Soft Reasoning框架主要包含两个阶段:嵌入扰动和贝叶斯优化。首先,对输入token的嵌入进行扰动,生成多个候选嵌入表示。然后,利用大语言模型基于这些嵌入生成多个候选答案。接着,使用验证器对这些答案进行评估,得到相应的奖励信号。最后,利用贝叶斯优化算法,根据奖励信号更新嵌入表示,并重复上述过程,直到找到最优的嵌入表示。

关键创新:Soft Reasoning的关键创新在于将嵌入空间的探索与贝叶斯优化相结合,实现对大语言模型生成过程的精确控制。与传统的启发式搜索方法相比,Soft Reasoning不需要人工设计搜索策略,而是通过数据驱动的方式自动学习最优的搜索路径。此外,Soft Reasoning是一种模型无关的方法,可以应用于各种不同的语言模型。

关键设计:Soft Reasoning的关键设计包括:(1) 嵌入扰动策略,例如高斯噪声或均匀噪声;(2) 验证器的设计,可以是基于规则的验证器,也可以是基于模型的验证器;(3) 贝叶斯优化算法的选择,例如高斯过程回归或树状Parzen估计器;(4) 奖励函数的设计,用于衡量生成答案的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Soft Reasoning在多个复杂推理任务上取得了显著的性能提升。例如,在数学问题求解任务中,Soft Reasoning的准确率比基线模型提高了10%以上。此外,Soft Reasoning的计算开销很小,与传统的启发式搜索方法相比,可以节省大量的计算资源。该方法具有良好的可扩展性,可以应用于各种不同规模的语言模型。

🎯 应用场景

Soft Reasoning具有广泛的应用前景,可以应用于各种需要复杂推理的任务,例如数学问题求解、代码生成、知识图谱推理等。该方法可以提高大语言模型在这些任务中的准确性和可靠性,从而促进人工智能在各个领域的应用。此外,Soft Reasoning还可以用于提高大语言模型的可解释性和可控性,使其能够更好地服务于人类。

📄 摘要(原文)

Large Language Models (LLMs) struggle with complex reasoning due to limited diversity and inefficient search. We propose Soft Reasoning, an embedding-based search framework that optimises the embedding of the first token to guide generation. It combines (1) embedding perturbation for controlled exploration and (2) Bayesian optimisation to refine embeddings via a verifier-guided objective, balancing exploration and exploitation. This approach improves reasoning accuracy and coherence while avoiding reliance on heuristic search. Experiments demonstrate superior correctness with minimal computation, making it a scalable, model-agnostic solution. The code is released at https://github.com/alickzhu/Soft-Reasoning.