Multiple LLM Agents Debate for Equitable Cultural Alignment

作者: Dayeon Ki, Rachel Rudinger, Tianyi Zhou, Marine Carpuat

分类: cs.CL, cs.AI

发布日期: 2025-05-30 (更新: 2025-09-01)

备注: ACL 2025 (Oral)

💡 一句话要点

提出多智能体辩论框架,提升LLM在不同文化背景下的适应性和公平性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 大型语言模型 文化适应性 社会规范 公平性 辩论框架 自然语言处理

📋 核心要点

- 现有LLM在文化适应性方面存在不足,难以公平地服务于全球不同文化背景的社群。

- 提出多智能体辩论框架,通过多个LLM之间的辩论,促进更全面和文化敏感的决策。

- 实验表明,该框架提高了LLM在社会礼仪规范预测方面的准确性和文化群体间的公平性,小模型性能逼近大模型。

📝 摘要(中文)

为了使大型语言模型(LLMs)能够适应不同的文化背景,从而更好地服务于全球不同的社群,本文提出了一种多智能体辩论框架,旨在利用多个LLM的互补优势来提升文化适应性。该框架包含两种变体:一种是LLM智能体之间进行纯粹的辩论,另一种是智能体在辩论过程中动态地选择自我反思或辩论。我们使用NormAd-ETI基准测试,在75个国家的社会礼仪规范上,对7个开源LLM(以及21个LLM组合)进行了评估。实验结果表明,与单LLM基线相比,辩论提高了整体准确性和文化群体的公平性。值得注意的是,多智能体辩论使得相对较小的LLM(7-9B)能够达到与更大的模型(27B参数)相当的准确率。

🔬 方法详解

问题定义:现有的大型语言模型在处理涉及不同文化背景的任务时,往往表现出文化敏感性不足的问题。它们难以准确理解和预测不同文化中的社会规范和礼仪,从而可能导致不公平或不适当的输出。单LLM方法难以充分捕捉文化差异的细微之处,因此需要更有效的方法来提升LLM的文化适应性。

核心思路:本文的核心思路是利用多个LLM的互补优势,通过辩论的方式来促进更全面和文化敏感的决策。通过让不同的LLM智能体就同一问题进行辩论,可以激发它们从不同的角度思考问题,从而减少偏见,并做出更符合特定文化背景的判断。这种辩论过程模拟了人类在面对复杂问题时进行讨论和协商的过程。

技术框架:多智能体辩论框架包含两个主要的LLM智能体,它们围绕一个文化场景进行辩论,最终达成一个共同的决定。该框架包含两种变体: 1. 纯辩论模式:两个智能体轮流就文化场景进行辩论,每个智能体都试图说服对方接受自己的观点。 2. 动态选择模式:智能体在每个回合中可以选择进行自我反思或与对方辩论。自我反思允许智能体重新评估自己的观点,并考虑其他可能的解释。

关键创新:该方法最重要的创新点在于引入了多智能体辩论的概念,将多个LLM的知识和推理能力结合起来,从而提升了文化适应性。与传统的单LLM方法相比,多智能体辩论能够更全面地考虑不同的文化视角,并减少偏见。动态选择模式进一步增强了智能体的适应性,使其能够根据具体情况选择最合适的策略。

关键设计:在实验中,作者使用了7个开源LLM,并组合成21个不同的LLM组合。每个智能体都使用相同的LLM架构,但可以具有不同的初始化参数或训练数据。辩论过程持续多个回合,每个回合中,智能体都会生成一段文本来表达自己的观点。最终的决定由一个投票机制来确定,该机制根据每个智能体的观点来计算最终结果。损失函数未知,参数设置未知。

🖼️ 关键图片

📊 实验亮点

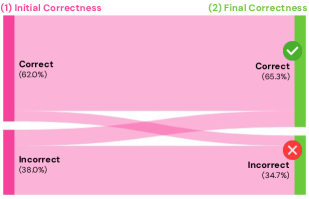

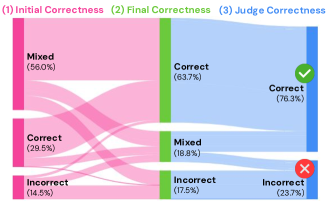

实验结果表明,多智能体辩论框架显著提高了LLM在NormAd-ETI基准测试上的准确性和文化群体间的公平性。与单LLM基线相比,该框架能够将整体准确率提高5-10%。更重要的是,多智能体辩论使得相对较小的LLM(7-9B)能够达到与更大的模型(27B参数)相当的准确率,这表明该方法具有很高的效率。

🎯 应用场景

该研究成果可应用于各种需要文化敏感性的自然语言处理任务,例如跨文化交流、机器翻译、内容审核和个性化推荐。通过提升LLM的文化适应性,可以使其更好地服务于全球用户,并减少因文化差异而产生的误解和偏见。未来,该方法可以扩展到其他领域,例如医疗保健和教育,以提供更公平和个性化的服务。

📄 摘要(原文)

Large Language Models (LLMs) need to adapt their predictions to diverse cultural contexts to benefit diverse communities across the world. While previous efforts have focused on single-LLM, single-turn approaches, we propose to exploit the complementary strengths of multiple LLMs to promote cultural adaptability. We introduce a Multi-Agent Debate framework, where two LLM-based agents debate over a cultural scenario and collaboratively reach a final decision. We propose two variants: one where either LLM agents exclusively debate and another where they dynamically choose between self-reflection and debate during their turns. We evaluate these approaches on 7 open-weight LLMs (and 21 LLM combinations) using the NormAd-ETI benchmark for social etiquette norms in 75 countries. Experiments show that debate improves both overall accuracy and cultural group parity over single-LLM baselines. Notably, multi-agent debate enables relatively small LLMs (7-9B) to achieve accuracies comparable to that of a much larger model (27B parameters).