Eye of Judgement: Dissecting the Evaluation of Russian-speaking LLMs with POLLUX

作者: Nikita Martynov, Anastasia Mordasheva, Dmitriy Gorbetskiy, Danil Astafurov, Ulyana Isaeva, Elina Basyrova, Sergey Skachkov, Victoria Berestova, Nikolay Ivanov, Valeriia Zanina, Alena Fenogenova

分类: cs.CL, cs.AI

发布日期: 2025-05-30 (更新: 2025-12-01)

备注: short version

💡 一句话要点

提出POLLUX:一个用于评估俄语LLM生成能力的综合性开源基准。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 俄语LLM 语言模型评估 生成能力 开源基准 自动化评估

📋 核心要点

- 现有俄语LLM评估缺乏细粒度和可解释性,依赖耗时的人工评估,难以满足快速发展的模型评估需求。

- POLLUX通过定义详细评估标准和训练LLM作为评估器,实现了透明、可扩展的俄语LLM生成能力评估。

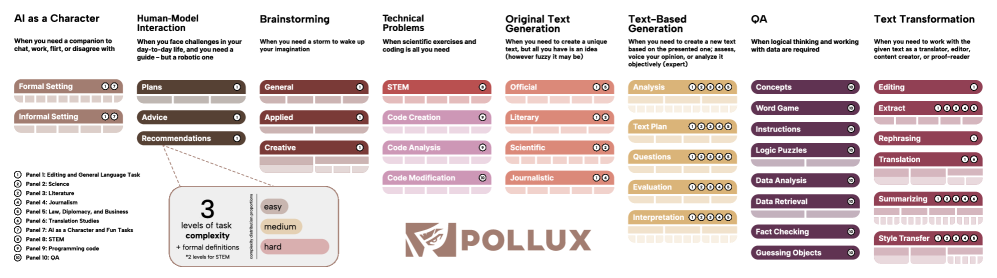

- POLLUX包含35种任务类型和2100个提示,并提供7B和32B的LLM评估器,为俄语LLM开发提供有效工具。

📝 摘要(中文)

我们推出了POLLUX,这是一个全面的开源基准,旨在评估大型语言模型(LLM)在俄语中的生成能力。我们的主要贡献是一种新颖的评估方法,增强了LLM评估的可解释性。对于每种任务类型,我们定义了一组详细的标准,并开发了一种评分协议,模型可以评估响应并为它们的评分提供理由。这实现了透明的、标准驱动的评估,超越了传统的、资源消耗型的、并排的人工比较。POLLUX包括一个详细的、细粒度的分类,包含35种任务类型,涵盖了各种生成领域,如代码生成、创意写作和实用助手用例,总共有2100个手工制作和专业编写的提示。每个任务都按难度(简单/中等/困难)进行分类,专家完全从头开始构建数据集。我们还发布了一系列LLM-as-a-Judge(7B和32B)评估器,这些评估器经过训练,可以对生成输出进行细致的评估。这种方法为模型开发提供了可扩展的、可解释的评估和注释工具,有效地取代了成本高昂且不太精确的人工判断。

🔬 方法详解

问题定义:论文旨在解决俄语大型语言模型(LLM)生成能力评估的问题。现有的评估方法,特别是依赖人工评估,存在成本高、耗时、主观性强等问题,难以快速、准确地评估LLM在各种俄语生成任务中的表现。缺乏细粒度的评估标准和可解释的评估结果,也阻碍了模型的改进和优化。

核心思路:论文的核心思路是利用LLM自身的能力来评估其他LLM的生成质量,从而替代或减少人工评估的需求。通过定义详细的评估标准,并训练LLM作为评估器(LLM-as-a-Judge),可以实现自动化、可扩展、可解释的评估。这种方法不仅降低了评估成本,还提高了评估的一致性和客观性。

技术框架:POLLUX的整体框架包括以下几个主要组成部分:1) 任务数据集:包含35种不同类型的俄语生成任务,涵盖代码生成、创意写作、实用助手等领域,共计2100个手工制作的提示。2) 评估标准:为每种任务类型定义了一组详细的评估标准,用于指导评估过程。3) LLM评估器:训练了一系列LLM(7B和32B)作为评估器,用于自动评估LLM的生成结果。4) 评分协议:定义了LLM评估器如何根据评估标准对生成结果进行评分,并提供评分理由。

关键创新:POLLUX最重要的技术创新点在于其基于LLM的自动化评估方法。与传统的依赖人工评估的方法相比,POLLUX的评估方法具有更高的效率、更低的成本和更好的可扩展性。此外,POLLUX还提供了细粒度的评估标准和可解释的评估结果,有助于深入了解LLM的优势和不足。

关键设计:POLLUX的关键设计包括:1) 任务数据集的设计:任务类型涵盖广泛,并根据难度进行分类,确保评估的全面性和有效性。2) 评估标准的设计:评估标准详细且具体,能够准确反映生成结果的质量。3) LLM评估器的训练:使用高质量的训练数据和合适的训练方法,确保LLM评估器具有良好的评估能力。4) 评分协议的设计:评分协议清晰明确,能够指导LLM评估器进行一致的评分。

🖼️ 关键图片

📊 实验亮点

POLLUX发布了包含35种任务类型和2100个提示的俄语LLM评估数据集,并训练了7B和32B的LLM评估器。实验结果(具体数值未知)表明,该评估器能够有效地评估俄语LLM的生成能力,并提供可解释的评估结果,为俄语LLM的开发和评估提供了有力的工具。

🎯 应用场景

POLLUX可应用于俄语LLM的开发、评估和比较。研究人员和开发者可以使用POLLUX来评估其模型的生成能力,发现模型的优势和不足,并进行针对性的改进。此外,POLLUX还可以用于比较不同LLM的性能,为用户选择合适的模型提供参考。未来,POLLUX可以扩展到其他语言和任务,成为通用的LLM评估工具。

📄 摘要(原文)

We introduce POLLUX, a comprehensive open-source benchmark designed to evaluate the generative capabilities of large language models (LLMs) in Russian. Our main contribution is a novel evaluation methodology that enhances the interpretability of LLM assessment. For each task type, we define a set of detailed criteria and develop a scoring protocol where models evaluate responses and provide justifications for their ratings. This enables transparent, criteria-driven evaluation beyond traditional resource-consuming, side-by-side human comparisons. POLLUX includes a detailed, fine-grained taxonomy of 35 task types covering diverse generative domains such as code generation, creative writing, and practical assistant use cases, totaling 2,100 manually crafted and professionally authored prompts. Each task is categorized by difficulty (easy/medium/hard), with experts constructing the dataset entirely from scratch. We also release a family of LLM-as-a-Judge (7B and 32B) evaluators trained for nuanced assessment of generative outputs. This approach provides scalable, interpretable evaluation and annotation tools for model development, effectively replacing costly and less precise human judgments.