A Closer Look at Bias and Chain-of-Thought Faithfulness of Large (Vision) Language Models

作者: Sriram Balasubramanian, Samyadeep Basu, Soheil Feizi

分类: cs.CL, cs.AI

发布日期: 2025-05-29 (更新: 2025-11-01)

备注: Accepted in EMNLP 2025, 34 pages, 25 figures

💡 一句话要点

首个针对大型视觉语言模型中偏见与思维链忠实性的综合研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 思维链 偏见 忠实性 推理 评估方法 不一致推理

📋 核心要点

- 大型视觉语言模型(LVLM)的思维链(CoT)推理能力受到关注,但其推理过程的忠实性仍待考察,尤其是在偏见影响下。

- 论文提出一种细粒度的评估流程,用于分析LVLM在处理文本和图像偏见时的CoT推理,从而更精确地评估其忠实性。

- 研究发现图像偏见难以被LVLM表达,并揭示了一种“不一致”推理现象,可作为检测偏见推理的预警信号。

📝 摘要(中文)

思维链(CoT)推理可以提升大型语言模型的性能,但这些推理轨迹是否忠实地反映了模型的内部过程仍然存在疑问。本文首次对大型视觉语言模型(LVLM)中的CoT忠实性进行了全面的研究,调查了基于文本的和先前未探索的基于图像的偏见如何影响推理和偏见表达。本文提出了一种新颖的、细粒度的评估流程,用于对偏见表达模式进行分类,从而能够比以前的方法更精确地分析CoT推理。该框架揭示了模型如何处理和响应不同类型偏见的关键区别,为LVLM CoT的忠实性提供了新的见解。研究结果表明,与显式的基于文本的偏见相比,即使在专门用于推理的模型中,微妙的基于图像的偏见也极少被表达。此外,许多模型表现出一种先前未识别的现象,我们称之为“不一致”推理——在突然改变答案之前进行正确的推理,这可以作为检测来自不忠实CoT的偏见推理的潜在预警信号。然后,我们将相同的评估流程应用于重新审视LLM中各种隐式线索水平下的CoT忠实性。我们的研究结果表明,当前的纯语言推理模型仍然难以表达未明确说明的线索。

🔬 方法详解

问题定义:现有的大型视觉语言模型(LVLM)虽然在思维链(CoT)推理方面表现出色,但其推理过程是否忠实地反映了模型内部的真实思考过程,尤其是在存在各种偏见的情况下,是一个亟待解决的问题。现有的评估方法通常不够精细,难以准确捕捉模型在处理不同类型偏见时的行为模式。

核心思路:本文的核心思路是设计一种细粒度的评估流程,能够深入分析LVLM在面对文本和图像偏见时,其CoT推理的忠实性。通过对偏见表达模式进行分类,从而更准确地了解模型如何处理和响应不同类型的偏见。此外,论文还关注模型在推理过程中可能出现的“不一致”现象,将其作为检测偏见推理的潜在指标。

技术框架:该研究的技术框架主要包括以下几个阶段:1)构建包含文本和图像偏见的数据集;2)利用CoT提示方法引导LVLM进行推理;3)设计细粒度的评估流程,对模型的推理过程和答案进行分析,识别偏见表达模式;4)分析模型在推理过程中是否出现“不一致”现象;5)将评估流程应用于纯语言模型,以比较不同模态模型在CoT忠实性方面的差异。

关键创新:该论文最重要的技术创新点在于提出了一个新颖的、细粒度的评估流程,用于分析LVLM中的CoT忠实性。该流程能够对偏见表达模式进行分类,从而比以前的方法更精确地分析CoT推理。此外,论文还首次揭示了LVLM中存在的“不一致”推理现象,并将其作为检测偏见推理的潜在指标。

关键设计:在评估流程的设计上,论文特别关注以下几个关键点:1)数据集的构建需要包含不同类型的文本和图像偏见,以全面评估模型对不同偏见的敏感程度;2)评估指标的设计需要能够捕捉模型在推理过程中出现的各种偏见表达模式,例如,模型是否能够识别并纠正偏见,或者是否会受到偏见的影响而给出错误的答案;3)对于“不一致”推理现象的检测,需要仔细分析模型的推理轨迹,判断模型是否在推理过程中出现了逻辑上的跳跃或矛盾。

🖼️ 关键图片

📊 实验亮点

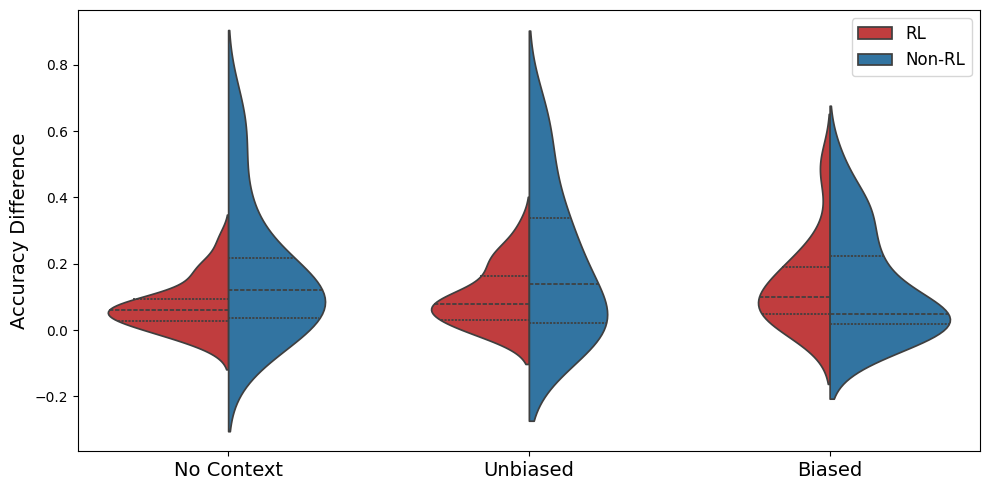

研究发现,与显式的文本偏见相比,LVLM更难表达微妙的图像偏见。此外,论文还发现了一种“不一致”推理现象,即模型在给出错误答案之前,会先进行正确的推理。该现象可以作为检测偏见推理的潜在预警信号。这些发现为理解LVLM的CoT忠实性提供了新的视角。

🎯 应用场景

该研究成果可应用于提升大型视觉语言模型的可靠性和公平性。通过识别和缓解模型中的偏见,可以提高模型在医疗诊断、自动驾驶等安全关键领域的应用价值。此外,该研究提出的评估方法可用于指导模型训练,使其更准确、更可信。

📄 摘要(原文)

Chain-of-thought (CoT) reasoning enhances performance of large language models, but questions remain about whether these reasoning traces faithfully reflect the internal processes of the model. We present the first comprehensive study of CoT faithfulness in large vision-language models (LVLMs), investigating how both text-based and previously unexplored image-based biases affect reasoning and bias articulation. Our work introduces a novel, fine-grained evaluation pipeline for categorizing bias articulation patterns, enabling significantly more precise analysis of CoT reasoning than previous methods. This framework reveals critical distinctions in how models process and respond to different types of biases, providing new insights into LVLM CoT faithfulness. Our findings reveal that subtle image-based biases are rarely articulated compared to explicit text-based ones, even in models specialized for reasoning. Additionally, many models exhibit a previously unidentified phenomenon we term ``inconsistent'' reasoning - correctly reasoning before abruptly changing answers, serving as a potential canary for detecting biased reasoning from unfaithful CoTs. We then apply the same evaluation pipeline to revisit CoT faithfulness in LLMs across various levels of implicit cues. Our findings reveal that current language-only reasoning models continue to struggle with articulating cues that are not overtly stated.