Retrieval Augmented Generation based Large Language Models for Causality Mining

作者: Thushara Manjari Naduvilakandy, Hyeju Jang, Mohammad Al Hasan

分类: cs.CL

发布日期: 2025-05-29

备注: 13 pages, 6 figures, published in knowledgeNLP-NAACL2025

💡 一句话要点

提出基于检索增强生成的大语言模型因果关系挖掘方法,提升因果检测与抽取性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 因果关系挖掘 检索增强生成 大语言模型 动态提示 信息抽取

📋 核心要点

- 现有因果关系挖掘方法,如无监督方法泛化性差,监督方法依赖大规模标注数据,限制了其应用。

- 论文提出基于检索增强生成(RAG)的动态提示方法,利用外部知识提升大语言模型在因果关系挖掘中的表现。

- 实验结果表明,该方法在多个数据集和不同大语言模型上,均优于传统的静态提示方法。

📝 摘要(中文)

因果关系检测与挖掘在信息检索中具有重要意义,可广泛应用于信息抽取和知识图谱构建。现有方法包括无监督和监督方法,但无监督方法性能较差,且需要大量人工干预进行因果规则选择,泛化能力弱;监督方法则受限于缺乏大规模训练数据集。近年来,有效提示工程的大语言模型(LLM)在一定程度上缓解了数据不足的问题。然而,目前缺乏利用LLM提示进行因果关系检测和挖掘的全面研究。本文提出了一种基于检索增强生成(RAG)的动态提示方案,以增强LLM在因果关系检测和抽取任务中的性能。在三个数据集和五个LLM上的大量实验验证了我们提出的基于RAG的动态提示优于其他静态提示方案。

🔬 方法详解

问题定义:论文旨在解决因果关系检测和抽取问题。现有无监督方法依赖人工规则,泛化能力差;监督方法需要大量标注数据,成本高昂。大语言模型(LLM)虽然具备一定的知识,但在因果关系挖掘方面仍存在不足,尤其是在缺乏特定领域知识的情况下表现不佳。

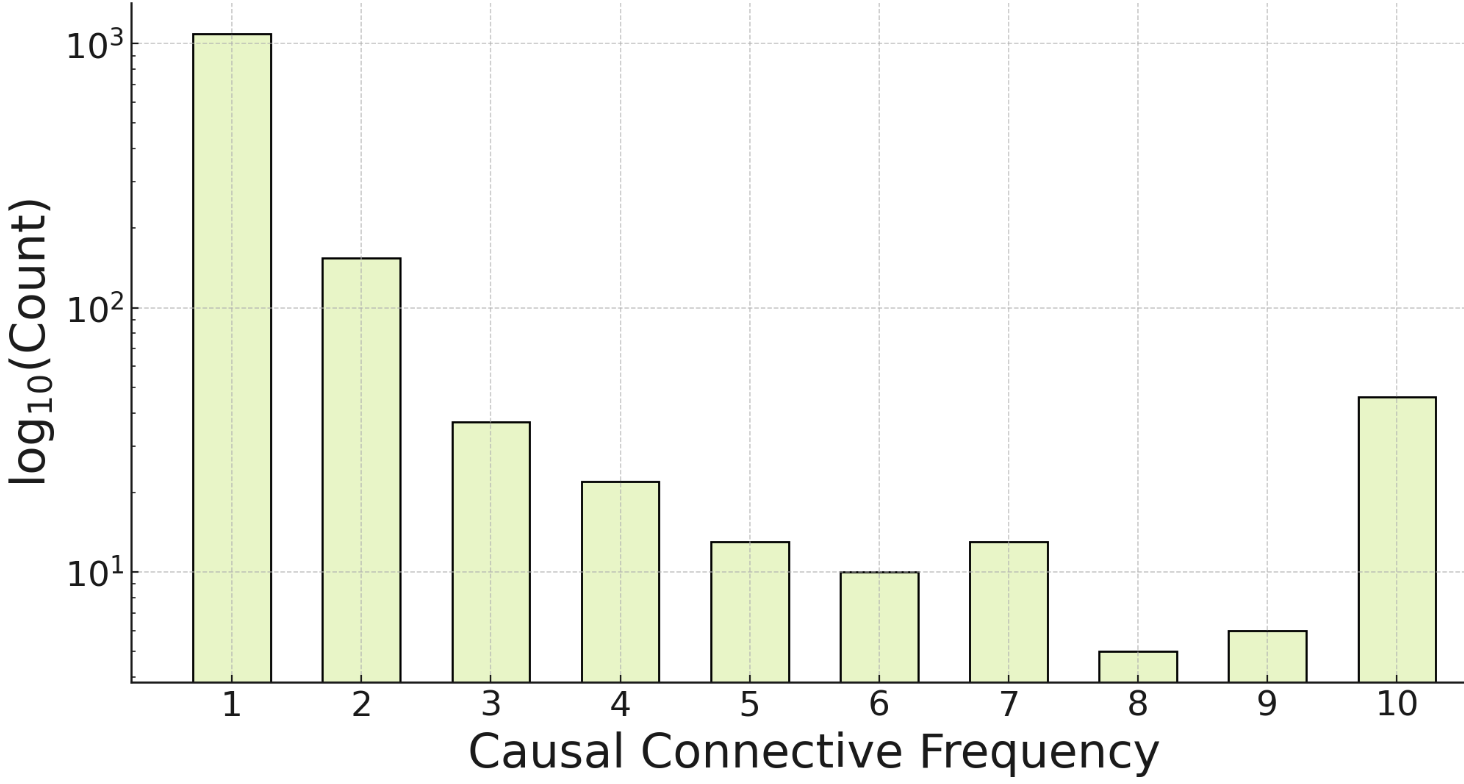

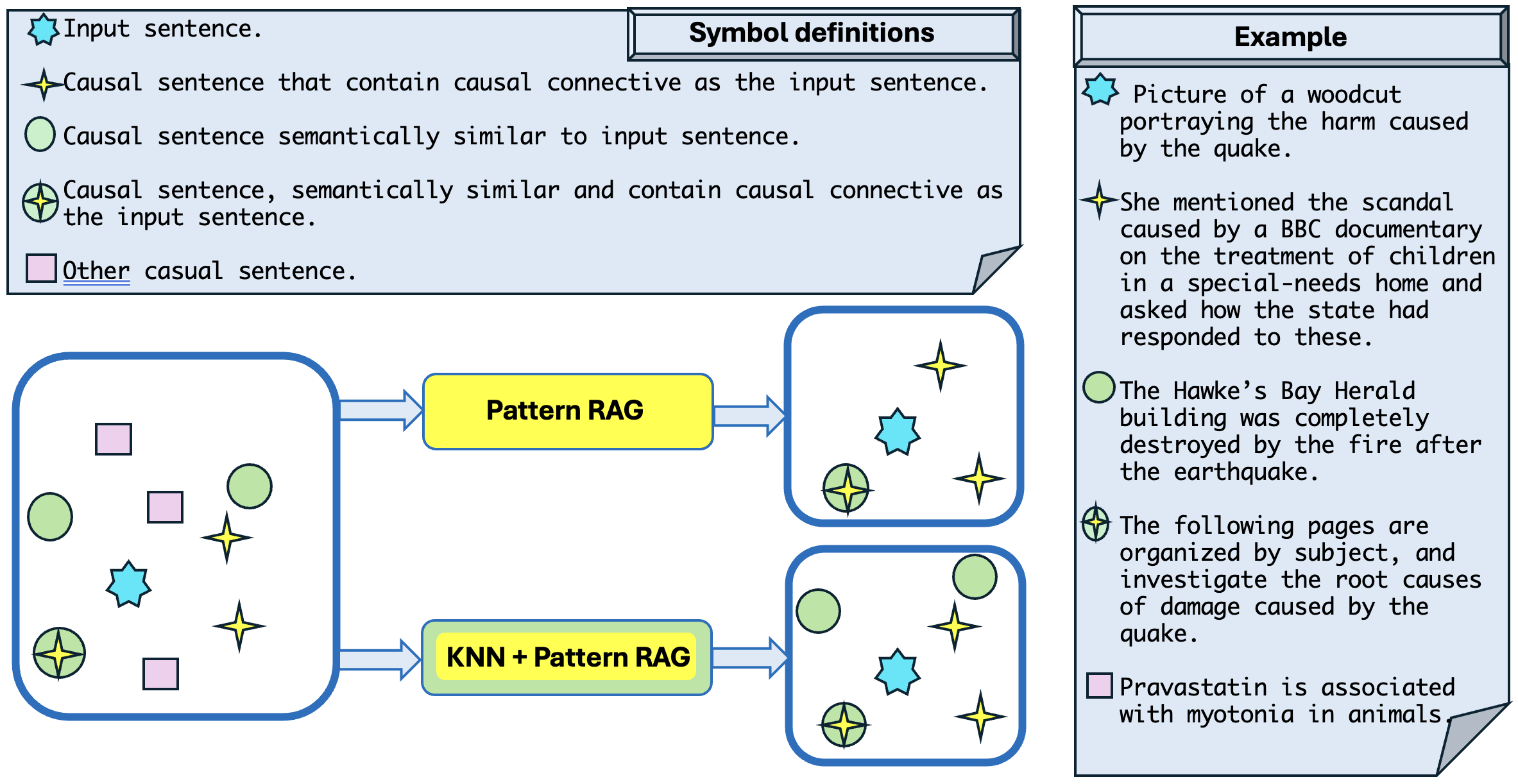

核心思路:论文的核心思路是利用检索增强生成(RAG)框架,为LLM提供相关的外部知识,从而提升其在因果关系检测和抽取任务中的性能。通过检索与输入相关的文档片段,LLM可以获得更丰富的上下文信息,从而更准确地判断因果关系。动态提示策略则允许根据检索到的信息调整提示,进一步优化LLM的输出。

技术框架:整体框架包含以下几个主要步骤:1) 检索:根据输入文本,从外部知识库中检索相关的文档片段。2) 增强:将检索到的文档片段与原始输入文本结合,形成增强的输入。3) 生成:将增强的输入传递给LLM,并使用动态提示策略生成因果关系判断或抽取结果。4) 评估:对LLM的输出进行评估,并根据评估结果调整检索和提示策略。

关键创新:论文的关键创新在于将检索增强生成(RAG)与动态提示策略相结合,用于因果关系检测和抽取。传统的静态提示方法无法充分利用外部知识,而RAG框架可以有效地将相关知识融入到LLM的输入中。动态提示策略则允许根据检索到的知识调整提示,进一步优化LLM的输出,使其更适应不同的输入场景。

关键设计:论文中涉及的关键设计包括:1) 检索策略:选择合适的检索算法和知识库,以确保检索到相关的文档片段。2) 提示工程:设计有效的提示模板,引导LLM进行因果关系判断和抽取。3) 动态提示策略:根据检索到的知识调整提示,例如,根据检索到的因果关系规则调整提示内容。4) 评估指标:选择合适的评估指标,例如精确率、召回率和F1值,以评估LLM的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的基于RAG的动态提示方法在三个数据集和五个LLM上均优于其他静态提示方案。具体性能提升幅度未知,但论文强调了RAG方法在提升LLM因果关系挖掘能力方面的有效性。实验验证了动态提示策略的优势,表明其能够根据检索到的知识优化LLM的输出。

🎯 应用场景

该研究成果可应用于信息抽取、知识图谱构建、问答系统等领域。通过提升因果关系挖掘的准确性和效率,可以帮助人们更好地理解复杂事件之间的关联,从而做出更明智的决策。例如,在医疗领域,可以用于挖掘疾病与症状之间的因果关系,辅助医生进行诊断和治疗。

📄 摘要(原文)

Causality detection and mining are important tasks in information retrieval due to their enormous use in information extraction, and knowledge graph construction. To solve these tasks, in existing literature there exist several solutions -- both unsupervised and supervised. However, the unsupervised methods suffer from poor performance and they often require significant human intervention for causal rule selection, leading to poor generalization across different domains. On the other hand, supervised methods suffer from the lack of large training datasets. Recently, large language models (LLMs) with effective prompt engineering are found to be effective to overcome the issue of unavailability of large training dataset. Yet, in existing literature, there does not exist comprehensive works on causality detection and mining using LLM prompting. In this paper, we present several retrieval-augmented generation (RAG) based dynamic prompting schemes to enhance LLM performance in causality detection and extraction tasks. Extensive experiments over three datasets and five LLMs validate the superiority of our proposed RAG-based dynamic prompting over other static prompting schemes.