Table-R1: Inference-Time Scaling for Table Reasoning

作者: Zheyuan Yang, Lyuhao Chen, Arman Cohan, Yilun Zhao

分类: cs.CL

发布日期: 2025-05-29 (更新: 2025-09-26)

备注: EMNLP 2025

💡 一句话要点

Table-R1:探索表格推理任务的推理时缩放技术,提升小模型性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 表格推理 推理时缩放 知识蒸馏 强化学习 可验证奖励

📋 核心要点

- 现有表格推理模型计算成本高昂,难以在资源受限的环境中部署,推理时缩放能力不足。

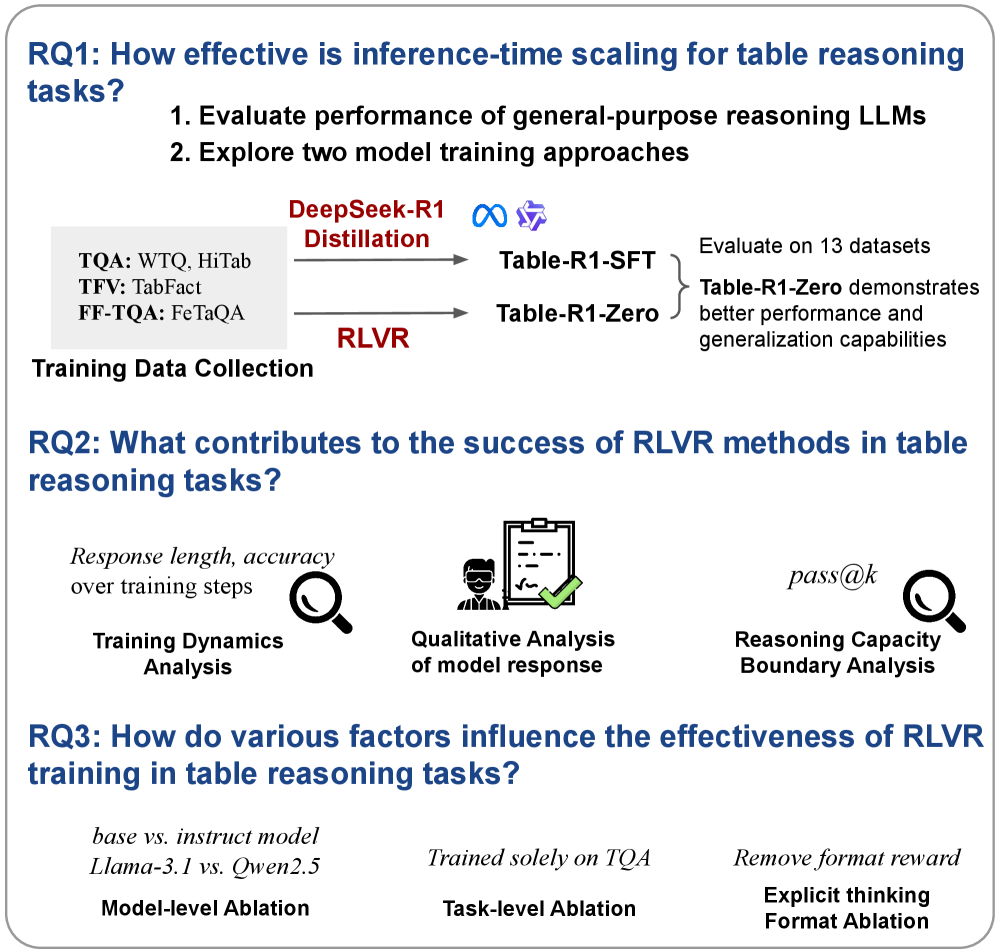

- 论文提出两种后训练策略:基于DeepSeek-R1推理轨迹的知识蒸馏和基于可验证奖励的强化学习,实现推理时性能提升。

- 实验表明,仅使用70亿参数的Table-R1-Zero模型,在多个表格推理任务上达到甚至超过GPT-4.1和DeepSeek-R1的性能。

📝 摘要(中文)

本文首次探索了表格推理任务中的推理时缩放技术。我们开发并评估了两种后训练策略来实现推理时缩放:从前沿模型推理轨迹中进行知识蒸馏,以及使用可验证奖励的强化学习(RLVR)。对于知识蒸馏,我们引入了一个由DeepSeek-R1生成的大规模推理轨迹数据集,并使用它来微调LLM,得到Table-R1-SFT模型。对于RLVR,我们提出了特定于任务的可验证奖励函数,并应用GRPO算法来获得Table-R1-Zero模型。我们在各种表格推理任务(包括简答题、事实核查和自由问答)中评估了Table-R1系列模型。值得注意的是,Table-R1-Zero模型在使用仅70亿参数的LLM的情况下,性能与GPT-4.1和DeepSeek-R1相匹配甚至超过。它还展示了对领域外数据集的强大泛化能力。大量的消融和定性分析揭示了指令调优、模型架构选择和跨任务泛化的好处,以及在RL训练期间出现的关键表格推理技能。

🔬 方法详解

问题定义:论文旨在解决表格推理任务中,现有大型语言模型(LLM)计算成本高、推理速度慢,难以在资源受限环境下部署的问题。现有方法通常依赖于模型规模的扩大来提升性能,但忽略了推理效率,缺乏推理时缩放的能力。

核心思路:论文的核心思路是通过后训练技术,使小规模LLM能够学习到大型模型的推理能力,从而在保证性能的同时,降低计算成本,实现推理时缩放。具体而言,论文探索了知识蒸馏和强化学习两种方法,分别从不同的角度提升小模型的推理能力。

技术框架:论文的技术框架主要包含两个分支:基于知识蒸馏的Table-R1-SFT模型和基于强化学习的Table-R1-Zero模型。

- Table-R1-SFT:首先利用DeepSeek-R1生成大规模的推理轨迹数据集,然后使用该数据集对LLM进行微调,使其学习到DeepSeek-R1的推理过程。

- Table-R1-Zero:设计特定于表格推理任务的可验证奖励函数,并使用GRPO(Gradient Ratio Policy Optimization)算法对LLM进行强化学习,使其能够根据奖励函数自主学习推理策略。

关键创新:论文的关键创新在于:

- 首次探索了表格推理任务中的推理时缩放技术。

- 提出了基于推理轨迹的知识蒸馏方法,有效利用了大型模型的推理过程信息。

- 设计了可验证的奖励函数,引导强化学习过程,提升了模型的推理能力和泛化能力。

关键设计:

- 推理轨迹数据集:使用DeepSeek-R1生成,包含输入表格、问题以及DeepSeek-R1的推理步骤。

- 可验证奖励函数:针对不同的表格推理任务,设计了不同的奖励函数,例如,对于事实核查任务,奖励函数会根据模型输出的答案是否正确进行奖励或惩罚。

- GRPO算法:使用GRPO算法进行强化学习,该算法能够有效地平衡探索和利用,避免模型陷入局部最优。

🖼️ 关键图片

📊 实验亮点

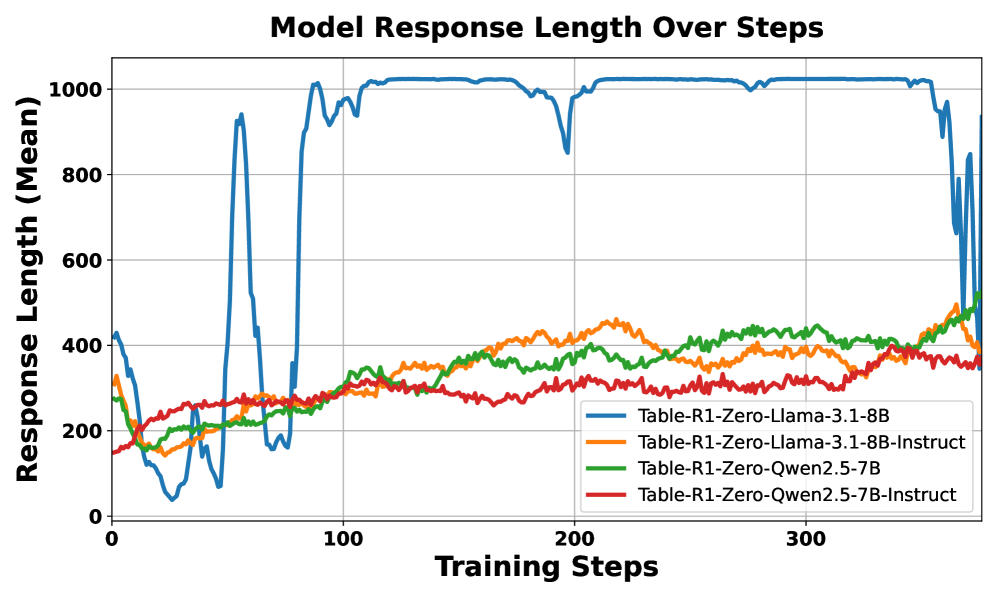

Table-R1-Zero模型在仅使用70亿参数的情况下,在多个表格推理任务上达到了与GPT-4.1和DeepSeek-R1相媲美的性能,甚至在某些任务上超过了它们。此外,Table-R1-Zero模型还展现出了强大的领域外泛化能力,在未见过的表格数据上也能保持较高的准确率。消融实验表明,指令调优和模型架构选择对性能提升有显著影响。

🎯 应用场景

该研究成果可应用于各种需要表格推理的场景,例如金融分析、医疗诊断、智能客服等。通过使用小规模模型,可以在资源受限的设备上实现高效的表格数据分析和决策支持,降低部署成本,提高响应速度。未来,该技术有望进一步推广到其他类型的推理任务中。

📄 摘要(原文)

In this work, we present the first study to explore inference-time scaling on table reasoning tasks. We develop and evaluate two post-training strategies to enable inference-time scaling: distillation from frontier model reasoning traces and reinforcement learning with verifiable rewards (RLVR). For distillation, we introduce a large-scale dataset of reasoning traces generated by DeepSeek-R1, which we use to fine-tune LLMs into the Table-R1-SFT model. For RLVR, we propose task-specific verifiable reward functions and apply the GRPO algorithm to obtain the Table-R1-Zero model. We evaluate our Table-R1-series models across diverse table reasoning tasks, including short-form QA, fact verification, and free-form QA. Notably, the Table-R1-Zero model matches or exceeds the performance of GPT-4.1 and DeepSeek-R1, while using only a 7B-parameter LLM. It also demonstrates strong generalization to out-of-domain datasets. Extensive ablation and qualitative analyses reveal the benefits of instruction tuning, model architecture choices, and cross-task generalization, as well as emergence of essential table reasoning skills during RL training.