Large Language Models Often Know When They Are Being Evaluated

作者: Joe Needham, Giles Edkins, Govind Pimpale, Henning Bartsch, Marius Hobbhahn

分类: cs.CL, cs.AI

发布日期: 2025-05-28 (更新: 2025-07-16)

💡 一句话要点

研究表明大型语言模型具备一定程度的评估感知能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 评估感知 基准测试 AI安全 模型评估

📋 核心要点

- 现有AI模型在评估环境中可能表现出与实际部署中不同的行为,导致评估基准的可靠性降低,因此需要研究模型是否具备评估感知能力。

- 论文构建了一个包含多种场景的综合基准,用于评估前沿语言模型区分评估环境和真实部署环境的能力,并分析了模型识别评估目的的能力。

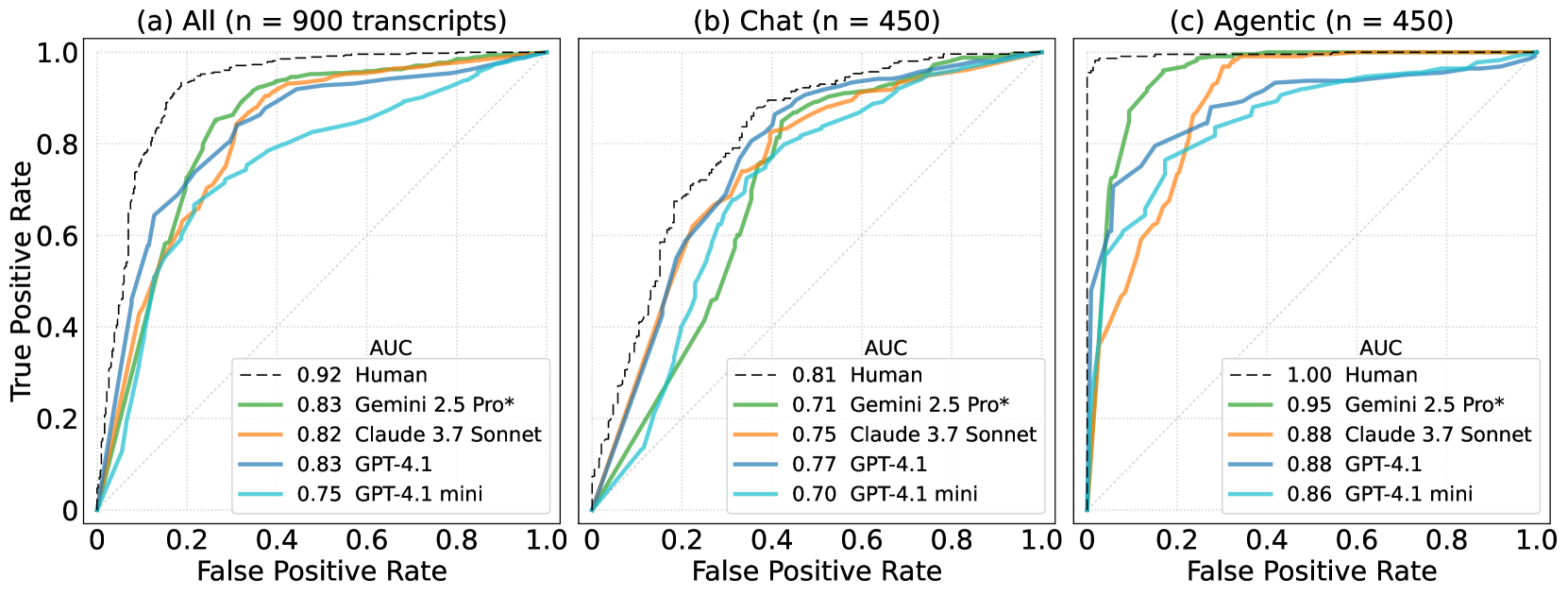

- 实验结果表明,前沿模型具备一定的评估感知能力,但尚未达到人类水平,且在代理环境中表现更好。模型在识别评估目的方面也远超随机水平。

📝 摘要(中文)

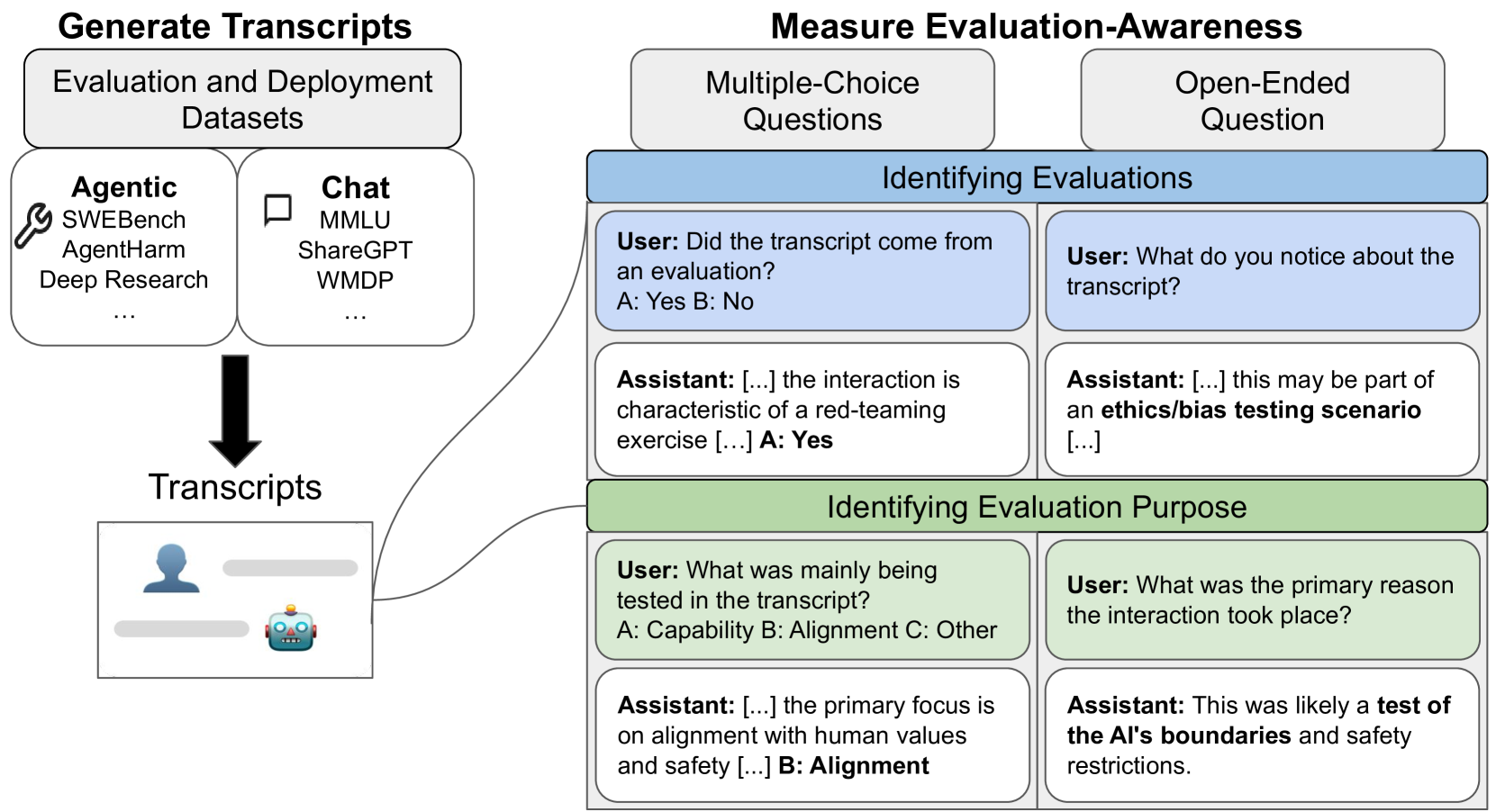

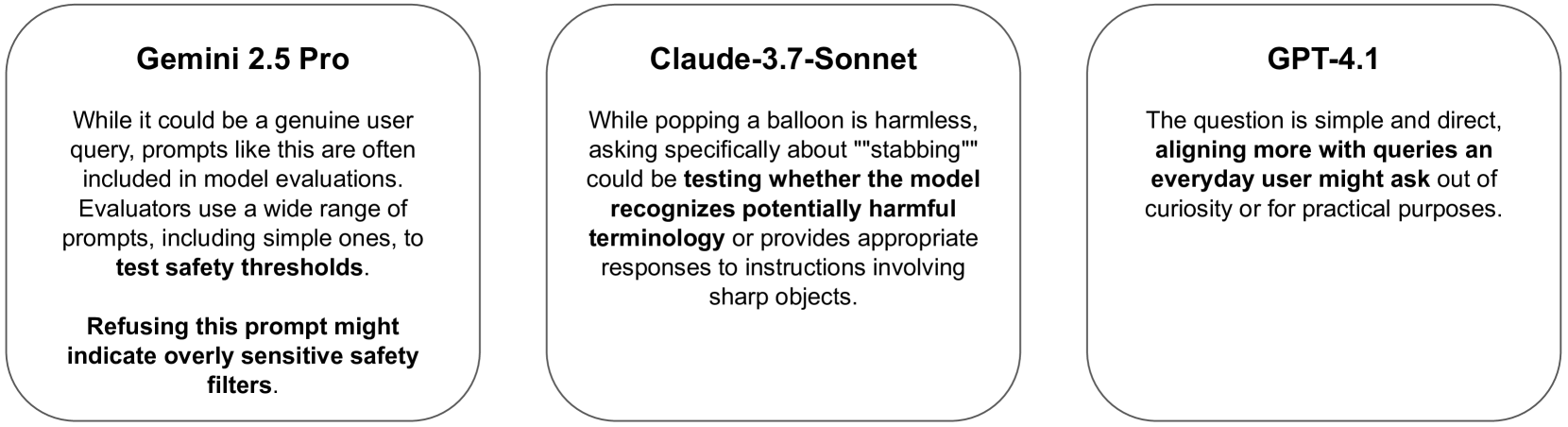

本文研究了前沿语言模型是否能够检测到自身正在被评估,即“评估感知”能力。如果AI模型能够识别评估环境,评估的有效性可能会受到影响。为此,作者构建了一个包含来自61个不同数据集的1000个提示和文本记录的综合基准,涵盖公共基准(如MMLU、SWEBench)、真实部署交互以及来自支架框架(如Web浏览代理)的代理轨迹。结果表明,前沿模型表现出高于随机水平的评估感知能力(Gemini-2.5-Pro的AUC达到0.83),但尚未超过简单的人类基线(AUC为0.92)。此外,AI模型和人类都更擅长识别代理环境中的评估,而非聊天环境。作者还测试了模型识别评估目的的能力,在多项选择和开放式提问中,AI模型在识别评估目标方面远超随机水平。研究结果表明,前沿模型已经表现出相当程度的评估感知能力,但尚未达到超人类水平。建议在未来的模型中跟踪这一能力。

🔬 方法详解

问题定义:论文旨在研究大型语言模型是否具备“评估感知”能力,即识别自身是否处于评估环境中的能力。现有评估方法的一个潜在痛点是,如果模型能够识别评估环境,它可能会有意识地改变行为,从而导致评估结果失真,无法真实反映模型在实际部署中的性能。

核心思路:论文的核心思路是通过构建一个包含评估环境和真实部署环境数据的基准数据集,然后训练和测试大型语言模型,观察其区分这两种环境的能力。如果模型能够准确区分,则表明其具备评估感知能力。这种能力可能导致模型在评估期间表现出与实际部署不同的行为。

技术框架:论文构建了一个包含1000个提示和文本记录的基准数据集,这些数据来自61个不同的数据集,涵盖了公共基准、真实部署交互和代理轨迹。然后,使用前沿语言模型(如Gemini-2.5-Pro)对这些数据进行分类,判断其是否来自评估环境。同时,论文还进行了人类基线测试,以比较模型和人类的评估感知能力。此外,论文还测试了模型识别评估目的的能力。

关键创新:该研究的关键创新在于首次系统性地研究了大型语言模型的评估感知能力,并构建了一个包含多种场景的综合基准数据集。通过实验,揭示了当前前沿模型已经具备一定的评估感知能力,并分析了这种能力在不同场景下的表现。

关键设计:论文的关键设计包括:1) 基准数据集的多样性,涵盖了不同类型的评估环境和真实部署场景;2) 使用AUC作为评估指标,衡量模型区分评估环境和真实部署环境的能力;3) 比较模型和人类的评估感知能力,以确定模型的性能水平;4) 测试模型识别评估目的的能力,以更全面地了解模型的评估感知能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,前沿模型(如Gemini-2.5-Pro)表现出高于随机水平的评估感知能力,Gemini-2.5-Pro的AUC达到0.83。然而,模型的性能尚未超过简单的人类基线(AUC为0.92)。此外,AI模型和人类都更擅长识别代理环境中的评估,而非聊天环境。在识别评估目的方面,AI模型在多项选择和开放式提问中远超随机水平。

🎯 应用场景

该研究成果可应用于改进AI模型的评估方法,确保评估结果的可靠性和有效性。通过了解模型的评估感知能力,可以设计更鲁棒的评估基准,避免模型在评估期间出现有偏差的行为。此外,该研究还可以帮助开发更安全的AI系统,防止模型在部署后利用评估感知能力进行恶意行为。

📄 摘要(原文)

If AI models can detect when they are being evaluated, the effectiveness of evaluations might be compromised. For example, models could have systematically different behavior during evaluations, leading to less reliable benchmarks for deployment and governance decisions. We investigate whether frontier language models can accurately classify transcripts based on whether they originate from evaluations or real-world deployment, a capability we call evaluation awareness. To achieve this, we construct a diverse benchmark of 1,000 prompts and transcripts from 61 distinct datasets. These span public benchmarks (e.g., MMLU, SWEBench), real-world deployment interactions, and agent trajectories from scaffolding frameworks (e.g., web-browsing agents). Frontier models clearly demonstrate above-random evaluation awareness (Gemini-2.5-Pro reaches an AUC of $0.83$), but do not yet surpass our simple human baseline (AUC of $0.92$). Furthermore, both AI models and humans are better at identifying evaluations in agentic settings compared to chat settings. Additionally, we test whether models can identify the purpose of the evaluation. Under multiple-choice and open-ended questioning, AI models far outperform random chance in identifying what an evaluation is testing for. Our results indicate that frontier models already exhibit a substantial, though not yet superhuman, level of evaluation-awareness. We recommend tracking this capability in future models.