Unraveling LoRA Interference: Orthogonal Subspaces for Robust Model Merging

作者: Haobo Zhang, Jiayu Zhou

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-05-28

备注: 14 pages, 5 figures, 16 tables, accepted by ACL 2025

💡 一句话要点

提出正交子空间模型合并(OSRM),解决LoRA模型合并时的性能退化问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 模型合并 低秩适应 LoRA 正交子空间 多任务学习

📋 核心要点

- 现有模型合并方法在合并LoRA微调的模型时,存在显著的性能下降,原因是忽略了模型参数与数据分布间的相互影响。

- OSRM的核心思想是在微调前约束LoRA子空间,确保任务相关的更新不会对其他任务的输出产生负面影响,从而减少任务间的干扰。

- 实验结果表明,OSRM不仅提升了模型合并的性能,还保留了单任务的准确性,并且对合并超参数具有更强的鲁棒性。

📝 摘要(中文)

针对大型语言模型(LLM)微调后部署和存储成本高昂的问题,模型合并技术应运而生,旨在将多个特定任务的模型合并为一个多任务模型,无需额外训练。然而,现有合并方法在合并使用低秩适应(LoRA)微调的模型时,常常面临严重的性能下降。本文指出,这是由于模型参数和数据分布之间先前被忽视的相互作用所致。为此,我们提出了正交子空间模型合并(OSRM),在微调之前约束LoRA子空间,确保与一个任务相关的更新不会对其他任务的输出产生不利影响。我们的方法可以无缝集成到大多数现有合并算法中,减少任务间不必要的干扰。在八个数据集上,使用三个常用LLM和两个大型LLM进行的广泛实验表明,我们的方法不仅提高了合并性能,还保留了单任务的准确性。此外,我们的方法对合并的超参数表现出更强的鲁棒性。这些结果突出了数据-参数交互在模型合并中的重要性,并为合并LoRA模型提供了一个即插即用的解决方案。

🔬 方法详解

问题定义:论文旨在解决使用LoRA进行微调后的大型语言模型在模型合并时出现的性能显著下降问题。现有模型合并方法没有充分考虑模型参数和数据分布之间的相互作用,导致任务间的干扰,从而降低了合并模型的性能。

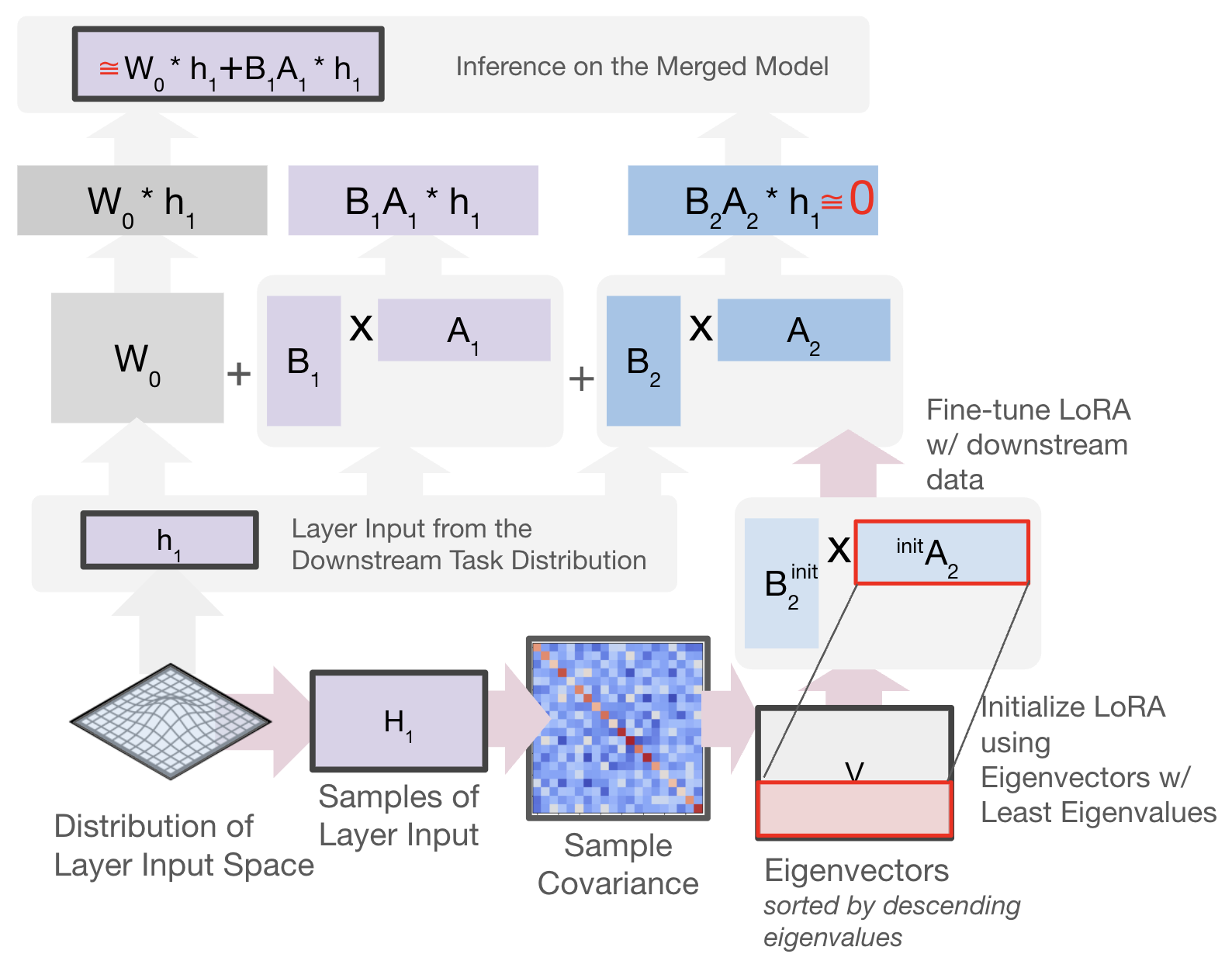

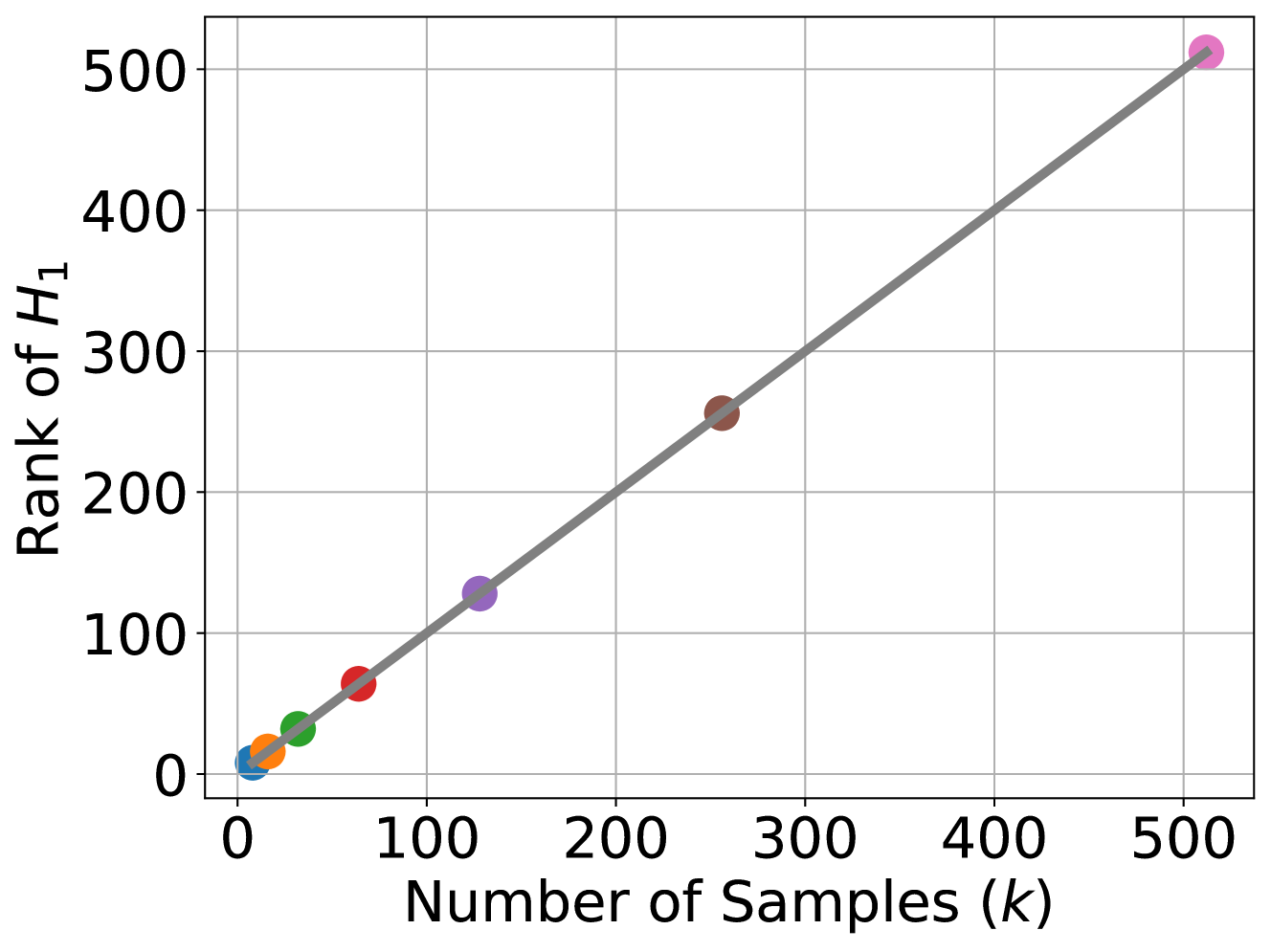

核心思路:论文的核心思路是在LoRA微调之前,对LoRA的参数子空间进行约束,使其满足正交性。通过确保不同任务的LoRA更新位于正交的子空间中,可以最大限度地减少一个任务的更新对其他任务输出的负面影响,从而提高模型合并的性能。这种正交性约束旨在解耦不同任务的学习过程,减少任务间的干扰。

技术框架:OSRM方法可以无缝集成到现有的模型合并算法中。其主要流程包括:1) 在LoRA微调之前,对LoRA参数矩阵进行正交约束,确保不同任务的更新位于正交子空间中。2) 使用LoRA对各个任务进行微调。3) 使用现有的模型合并算法(例如,平均权重)合并微调后的LoRA模型。4) 在合并后的模型上进行评估。

关键创新:该论文的关键创新在于提出了在LoRA微调之前对LoRA子空间进行正交约束的思想。与现有方法不同,OSRM关注数据-参数交互,通过约束参数空间来减少任务间的干扰,从而提高模型合并的性能。现有方法通常直接合并微调后的模型参数,而忽略了任务间的相互影响。

关键设计:OSRM的关键设计在于如何实现LoRA子空间的正交约束。一种实现方式是使用Gram-Schmidt正交化过程,在每次LoRA更新后,对LoRA参数矩阵进行正交化。另一种方式是在损失函数中添加一个正交性约束项,鼓励LoRA参数矩阵保持正交。具体的损失函数形式可以根据实际情况进行调整,例如,可以使用Frobenius范数来衡量不同LoRA参数矩阵之间的正交性。

🖼️ 关键图片

📊 实验亮点

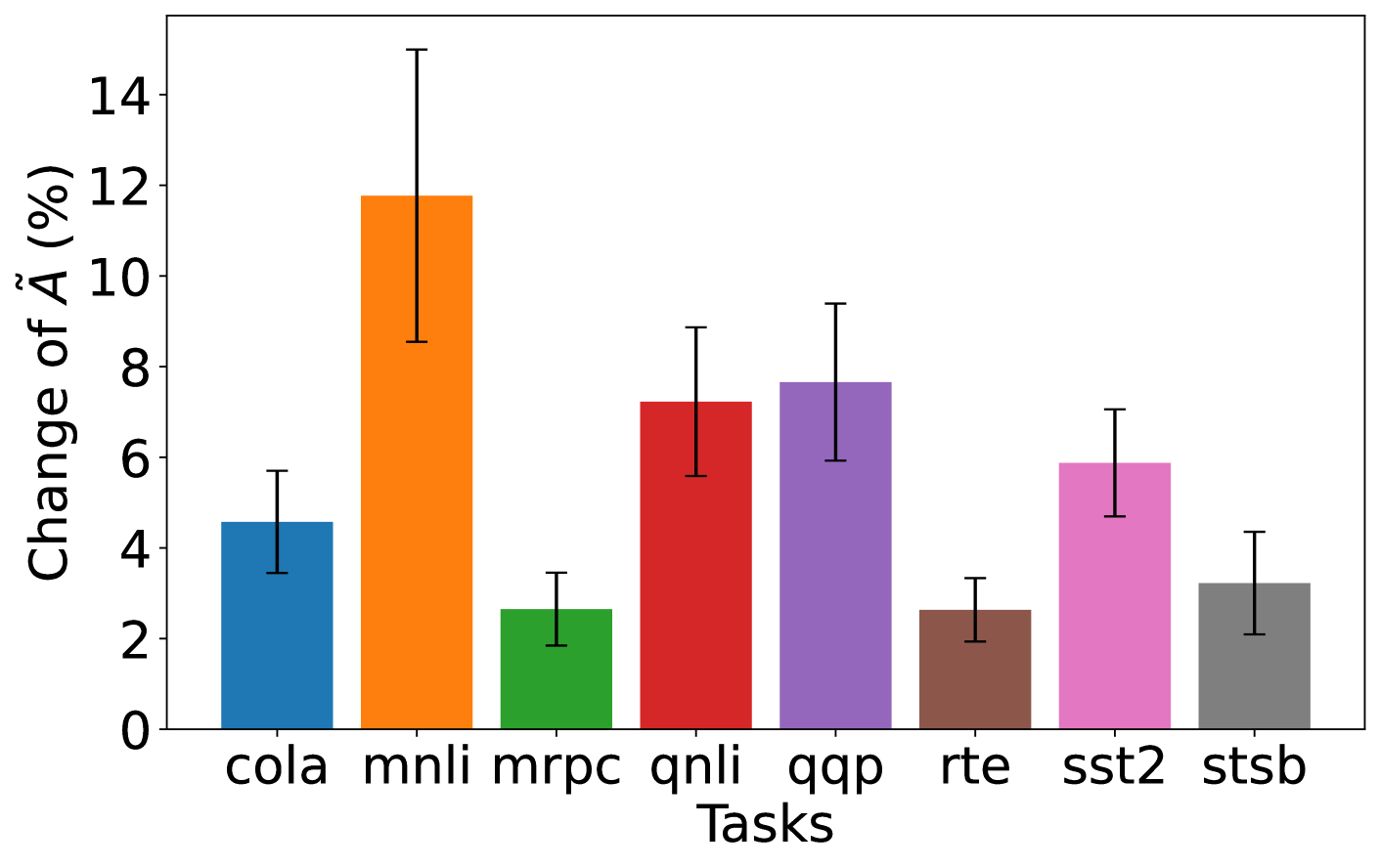

实验结果表明,OSRM在多个数据集和大型语言模型上均取得了显著的性能提升。例如,在某些数据集上,OSRM可以将合并模型的性能提升高达10%以上,并且能够更好地保留单任务的准确性。此外,OSRM还表现出对合并超参数的更强鲁棒性,这意味着该方法更容易部署和使用。

🎯 应用场景

该研究成果可广泛应用于需要对大型语言模型进行多任务学习的场景,例如,智能客服、多语言翻译、内容生成等。通过OSRM方法,可以有效地将多个特定任务的模型合并为一个高性能的多任务模型,降低部署和存储成本,并提高模型的泛化能力。该方法还有助于开发更加模块化和可扩展的AI系统。

📄 摘要(原文)

Fine-tuning large language models (LMs) for individual tasks yields strong performance but is expensive for deployment and storage. Recent works explore model merging to combine multiple task-specific models into a single multi-task model without additional training. However, existing merging methods often fail for models fine-tuned with low-rank adaptation (LoRA), due to significant performance degradation. In this paper, we show that this issue arises from a previously overlooked interplay between model parameters and data distributions. We propose Orthogonal Subspaces for Robust model Merging (OSRM) to constrain the LoRA subspace prior to fine-tuning, ensuring that updates relevant to one task do not adversely shift outputs for others. Our approach can seamlessly integrate with most existing merging algorithms, reducing the unintended interference among tasks. Extensive experiments on eight datasets, tested with three widely used LMs and two large LMs, demonstrate that our method not only boosts merging performance but also preserves single-task accuracy. Furthermore, our approach exhibits greater robustness to the hyperparameters of merging. These results highlight the importance of data-parameter interaction in model merging and offer a plug-and-play solution for merging LoRA models.