Do Large Language Models Think Like the Brain? Sentence-Level Evidences from Layer-Wise Embeddings and fMRI

作者: Yu Lei, Xingyang Ge, Yi Zhang, Yiming Yang, Bolei Ma

分类: cs.CL, q-bio.NC

发布日期: 2025-05-28 (更新: 2025-12-02)

备注: AAAI 2026

💡 一句话要点

通过层级嵌入和fMRI,研究大型语言模型与人脑的句子级神经机制相似性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 fMRI 神经机制 层级表征 类脑计算 句子级别分析 神经预测模型 语言理解

📋 核心要点

- 现有研究缺乏对LLM与人脑在句子级别神经机制上对应关系的系统性分析,难以判断LLM的类脑特性是否源于单纯的规模效应。

- 该研究通过比较LLM层级表征与人类fMRI数据,构建神经预测模型,旨在揭示LLM中哪些层与大脑特定区域的激活相关联。

- 实验结果表明,LLM性能的提升会促使其表征架构向类脑层级结构演进,尤其在高层语义抽象层面表现出更强的功能和解剖对应性。

📝 摘要(中文)

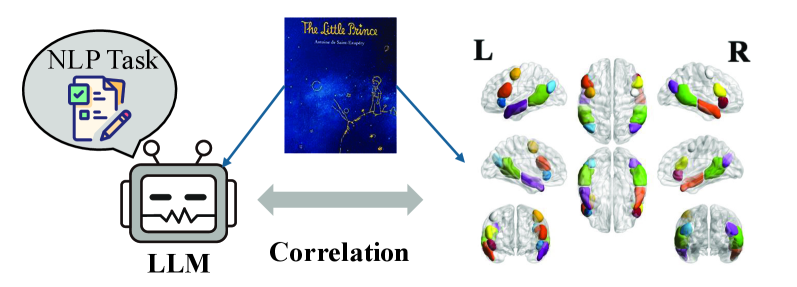

本研究旨在探究大型语言模型(LLMs)与人脑在计算原理上是否趋同,这是一个认知神经科学和人工智能领域的重要问题。研究关注LLMs中类脑模式的出现是否仅仅源于模型规模的扩大,还是反映了与人类语言处理架构更深层次的对齐。通过比较14个公开LLMs的层级嵌入与人类在自然叙事故事理解过程中的fMRI数据,构建句子级别的神经预测模型,以识别与大脑区域激活最相关的模型层。结果表明,模型性能的提升驱动表征架构向类脑层级结构演进,尤其是在更高语义抽象层面上实现了更强的功能和解剖对应关系。这些发现加深了我们对LLMs与人脑之间计算相似性的理解,突显了LLMs作为人类语言处理模型的潜力。

🔬 方法详解

问题定义:现有方法主要关注LLM的整体性能,缺乏对LLM内部表征与人脑神经活动在句子级别上的细粒度对应关系的研究。以往研究难以区分LLM的类脑特性是源于模型规模的扩大,还是反映了与人类语言处理架构更深层次的对齐。因此,需要一种方法来系统地比较LLM的层级表征与人脑的神经活动,以揭示它们之间的对应关系。

核心思路:该研究的核心思路是通过比较LLM不同层的嵌入向量与人类在理解句子时的fMRI数据,来建立LLM内部表征与人脑神经活动之间的联系。通过构建句子级别的神经预测模型,可以识别LLM中哪些层与大脑特定区域的激活相关联,从而揭示LLM的类脑特性。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 从14个公开的LLM中提取句子级别的层级嵌入向量;2) 收集人类在理解自然叙事故事时的fMRI数据;3) 构建句子级别的神经预测模型,将LLM的嵌入向量作为预测变量,fMRI数据作为目标变量;4) 分析不同LLM层与大脑区域之间的相关性,以识别与大脑激活最相关的模型层;5) 评估模型性能与LLM表征架构的类脑程度之间的关系。

关键创新:该研究的关键创新在于:1) 系统地比较了多个LLM的层级表征与人类fMRI数据,从而更全面地评估了LLM的类脑特性;2) 构建了句子级别的神经预测模型,从而可以更细粒度地分析LLM内部表征与人脑神经活动之间的对应关系;3) 揭示了模型性能的提升会促使LLM表征架构向类脑层级结构演进。

关键设计:该研究的关键设计包括:1) 选择了14个具有代表性的公开LLM,涵盖了不同的模型架构和训练数据;2) 使用了自然叙事故事作为实验材料,以模拟真实的语言理解场景;3) 使用了岭回归作为神经预测模型的算法,以避免过拟合;4) 使用了解码精度作为评估模型性能的指标,以衡量LLM表征与人脑神经活动之间的相关性。

🖼️ 关键图片

📊 实验亮点

研究结果表明,随着模型性能的提升,LLM的表征架构会向类脑层级结构演进,尤其是在更高语义抽象层面上实现了更强的功能和解剖对应关系。具体来说,性能更优的模型在高层语义处理区域(如前额叶皮层)与人脑的激活模式具有更高的相关性。这表明,提升模型性能是使LLM更像人脑的关键因素。

🎯 应用场景

该研究的成果可以应用于以下领域:1) 改进LLM的架构设计,使其更符合人类的语言处理方式;2) 利用LLM作为人脑语言处理的计算模型,从而加深我们对人类语言理解机制的理解;3) 开发更有效的神经机器翻译系统,使其能够更好地模拟人类的翻译过程。此外,该研究还可以为认知神经科学和人工智能的交叉研究提供新的思路和方法。

📄 摘要(原文)

Understanding whether large language models (LLMs) and the human brain converge on similar computational principles remains a fundamental and important question in cognitive neuroscience and AI. Do the brain-like patterns observed in LLMs emerge simply from scaling, or do they reflect deeper alignment with the architecture of human language processing? This study focuses on the sentence-level neural mechanisms of language models, systematically investigating how layer-wise representations in LLMs align with the dynamic neural responses during human sentence comprehension. By comparing hierarchical embeddings from 14 publicly available LLMs with fMRI data collected from participants, who were exposed to a naturalistic narrative story, we constructed sentence-level neural prediction models to identify the model layers most significantly correlated with brain region activations. Results show that improvements in model performance drive the evolution of representational architectures toward brain-like hierarchies, particularly achieving stronger functional and anatomical correspondence at higher semantic abstraction levels. These findings advance our understanding of the computational parallels between LLMs and the human brain, highlighting the potential of LLMs as models for human language processing.