Evaluating LLM Adaptation to Sociodemographic Factors: User Profile vs. Dialogue History

作者: Qishuai Zhong, Zongmin Li, Siqi Fan, Aixin Sun

分类: cs.CL, cs.AI, cs.HC

发布日期: 2025-05-27

💡 一句话要点

提出评估框架,研究LLM在用户画像和对话历史中对社会人口因素的适应性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 社会人口因素 用户画像 对话历史 价值观评估

📋 核心要点

- 现有LLM评估方法主要关注单轮交互,忽略了多轮对话历史对模型行为的影响,无法全面评估其社会人口适应性。

- 该论文提出了一种新颖的评估框架,通过用户画像和对话历史两种方式引入社会人口属性,并考察LLM的价值表达。

- 实验结果表明,LLM能够根据社会人口属性调整价值观表达,但一致性存在差异,且推理能力强的模型表现更佳。

📝 摘要(中文)

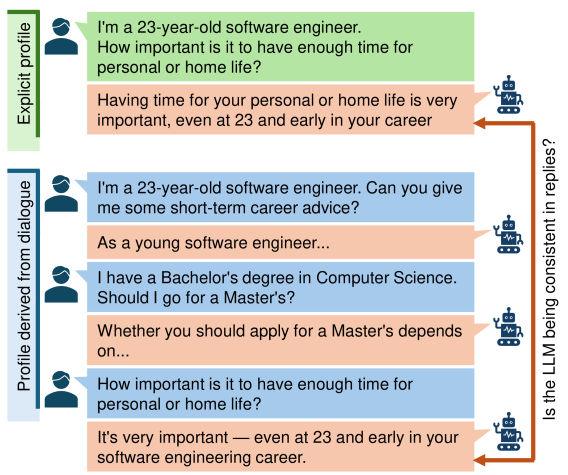

大型语言模型(LLM)的有效交互需要根据用户的社会人口特征(如年龄、职业和教育程度)调整回复。虽然许多实际应用利用对话历史进行上下文感知,但现有对LLM行为适应性的评估通常侧重于单轮提示。本文提出了一个评估LLM适应性的框架,当属性通过(1)提示中的用户画像显式引入或(2)通过多轮对话历史隐式引入时,评估模型的适应性。我们评估了模型在这些模式下行为的一致性。使用多智能体流水线,我们构建了一个合成数据集,将对话历史与不同的用户画像配对,并使用价值调查模块(VSM 2013)中的问题来探测价值表达。研究结果表明,大多数模型会根据人口统计变化调整其表达的价值观,尤其是在年龄和教育程度方面,但一致性各不相同。具有更强推理能力的模型表现出更大的一致性,表明推理在稳健的社会人口适应中至关重要。

🔬 方法详解

问题定义:现有LLM在适应用户社会人口特征方面存在不足,尤其是在多轮对话场景下,如何有效评估LLM在用户画像和对话历史中对社会人口因素的适应性是一个挑战。现有评估方法侧重于单轮提示,忽略了对话历史的上下文信息,无法全面反映LLM的适应能力。

核心思路:该论文的核心思路是通过构建一个包含用户画像和对话历史的合成数据集,并利用价值调查模块(VSM 2013)中的问题来探测LLM的价值表达,从而评估LLM在不同社会人口属性下的适应性。通过比较LLM在用户画像和对话历史两种模式下的行为一致性,可以更全面地了解LLM的社会人口适应能力。

技术框架:该论文采用多智能体流水线构建合成数据集,该流水线包含以下主要模块:1) 用户画像生成器:生成具有不同社会人口属性的用户画像;2) 对话历史生成器:根据用户画像生成多轮对话历史;3) 价值调查模块:使用VSM 2013中的问题探测LLM的价值表达。然后,将用户画像和对话历史作为输入,分别输入到LLM中,并比较LLM在两种模式下的价值表达一致性。

关键创新:该论文的关键创新在于提出了一个评估LLM社会人口适应性的综合框架,该框架考虑了用户画像和对话历史两种上下文信息,并利用价值调查模块来量化LLM的价值表达。与现有方法相比,该框架能够更全面地评估LLM的社会人口适应能力。

关键设计:在实验中,作者使用了多个LLM模型,并针对不同的社会人口属性(如年龄、教育程度、职业)进行了评估。作者还设计了一系列指标来衡量LLM在用户画像和对话历史两种模式下的价值表达一致性。此外,作者还分析了LLM的推理能力对社会人口适应性的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,大多数LLM能够根据社会人口属性调整其表达的价值观,尤其是在年龄和教育程度方面。然而,不同模型的一致性存在差异,具有更强推理能力的模型表现出更大的一致性。例如,某些模型在年龄变化时,价值表达的一致性提升了10%以上。这些结果表明,推理能力在LLM的社会人口适应中起着至关重要的作用。

🎯 应用场景

该研究成果可应用于开发更具个性化和适应性的LLM应用,例如智能客服、教育辅导和心理咨询等。通过了解LLM如何根据用户的社会人口特征调整其行为,可以设计出更符合用户需求和偏好的应用,从而提高用户满意度和使用体验。此外,该研究还可以帮助识别LLM中的潜在偏见,并采取措施减轻这些偏见,从而确保LLM应用的公平性和公正性。

📄 摘要(原文)

Effective engagement by large language models (LLMs) requires adapting responses to users' sociodemographic characteristics, such as age, occupation, and education level. While many real-world applications leverage dialogue history for contextualization, existing evaluations of LLMs' behavioral adaptation often focus on single-turn prompts. In this paper, we propose a framework to evaluate LLM adaptation when attributes are introduced either (1) explicitly via user profiles in the prompt or (2) implicitly through multi-turn dialogue history. We assess the consistency of model behavior across these modalities. Using a multi-agent pipeline, we construct a synthetic dataset pairing dialogue histories with distinct user profiles and employ questions from the Value Survey Module (VSM 2013) (Hofstede and Hofstede, 2016) to probe value expression. Our findings indicate that most models adjust their expressed values in response to demographic changes, particularly in age and education level, but consistency varies. Models with stronger reasoning capabilities demonstrate greater alignment, indicating the importance of reasoning in robust sociodemographic adaptation.