BLUCK: A Benchmark Dataset for Bengali Linguistic Understanding and Cultural Knowledge

作者: Daeen Kabir, Minhajur Rahman Chowdhury Mahim, Sheikh Shafayat, Adnan Sadik, Arian Ahmed, Eunsu Kim, Alice Oh

分类: cs.CL, cs.AI

发布日期: 2025-05-27 (更新: 2026-01-19)

备注: Accepted at BLP Workshop, IJCNLP-AACL 2025

💡 一句话要点

提出BLUCK:孟加拉语理解与文化知识的基准数据集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 孟加拉语 语言理解 文化知识 基准数据集 大型语言模型

📋 核心要点

- 现有大型语言模型在孟加拉语理解和文化知识方面缺乏专门的评估基准,阻碍了相关研究的进展。

- BLUCK数据集通过收集和整理包含孟加拉文化、历史和语言学知识的多项选择题,构建了一个全面的评估基准。

- 实验结果表明,现有LLM在BLUCK数据集上表现尚可,但在孟加拉语音韵学方面存在不足,揭示了未来研究方向。

📝 摘要(中文)

本文介绍BLUCK,一个旨在衡量大型语言模型(LLM)在孟加拉语语言理解和文化知识方面性能的新数据集。该数据集包含2366个多项选择题(MCQ),这些问题经过精心策划,来源于大学和求职级别的考试汇编,涵盖23个类别,包括孟加拉国文化、历史和孟加拉语语言学知识。我们使用6个专有LLM和3个开源LLM(包括GPT-4o、Claude-3.5-Sonnet、Gemini-1.5-Pro、Llama-3.3-70B-Instruct和DeepSeekV3)对BLUCK进行了基准测试。结果表明,虽然这些模型总体表现良好,但在孟加拉语音韵学的一些领域仍然存在困难。尽管当前LLM在孟加拉文化和语言环境中的表现与英语等主流语言相比仍有差距,但我们的结果表明孟加拉语作为一种中等资源语言的地位。重要的是,BLUCK也是第一个以孟加拉本土文化、历史和语言学为中心的多项选择题评估基准。

🔬 方法详解

问题定义:现有的大型语言模型在处理孟加拉语时,缺乏专门针对孟加拉文化、历史和语言学知识的评估基准。这使得评估和提升模型在孟加拉语环境下的理解能力变得困难。现有方法主要集中在通用语言理解能力上,忽略了特定文化和语言的细微差别。

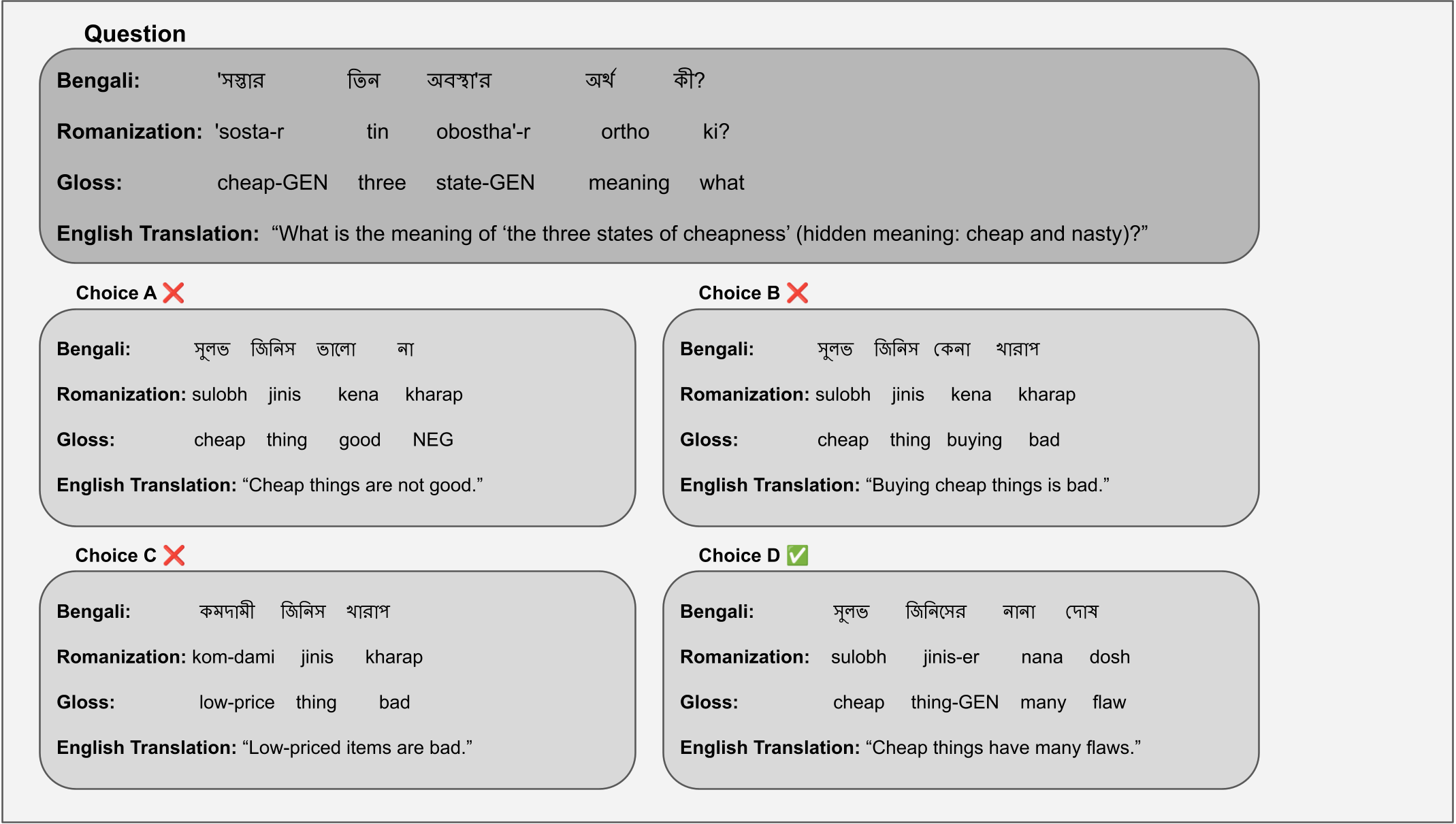

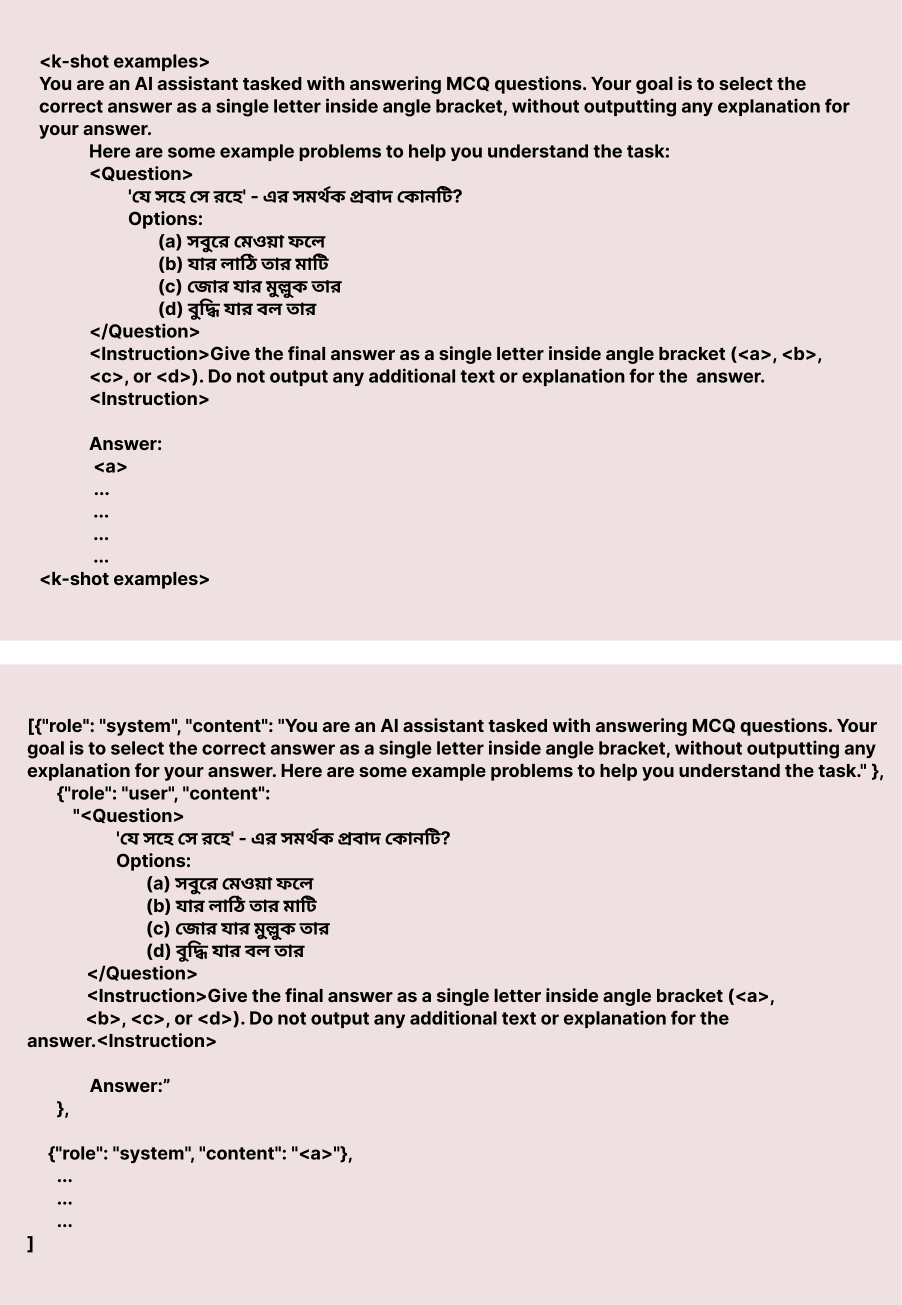

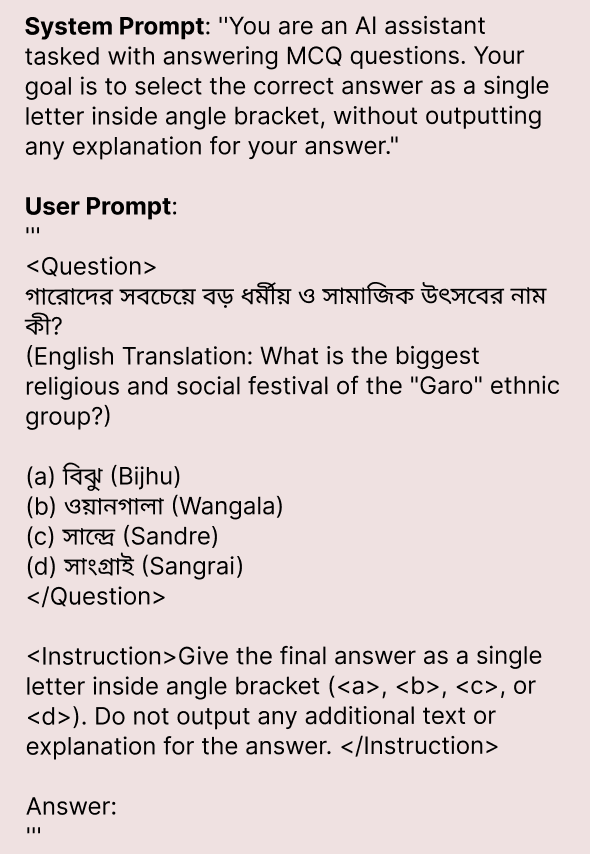

核心思路:BLUCK数据集的核心思路是构建一个包含大量多项选择题(MCQ)的基准数据集,这些问题涵盖了孟加拉文化、历史和语言学的各个方面。通过评估LLM在这些问题上的表现,可以更准确地衡量其在孟加拉语环境下的理解能力。

技术框架:BLUCK数据集的构建流程主要包括以下几个阶段:1) 数据收集:从大学和求职级别的考试汇编中收集相关题目。2) 数据清洗:对收集到的题目进行清洗和整理,确保题目的质量和准确性。3) 类别划分:将题目划分为23个类别,涵盖孟加拉文化、历史和语言学的各个方面。4) 基准测试:使用多个LLM(包括专有和开源模型)对BLUCK数据集进行基准测试,评估其性能。

关键创新:BLUCK数据集的主要创新点在于它是第一个以孟加拉本土文化、历史和语言学为中心的多项选择题评估基准。它填补了现有LLM评估基准在孟加拉语领域的空白,为相关研究提供了新的工具和资源。

关键设计:BLUCK数据集包含2366个多项选择题,涵盖23个类别。数据集的设计考虑了题目的难度和多样性,以确保能够全面评估LLM在孟加拉语环境下的理解能力。具体参数设置和损失函数取决于用于评估的LLM。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有LLM在BLUCK数据集上表现尚可,但与英语等主流语言相比仍有差距。例如,GPT-4o在总体上表现最好,但仍然在孟加拉语音韵学方面存在困难。这些结果表明,未来研究需要更加关注LLM在特定文化和语言环境下的适应能力。

🎯 应用场景

BLUCK数据集可用于评估和提升大型语言模型在孟加拉语环境下的理解能力,促进孟加拉语自然语言处理技术的发展。该数据集还可用于开发面向孟加拉语用户的智能应用,例如智能问答系统、机器翻译和内容生成工具。此外,BLUCK数据集有助于保护和传承孟加拉文化和历史知识。

📄 摘要(原文)

In this work, we introduce BLUCK, a new dataset designed to measure the performance of Large Language Models (LLMs) in Bengali linguistic understanding and cultural knowledge. Our dataset comprises 2366 multiple-choice questions (MCQs) carefully curated from compiled collections of several college and job level examinations and spans 23 categories covering knowledge on Bangladesh's culture and history and Bengali linguistics. We benchmarked BLUCK using 6 proprietary and 3 open-source LLMs - including GPT-4o, Claude-3.5-Sonnet, Gemini-1.5-Pro, Llama-3.3-70B-Instruct, and DeepSeekV3. Our results show that while these models perform reasonably well overall, they, however, struggles in some areas of Bengali phonetics. Although current LLMs' performance on Bengali cultural and linguistic contexts is still not comparable to that of mainstream languages like English, our results indicate Bengali's status as a mid-resource language. Importantly, BLUCK is also the first MCQ-based evaluation benchmark that is centered around native Bengali culture, history, and linguistics.