Semantic-Preserving Adversarial Attacks on LLMs: An Adaptive Greedy Binary Search Approach

作者: Chong Zhang, Xiang Li, Jia Wang, Shan Liang, Haochen Xue, Xiaobo Jin

分类: cs.CL, cs.CR

发布日期: 2025-05-26

备注: 19 pages, 8 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出自适应贪婪二分搜索AGBS,用于LLM的语义保持对抗攻击。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 对抗攻击 提示工程 语义保持 自适应搜索

📋 核心要点

- 现有LLM的自动提示优化机制可能导致对用户意图的误解,产生错误输出。

- 提出AGBS方法,模拟提示优化机制,动态评估其对LLM性能的影响,生成对抗样本。

- 实验表明AGBS在平衡语义一致性和攻击有效性方面表现出色,为提示优化系统设计提供参考。

📝 摘要(中文)

大型语言模型(LLM)越来越多地依赖图形用户界面(GUI)中的自动提示工程来优化用户输入并提高响应准确性。然而,用户需求的多样性常常导致意外的误解,自动优化扭曲了原始意图并产生错误的输出。为了应对这一挑战,我们提出了一种自适应贪婪二分搜索(AGBS)方法,该方法模拟了常见的提示优化机制,同时保持语义稳定性。我们的方法动态评估这些策略对LLM性能的影响,从而实现鲁棒的对抗样本生成。通过对开源和闭源LLM进行的大量实验,我们证明了AGBS在平衡语义一致性和攻击有效性方面的有效性。我们的研究结果为设计更可靠的提示优化系统提供了可操作的见解。代码可在https://github.com/franz-chang/DOBS 获取。

🔬 方法详解

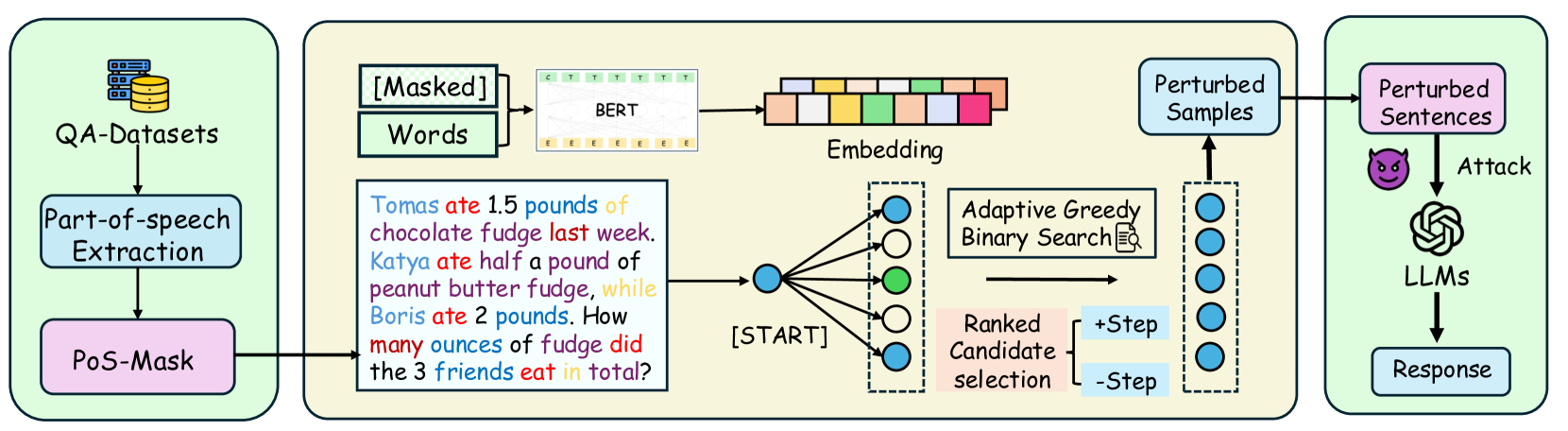

问题定义:论文旨在解决LLM在自动提示优化过程中,由于对用户意图的误解而产生错误输出的问题。现有方法缺乏在优化提示的同时保持语义一致性的能力,容易导致LLM生成与用户原始意图不符的响应。

核心思路:论文的核心思路是模拟常见的提示优化机制,并通过自适应的贪婪二分搜索(AGBS)方法,动态评估这些机制对LLM性能的影响。通过这种方式,可以在优化提示的同时,尽可能地保持原始语义的完整性,从而生成更有效的对抗样本。

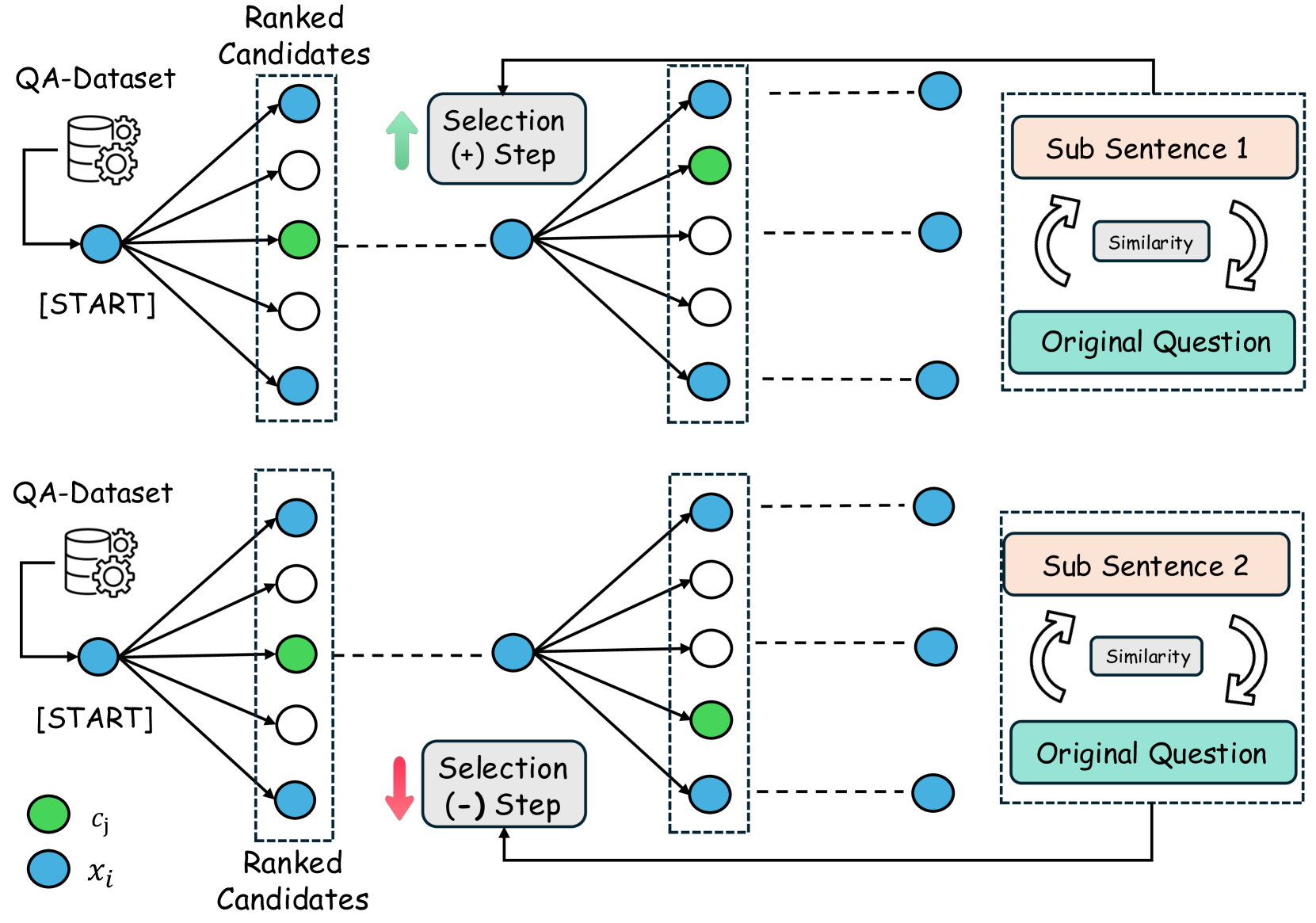

技术框架:AGBS方法主要包含以下几个阶段:1) 初始化:选择一个初始提示作为起点。2) 贪婪搜索:在每次迭代中,AGBS会尝试对提示进行小的修改,例如添加、删除或替换单词。3) 语义评估:对修改后的提示进行语义相似度评估,以确保其与原始提示的语义保持一致。4) 二分搜索:AGBS使用二分搜索策略来确定最佳的修改幅度,以在语义一致性和攻击有效性之间取得平衡。5) 迭代优化:重复上述步骤,直到达到预定的攻击目标或达到最大迭代次数。

关键创新:AGBS的关键创新在于其自适应性和贪婪二分搜索策略。自适应性体现在它可以根据LLM的反馈动态调整搜索策略,而贪婪二分搜索则可以在保证语义一致性的前提下,快速找到有效的对抗样本。与现有方法相比,AGBS能够更好地平衡语义一致性和攻击有效性。

关键设计:AGBS的关键设计包括:1) 语义相似度评估指标的选择,例如余弦相似度或BERTScore。2) 贪婪搜索的步长和搜索范围的设置。3) 二分搜索的停止条件,例如达到预定的攻击成功率或达到最大迭代次数。4) 对抗样本的生成策略,例如选择使LLM产生错误输出的提示作为对抗样本。

🖼️ 关键图片

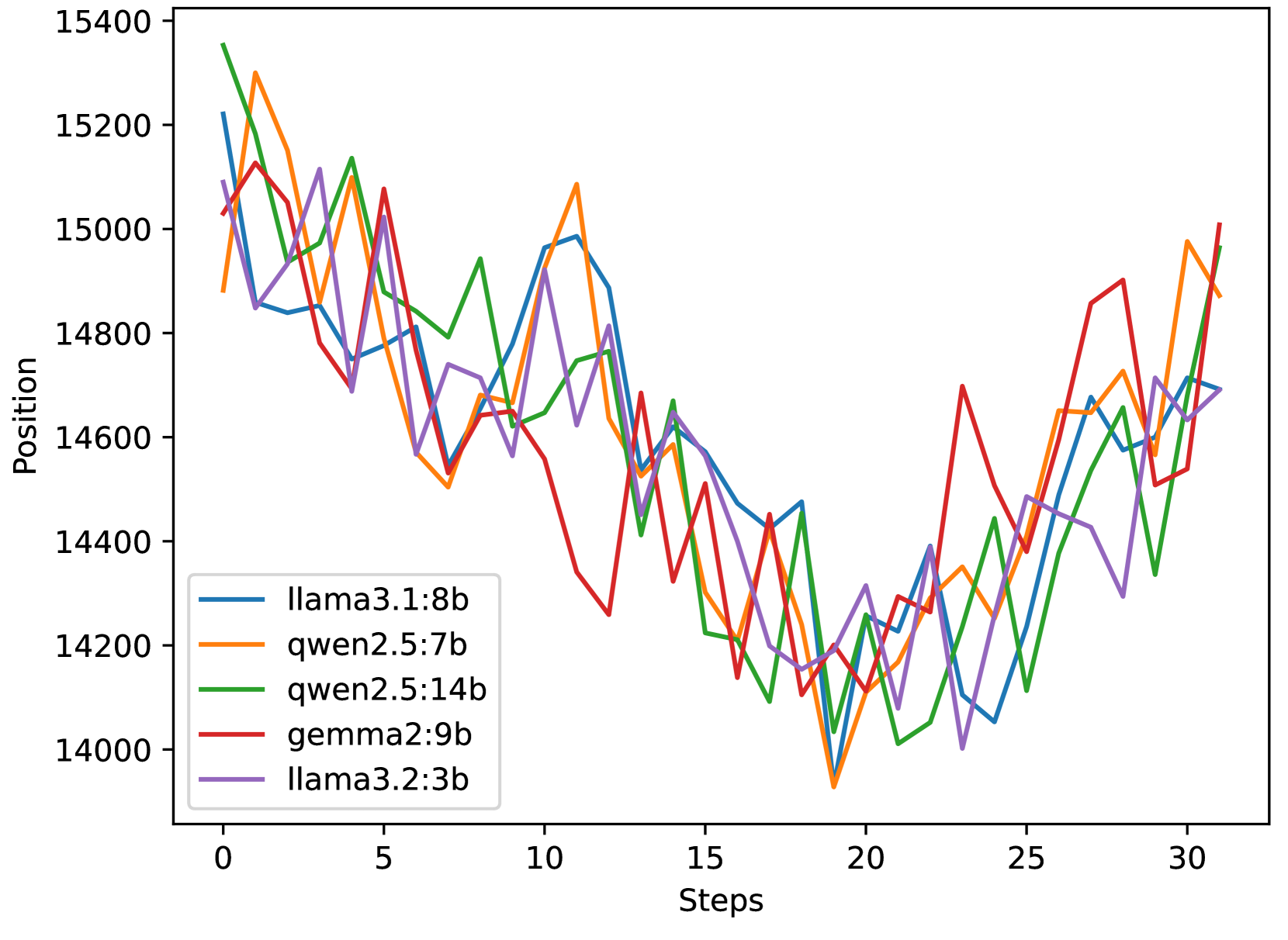

📊 实验亮点

实验结果表明,AGBS方法在开源和闭源LLM上均表现出良好的攻击效果,能够在保持语义一致性的前提下,有效地生成对抗样本。具体性能数据未知,但论文强调了AGBS在平衡语义一致性和攻击有效性方面的优势,优于现有方法。

🎯 应用场景

该研究成果可应用于提升LLM的鲁棒性和安全性,例如用于评估和改进LLM的提示优化系统,防止恶意用户利用自动提示工程进行攻击。此外,该方法还可以用于开发更可靠的LLM应用,确保LLM能够准确理解用户意图并生成高质量的响应。未来可应用于智能客服、内容生成、代码生成等领域。

📄 摘要(原文)

Large Language Models (LLMs) increasingly rely on automatic prompt engineering in graphical user interfaces (GUIs) to refine user inputs and enhance response accuracy. However, the diversity of user requirements often leads to unintended misinterpretations, where automated optimizations distort original intentions and produce erroneous outputs. To address this challenge, we propose the Adaptive Greedy Binary Search (AGBS) method, which simulates common prompt optimization mechanisms while preserving semantic stability. Our approach dynamically evaluates the impact of such strategies on LLM performance, enabling robust adversarial sample generation. Through extensive experiments on open and closed-source LLMs, we demonstrate AGBS's effectiveness in balancing semantic consistency and attack efficacy. Our findings offer actionable insights for designing more reliable prompt optimization systems. Code is available at: https://github.com/franz-chang/DOBS