Adaptive Classifier-Free Guidance via Dynamic Low-Confidence Masking

作者: Pengxiang Li, Shilin Yan, Joey Tsai, Renrui Zhang, Ruichuan An, Ziyu Guo, Xiaowei Gao

分类: cs.CL

发布日期: 2025-05-26

备注: Project page: https://github.com/pixeli99/A-CFG

💡 一句话要点

提出自适应无分类器引导(A-CFG),通过动态低置信度掩码提升生成模型的可控性。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 无分类器引导 扩散模型 语言生成 动态掩码 可控生成

📋 核心要点

- 现有CFG方法在迭代生成过程中使用静态无条件输入,忽略了模型不确定性的动态变化,导致引导效果受限。

- A-CFG通过动态地重新掩码模型低置信度的token,生成局部化的无条件输入,使引导更关注模型不确定的区域。

- 实验表明,A-CFG在多种语言生成任务上显著优于标准CFG,验证了动态调整引导机制的有效性。

📝 摘要(中文)

无分类器引导(CFG)通过插值条件和无条件预测,显著增强了生成模型的可控性。然而,标准CFG通常采用静态的无条件输入,这对于模型不确定性动态变化的迭代生成过程而言可能并非最优。我们提出自适应无分类器引导(A-CFG),一种通过利用模型瞬时预测置信度来调整无条件输入的新方法。在迭代(掩码)扩散语言模型的每一步中,A-CFG识别当前生成序列中模型置信度较低的token。这些token被临时重新掩码,以创建动态的、局部化的无条件输入。这使得CFG的校正影响精确地集中在模糊区域,从而实现更有效的引导。我们将A-CFG集成到最先进的掩码扩散语言模型中,并证明了其有效性。在各种语言生成基准上的实验表明,A-CFG比标准CFG有了显著的改进,例如在GPQA上获得了3.9分的提升。我们的工作突出了动态调整引导机制以适应迭代生成中模型不确定性的好处。

🔬 方法详解

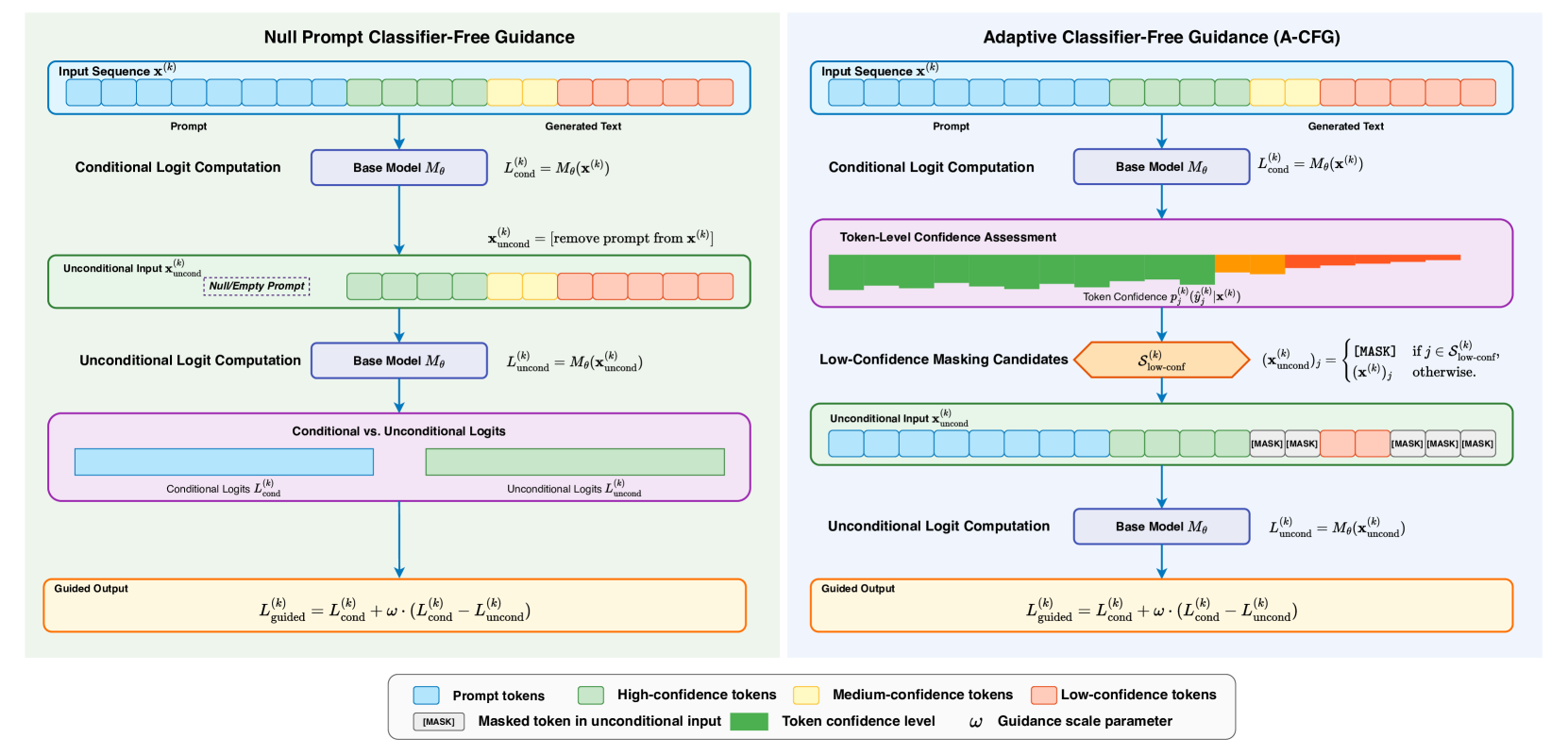

问题定义:论文旨在解决在迭代生成模型(特别是掩码扩散语言模型)中使用标准无分类器引导(CFG)时,由于静态无条件输入无法适应模型预测不确定性动态变化的问题。标准CFG对所有token一视同仁,无法针对性地引导模型在不确定的区域进行修正,导致生成质量和可控性受限。

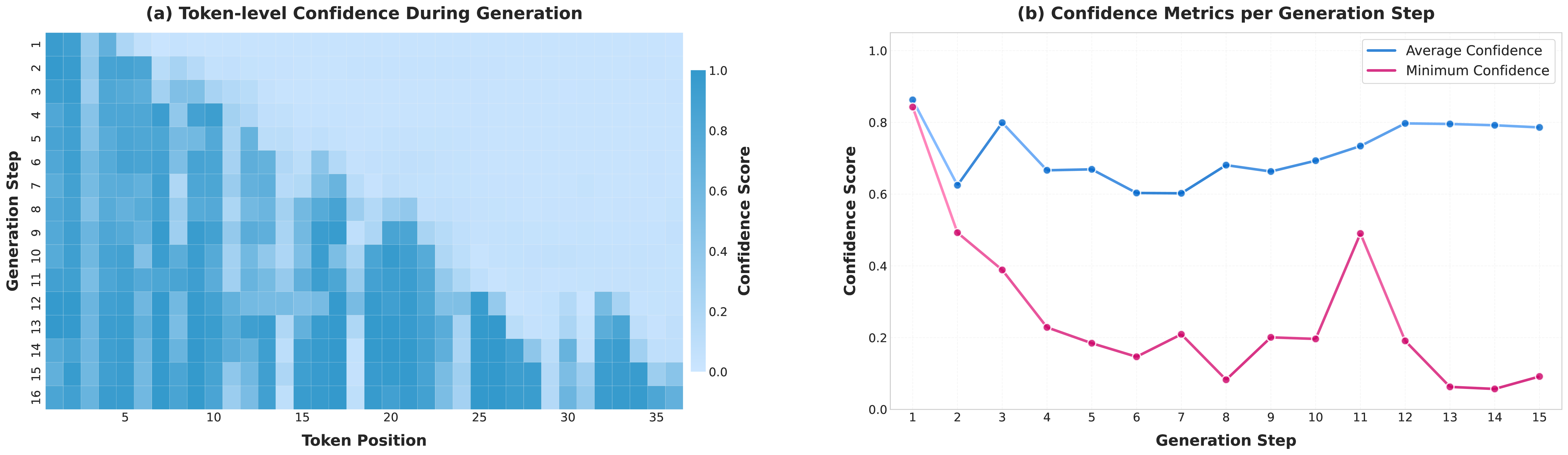

核心思路:A-CFG的核心思路是根据模型在每个迭代步骤中的预测置信度,动态地调整无条件输入。具体来说,对于模型预测置信度较低的token,将其重新掩码,迫使模型重新预测这些不确定的区域。通过这种方式,无条件输入能够更加关注模型容易出错的部分,从而使CFG的引导作用更加有效。这种动态调整的策略能够更好地适应模型在迭代生成过程中的不确定性变化。

技术框架:A-CFG可以集成到任何使用CFG的迭代生成模型中,特别是掩码扩散语言模型。其主要流程如下:1. 在每个迭代步骤中,模型首先生成一个序列。2. A-CFG评估模型对每个token的预测置信度(例如,通过softmax概率)。3. 根据置信度阈值,选择低置信度的token进行重新掩码。4. 使用重新掩码后的序列作为无条件输入,进行CFG计算。5. 将CFG的结果用于更新生成序列。

关键创新:A-CFG的关键创新在于动态地生成无条件输入,使其能够适应模型预测的不确定性。与标准CFG使用静态无条件输入不同,A-CFG通过重新掩码低置信度token,创建了一个局部化的、动态的无条件输入。这种动态调整的策略使得CFG的引导作用更加集中和有效。

关键设计:A-CFG的关键设计包括:1. 置信度评估方法:可以使用softmax概率、熵等指标来评估模型对每个token的预测置信度。2. 掩码策略:可以选择固定数量或比例的低置信度token进行掩码。3. 置信度阈值:需要根据具体任务和模型进行调整,以平衡引导的强度和生成的多样性。4. 集成方式:A-CFG可以与不同的CFG变体和掩码扩散语言模型相结合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,A-CFG在多个语言生成基准上显著优于标准CFG。例如,在GPQA数据集上,A-CFG取得了3.9分的提升。此外,A-CFG在其他任务上也表现出一致的性能提升,证明了其有效性和泛化能力。这些结果表明,动态调整引导机制能够显著提高生成模型的性能。

🎯 应用场景

A-CFG可应用于各种需要可控文本生成的场景,如机器翻译、文本摘要、对话生成、代码生成等。通过更精确的引导,可以提高生成文本的质量、相关性和一致性。该方法在医疗、金融等对准确性要求高的领域具有潜在应用价值,能够生成更可靠的专业文本。

📄 摘要(原文)

Classifier-Free Guidance (CFG) significantly enhances controllability in generative models by interpolating conditional and unconditional predictions. However, standard CFG often employs a static unconditional input, which can be suboptimal for iterative generation processes where model uncertainty varies dynamically. We introduce Adaptive Classifier-Free Guidance (A-CFG), a novel method that tailors the unconditional input by leveraging the model's instantaneous predictive confidence. At each step of an iterative (masked) diffusion language model, A-CFG identifies tokens in the currently generated sequence for which the model exhibits low confidence. These tokens are temporarily re-masked to create a dynamic, localized unconditional input. This focuses CFG's corrective influence precisely on areas of ambiguity, leading to more effective guidance. We integrate A-CFG into a state-of-the-art masked diffusion language model and demonstrate its efficacy. Experiments on diverse language generation benchmarks show that A-CFG yields substantial improvements over standard CFG, achieving, for instance, a 3.9 point gain on GPQA. Our work highlights the benefit of dynamically adapting guidance mechanisms to model uncertainty in iterative generation.