Scaling Physical Reasoning with the PHYSICS Dataset

作者: Shenghe Zheng, Qianjia Cheng, Junchi Yao, Mengsong Wu, Haonan He, Ning Ding, Yu Cheng, Shuyue Hu, Lei Bai, Dongzhan Zhou, Ganqu Cui, Peng Ye

分类: cs.CL, cs.LG, physics.ed-ph

发布日期: 2025-05-21 (更新: 2025-10-17)

备注: Accepted to the NeurIPS Datasets and Benchmarks Track

🔗 代码/项目: GITHUB

💡 一句话要点

提出PHYSICS数据集,用于提升和评估LLM在物理推理任务上的能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 物理推理 大型语言模型 数据集 评估框架 PHYSICS Rule+Model 科学计算 自然语言处理

📋 核心要点

- 现有大型语言模型在数学和编程等推理任务上取得了显著进展,但对物理这一同样需要推理且对理解现实世界至关重要的领域关注不足。

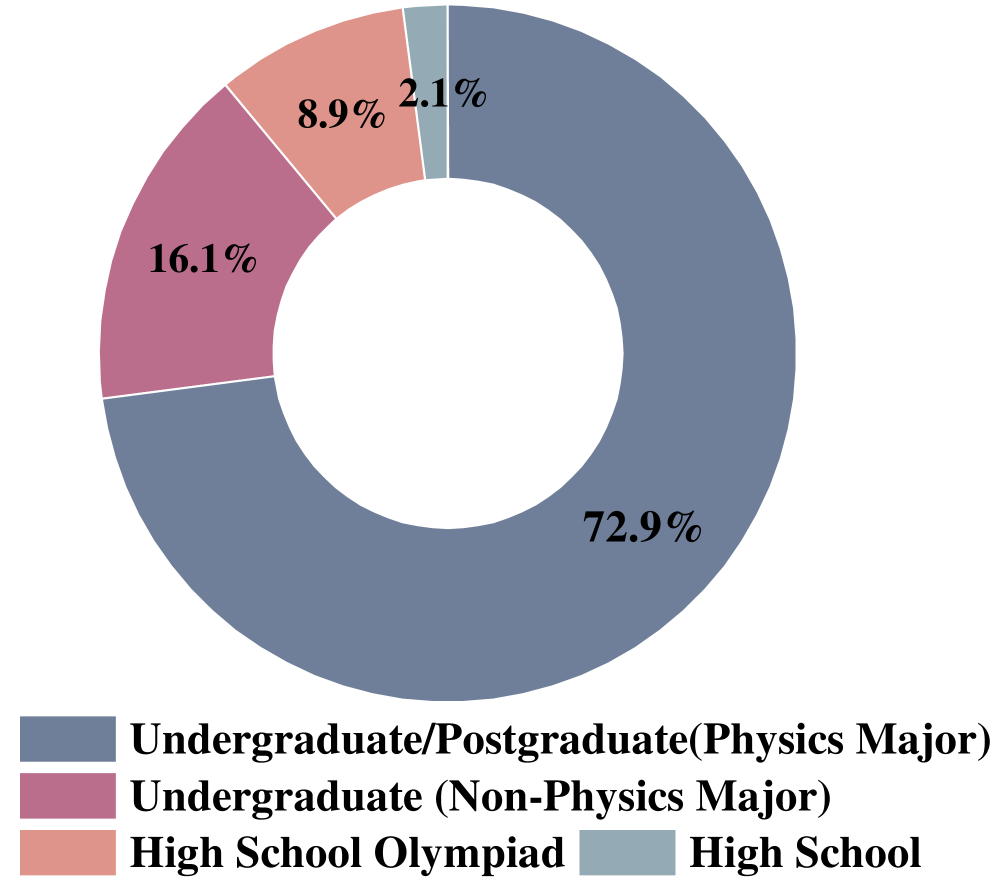

- 论文提出了PHYSICS数据集,包含16,568个高质量物理问题,覆盖力学、电磁学等五大领域,难度从高中到研究生级别,旨在促进物理推理能力的研究。

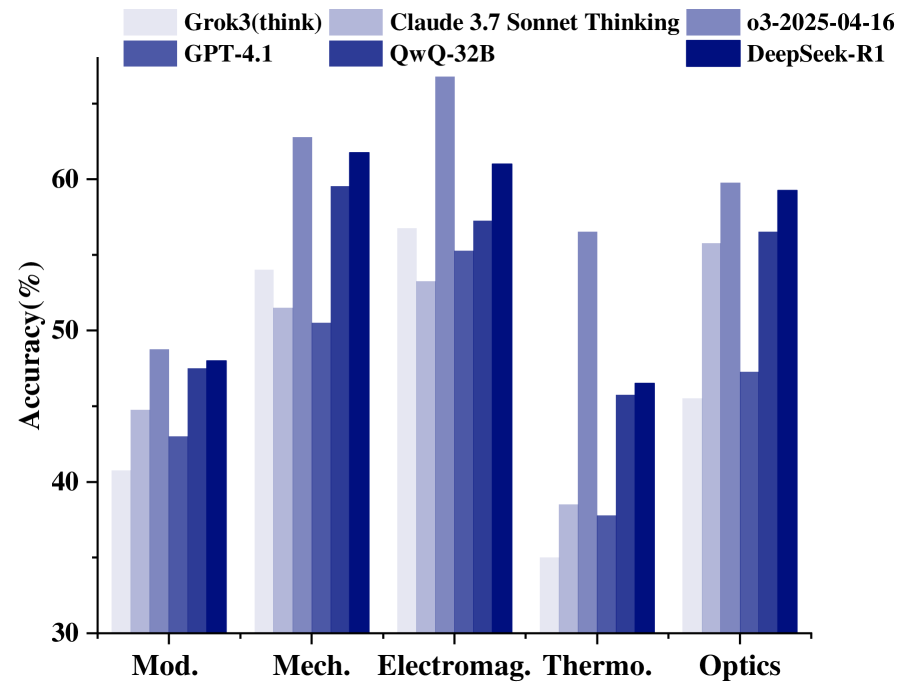

- 论文还提出了一种Rule+Model评估框架,以解决现有评估方法在物理领域存在的单位、简化和精度偏差问题,并对现有模型进行了评估。

📝 摘要(中文)

本文介绍了一个名为PHYSICS的数据集,旨在解决大型语言模型(LLMs)在物理推理方面关注不足的问题。该数据集包含16,568个高质量的物理问题,涵盖不同的主题和难度级别。PHYSICS数据集的构建经过精心设计的流程,从100多本教科书中收集练习题,并进行质量控制。它覆盖了五个主要的物理领域:力学、电磁学、热力学、光学和近代物理。难度范围从高中到研究生水平。为了利用这些数据来改进和评估模型的物理推理能力,我们将数据集分为训练集和测试集,并为训练数据提供由强大的推理模型生成的推理路径,以促进模型训练。此外,我们发现现有的评估框架在物理领域的单位、简化和精度等方面存在偏差。为了平衡效率和准确性,我们引入了一种针对物理问题的Rule+Model评估框架。我们对当前最先进的开源和专有模型的评估突出了当前模型在处理物理相关任务方面的局限性。我们希望我们的数据集和评估方法能够共同促进LLM在物理领域的发展。代码和数据可在https://github.com/Zhengsh123/PHYSICS找到。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在物理推理能力上的不足。现有方法在评估物理问题时,存在单位处理、公式简化和精度控制等方面的偏差,导致评估结果不准确。此外,缺乏高质量、大规模的物理问题数据集,限制了LLMs在物理领域的训练和发展。

核心思路:论文的核心思路是构建一个高质量的物理问题数据集PHYSICS,并设计一个更适合物理领域的评估框架Rule+Model。PHYSICS数据集提供丰富的训练数据,Rule+Model评估框架则能更准确地评估模型在物理问题上的表现。

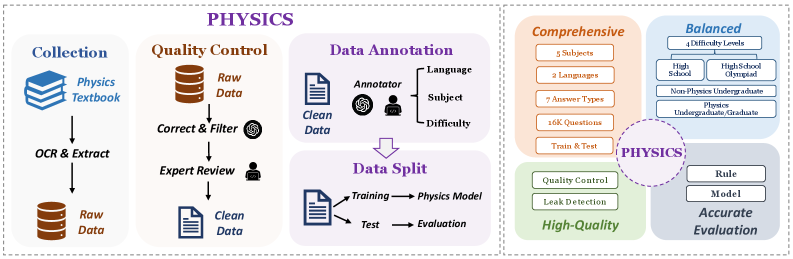

技术框架:PHYSICS数据集构建流程包括:1) 从100多本教科书中收集物理问题;2) 对问题进行分类,涵盖力学、电磁学、热力学、光学和近代物理等领域;3) 对问题进行难度分级,从高中到研究生水平;4) 对数据进行质量控制,确保问题的准确性和完整性。Rule+Model评估框架结合了规则和模型两种方法,首先使用规则检查单位和公式的正确性,然后使用模型评估问题的解答质量。

关键创新:论文的关键创新在于:1) 构建了大规模、高质量的PHYSICS数据集,填补了物理领域数据集的空白;2) 提出了Rule+Model评估框架,解决了现有评估方法在物理领域的偏差问题。

关键设计:PHYSICS数据集的构建过程中,采用了严格的质量控制流程,包括人工审核和自动化检查。Rule+Model评估框架中,规则部分的设计需要根据具体的物理领域和问题类型进行调整,模型部分可以选择不同的LLMs进行评估。

🖼️ 关键图片

📊 实验亮点

论文对当前最先进的开源和专有模型进行了评估,结果表明现有模型在处理物理相关任务方面存在局限性,突出了PHYSICS数据集和Rule+Model评估框架的价值。具体的性能数据和对比基线可以在论文中找到,为后续研究提供了参考。

🎯 应用场景

该研究成果可应用于提升大型语言模型在物理领域的推理能力,例如辅助物理教学、自动解答物理问题、进行科学研究等。PHYSICS数据集和Rule+Model评估框架可以作为基准,促进物理领域AI的发展,并推动LLM在科学领域的更广泛应用。

📄 摘要(原文)

Large Language Models (LLMs) have achieved remarkable progress on advanced reasoning tasks such as mathematics and coding competitions. Meanwhile, physics, despite being both reasoning-intensive and essential to real-world understanding, received limited academic and industrial attention. This paper introduces PHYSICS, a dataset containing 16,568 high-quality physics problems spanning subjects and difficulty levels, to facilitate this issue. Specifically, PHYSICS is curated with exercises from over 100 textbooks through a carefully designed pipeline for quality control. It covers five major physics domains: Mechanics, Electromagnetism, Thermodynamics, Optics, and Modern Physics. It also spans a wide range of difficulty levels, from high school to graduate-level physics courses. To utilize the data for improving and evaluating the model's physical reasoning capabilities, we split the dataset into training and test sets, and provide reasoning paths generated by powerful reasoning models for the training data to facilitate model training. In addition, for the evaluation part, we find that existing evaluation frameworks exhibit biases in aspects such as units, simplification, and precision in physics domain. To balance efficiency and accuracy, we introduce a Rule+Model evaluation framework tailored to physics problems. Our evaluations on current state-of-the-art open-source and proprietary models highlight the limitations of current models in handling physics-related tasks. We hope that our dataset and evaluation methodology will jointly advance the development of LLMs in the field of physics. The code and data can be found at: https://github.com/Zhengsh123/PHYSICS.