BanglaByT5: Byte-Level Modelling for Bangla

作者: Pramit Bhattacharyya, Arnab Bhattacharya

分类: cs.CL

发布日期: 2025-05-21

💡 一句话要点

提出BanglaByT5,一种面向孟加拉语的字节级编码器-解码器模型,提升资源受限场景下的NLP性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 孟加拉语NLP 字节级建模 编码器-解码器模型 ByT5 形态丰富语言 预训练语言模型 资源受限环境

📋 核心要点

- 现有LLM的tokenizer(如BPE)难以捕捉孟加拉语等形态丰富语言的细微之处。

- BanglaByT5采用字节级建模,直接处理原始字节序列,无需复杂的tokenization过程。

- 实验表明,BanglaByT5在生成和分类任务中表现出色,超越了更大的多语言模型。

📝 摘要(中文)

大型语言模型(LLMs)在各种自然语言处理任务中取得了显著成功。然而,大多数LLM模型使用传统的tokenizer,如BPE和SentencePiece,这些tokenizer无法捕捉像孟加拉语这样形态丰富的语言的细微之处。本文介绍了BanglaByT5,这是第一个专门为孟加拉语量身定制的字节级编码器-解码器模型。BanglaByT5建立在Google的ByT5架构的一个小型变体之上,并在一个14GB的精选语料库上进行了预训练,该语料库结合了高质量的文学和新闻文章。通过生成和分类任务的零样本和监督评估,BanglaByT5展示了具有竞争力的性能,超过了几个多语言和更大的模型。我们的研究结果突出了字节级建模对于形态丰富语言的有效性,并强调了BanglaByT5作为孟加拉语NLP的轻量级但功能强大的工具的潜力,特别是在资源受限和可扩展的环境中。

🔬 方法详解

问题定义:现有的大型语言模型在处理孟加拉语等形态丰富的语言时,由于传统tokenizer(如BPE和SentencePiece)的局限性,无法充分捕捉语言的细微结构和语义信息。这导致模型在处理孟加拉语相关任务时性能下降,尤其是在资源受限的环境下,大型模型的部署和训练成本较高。

核心思路:BanglaByT5的核心思路是采用字节级建模,直接将原始字节序列作为模型的输入,避免了传统tokenizer带来的信息损失和复杂性。通过字节级建模,模型能够更好地学习孟加拉语的形态和语义特征,从而提高在各种NLP任务中的性能。

技术框架:BanglaByT5基于Google的ByT5架构,采用编码器-解码器结构。模型首先通过编码器将输入的字节序列转换为隐藏表示,然后解码器利用这些隐藏表示生成目标序列。模型在包含高质量文学和新闻文章的14GB孟加拉语语料库上进行预训练,以学习语言的通用特征。

关键创新:BanglaByT5的关键创新在于其字节级建模方法,这是第一个专门为孟加拉语设计的字节级编码器-解码器模型。与传统的基于token的模型相比,BanglaByT5能够更好地处理孟加拉语的形态复杂性,并且无需依赖复杂的tokenization过程。

关键设计:BanglaByT5使用了ByT5架构的一个小型变体,具体参数设置未知。模型采用标准的Transformer架构,并使用交叉熵损失函数进行训练。预训练语料库包含14GB的高质量孟加拉语文本,包括文学作品和新闻文章。具体网络结构和超参数设置在论文中可能未详细公开。

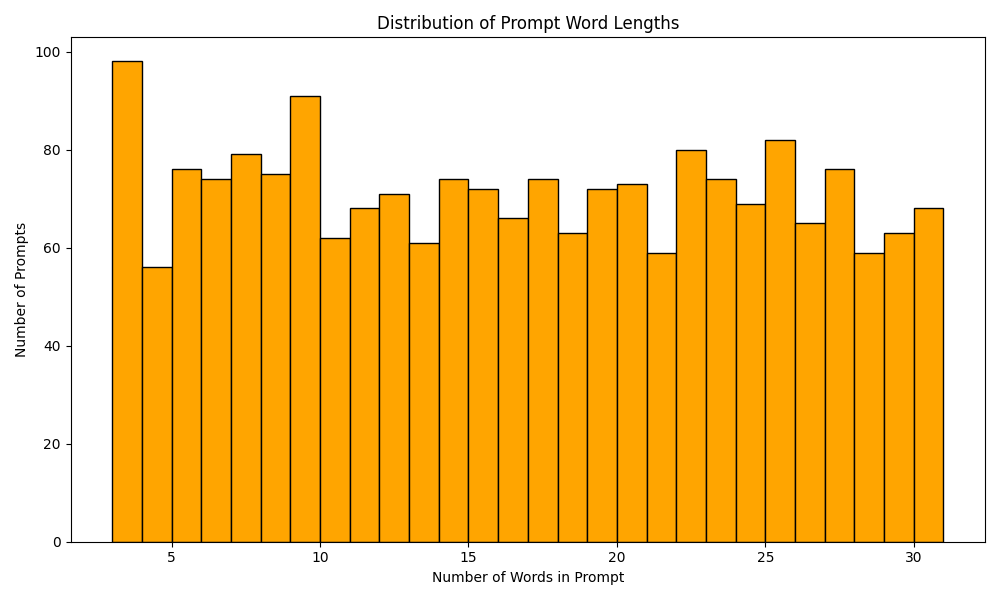

🖼️ 关键图片

📊 实验亮点

BanglaByT5在零样本和监督评估中表现出竞争力,超越了几个多语言和更大的模型。具体性能数据未知,但结果表明字节级建模对于形态丰富的孟加拉语是有效的。该模型为孟加拉语NLP提供了一个轻量级且强大的工具。

🎯 应用场景

BanglaByT5适用于各种孟加拉语NLP任务,如机器翻译、文本摘要、情感分析和问答系统。其轻量级特性使其特别适合资源受限的环境,例如移动设备或低成本服务器。该模型可以促进孟加拉语数字内容的发展,并为孟加拉语使用者提供更好的语言技术服务。

📄 摘要(原文)

Large language models (LLMs) have achieved remarkable success across various natural language processing tasks. However, most LLM models use traditional tokenizers like BPE and SentencePiece, which fail to capture the finer nuances of a morphologically rich language like Bangla (Bengali). In this work, we introduce BanglaByT5, the first byte-level encoder-decoder model explicitly tailored for Bangla. Built upon a small variant of Googles ByT5 architecture, BanglaByT5 is pre-trained on a 14GB curated corpus combining high-quality literary and newspaper articles. Through zeroshot and supervised evaluations across generative and classification tasks, BanglaByT5 demonstrates competitive performance, surpassing several multilingual and larger models. Our findings highlight the efficacy of byte-level modelling for morphologically rich languages and highlight BanglaByT5 potential as a lightweight yet powerful tool for Bangla NLP, particularly in both resource-constrained and scalable environments.