VerifyBench: Benchmarking Reference-based Reward Systems for Large Language Models

作者: Yuchen Yan, Jin Jiang, Zhenbang Ren, Yijun Li, Xudong Cai, Yang Liu, Xin Xu, Mengdi Zhang, Jian Shao, Yongliang Shen, Jun Xiao, Yueting Zhuang

分类: cs.CL, cs.AI

发布日期: 2025-05-21 (更新: 2025-09-25)

备注: Project Page: https://zju-real.github.io/VerifyBench Dataset: https://huggingface.co/datasets/ZJU-REAL/VerifyBench Code: https://github.com/ZJU-REAL/VerifyBench

💡 一句话要点

提出VerifyBench和VerifyBench-Hard,用于评估基于参考答案的大语言模型奖励系统。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 奖励系统 强化学习 基准测试 推理能力

📋 核心要点

- 现有奖励基准测试未能充分评估基于参考答案的奖励系统,限制了对验证器准确性的理解。

- 提出VerifyBench和VerifyBench-Hard,通过高质量的数据构建和人工标注,全面评估奖励系统。

- 实验表明,现有模型在所提出的基准测试上仍有提升空间,尤其是在小规模模型上。

📝 摘要(中文)

本文提出了VerifyBench和VerifyBench-Hard两个基准测试,旨在评估基于参考答案的奖励系统在大语言模型中的性能。现有奖励基准测试缺乏对此类系统的评估,限制了研究人员对强化学习中验证器准确性的理解。这两个基准测试通过细致的数据收集、整理和人工标注构建,以确保高质量。实验结果表明,当前模型在VerifyBench和VerifyBench-Hard上仍有很大的提升空间,尤其是小规模模型。此外,本文对评估结果进行了全面深入的分析,为理解和开发基于参考答案的奖励系统提供了见解。所提出的基准测试可有效指导验证器准确性的提升,并促进通过强化学习训练的模型在推理任务中的能力。

🔬 方法详解

问题定义:论文旨在解决现有奖励基准测试缺乏对基于参考答案的奖励系统进行有效评估的问题。现有方法无法准确衡量验证器在强化学习训练中的性能,阻碍了大语言模型推理能力的提升。现有方法的痛点在于缺乏高质量、多样化的数据集来评估验证器的准确性。

核心思路:论文的核心思路是构建高质量的基准测试集,包含精心收集和标注的数据,用于全面评估基于参考答案的奖励系统。通过分析模型在这些基准测试上的表现,可以深入了解验证器的优缺点,并指导其改进。这种方法旨在弥补现有基准测试的不足,为研究人员提供更有效的工具来开发和评估奖励系统。

技术框架:VerifyBench和VerifyBench-Hard的构建流程主要包括以下几个阶段:1) 数据收集:从各种来源收集推理任务相关的数据。2) 数据整理:对收集到的数据进行清洗和筛选,确保数据的质量和多样性。3) 人工标注:由专业标注人员对数据进行标注,提供参考答案和评估标准。4) 基准测试构建:将标注好的数据整理成基准测试集,并提供评估指标。

关键创新:论文的关键创新在于构建了专门用于评估基于参考答案的奖励系统的基准测试集。与现有基准测试相比,VerifyBench和VerifyBench-Hard更加关注验证器的准确性,并提供了更全面的评估指标。此外,论文还对评估结果进行了深入分析,为研究人员提供了有价值的见解。

关键设计:VerifyBench和VerifyBench-Hard包含不同难度的推理任务,以全面评估模型的性能。数据标注过程中,采用了多轮审核机制,确保标注质量。评估指标包括准确率、召回率、F1值等,用于衡量验证器的性能。具体的参数设置和网络结构取决于被评估的奖励系统,论文主要关注基准测试集的构建和评估方法。

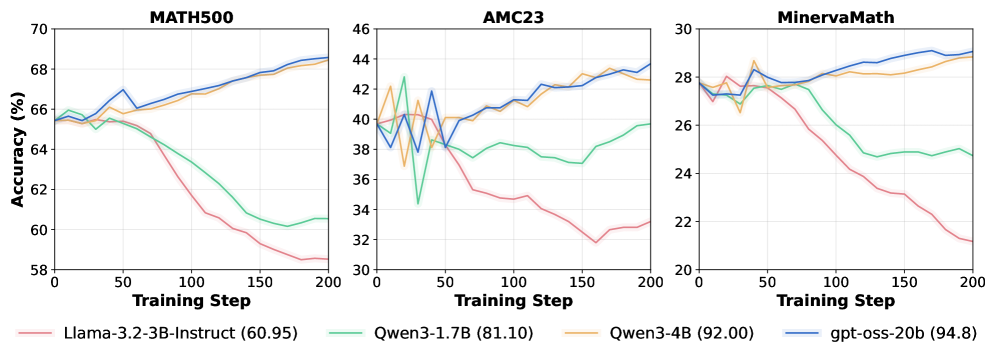

🖼️ 关键图片

📊 实验亮点

实验结果表明,当前模型在VerifyBench和VerifyBench-Hard上仍有很大的提升空间,尤其是在小规模模型上。这表明,基于参考答案的奖励系统仍有很大的发展潜力。通过对评估结果的深入分析,论文为研究人员提供了有价值的见解,有助于指导验证器准确性的提升和推理能力的增强。例如,分析表明,模型在处理复杂推理任务时,验证器的准确性会显著下降。

🎯 应用场景

该研究成果可广泛应用于大语言模型的训练和评估,尤其是在需要可验证推理能力的场景中,例如问答系统、代码生成、数学问题求解等。通过使用VerifyBench和VerifyBench-Hard,研究人员可以更有效地开发和评估奖励系统,从而提升模型的推理能力和可靠性。未来,该研究可以扩展到其他类型的任务和模型,并促进人工智能技术的进步。

📄 摘要(原文)

Large reasoning models such as OpenAI o1 and DeepSeek-R1 have achieved remarkable performance in the domain of reasoning. A key component of their training is the incorporation of verifiable rewards within reinforcement learning (RL). However, existing reward benchmarks do not evaluate reference-based reward systems, leaving researchers with limited understanding of the accuracy of verifiers used in RL. In this paper, we introduce two benchmarks, VerifyBench and VerifyBench-Hard, designed to assess the performance of reference-based reward systems. These benchmarks are constructed through meticulous data collection and curation, followed by careful human annotation to ensure high quality. Current models still show considerable room for improvement on both VerifyBench and VerifyBench-Hard, especially smaller-scale models. Furthermore, we conduct a thorough and comprehensive analysis of evaluation results, offering insights for understanding and developing reference-based reward systems. Our proposed benchmarks serve as effective tools for guiding the development of verifier accuracy and the reasoning capabilities of models trained via RL in reasoning tasks.