MIKU-PAL: An Automated and Standardized Multi-Modal Method for Speech Paralinguistic and Affect Labeling

作者: Yifan Cheng, Ruoyi Zhang, Jiatong Shi

分类: cs.SD, cs.CL, eess.AS

发布日期: 2025-05-21

备注: Accepted by Interspeech

期刊: Proc. of Interspeech2025

DOI: 10.21437/Interspeech.2025-648

💡 一句话要点

MIKU-PAL:一种自动、标准化的多模态语音副语言和情感标注方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感语音合成 多模态学习 自动标注 大型语言模型 情感分析 语音数据集 视觉语音克隆

📋 核心要点

- 情感语音数据获取面临一致性挑战,现有方法成本高、效率低。

- MIKU-PAL利用多模态大语言模型,实现自动情感分析和标注。

- 实验表明,该方法在准确率、一致性和效率上均优于人工标注。

📝 摘要(中文)

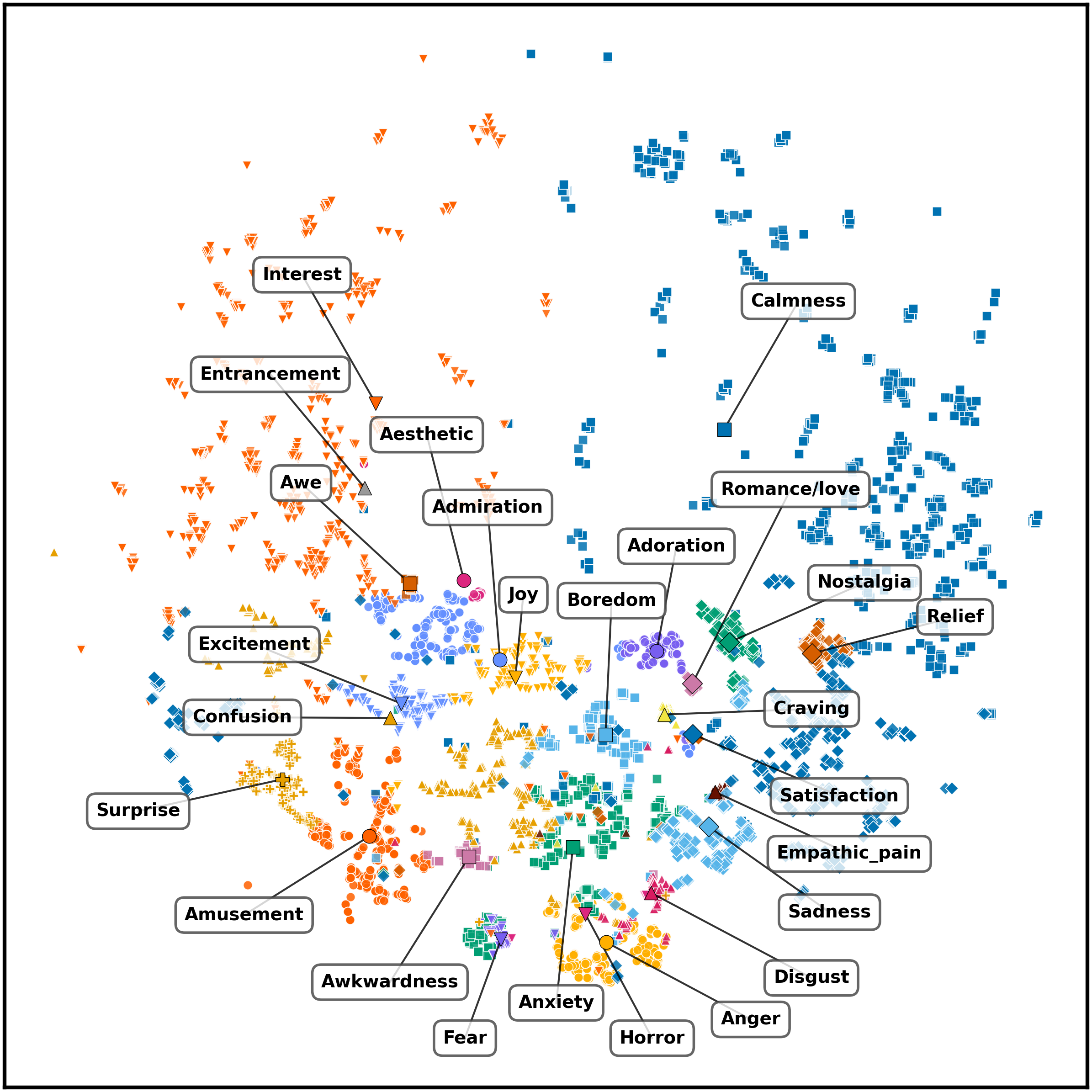

本文提出了一种全自动多模态流水线MIKU-PAL,用于从无标注视频数据中提取高一致性的情感语音,旨在解决语音合成领域获取大规模、高一致性情感语音数据的挑战。该方法利用人脸检测和跟踪算法,开发了一个基于多模态大型语言模型(MLLM)的自动情感分析系统。实验结果表明,MIKU-PAL能够达到人类水平的准确率(在MELD数据集上达到68.5%),并具有卓越的一致性(Fleiss Kappa系数为0.93),同时比人工标注更经济高效。凭借MIKU-PAL高质量、灵活和一致的标注,我们可以标注多达26种细粒度的语音情感类别,并通过人工标注验证,合理性评分达到83%。基于该系统,我们进一步发布了一个细粒度的情感语音数据集MIKU-EmoBench(131.2小时),作为情感文本到语音和视觉语音克隆的新基准。

🔬 方法详解

问题定义:论文旨在解决情感语音合成领域中,大规模、高一致性情感语音数据难以获取的问题。现有的人工标注方法成本高昂、耗时,且不同标注者之间可能存在主观差异,导致数据一致性较差。这限制了情感语音合成模型的效果和泛化能力。

核心思路:论文的核心思路是利用多模态信息(面部表情和语音)以及大型语言模型(MLLM)的强大理解能力,构建一个全自动的标注流水线。通过结合视觉和听觉信息,可以更准确地推断情感状态,从而提高标注的准确性和一致性。自动化流程可以显著降低成本和时间。

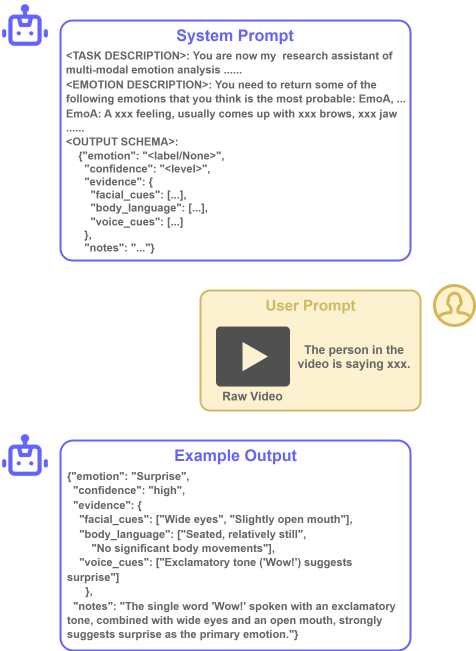

技术框架:MIKU-PAL的整体框架包含以下几个主要模块:1) 人脸检测与跟踪:使用算法自动检测和跟踪视频中的人脸。2) 多模态情感分析:利用MLLM分析人脸表情和语音信息,预测情感类别。3) 标注生成:根据情感分析结果,自动为语音数据生成情感标签。4) 数据集构建:将标注后的语音数据整理成数据集。

关键创新:该方法最关键的创新在于将多模态大语言模型应用于情感语音标注任务,并构建了一个全自动化的标注流水线。与传统的基于人工标注或简单规则的方法相比,MIKU-PAL能够更准确、更高效地标注情感,并保证数据的一致性。

关键设计:论文中没有详细说明具体的参数设置、损失函数和网络结构等技术细节。但是,可以推断MLLM的选择和训练方式,以及多模态信息融合的方式,是影响系统性能的关键因素。此外,人脸检测和跟踪算法的精度也会直接影响情感分析的准确性。具体的技术细节有待进一步研究。

🖼️ 关键图片

📊 实验亮点

MIKU-PAL在MELD数据集上达到了68.5%的人类水平准确率,并且具有0.93的Fleiss Kappa一致性评分,显著优于人工标注。该方法能够标注多达26种细粒度的语音情感类别,人工标注验证的合理性评分达到83%。基于该系统构建的MIKU-EmoBench数据集包含131.2小时的细粒度情感语音数据,为情感文本到语音和视觉语音克隆提供了一个新的基准。

🎯 应用场景

该研究成果可广泛应用于情感语音合成、语音情感识别、虚拟助手、情感计算等领域。高质量的情感语音数据集能够提升语音合成系统的表现力,使其能够生成更自然、更富有情感的语音。此外,该方法还可以用于分析用户的情感状态,为个性化服务和情感支持提供依据。未来,该技术有望应用于智能客服、在线教育、心理咨询等场景。

📄 摘要(原文)

Acquiring large-scale emotional speech data with strong consistency remains a challenge for speech synthesis. This paper presents MIKU-PAL, a fully automated multimodal pipeline for extracting high-consistency emotional speech from unlabeled video data. Leveraging face detection and tracking algorithms, we developed an automatic emotion analysis system using a multimodal large language model (MLLM). Our results demonstrate that MIKU-PAL can achieve human-level accuracy (68.5% on MELD) and superior consistency (0.93 Fleiss kappa score) while being much cheaper and faster than human annotation. With the high-quality, flexible, and consistent annotation from MIKU-PAL, we can annotate fine-grained speech emotion categories of up to 26 types, validated by human annotators with 83% rationality ratings. Based on our proposed system, we further released a fine-grained emotional speech dataset MIKU-EmoBench(131.2 hours) as a new benchmark for emotional text-to-speech and visual voice cloning.