Enhancing Large Language Models for Detecting Mental Manipulation via Annotation-Free Data Augmentation and Anti-Curriculum Distillation

作者: Yuansheng Gao, Han Bao, Tong Zhang, Bin Li, Jixiang Luo, Ronghao Chen, Zonghui Wang, Wenzhi Chen

分类: cs.CL

发布日期: 2025-05-21 (更新: 2025-11-26)

备注: Preprint

💡 一句话要点

提出MentalMAC框架,通过无标注数据增强和反课程蒸馏提升大语言模型对精神操控的检测能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 精神操控检测 大型语言模型 无标注数据增强 反课程蒸馏 多任务学习 心理健康 对话系统

📋 核心要点

- 现有方法难以有效检测精神操控,主要由于训练数据匮乏、操控行为隐蔽以及缺乏真实场景数据集。

- MentalMAC框架利用EvoSA进行无标注数据增强,结合教师模型多任务监督和反课程蒸馏,提升模型检测能力。

- 实验结果表明,MentalMAC在F1mac和准确率上显著优于现有基线模型,包括GPT-4和Claude-3.5-Sonnet。

📝 摘要(中文)

精神操控是一种隐蔽但普遍存在的心理虐待形式,对心理健康构成严重威胁。然而,检测精神操控仍然是一个很大程度上未被探索的研究问题。该领域面临三个主要挑战:(i) 训练数据不足且难以获取;(ii) 精神操控的隐蔽性,阻碍了检测;(iii) 缺乏真实世界的数据集。为了应对这些挑战,我们提出了MentalMAC,一种新颖的框架,旨在增强大型语言模型在多轮对话中检测精神操控元素的能力。我们的方法包括三个关键组成部分:EvoSA,一种基于进化操作和言语行为理论的无标注数据增强方法;教师模型生成的多任务监督;以及渐进式任务级别反课程蒸馏。我们还构建了ReaMent数据集,包含5,000个真实世界对话样本,并利用MentalMAC蒸馏模型辅助人工标注。大量实验表明,MentalMAC在F1mac指标上实现了高达25.9%的改进,在准确率上实现了8.1%的改进,优于GPT-4和Claude-3.5-Sonnet等商业LLM。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在检测多轮对话中的精神操控行为时面临的挑战。现有方法受限于训练数据不足、精神操控的隐蔽性以及缺乏真实世界数据集,导致检测精度不高。

核心思路:论文的核心思路是通过无标注数据增强和反课程蒸馏来提升模型的检测能力。无标注数据增强解决了数据匮乏的问题,反课程蒸馏则帮助模型从更难的样本中学习,从而更好地识别隐蔽的精神操控行为。

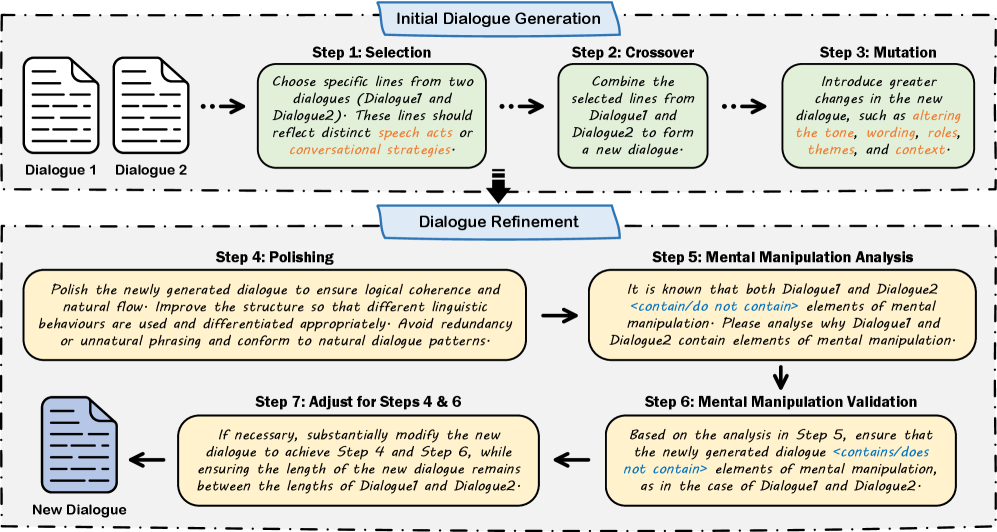

技术框架:MentalMAC框架包含三个主要模块:1) EvoSA:基于进化操作和言语行为理论的无标注数据增强模块,用于生成更多样化的训练数据。2) 教师模型多任务监督:利用教师模型生成多任务监督信号,指导学生模型学习。3) 渐进式任务级别反课程蒸馏:从更难的样本开始训练,逐步提升模型的泛化能力。

关键创新:论文的关键创新在于EvoSA无标注数据增强方法和反课程蒸馏策略。EvoSA能够有效地生成高质量的训练数据,而反课程蒸馏则能够帮助模型更好地学习精神操控的细微特征。与现有方法相比,MentalMAC无需人工标注数据,并且能够更好地应对精神操控的隐蔽性。

关键设计:EvoSA模块使用进化算法来生成新的对话样本,并结合言语行为理论来保证生成样本的合理性。反课程蒸馏模块则根据样本的难度动态调整训练顺序,并使用多任务学习来提升模型的泛化能力。具体的损失函数和网络结构等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

MentalMAC在ReaMent数据集上进行了评估,实验结果表明,MentalMAC在F1mac指标上实现了高达25.9%的改进,在准确率上实现了8.1%的改进,显著优于现有基线模型,包括GPT-4和Claude-3.5-Sonnet等商业LLM。这些结果表明MentalMAC在检测精神操控方面具有显著优势。

🎯 应用场景

该研究成果可应用于心理健康咨询、社交媒体内容审核、智能客服等领域,帮助识别和预防精神操控行为,保护用户心理健康。未来,该技术可进一步扩展到其他类型的心理虐待检测,并与心理健康干预系统相结合,提供更全面的心理健康服务。

📄 摘要(原文)

Mental manipulation is a subtle yet pervasive form of psychological abuse that poses serious threats to mental health. Nevertheless, detecting mental manipulation remains a largely underexplored research problem. The field faces three major challenges: (i) insufficient and hard-to-obtain training data; (ii) the covert nature of mental manipulation, which hinders detection; and (iii) the lack of real-world datasets. To address these challenges, we propose MentalMAC, a novel framework that enhances large language models' ability to detect elements of mental manipulation in multi-turn dialogue. Our approach consists of three key components: EvoSA, an annotation-free data augmentation method based on evolutionary operations and speech act theory; teacher-model-generated multi-task supervision; and progressive task-level anti-curriculum distillation. We then constructed the ReaMent dataset, comprising 5,000 real-world dialogue samples, utilizing MentalMAC-distilled models to aid in human annotation. Vast experiments show that MentalMAC achieves up to 25.9% improvement in F1mac and 8.1% in accuracy over the best-performing baseline, outperforming commercial LLMs such as GPT-4 and Claude-3.5-Sonnet. Warning: This paper contains content that may be offensive to the reader.