Development and Validation of Engagement and Rapport Scales for Evaluating User Experience in Multimodal Dialogue Systems

作者: Fuma Kurata, Mao Saeki, Masaki Eguchi, Shungo Suzuki, Hiroaki Takatsu, Yoichi Matsuyama

分类: cs.CL, cs.AI

发布日期: 2025-05-20

期刊: Proceedings of the 14th International Workshop on Spoken Dialogue Systems Technology, Hokkaido, Japan, 2024

💡 一句话要点

为多模态对话系统用户体验评估,开发并验证了交互投入度和亲和度量表

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态对话系统 用户体验评估 交互投入度 亲和度 量表开发 外语学习 人机交互

📋 核心要点

- 现有方法缺乏针对多模态对话系统用户体验中交互投入度和亲和度的有效评估工具。

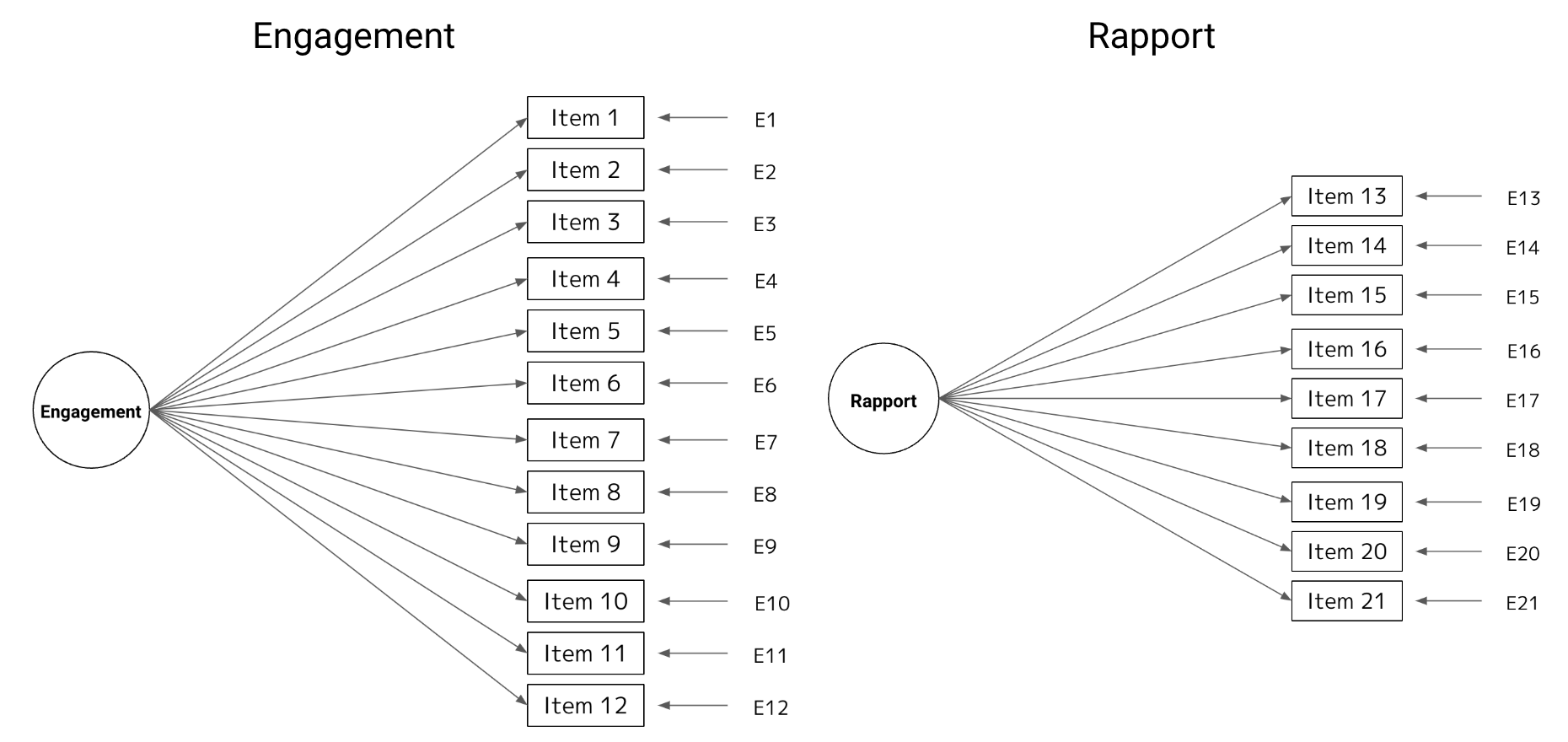

- 本研究基于心理学理论设计了交互投入度和亲和度量表,用于评估用户与多模态对话系统的互动体验。

- 实验结果表明,该量表能够有效区分与人类导师和对话智能体交互时用户体验的差异。

📝 摘要(中文)

本研究旨在开发和验证交互投入度(engagement)和亲和度(rapport)两个量表,用于评估多模态对话系统中用户体验的质量,尤其是在外语学习的场景下。这些量表的设计基于教育心理学、社会心理学和第二语言习得理论。七十四名日语英语学习者与经过训练的人类导师和一个对话智能体完成了角色扮演和讨论任务。在每次对话任务完成后,他们对交互投入度和亲和度量表进行反馈。通过两项分析,研究人员考察了量表的有效性和可靠性。首先,进行了Cronbach's alpha系数分析和一系列验证性因素分析,以检验量表的结构效度和设计项目的可靠性。然后,比较了与人类导师对话和与对话智能体对话时,交互投入度和亲和度的得分。结果表明,该量表成功地从多个角度捕捉到了人类对话者和对话智能体之间对话体验质量的差异。

🔬 方法详解

问题定义:论文旨在解决多模态对话系统中用户体验评估的问题,特别是缺乏量化的交互投入度和亲和度评估工具。现有方法难以准确衡量用户在与对话系统交互时的情感和认知状态,从而影响了对话系统的优化和改进。

核心思路:论文的核心思路是借鉴教育心理学、社会心理学和第二语言习得理论,构建一套可量化的交互投入度和亲和度量表。通过用户对量表中问题的反馈,可以评估用户在与多模态对话系统交互时的体验质量。这样设计的目的是为了更全面、客观地了解用户与对话系统的互动情况。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 基于理论基础设计交互投入度和亲和度量表;2) 招募日语英语学习者作为实验对象;3) 让实验对象分别与人类导师和对话智能体进行角色扮演和讨论任务;4) 实验对象在每次任务后填写量表;5) 对量表数据进行统计分析,包括Cronbach's alpha系数分析和验证性因素分析,以检验量表的有效性和可靠性;6) 比较与人类导师和对话智能体交互时,交互投入度和亲和度的得分差异。

关键创新:该研究的关键创新在于将心理学理论应用于多模态对话系统的用户体验评估,并开发了相应的量化评估工具。与传统的用户满意度调查等方法相比,该量表能够更深入地了解用户在交互过程中的情感和认知状态,从而为对话系统的改进提供更有效的指导。

关键设计:量表的设计基于教育心理学、社会心理学和第二语言习得理论,具体问题设计未知。实验中,采用了角色扮演和讨论任务,以模拟真实的外语学习场景。统计分析方面,使用了Cronbach's alpha系数分析和验证性因素分析,以检验量表的信度和效度。具体的参数设置、损失函数、网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

研究结果表明,所开发的交互投入度和亲和度量表能够有效区分与人类导师和对话智能体交互时用户体验的差异。通过Cronbach's alpha系数分析和验证性因素分析,验证了量表的结构效度和设计项目的可靠性。该量表为多模态对话系统的用户体验评估提供了一种有效的工具。

🎯 应用场景

该研究成果可应用于各种多模态对话系统,例如外语学习App、智能客服、虚拟助手等。通过使用该量表评估用户体验,可以帮助开发者更好地了解用户的需求和痛点,从而改进对话系统的设计,提高用户满意度和学习效果。未来,该量表还可以扩展到其他领域,例如人机协作、心理咨询等。

📄 摘要(原文)

This study aimed to develop and validate two scales of engagement and rapport to evaluate the user experience quality with multimodal dialogue systems in the context of foreign language learning. The scales were designed based on theories of engagement in educational psychology, social psychology, and second language acquisition.Seventy-four Japanese learners of English completed roleplay and discussion tasks with trained human tutors and a dialog agent. After each dialogic task was completed, they responded to the scales of engagement and rapport. The validity and reliability of the scales were investigated through two analyses. We first conducted analysis of Cronbach's alpha coefficient and a series of confirmatory factor analyses to test the structural validity of the scales and the reliability of our designed items. We then compared the scores of engagement and rapport between the dialogue with human tutors and the one with a dialogue agent. The results revealed that our scales succeeded in capturing the difference in the dialogue experience quality between the human interlocutors and the dialogue agent from multiple perspectives.