Mind the Gap: Bridging Thought Leap for Improved Chain-of-Thought Tuning

作者: Haolei Xu, Yuchen Yan, Yongliang Shen, Wenqi Zhang, Guiyang Hou, Shengpei Jiang, Kaitao Song, Weiming Lu, Jun Xiao, Yueting Zhuang

分类: cs.CL, cs.AI

发布日期: 2025-05-20 (更新: 2025-11-27)

备注: Accepted to NeurIPS 2025. Camera ready version. Code: https://github.com/ZJU-REAL/Mind-the-Gap Project: https://zju-real.github.io/CoT-Bridge/

💡 一句话要点

提出CoT-Bridge以弥补思维链推理中的“跳跃”问题,提升模型性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 思维链推理 CoT 思维跳跃 数据增强 数学推理 语言模型微调 知识推理 数据集构建

📋 核心要点

- 现有CoT数据集存在思维跳跃,专家省略中间步骤影响模型学习和泛化。

- 提出CoT-Bridge任务,自动检测并生成缺失的中间推理步骤,恢复CoT的完整性。

- 实验表明,在桥接数据集上微调的模型性能显著提升,且具有更好的泛化能力。

📝 摘要(中文)

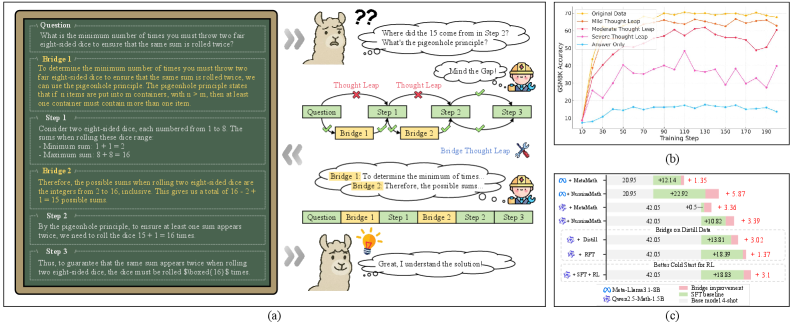

大型语言模型(LLMs)通过思维链(CoT)推理在数学任务上取得了显著进展。然而,现有的数学CoT数据集常常由于专家省略中间步骤而存在思维跳跃,这会对模型的学习和泛化产生负面影响。我们提出了CoT思维跳跃桥接任务,旨在自动检测跳跃并生成缺失的中间推理步骤,以恢复CoT的完整性和连贯性。为了实现这一目标,我们基于结构化的ScaleQuestMath数据集构建了一个专门的训练数据集ScaleQM+,并训练了CoT-Bridge来桥接思维跳跃。通过在数学推理基准上的全面实验,我们证明了在桥接数据集上微调的模型始终优于在原始数据集上训练的模型,在NuminaMath上提升高达+5.87%。我们的方法有效地增强了蒸馏数据(+3.02%),并为强化学习提供了更好的起点(+3.1%),作为一个即插即用模块,与现有的优化技术兼容。此外,CoT-Bridge展示了对领域外逻辑推理任务的改进泛化,证实了增强推理完整性会产生广泛适用的好处。

🔬 方法详解

问题定义:论文旨在解决现有思维链(CoT)数据集中存在的“思维跳跃”问题。在构建CoT数据集时,专家可能会省略一些中间推理步骤,导致模型难以学习到完整的推理过程,从而影响其在数学问题上的表现和泛化能力。现有方法没有有效地解决CoT数据集中推理步骤不完整的问题。

核心思路:论文的核心思路是训练一个CoT-Bridge模型,该模型能够自动检测CoT推理过程中的跳跃,并生成缺失的中间推理步骤,从而补全CoT的推理链。通过在补全后的数据集上训练模型,可以提高模型学习到完整推理过程的能力,从而提升其性能和泛化能力。

技术框架:整体框架包含以下几个主要步骤:1) 构建包含思维跳跃的原始CoT数据集;2) 训练CoT-Bridge模型,使其能够检测跳跃并生成缺失的中间步骤;3) 使用CoT-Bridge模型补全原始CoT数据集,生成桥接后的数据集;4) 在桥接后的数据集上微调大型语言模型;5) 在数学推理基准上评估微调后的模型性能。

关键创新:论文的关键创新在于提出了CoT-Bridge任务和相应的CoT-Bridge模型,能够自动地补全CoT推理链中的缺失步骤。与现有方法相比,CoT-Bridge能够更有效地解决CoT数据集中推理步骤不完整的问题,从而提升模型的性能和泛化能力。此外,该方法具有即插即用的特性,可以与现有的优化技术相结合。

关键设计:论文构建了一个名为ScaleQM+的专门训练数据集,该数据集基于ScaleQuestMath数据集,并针对CoT-Bridge任务进行了优化。CoT-Bridge模型的具体结构和训练细节未知,但可以推断其可能采用了序列到序列(sequence-to-sequence)的架构,并使用交叉熵损失函数进行训练。论文还提到CoT-Bridge可以作为强化学习的良好起点,暗示其输出可以作为奖励信号的一部分。

🖼️ 关键图片

📊 实验亮点

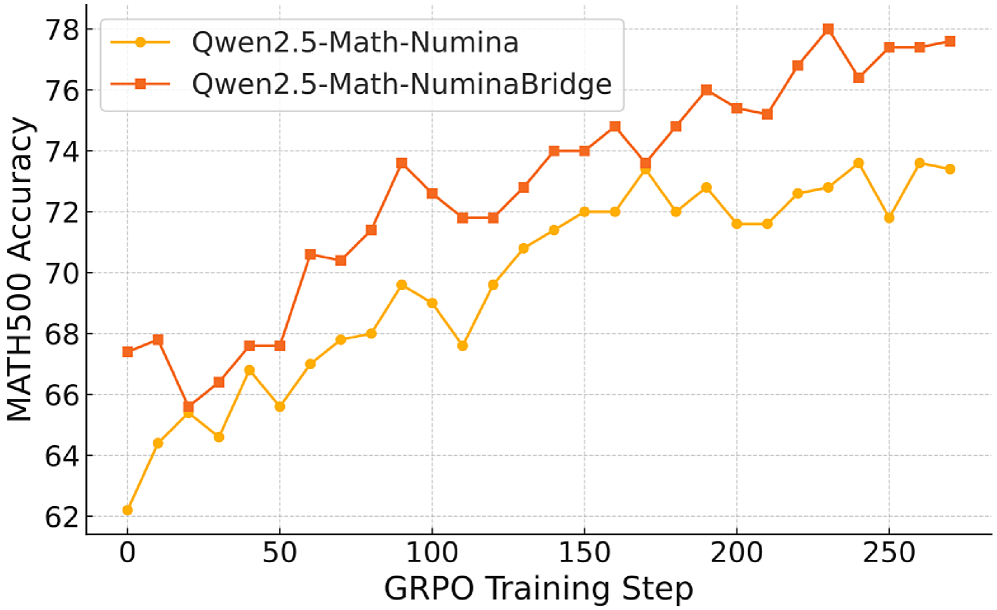

实验结果表明,在桥接数据集上微调的模型在数学推理基准上取得了显著的性能提升,例如在NuminaMath上提升了高达+5.87%。此外,该方法还能够有效地增强蒸馏数据(+3.02%),并为强化学习提供更好的起点(+3.1%)。CoT-Bridge还展示了对领域外逻辑推理任务的改进泛化能力。

🎯 应用场景

该研究成果可应用于各种需要复杂推理的任务,例如数学问题求解、逻辑推理、代码生成等。通过补全推理链,可以提高模型在这些任务上的准确性和可靠性。此外,该方法还可以用于改进现有的CoT数据集,使其更加完整和连贯,从而促进相关领域的研究进展。

📄 摘要(原文)

Large language models (LLMs) have achieved remarkable progress on mathematical tasks through Chain-of-Thought (CoT) reasoning. However, existing mathematical CoT datasets often suffer from Thought Leaps due to experts omitting intermediate steps, which negatively impacts model learning and generalization. We propose the CoT Thought Leap Bridge Task, which aims to automatically detect leaps and generate missing intermediate reasoning steps to restore the completeness and coherence of CoT. To facilitate this, we constructed a specialized training dataset called ScaleQM+, based on the structured ScaleQuestMath dataset, and trained CoT-Bridge to bridge thought leaps. Through comprehensive experiments on mathematical reasoning benchmarks, we demonstrate that models fine-tuned on bridged datasets consistently outperform those trained on original datasets, with improvements of up to +5.87% on NuminaMath. Our approach effectively enhances distilled data (+3.02%) and provides better starting points for reinforcement learning (+3.1%), functioning as a plug-and-play module compatible with existing optimization techniques. Furthermore, CoT-Bridge demonstrate improved generalization to out-of-domain logical reasoning tasks, confirming that enhancing reasoning completeness yields broadly applicable benefits.