MoMoE: Mixture of Moderation Experts Framework for AI-Assisted Online Governance

作者: Agam Goyal, Xianyang Zhan, Yilun Chen, Koustuv Saha, Eshwar Chandrasekharan

分类: cs.CL

发布日期: 2025-05-20 (更新: 2025-10-23)

备注: EMNLP 2025 (Oral)

💡 一句话要点

提出MoMoE框架,用于可解释、跨社区的AI辅助在线内容审核。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 内容审核 混合专家模型 可解释性AI 在线社区治理 自然语言处理

📋 核心要点

- 现有在线内容审核方法需为每个社区单独训练模型,决策过程不透明,限制了实际应用。

- MoMoE框架通过模块化的专家集成,实现跨社区的内容审核,并提供事后解释,提升透明度。

- 实验表明,MoMoE在未见过的subreddit上表现出色,匹配或超过微调基线,并提供可靠解释。

📝 摘要(中文)

大型语言模型(LLMs)在识别在线社区中的有害内容方面展现出巨大潜力。然而,现有的审核方法通常需要为每个社区单独训练模型,并且决策过程不透明,限制了实际应用。本文提出了混合审核专家(MoMoE)框架,这是一个模块化、跨社区的框架,能够为可扩展的内容审核添加事后解释。MoMoE协调四个操作器——分配(Allocate)、预测(Predict)、聚合(Aggregate)和解释(Explain),并实例化为七个社区专业专家(MoMoE-Community)和五个规范违规专家(MoMoE-NormVio)。在30个未见过的subreddit上,最佳变体的Micro-F1分数分别达到0.72和0.67,匹配或超过了强大的微调基线,同时始终产生简洁可靠的解释。虽然社区专业专家提供了最高的峰值准确率,但规范违规专家在各个领域提供了更稳定的性能。这些发现表明,MoMoE无需针对每个社区进行微调即可实现可扩展、透明的审核。更广泛地说,它们表明轻量级、可解释的专家集成可以指导未来关于在线社区可信赖的人工智能治理的NLP和HCI研究。

🔬 方法详解

问题定义:论文旨在解决现有在线内容审核方法的局限性,即需要为每个社区单独训练模型,且决策过程缺乏透明度。这种方式不仅成本高昂,难以扩展,而且由于缺乏可解释性,用户难以信任审核结果。

核心思路:论文的核心思路是利用混合专家模型(Mixture of Experts, MoE)的思想,构建一个模块化的、跨社区的内容审核框架。该框架通过集成多个专家模型,每个专家模型专注于不同的社区或规范违规类型,从而实现更高效、更通用的内容审核。同时,框架设计了事后解释机制,为每个审核决策提供可解释的理由。

技术框架:MoMoE框架包含四个主要操作器:Allocate(分配)、Predict(预测)、Aggregate(聚合)和 Explain(解释)。Allocate操作器负责将输入内容分配给不同的专家模型;Predict操作器利用专家模型对内容进行预测,判断其是否违反社区规范;Aggregate操作器将不同专家模型的预测结果进行聚合,得到最终的审核结果;Explain操作器则为审核结果生成事后解释。框架实例化为两类专家:MoMoE-Community(社区专业专家)和 MoMoE-NormVio(规范违规专家)。

关键创新:MoMoE的关键创新在于其模块化和可解释性。通过模块化的专家集成,MoMoE能够实现跨社区的内容审核,而无需为每个社区单独训练模型。同时,事后解释机制使得审核决策更加透明,用户可以了解审核的原因。与现有方法相比,MoMoE在可扩展性和可解释性方面具有显著优势。

关键设计:Allocate操作器可以使用不同的路由策略,例如基于社区ID的硬路由或基于内容特征的软路由。Predict操作器可以使用各种预训练语言模型,例如BERT或RoBERTa。Aggregate操作器可以使用不同的聚合函数,例如加权平均或投票。Explain操作器可以使用各种解释方法,例如LIME或SHAP。论文中具体使用的参数设置和网络结构在正文中进行了详细描述,此处未知。

🖼️ 关键图片

📊 实验亮点

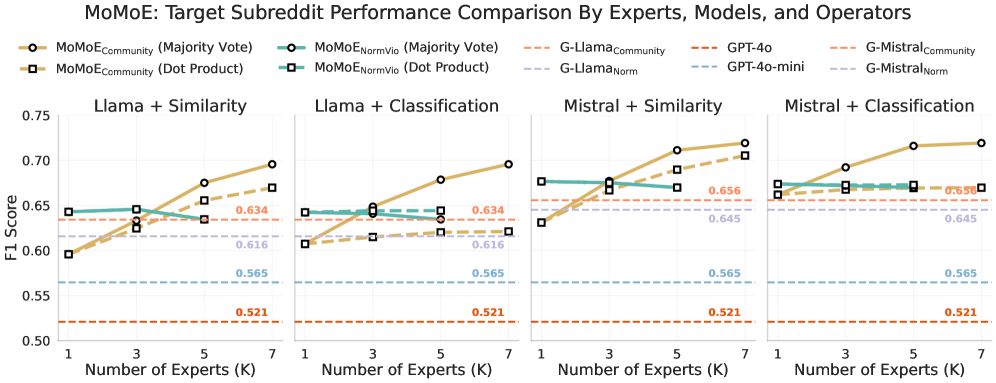

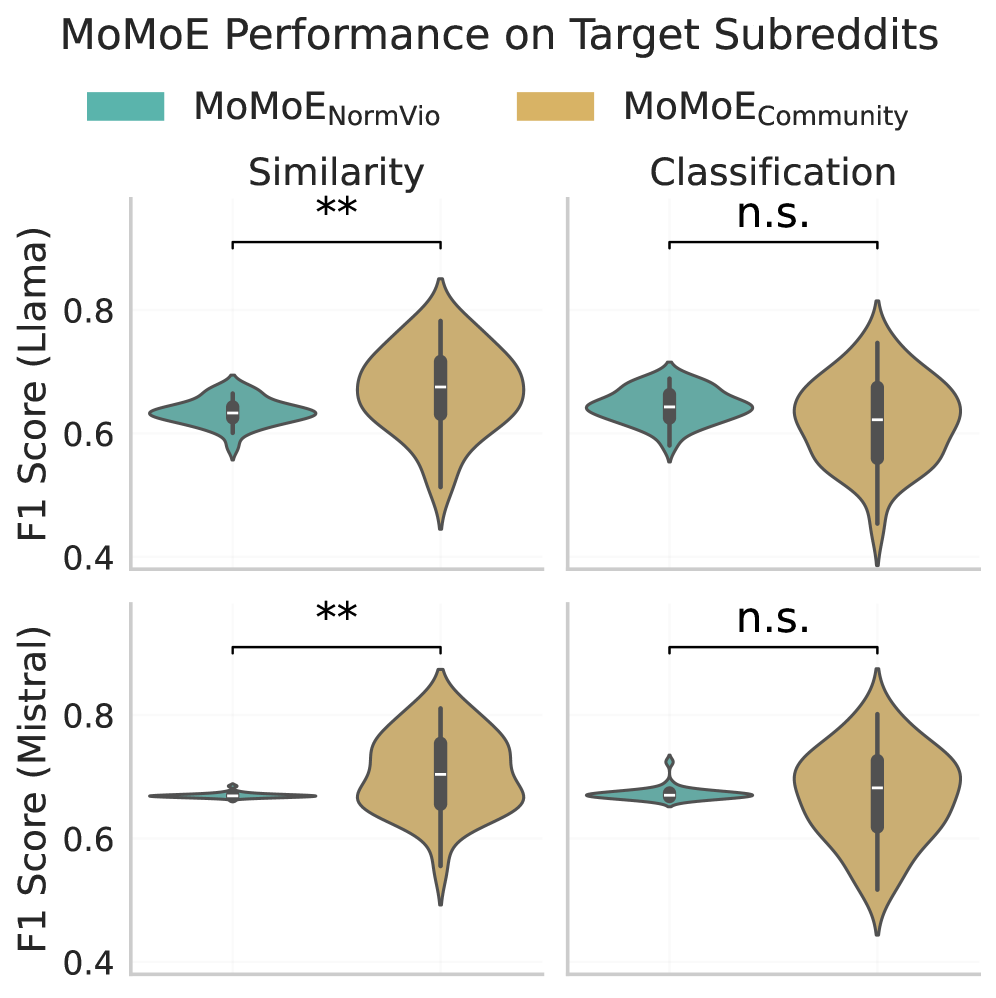

在30个未见过的subreddit上,MoMoE的最佳变体取得了显著的成果,Micro-F1分数分别达到了0.72(MoMoE-Community)和0.67(MoMoE-NormVio)。这些结果与经过微调的强大基线模型相匹配甚至超过了它们,同时MoMoE还能持续生成简洁且可靠的解释,显著提升了内容审核的透明度。

🎯 应用场景

MoMoE框架可应用于各种在线社区和社交平台的内容审核,帮助平台更高效、更透明地管理用户生成的内容。该框架能够降低审核成本,提高审核效率,并增强用户对审核结果的信任度。此外,MoMoE框架还可以用于教育和培训,帮助用户了解社区规范和内容审核标准,从而促进更健康的网络环境。

📄 摘要(原文)

Large language models (LLMs) have shown great potential in flagging harmful content in online communities. Yet, existing approaches for moderation require a separate model for every community and are opaque in their decision-making, limiting real-world adoption. We introduce Mixture of Moderation Experts (MoMoE), a modular, cross-community framework that adds post-hoc explanations to scalable content moderation. MoMoE orchestrates four operators -- Allocate, Predict, Aggregate, Explain -- and is instantiated as seven community-specialized experts (MoMoE-Community) and five norm-violation experts (MoMoE-NormVio). On 30 unseen subreddits, the best variants obtain Micro-F1 scores of 0.72 and 0.67, respectively, matching or surpassing strong fine-tuned baselines while consistently producing concise and reliable explanations. Although community-specialized experts deliver the highest peak accuracy, norm-violation experts provide steadier performance across domains. These findings show that MoMoE yields scalable, transparent moderation without needing per-community fine-tuning. More broadly, they suggest that lightweight, explainable expert ensembles can guide future NLP and HCI research on trustworthy human-AI governance of online communities.