Pierce the Mists, Greet the Sky: Decipher Knowledge Overshadowing via Knowledge Circuit Analysis

作者: Haoming Huang, Yibo Yan, Jiahao Huo, Xin Zou, Xinfeng Li, Kun Wang, Xuming Hu

分类: cs.CL

发布日期: 2025-05-20 (更新: 2025-09-09)

备注: Accepted by 2025 EMNLP Main

💡 一句话要点

提出PhantomCircuit框架,通过知识电路分析解决LLM中的知识遮蔽问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 知识遮蔽 幻觉问题 知识电路分析 注意力机制

📋 核心要点

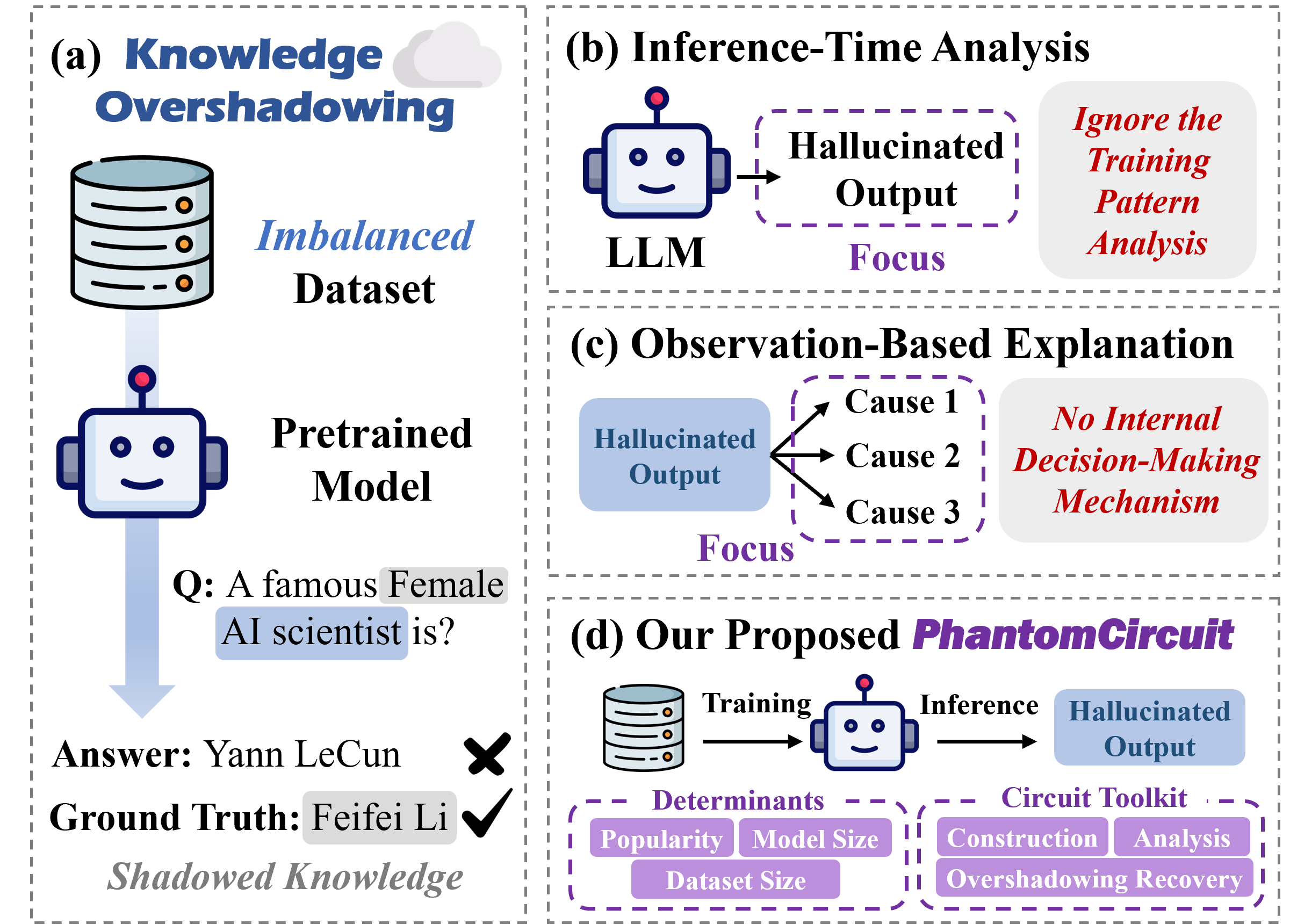

- 现有方法对LLM知识遮蔽现象的理解不足,主要集中在推理阶段的观察,缺乏对训练过程内部机制的深入分析。

- 论文提出PhantomCircuit框架,通过知识电路分析,剖析模型内部关键组件的功能和注意力模式动态,从而检测和分析知识遮蔽现象。

- 实验结果表明,PhantomCircuit能够有效识别知识遮蔽的实例,为研究人员提供了新的视角和方法来缓解LLM的幻觉问题。

📝 摘要(中文)

大型语言模型(LLMs)虽然表现出卓越的能力,但仍受到幻觉问题的困扰。知识遮蔽是一种特别具有挑战性的变体,当一个被激活的知识片段无意中掩盖了另一个相关的知识片段时,即使使用高质量的训练数据也会导致错误的输出。目前对知识遮蔽的理解主要局限于推理时的观察,缺乏对其起源和模型训练过程中内部机制的深入了解。因此,我们引入了PhantomCircuit,这是一个旨在全面分析和检测知识遮蔽的新框架。通过创新性地采用知识电路分析,PhantomCircuit剖析了电路中关键组件的功能,以及注意力模式动态如何促成遮蔽现象及其在整个训练过程中的演变。大量的实验证明了PhantomCircuit在识别此类实例方面的有效性,为这种难以捉摸的幻觉提供了新的见解,并为研究界提供了一种新的方法论视角,以潜在地缓解它。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)中知识遮蔽(knowledge overshadowing)的问题。知识遮蔽是指模型在生成答案时,由于某些知识片段的激活,错误地抑制或掩盖了其他相关知识片段,导致生成错误或不准确的答案。现有方法主要关注推理阶段的现象观察,缺乏对知识遮蔽在训练过程中产生和演化的深入理解,难以有效缓解该问题。

核心思路:论文的核心思路是利用知识电路分析(knowledge circuit analysis)的方法,将LLM内部的知识表示和处理过程视为一个复杂的电路,通过分析电路中各个组件的功能和连接关系,以及注意力模式的动态变化,来理解知识遮蔽的产生机制和演化过程。这种方法能够深入挖掘模型内部的知识表示和交互方式,从而为缓解知识遮蔽问题提供理论基础。

技术框架:PhantomCircuit框架主要包含以下几个阶段:1) 知识激活:确定与特定问题相关的知识片段在模型中的激活状态。2) 电路构建:构建表示知识片段之间连接和交互的知识电路。3) 注意力分析:分析注意力模式在知识电路中的动态变化,识别导致知识遮蔽的关键节点和路径。4) 遮蔽检测:基于电路分析和注意力模式,检测知识遮蔽的实例。5) 演化分析:跟踪知识遮蔽现象在训练过程中的演化过程,分析其产生的原因和影响。

关键创新:论文最重要的技术创新点在于将知识电路分析应用于LLM的知识遮蔽问题。通过构建和分析知识电路,能够更深入地理解模型内部的知识表示和交互方式,从而揭示知识遮蔽的产生机制。与现有方法相比,PhantomCircuit不仅关注推理阶段的现象,更关注训练过程中的演化,为缓解知识遮蔽问题提供了新的视角。

关键设计:PhantomCircuit的关键设计包括:1) 如何构建有效的知识电路,准确表示知识片段之间的连接和交互关系。2) 如何设计注意力分析方法,能够准确捕捉注意力模式的动态变化,识别导致知识遮蔽的关键节点和路径。3) 如何定义知识遮蔽的指标,能够准确评估知识遮蔽的程度和影响。4) 如何设计实验,验证PhantomCircuit的有效性,并分析知识遮蔽的产生原因和影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PhantomCircuit能够有效识别LLM中的知识遮蔽实例,并揭示其在训练过程中的演化规律。通过分析知识电路和注意力模式,可以发现导致知识遮蔽的关键节点和路径。这些发现为研究人员提供了新的视角和方法来缓解LLM的幻觉问题,并提升模型的可靠性和准确性。

🎯 应用场景

该研究成果可应用于提升大型语言模型的可靠性和准确性,减少幻觉现象。通过深入理解知识遮蔽的产生机制,可以开发更有效的训练方法和模型架构,从而提高LLM在各种任务中的表现,例如问答系统、文本生成和机器翻译等。此外,该研究也为其他类型的模型幻觉问题提供了新的研究思路。

📄 摘要(原文)

Large Language Models (LLMs), despite their remarkable capabilities, are hampered by hallucinations. A particularly challenging variant, knowledge overshadowing, occurs when one piece of activated knowledge inadvertently masks another relevant piece, leading to erroneous outputs even with high-quality training data. Current understanding of overshadowing is largely confined to inference-time observations, lacking deep insights into its origins and internal mechanisms during model training. Therefore, we introduce PhantomCircuit, a novel framework designed to comprehensively analyze and detect knowledge overshadowing. By innovatively employing knowledge circuit analysis, PhantomCircuit dissects the function of key components in the circuit and how the attention pattern dynamics contribute to the overshadowing phenomenon and its evolution throughout the training process. Extensive experiments demonstrate PhantomCircuit's effectiveness in identifying such instances, offering novel insights into this elusive hallucination and providing the research community with a new methodological lens for its potential mitigation.