Teaching Small Language Models to Learn Logic through Meta-Learning

作者: Leonardo Bertolazzi, Manuel Vargas Guzmán, Raffaella Bernardi, Maciej Malicki, Jakub Szymanik

分类: cs.CL

发布日期: 2025-05-20 (更新: 2026-01-26)

备注: EACL 2026 Main

💡 一句话要点

通过元学习训练小语言模型学习逻辑推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 元学习 逻辑推理 三段论推理 小语言模型 泛化能力

📋 核心要点

- 大型语言模型在逻辑推理方面仍有不足,尤其是在泛化到新结构时。

- 采用少样本元学习,鼓励模型学习跨任务的逻辑规则,而非记忆特定任务模式。

- 实验表明,元学习能显著提升小模型在三段论推理上的泛化能力,超越GPT-4o等模型。

📝 摘要(中文)

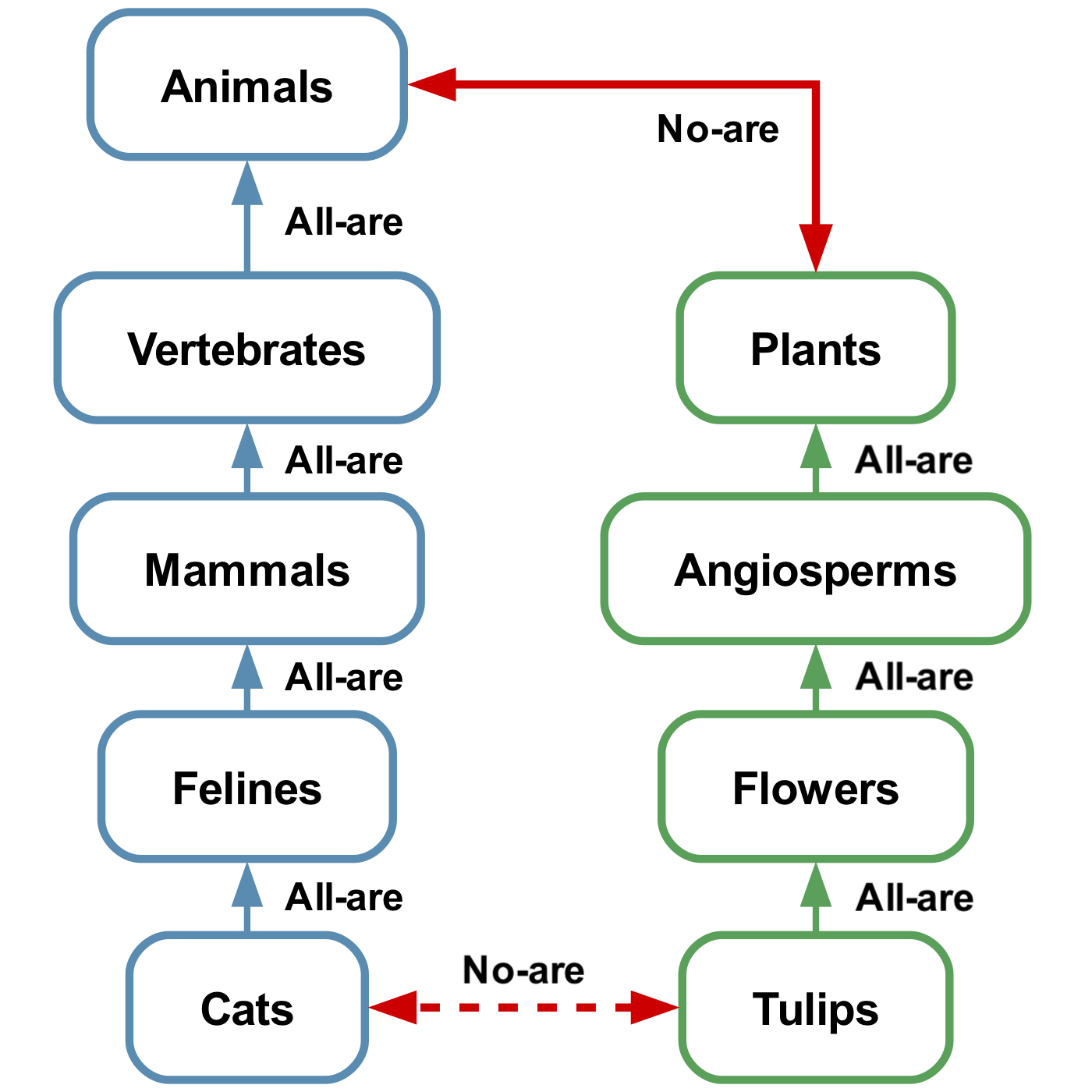

大型语言模型(LLMs)越来越多地在推理任务中接受评估,但它们的逻辑能力仍然存在争议。为了解决这个问题,我们研究了LLMs在一个明确定义的逻辑片段中的推理能力:三段论推理。我们将该问题转化为前提选择,并构建受控数据集以分离逻辑能力。除了评估之外,一个公开的挑战是使LLMs能够获得推广到新结构的抽象推理模式。我们建议将少样本元学习应用于该领域,从而鼓励模型提取跨任务的规则,而不是记忆任务内的模式。虽然元学习在逻辑可学习性的背景下很少被探索,但我们的实验表明它是有效的:通过元学习微调的小模型(1.5B-7B)在泛化方面表现出强大的提升,尤其是在低数据状态下。这些元学习模型在我们三段论推理任务中的表现优于GPT-4o和o3-mini。

🔬 方法详解

问题定义:论文旨在提升小型语言模型在三段论推理任务上的逻辑推理能力。现有方法,特别是直接训练大型语言模型,往往依赖于记忆训练数据中的模式,难以泛化到新的逻辑结构。因此,如何让模型真正学习到抽象的逻辑推理规则,而非仅仅是模式匹配,是一个关键问题。

核心思路:论文的核心思路是利用元学习,使模型能够从多个不同的三段论推理任务中学习,从而获得泛化能力。通过让模型接触各种逻辑结构,鼓励其提取通用的推理规则,而不是过度拟合特定任务的模式。这种方法类似于人类学习逻辑的过程,即通过接触不同的例子来掌握抽象的逻辑原则。

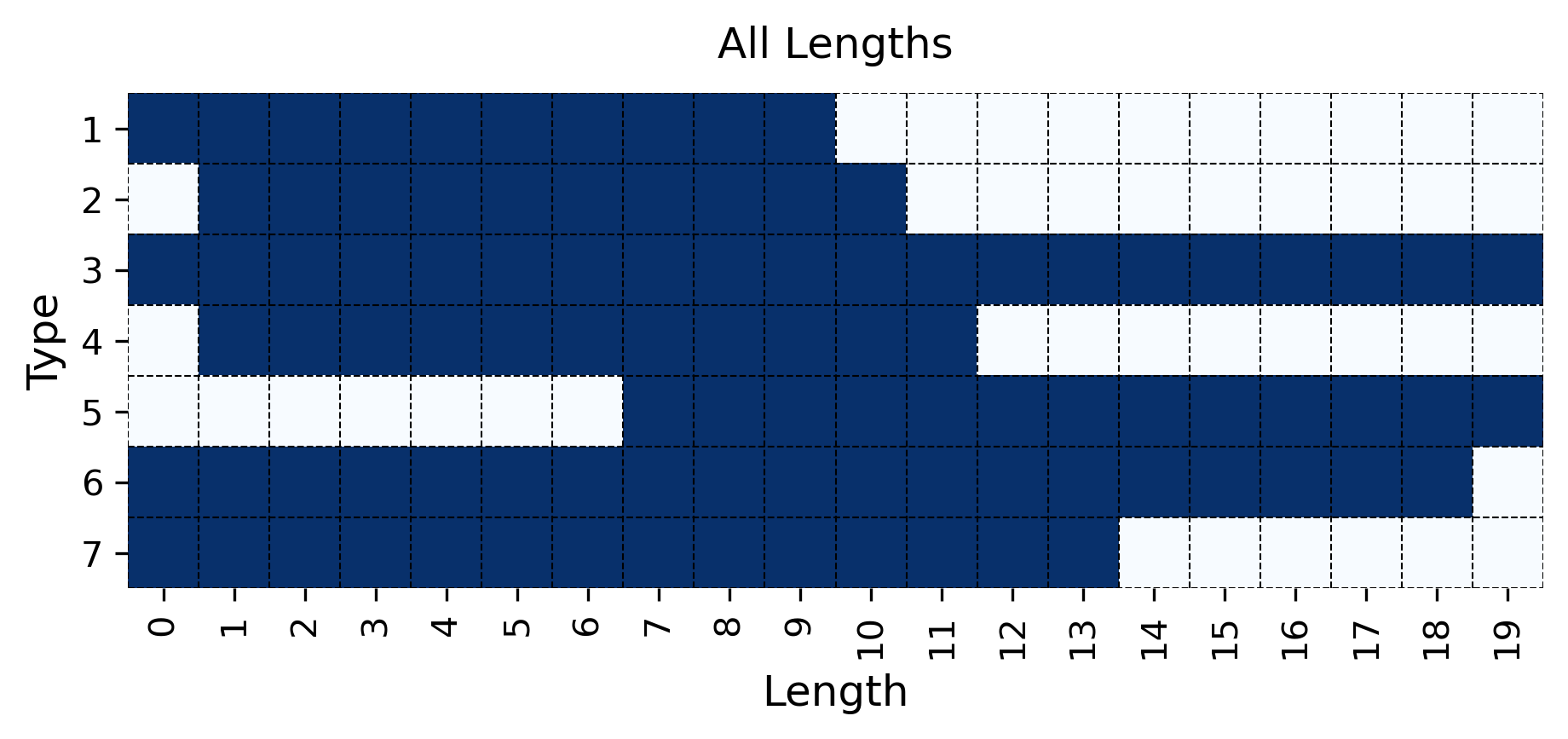

技术框架:整体框架包括以下几个阶段:1) 构建包含多个三段论推理任务的数据集,每个任务包含不同的前提和结论;2) 使用元学习算法(具体算法未知,论文中未明确说明)训练小型语言模型,使其能够从少量样本中快速适应新的推理任务;3) 在未见过的三段论推理任务上评估模型的泛化能力。模型结构使用了1.5B-7B参数的小型语言模型。

关键创新:最重要的技术创新点是将元学习应用于逻辑推理任务,特别是三段论推理。与传统的监督学习方法相比,元学习能够更好地提升模型在低数据情况下的泛化能力,使其能够适应新的逻辑结构。这种方法鼓励模型学习抽象的推理规则,而不是仅仅记忆训练数据中的模式。

关键设计:论文的关键设计包括:1) 精心构建的三段论推理数据集,用于训练和评估模型的逻辑推理能力;2) 使用少样本元学习算法,使模型能够从少量样本中快速适应新的推理任务;3) 针对三段论推理任务设计的特定损失函数(具体细节未知),用于优化模型的推理性能;4) 选择合适规模的小型语言模型(1.5B-7B),以在性能和计算成本之间取得平衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过元学习微调的小型语言模型(1.5B-7B)在三段论推理任务中表现出强大的泛化能力,尤其是在低数据状态下。这些元学习模型在性能上优于GPT-4o和o3-mini等大型语言模型,证明了元学习在提升逻辑推理能力方面的有效性。具体的性能提升数据未知,论文中未给出详细的数值对比。

🎯 应用场景

该研究成果可应用于需要逻辑推理能力的各种领域,例如智能问答系统、自然语言推理、知识图谱推理等。通过提升小型语言模型的逻辑推理能力,可以降低计算成本,使其能够在资源受限的环境中部署。此外,该研究也为开发更可靠、更可解释的人工智能系统奠定了基础。

📄 摘要(原文)

Large language models (LLMs) are increasingly evaluated on reasoning tasks, yet their logical abilities remain contested. To address this, we study LLMs' reasoning in a well-defined fragment of logic: syllogistic reasoning. We cast the problem as premise selection and construct controlled datasets to isolate logical competence. Beyond evaluation, an open challenge is enabling LLMs to acquire abstract inference patterns that generalize to novel structures. We propose to apply few-shot meta-learning to this domain, thereby encouraging models to extract rules across tasks rather than memorize patterns within tasks. Although meta-learning has been little explored in the context of logic learnability, our experiments show that it is effective: small models (1.5B-7B) fine-tuned with meta-learning demonstrate strong gains in generalization, with especially pronounced benefits in low-data regimes. These meta-learned models outperform GPT-4o and o3-mini on our syllogistic reasoning task.