From Unaligned to Aligned: Scaling Multilingual LLMs with Multi-Way Parallel Corpora

作者: Yingli Shen, Wen Lai, Shuo Wang, Ge Gao, Kangyang Luo, Alexander Fraser, Maosong Sun

分类: cs.CL, cs.AI

发布日期: 2025-05-20 (更新: 2025-10-21)

备注: EMNLP 2025 Main Conference (Oral)

💡 一句话要点

利用多路平行语料提升多语言大语言模型跨语言语义理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言模型 平行语料 跨语言语义 持续预训练 指令微调 TED演讲 低资源语言

📋 核心要点

- 现有方法依赖未对齐的多语言数据,难以有效捕捉跨语言语义,限制了多语言大语言模型的性能。

- 论文提出利用多路平行语料,通过对齐多种语言的相同内容,增强模型的跨语言一致性和语义理解能力。

- 实验表明,在TED2025多路平行语料上训练的模型,在多个多语言基准测试中显著优于使用未对齐数据训练的模型。

📝 摘要(中文)

大规模多语言数据上的持续预训练和指令微调已被证明能有效扩展大语言模型(LLMs)到低资源语言。然而,此类数据未对齐的特性限制了其有效捕获跨语言语义的能力。相比之下,多路平行数据在多种语言中对齐相同内容,提供更强的跨语言一致性,并为提高多语言性能提供更大的潜力。本文介绍了一个基于TED演讲的大规模、高质量多路平行语料库TED2025。该语料库跨越113种语言,最多有50种语言并行对齐,确保了广泛的多语言覆盖。利用该数据集,我们研究了利用多路平行数据增强LLM的最佳实践,包括持续预训练、指令微调以及关键影响因素的分析。在六个多语言基准上的实验表明,在多路平行数据上训练的模型始终优于在未对齐的多语言数据上训练的模型。

🔬 方法详解

问题定义:现有的大规模多语言模型训练依赖于大量的未对齐的多语言数据,虽然能够覆盖多种语言,但是由于缺乏明确的跨语言对应关系,模型难以学习到准确的跨语言语义信息。这导致模型在跨语言理解、翻译等任务上的表现受到限制。现有方法难以充分利用不同语言之间的关联性,导致模型性能瓶颈。

核心思路:论文的核心思路是利用多路平行语料,即在多种语言中对齐相同内容的语料库,来训练多语言大语言模型。通过这种方式,模型可以直接学习到不同语言之间的对应关系,从而更好地理解跨语言语义。论文认为,相比于未对齐的数据,多路平行数据能够提供更强的跨语言一致性,从而提升模型的性能。

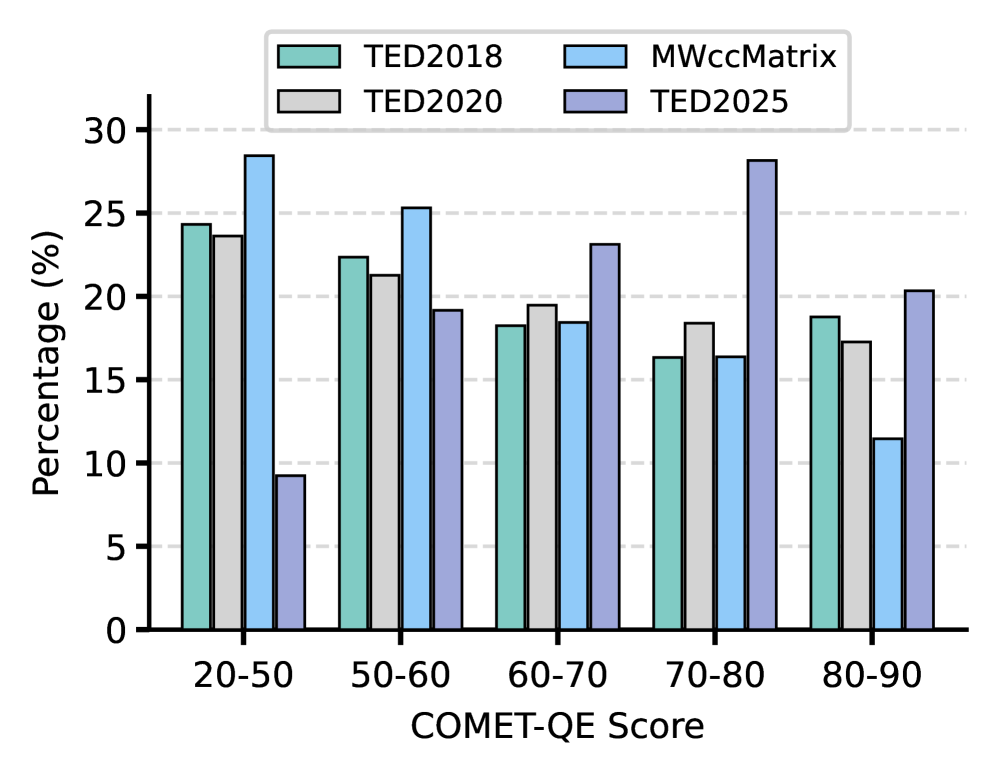

技术框架:论文的技术框架主要包括以下几个部分:首先,构建了一个大规模的多路平行语料库TED2025,该语料库基于TED演讲,覆盖了113种语言,最多有50种语言并行对齐。然后,利用该语料库进行模型的持续预训练和指令微调。在训练过程中,论文探索了不同的训练策略,例如如何有效地利用多路平行数据,以及如何平衡不同语言之间的训练数据。最后,在多个多语言基准测试上评估了模型的性能。

关键创新:论文的关键创新在于构建了一个大规模、高质量的多路平行语料库TED2025,并证明了利用该语料库训练多语言大语言模型能够显著提升模型的性能。与以往的研究相比,论文更加注重利用多路平行数据来增强模型的跨语言语义理解能力。此外,论文还探索了不同的训练策略,例如如何有效地利用多路平行数据,以及如何平衡不同语言之间的训练数据。

关键设计:论文的关键设计包括:1) TED2025语料库的构建,包括数据的收集、清洗和对齐;2) 持续预训练和指令微调的训练策略,例如如何选择合适的学习率、batch size等超参数;3) 损失函数的设计,例如如何平衡不同语言之间的损失;4) 实验评估方案的设计,例如如何选择合适的基准测试和评估指标。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在TED2025多路平行语料上训练的模型在六个多语言基准测试中始终优于在未对齐的多语言数据上训练的模型。具体性能提升幅度未知,但论文强调了在多路平行数据上训练的模型的显著优势,证明了该方法的有效性。

🎯 应用场景

该研究成果可广泛应用于机器翻译、跨语言信息检索、多语言对话系统等领域。通过提升多语言大语言模型的跨语言理解能力,可以实现更准确、更自然的跨语言交流。此外,该研究对于低资源语言的自然语言处理也具有重要意义,可以帮助构建更好的低资源语言模型,促进全球范围内的信息共享和交流。

📄 摘要(原文)

Continued pretraining and instruction tuning on large-scale multilingual data have proven to be effective in scaling large language models (LLMs) to low-resource languages. However, the unaligned nature of such data limits its ability to effectively capture cross-lingual semantics. In contrast, multi-way parallel data, where identical content is aligned across multiple languages, provides stronger cross-lingual consistency and offers greater potential for improving multilingual performance. In this paper, we introduce a large-scale, high-quality multi-way parallel corpus, TED2025, based on TED Talks. The corpus spans 113 languages, with up to 50 languages aligned in parallel, ensuring extensive multilingual coverage. Using this dataset, we investigate best practices for leveraging multi-way parallel data to enhance LLMs, including strategies for continued pretraining, instruction tuning, and the analysis of key influencing factors. Experiments on six multilingual benchmarks show that models trained on multiway parallel data consistently outperform those trained on unaligned multilingual data.