VeriFact: Enhancing Long-Form Factuality Evaluation with Refined Fact Extraction and Reference Facts

作者: Xin Liu, Lechen Zhang, Sheza Munir, Yiyang Gu, Lu Wang

分类: cs.CL

发布日期: 2025-05-14 (更新: 2025-09-26)

💡 一句话要点

VeriFact:通过精细化事实抽取和参考事实增强长文本事实性评估

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 事实性评估 长文本生成 大型语言模型 信息抽取 知识图谱 自然语言处理 基准测试

📋 核心要点

- 现有长文本事实性评估方法难以捕捉句子间的复杂依赖关系和关键关系事实,导致评估不准确。

- VeriFact框架通过识别和补全不完整的事实,并利用参考事实集,提升事实抽取的完整性和准确性。

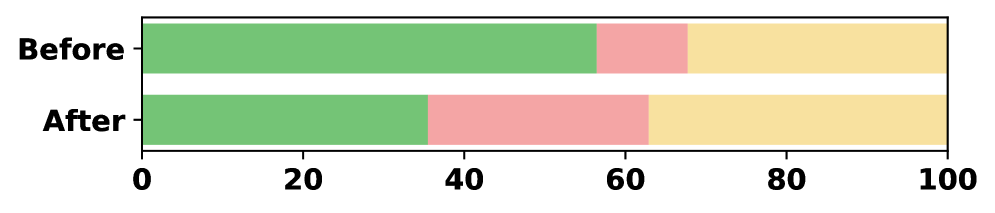

- FactRBench基准测试表明,VeriFact能更准确地评估长文本的事实性,并揭示了精确率与召回率之间的差异。

📝 摘要(中文)

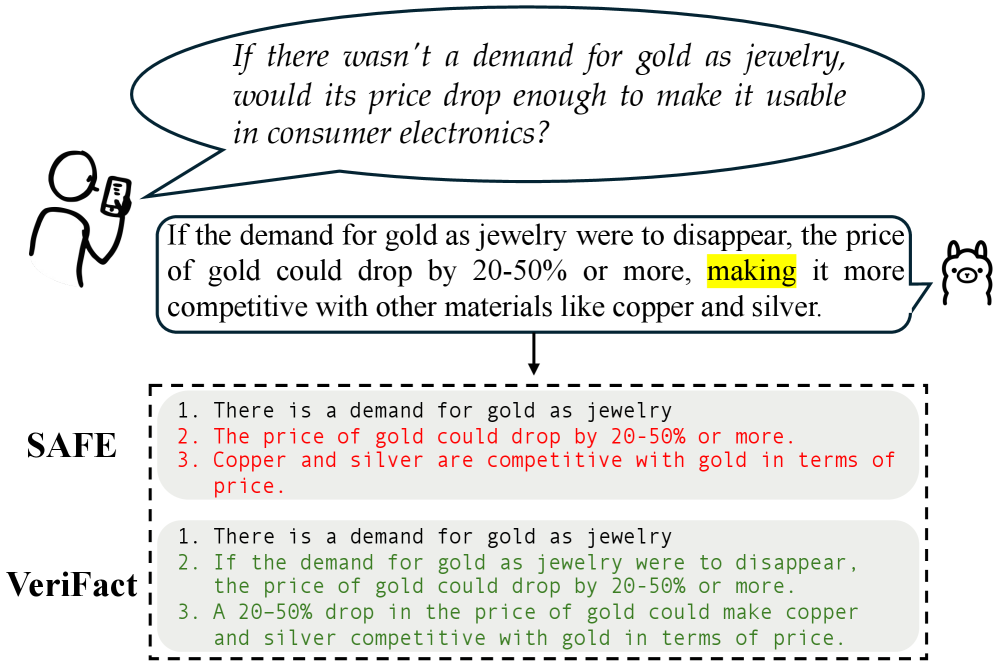

大型语言模型(LLMs)擅长生成长篇回复,但评估其事实性仍然具有挑战性,因为生成的事实中存在复杂的句子间依赖关系。以往的解决方案主要遵循分解-去语境化-验证的流程,但通常无法捕捉必要的上下文,并遗漏关键的关系事实。本文提出了VeriFact,一个事实性评估框架,旨在通过识别和解决不完整和缺失的事实来增强事实抽取,从而支持更准确的验证结果。此外,我们引入了FactRBench,一个评估长篇模型回复中精确率和召回率的基准,而之前的工作主要关注精确率。FactRBench提供了来自高级LLM和人工编写答案的参考事实集,从而能够进行召回率评估。经验评估表明,VeriFact显著提高了事实完整性,并保留了具有关键关系信息的复杂事实,从而实现了更准确的事实性评估。在FactRBench上对各种开放和封闭权重LLM的基准测试表明,同一模型系列中较大的模型提高了精确率和召回率,但高精确率并不总是与高召回率相关,这突出了全面事实性评估的重要性。

🔬 方法详解

问题定义:论文旨在解决长文本生成的事实性评估问题。现有方法,如分解-去语境化-验证流程,在处理长文本时,无法充分捕捉句子间的依赖关系,导致关键上下文信息丢失,特别是关系型事实的缺失,从而影响评估的准确性。现有基准测试主要关注精确率,忽略了召回率,无法全面评估模型的事实性。

核心思路:VeriFact的核心思路是通过更精细的事实抽取和引入参考事实来增强事实性评估。它旨在识别和补全生成文本中不完整或缺失的事实,从而提供更全面的事实基础进行验证。同时,利用参考事实集,可以评估模型生成事实的召回率,从而更全面地评估模型的事实性。

技术框架:VeriFact框架包含以下主要阶段:1) 事实抽取:从生成的长文本中抽取事实陈述。2) 事实补全:识别并补全不完整或缺失的事实,例如通过上下文推理或外部知识库查询。3) 事实验证:将抽取和补全后的事实与参考事实进行比较,以确定其真实性。4) 事实性评估:基于验证结果,计算精确率和召回率等指标,评估生成文本的事实性。

关键创新:VeriFact的关键创新在于其精细化的事实抽取和补全机制,以及引入参考事实集进行召回率评估。与现有方法相比,VeriFact更注重事实的完整性和上下文依赖关系,能够更准确地识别和验证复杂的事实陈述。FactRBench基准测试的引入,使得可以同时评估精确率和召回率,从而更全面地评估模型的事实性。

关键设计:论文中关键设计包括:1) 使用先进的LLM进行参考事实生成,构建高质量的参考事实集。2) 设计了专门的算法来识别和补全不完整的事实,例如利用上下文信息进行推理。3) 采用精确率和召回率作为评估指标,全面衡量模型的事实性。具体的参数设置、损失函数和网络结构等技术细节在论文中可能没有详细描述,需要进一步查阅论文原文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VeriFact能够显著提高事实抽取的完整性,并保留关键的关系信息,从而实现更准确的事实性评估。在FactRBench基准测试中,VeriFact能够有效区分不同LLM的事实性表现,并揭示了高精确率并不总是意味着高召回率的现象。实验结果强调了全面事实性评估的重要性。

🎯 应用场景

VeriFact可应用于各种需要评估长文本生成质量的场景,例如新闻生成、报告生成、对话系统等。通过提高事实性评估的准确性,可以帮助开发者更好地训练和评估LLM,从而生成更可靠、更值得信赖的内容。该研究对于提升AI系统的可信度和可靠性具有重要意义。

📄 摘要(原文)

Large language models (LLMs) excel at generating long-form responses, but evaluating their factuality remains challenging due to complex inter-sentence dependencies within the generated facts. Prior solutions predominantly follow a decompose-decontextualize-verify pipeline but often fail to capture essential context and miss key relational facts. In this paper, we introduce VeriFact, a factuality evaluation framework designed to enhance fact extraction by identifying and resolving incomplete and missing facts to support more accurate verification results. Moreover, we introduce FactRBench , a benchmark that evaluates both precision and recall in long-form model responses, whereas prior work primarily focuses on precision. FactRBench provides reference fact sets from advanced LLMs and human-written answers, enabling recall assessment. Empirical evaluations show that VeriFact significantly enhances fact completeness and preserves complex facts with critical relational information, resulting in more accurate factuality evaluation. Benchmarking various open- and close-weight LLMs on FactRBench indicate that larger models within same model family improve precision and recall, but high precision does not always correlate with high recall, underscoring the importance of comprehensive factuality assessment.