OnPrem.LLM: A Privacy-Conscious Document Intelligence Toolkit

作者: Arun S. Maiya

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-05-12 (更新: 2025-09-26)

备注: 6 pages

💡 一句话要点

OnPrem.LLM:一款注重隐私的本地化文档智能工具包

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 本地化部署 大型语言模型 文档智能 隐私保护 检索增强生成

📋 核心要点

- 现有方法在处理敏感数据时面临隐私泄露风险,难以在离线或受限环境中应用大型语言模型。

- OnPrem.LLM通过本地部署和灵活的后端支持,实现了在保护隐私的前提下使用LLM进行文档智能任务。

- 该工具包提供预构建的流水线和无需编码的Web界面,降低了LLM应用的技术门槛,方便非技术人员使用。

📝 摘要(中文)

本文介绍OnPrem.LLM,一个基于Python的工具包,旨在将大型语言模型(LLM)应用于敏感、非公开数据,且运行于离线或受限环境中。该系统专为保护隐私的用例而设计,提供预构建的文档处理和存储、检索增强生成(RAG)、信息提取、摘要、分类以及提示/输出处理流水线,配置需求极简。OnPrem.LLM支持多种LLM后端,包括llama.cpp、Ollama、vLLM和Hugging Face Transformers,并提供量化模型支持、GPU加速和无缝后端切换。虽然设计为完全本地执行,但OnPrem.LLM也支持与各种云LLM提供商集成(在允许的情况下),从而实现平衡性能和数据控制的混合部署。此外,该工具包还提供一个无需编码的Web界面,以扩展其对非技术用户的可访问性。

🔬 方法详解

问题定义:论文旨在解决在处理敏感、非公开数据时,如何安全地应用大型语言模型(LLM)的问题。现有方法通常依赖于云服务,存在数据泄露的风险,并且在离线或受限环境中无法使用。因此,需要一种能够在本地环境中运行,同时提供丰富文档智能功能的工具。

核心思路:OnPrem.LLM的核心思路是将LLM部署在本地环境中,从而避免数据传输到云端,保护数据的隐私。同时,该工具包提供预构建的流水线,简化了LLM的应用流程,降低了使用门槛。通过支持多种LLM后端,OnPrem.LLM提供了灵活性,用户可以根据自己的需求选择合适的模型。

技术框架:OnPrem.LLM的整体架构包括以下几个主要模块:文档处理和存储模块,负责文档的导入、清洗和存储;检索增强生成(RAG)模块,用于从文档中检索相关信息,并生成相应的文本;信息提取模块,用于从文档中提取关键信息;摘要模块,用于生成文档的摘要;分类模块,用于对文档进行分类;提示/输出处理模块,用于处理LLM的输入和输出。这些模块通过预构建的流水线连接在一起,用户可以通过简单的配置即可使用。

关键创新:OnPrem.LLM的关键创新在于其本地化部署和灵活的后端支持。与传统的基于云的LLM服务不同,OnPrem.LLM可以在本地环境中运行,从而避免数据泄露的风险。同时,该工具包支持多种LLM后端,包括llama.cpp、Ollama、vLLM和Hugging Face Transformers,用户可以根据自己的需求选择合适的模型。此外,该工具包还提供无需编码的Web界面,降低了LLM应用的技术门槛。

关键设计:OnPrem.LLM的关键设计包括:支持量化模型,以降低模型的大小和计算复杂度;使用GPU加速,以提高模型的推理速度;提供无缝后端切换,方便用户选择合适的模型;提供预构建的流水线,简化LLM的应用流程;提供无需编码的Web界面,降低使用门槛。具体的参数设置、损失函数、网络结构等技术细节取决于所使用的LLM后端。

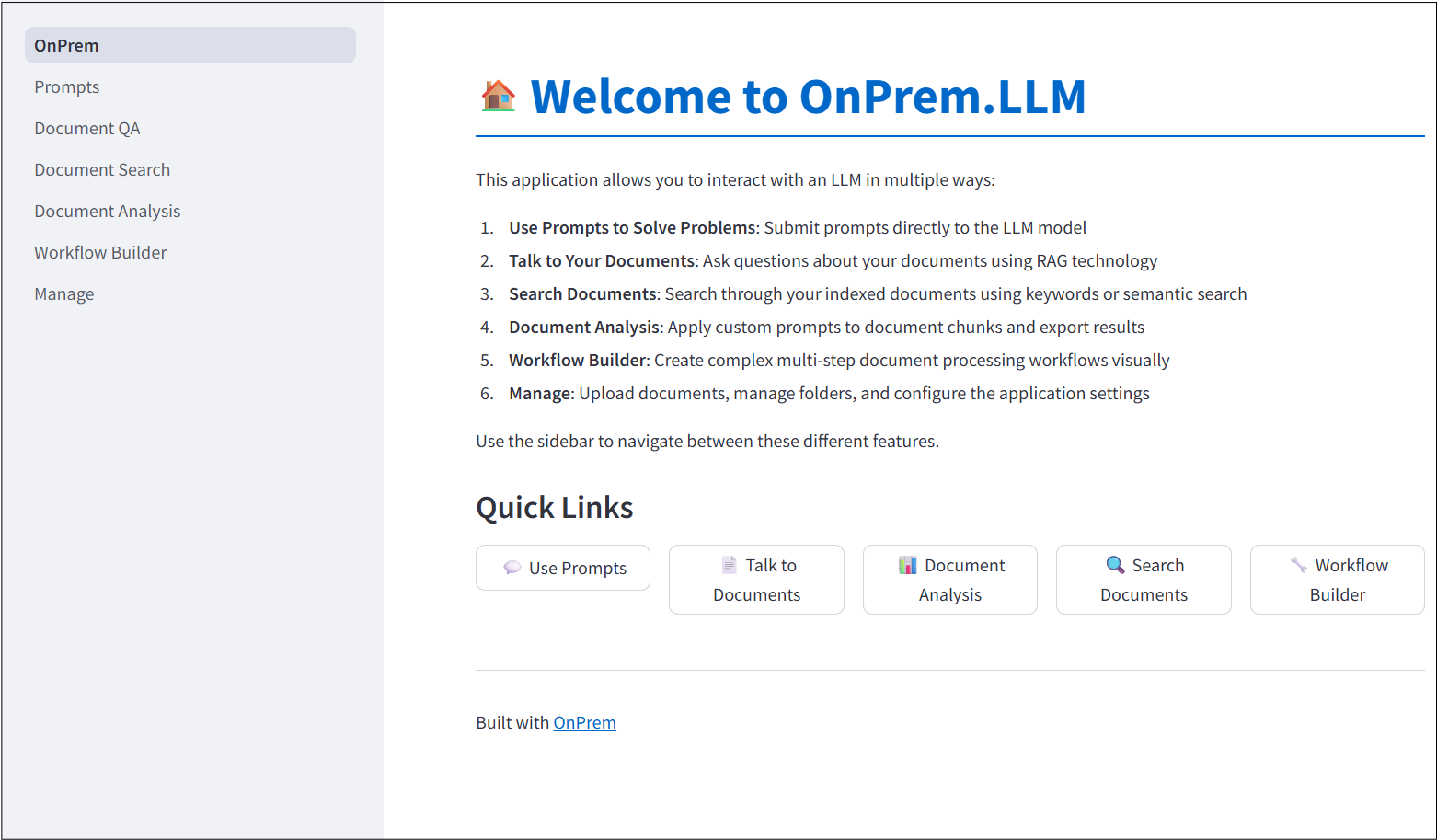

🖼️ 关键图片

📊 实验亮点

论文重点在于工具包的设计与实现,而非具体的实验结果。亮点在于其支持多种LLM后端,包括llama.cpp、Ollama、vLLM和Hugging Face Transformers,并提供量化模型支持和GPU加速。此外,无需编码的Web界面显著降低了使用门槛,使得非技术人员也能方便地使用LLM进行文档智能任务。

🎯 应用场景

OnPrem.LLM适用于需要处理敏感数据的各种场景,例如金融、医疗、法律等领域。它可以用于文档分析、信息提取、知识图谱构建等任务,帮助企业更好地利用其内部数据。该工具包的本地化部署特性使其特别适用于对数据安全有严格要求的组织。

📄 摘要(原文)

We present OnPrem$.$LLM, a Python-based toolkit for applying large language models (LLMs) to sensitive, non-public data in offline or restricted environments. The system is designed for privacy-preserving use cases and provides prebuilt pipelines for document processing and storage, retrieval-augmented generation (RAG), information extraction, summarization, classification, and prompt/output processing with minimal configuration. OnPrem$.$LLM supports multiple LLM backends -- including llama$.$cpp, Ollama, vLLM, and Hugging Face Transformers -- with quantized model support, GPU acceleration, and seamless backend switching. Although designed for fully local execution, OnPrem$.$LLM also supports integration with a wide range of cloud LLM providers when permitted, enabling hybrid deployments that balance performance with data control. A no-code web interface extends accessibility to non-technical users.