Ψ-Arena: Interactive Assessment and Optimization of LLM-based Psychological Counselors with Tripartite Feedback

作者: Shijing Zhu, Zhuang Chen, Guanqun Bi, Binghang Li, Yaxi Deng, Dazhen Wan, Libiao Peng, Xiyao Xiao, Rongsheng Zhang, Tangjie Lv, Zhipeng Hu, FangFang Li, Minlie Huang

分类: cs.CL

发布日期: 2025-05-06

备注: in progress

💡 一句话要点

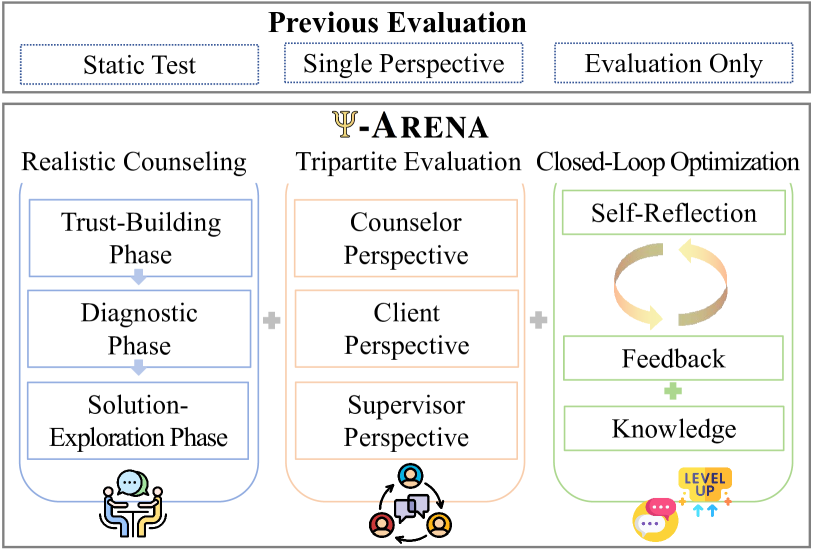

提出Ψ-Arena,通过三方反馈交互式评估和优化基于LLM的心理咨询师。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心理咨询 大型语言模型 人机交互 评估框架 闭环优化

📋 核心要点

- 现有心理咨询LLM评估方法缺乏真实互动、视角单一,且缺少有效反馈机制。

- Ψ-Arena构建交互式评估框架,模拟真实咨询场景,引入三方评估和闭环优化。

- 实验表明,不同LLM在不同场景下表现差异大,基于反思的优化可显著提升咨询性能。

📝 摘要(中文)

大型语言模型(LLMs)在提供可扩展的心理健康支持方面展现出潜力,但评估其咨询能力对于确保有效性和安全性至关重要。现有的评估方法受限于静态的知识测试、以用户体验为中心的单一视角以及缺乏可操作反馈的开环框架。为了解决这些问题,我们提出了Ψ-Arena,一个用于全面评估和优化基于LLM的咨询师的交互式框架,具有三个关键特征:(1)通过与心理侧写的NPC客户进行多阶段对话来模拟真实咨询的互动场景;(2)整合来自客户、咨询师和督导的三方评估;(3)使用诊断性反馈迭代改进LLM咨询师的闭环优化。对八个最先进的LLM进行的实验表明,在不同的真实场景和评估视角下,性能存在显著差异。此外,基于反思的优化使咨询性能提高了高达141%。我们希望Ψ-Arena为推进心理健康领域中可靠且符合人类价值观的LLM应用提供基础资源。

🔬 方法详解

问题定义:现有基于LLM的心理咨询评估方法主要存在三个痛点:一是评估方式静态,主要依赖知识测试,无法模拟真实咨询的互动性;二是评估视角单一,主要关注用户体验,忽略了咨询师和督导的专业视角;三是评估框架是开环的,缺乏有效的反馈机制来指导LLM咨询师的改进。因此,需要一个更全面、更具互动性和可优化性的评估框架。

核心思路:Ψ-Arena的核心思路是构建一个模拟真实心理咨询场景的交互式环境,并引入多方视角进行评估,同时利用评估结果进行闭环优化。通过模拟真实场景,可以更准确地评估LLM咨询师的实际咨询能力;通过引入多方视角,可以更全面地了解LLM咨询师的优缺点;通过闭环优化,可以不断提升LLM咨询师的咨询水平。

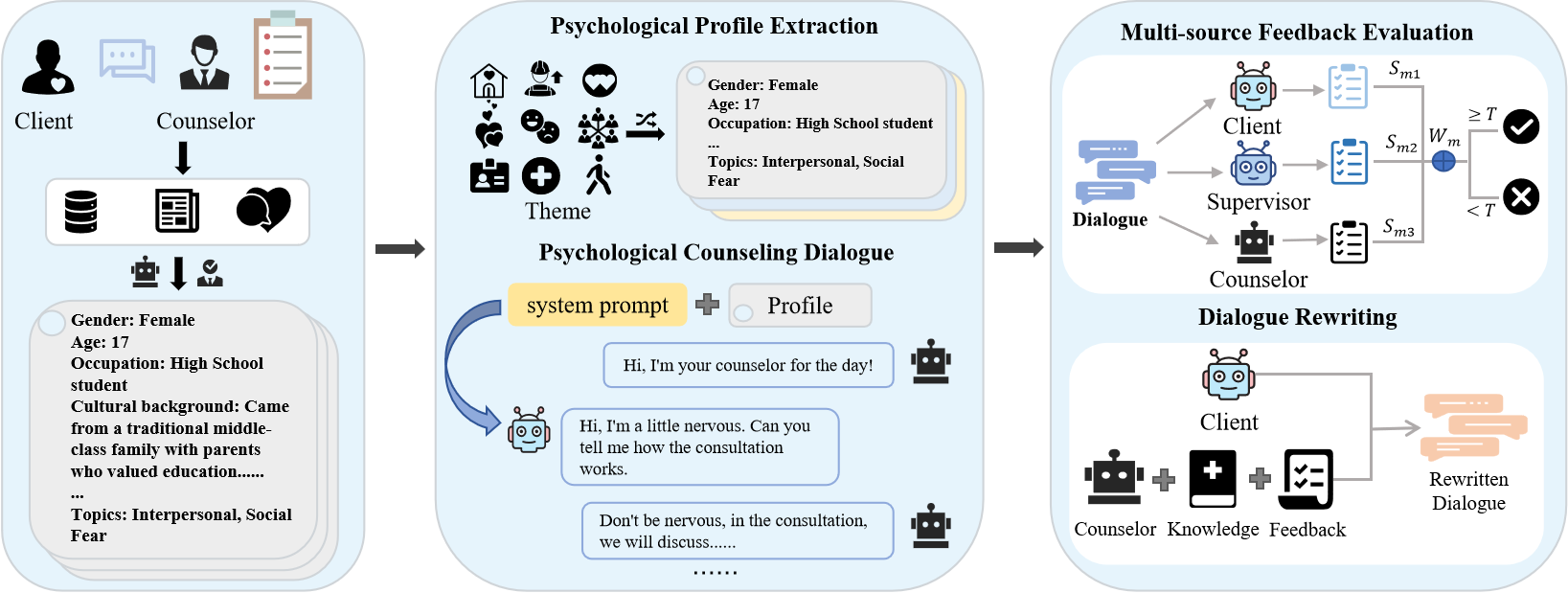

技术框架:Ψ-Arena的整体框架包含三个主要模块:一是互动场景构建模块,用于创建具有心理侧写的NPC客户,并模拟多阶段的咨询对话;二是三方评估模块,用于收集来自客户、咨询师(LLM)和督导的评估反馈;三是闭环优化模块,用于根据评估反馈对LLM咨询师进行迭代改进。整个流程是一个循环迭代的过程,每次迭代都会根据新的评估结果对LLM咨询师进行优化。

关键创新:Ψ-Arena的关键创新在于其三方评估和闭环优化机制。传统评估方法主要依赖用户反馈,而Ψ-Arena引入了咨询师和督导的专业视角,可以更全面地评估LLM咨询师的咨询能力。此外,Ψ-Arena的闭环优化机制可以根据评估反馈对LLM咨询师进行迭代改进,使其能够不断学习和提升。

关键设计:在互动场景构建方面,论文使用了心理侧写技术来创建具有不同性格和问题的NPC客户。在三方评估方面,论文设计了不同的评估指标,以反映客户的满意度、咨询师的专业水平和督导的指导意见。在闭环优化方面,论文采用了基于反思的学习方法,让LLM咨询师能够根据评估反馈反思自己的咨询过程,并进行自我改进。

🖼️ 关键图片

📊 实验亮点

实验结果表明,不同LLM在Ψ-Arena中的表现差异显著,表明该框架能够有效区分不同LLM的咨询能力。通过基于反思的优化,LLM咨询师的咨询性能提升高达141%,证明了Ψ-Arena的闭环优化机制的有效性。实验还验证了三方评估的必要性,不同视角下的评估结果存在差异,表明单一视角无法全面评估LLM咨询师的咨询能力。

🎯 应用场景

Ψ-Arena可应用于心理健康领域,用于评估和优化基于LLM的心理咨询系统,提升其咨询质量和安全性。该框架有助于开发更可靠、更人性化的AI心理咨询服务,缓解心理健康资源不足的问题,并为心理咨询师提供辅助工具。未来,该研究可扩展到其他需要人机交互的领域,如教育、客服等。

📄 摘要(原文)

Large language models (LLMs) have shown promise in providing scalable mental health support, while evaluating their counseling capability remains crucial to ensure both efficacy and safety. Existing evaluations are limited by the static assessment that focuses on knowledge tests, the single perspective that centers on user experience, and the open-loop framework that lacks actionable feedback. To address these issues, we propose Ψ-Arena, an interactive framework for comprehensive assessment and optimization of LLM-based counselors, featuring three key characteristics: (1) Realistic arena interactions that simulate real-world counseling through multi-stage dialogues with psychologically profiled NPC clients, (2) Tripartite evaluation that integrates assessments from the client, counselor, and supervisor perspectives, and (3) Closed-loop optimization that iteratively improves LLM counselors using diagnostic feedback. Experiments across eight state-of-the-art LLMs show significant performance variations in different real-world scenarios and evaluation perspectives. Moreover, reflection-based optimization results in up to a 141% improvement in counseling performance. We hope PsychoArena provides a foundational resource for advancing reliable and human-aligned LLM applications in mental healthcare.