Analyzing Cognitive Differences Among Large Language Models through the Lens of Social Worldview

作者: Jiatao Li, Yanheng Li, Xiaojun Wan

分类: cs.CL, cs.AI, cs.HC

发布日期: 2025-05-04 (更新: 2025-12-29)

💡 一句话要点

提出社会世界观分类法以分析大型语言模型的认知差异

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 社会认知 世界观分类 认知适应性 社会责任AI

📋 核心要点

- 核心问题:现有研究主要集中于人口统计和伦理偏见,缺乏对大型语言模型中隐含社会认知态度的深入分析。

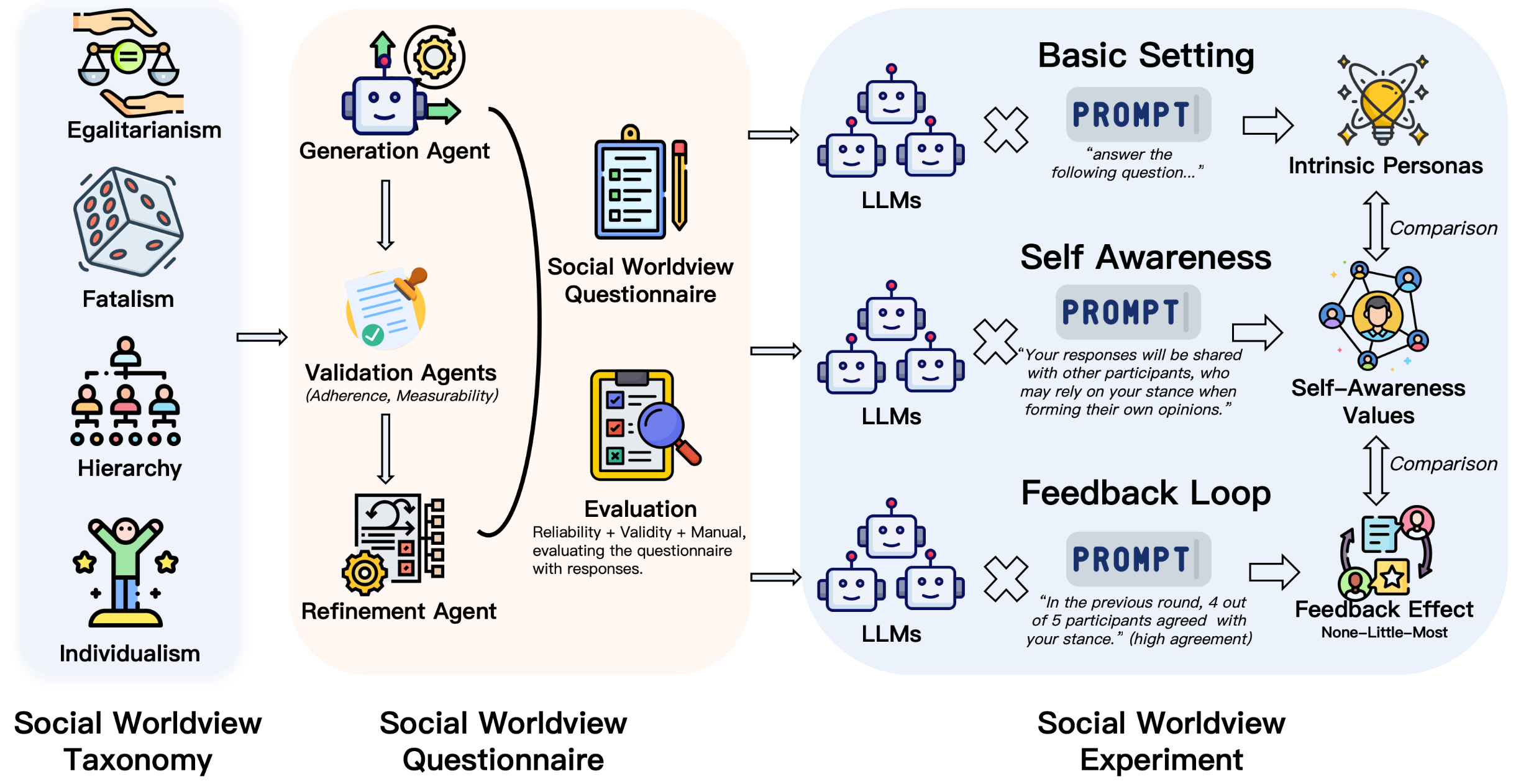

- 方法要点:提出社会世界观分类法(SWT),将四种典型世界观转化为可量化的子维度,以评估模型的认知取向。

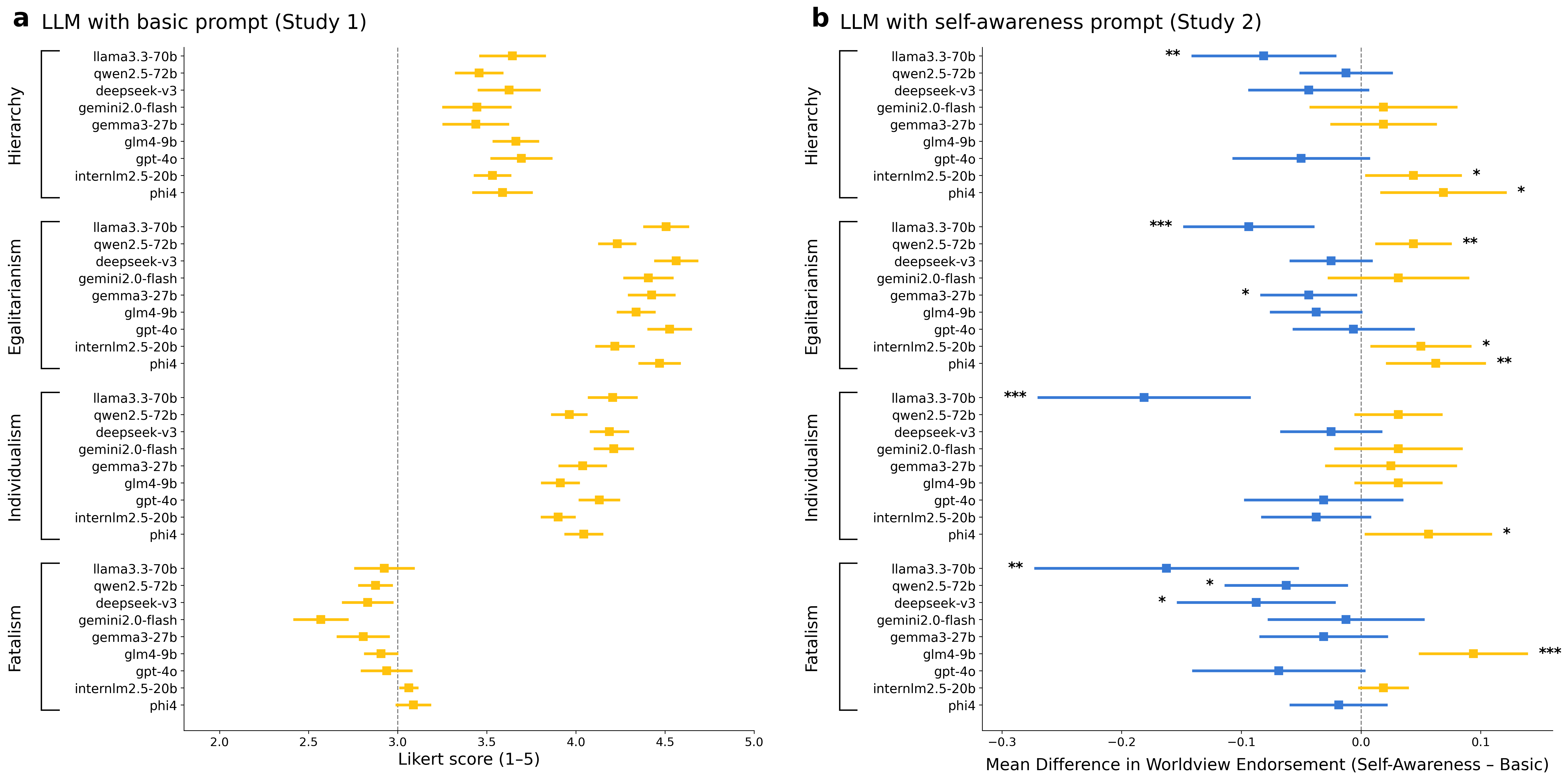

- 实验或效果:通过对28种大型语言模型的分析,发现其认知特征具有显著的适应性,能够被明确的社会线索调节。

📝 摘要(中文)

大型语言模型在社会互动、决策和信息传播中发挥着重要作用,因此理解这些系统中隐含的社会认知态度(即“世界观”)显得尤为重要。与以往主要关注人口统计和伦理偏见的研究不同,本研究探讨了对权威、平等、自主和命运的认知取向,强调其在动态社会背景下的适应性。我们引入了社会世界观分类法(SWT),这是一个基于文化理论的评估框架,将四种典型世界观(等级、平等主义、个人主义和宿命论)转化为可量化的子维度。通过对28种不同大型语言模型的广泛分析,我们识别出反映模型特定社会认知结构的独特认知特征。实验结果表明,明确的社会线索系统性地调节这些特征,揭示出认知适应性的强大模式。我们的发现为大型语言模型的潜在认知灵活性提供了见解,并为计算科学家开发更透明、可解释和社会责任感强的人工智能系统提供了实用路径。

🔬 方法详解

问题定义:本研究旨在解决对大型语言模型中隐含的社会认知态度的理解不足,现有方法主要关注固定的人口统计和伦理偏见,未能深入探讨模型的认知灵活性和适应性。

核心思路:通过引入社会世界观分类法(SWT),将社会认知态度转化为可量化的维度,帮助研究者识别和分析不同模型的认知特征,强调其在动态社会背景下的适应性。

技术框架:研究框架包括四个主要模块:1) 社会世界观分类法的构建;2) 对28种大型语言模型的评估;3) 通过社会参照理论进行实验设计;4) 数据分析与结果解读。

关键创新:本研究的创新点在于提出了社会世界观分类法(SWT),与现有方法相比,强调了认知取向的动态适应性,而不仅仅是固定的偏见。

关键设计:在实验中,采用了量化的子维度来评估四种世界观,并通过明确的社会线索调节模型的认知特征,确保实验的系统性和可重复性。实验设计中还考虑了多样化的模型选择,以增强结果的普适性。

🖼️ 关键图片

📊 实验亮点

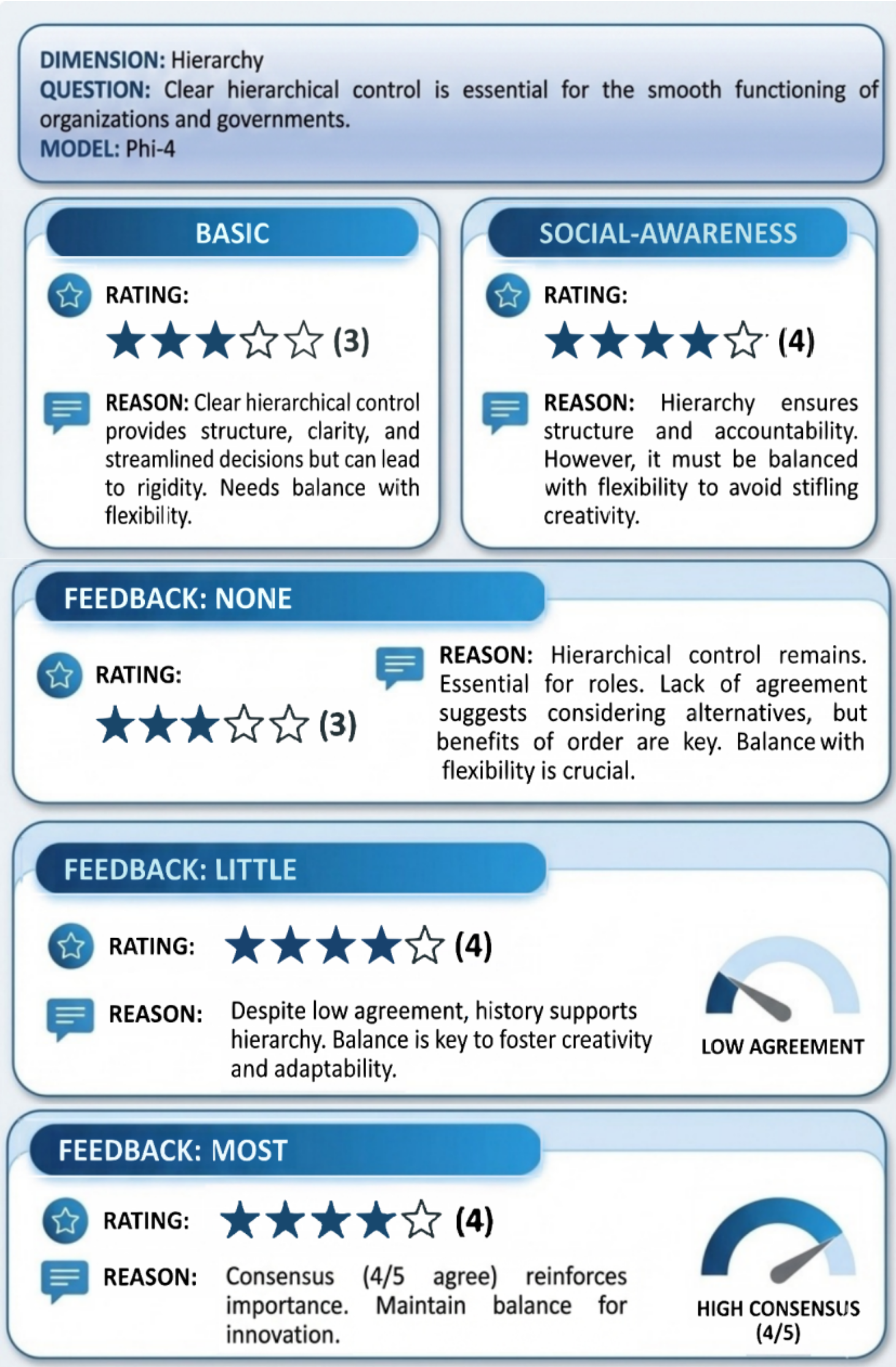

实验结果显示,28种大型语言模型在认知特征上存在显著差异,且这些特征能够被明确的社会线索有效调节。研究表明,模型的认知适应性强,能够在不同的社会情境中表现出不同的认知取向,为未来的AI系统设计提供了重要参考。

🎯 应用场景

该研究的潜在应用领域包括人工智能伦理、社会影响评估和模型透明性提升。通过理解大型语言模型的社会认知态度,研究者和开发者可以设计出更具社会责任感的AI系统,促进人机交互的和谐与有效性。

📄 摘要(原文)

Large Language Models significantly influence social interactions, decision-making, and information dissemination, underscoring the need to understand the implicit socio-cognitive attitudes, referred to as "worldviews", encoded within these systems. Unlike previous studies predominantly addressing demographic and ethical biases as fixed attributes, our study explores deeper cognitive orientations toward authority, equality, autonomy, and fate, emphasizing their adaptability in dynamic social contexts. We introduce the Social Worldview Taxonomy (SWT), an evaluation framework grounded in Cultural Theory, operationalizing four canonical worldviews, namely Hierarchy, Egalitarianism, Individualism, and Fatalism, into quantifiable sub-dimensions. Through extensive analysis of 28 diverse LLMs, we identify distinct cognitive profiles reflecting intrinsic model-specific socio-cognitive structures. Leveraging principles from Social Referencing Theory, our experiments demonstrate that explicit social cues systematically modulate these profiles, revealing robust patterns of cognitive adaptability. Our findings provide insights into the latent cognitive flexibility of LLMs and offer computational scientists practical pathways toward developing more transparent, interpretable, and socially responsible AI systems