Large Language Model-Driven Dynamic Assessment of Grammatical Accuracy in English Language Learner Writing

作者: Timur Jaganov, John Blake, Julián Villegas, Nicholas Carr

分类: cs.CL, cs.AI

发布日期: 2025-05-02

备注: 15 pages, 8 Figures. This work has been submitted to the IEEE for possible publication

期刊: IEEE ACCESS, 2025, Volume 13, pp. 151538-151550

DOI: 10.1109/ACCESS.2025.3603191

💡 一句话要点

利用大型语言模型动态评估英语学习者写作中的语法准确性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 动态评估 英语学习 语法纠错 自然语言处理

📋 核心要点

- 传统动态评估受限于师生比例,难以大规模应用,本研究旨在探索利用LLM扩展动态评估的可行性。

- 论文核心是构建DynaWrite平台,利用LLM生成动态反馈,辅助英语学习者提升语法准确性。

- 实验表明GPT-4o在语法错误识别和反馈质量上表现优异,具备实时性和稳定性,适合大规模动态评估。

📝 摘要(中文)

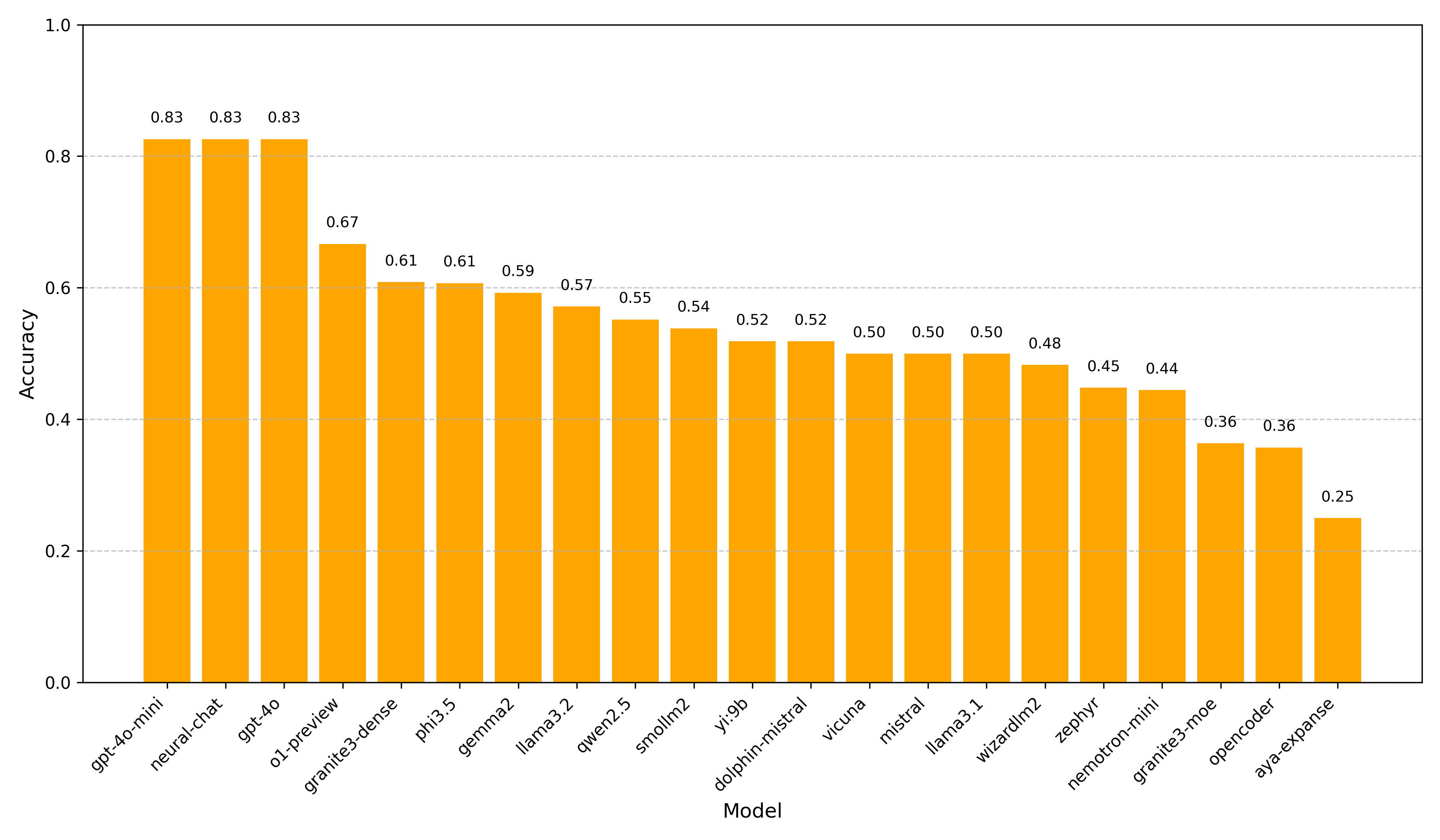

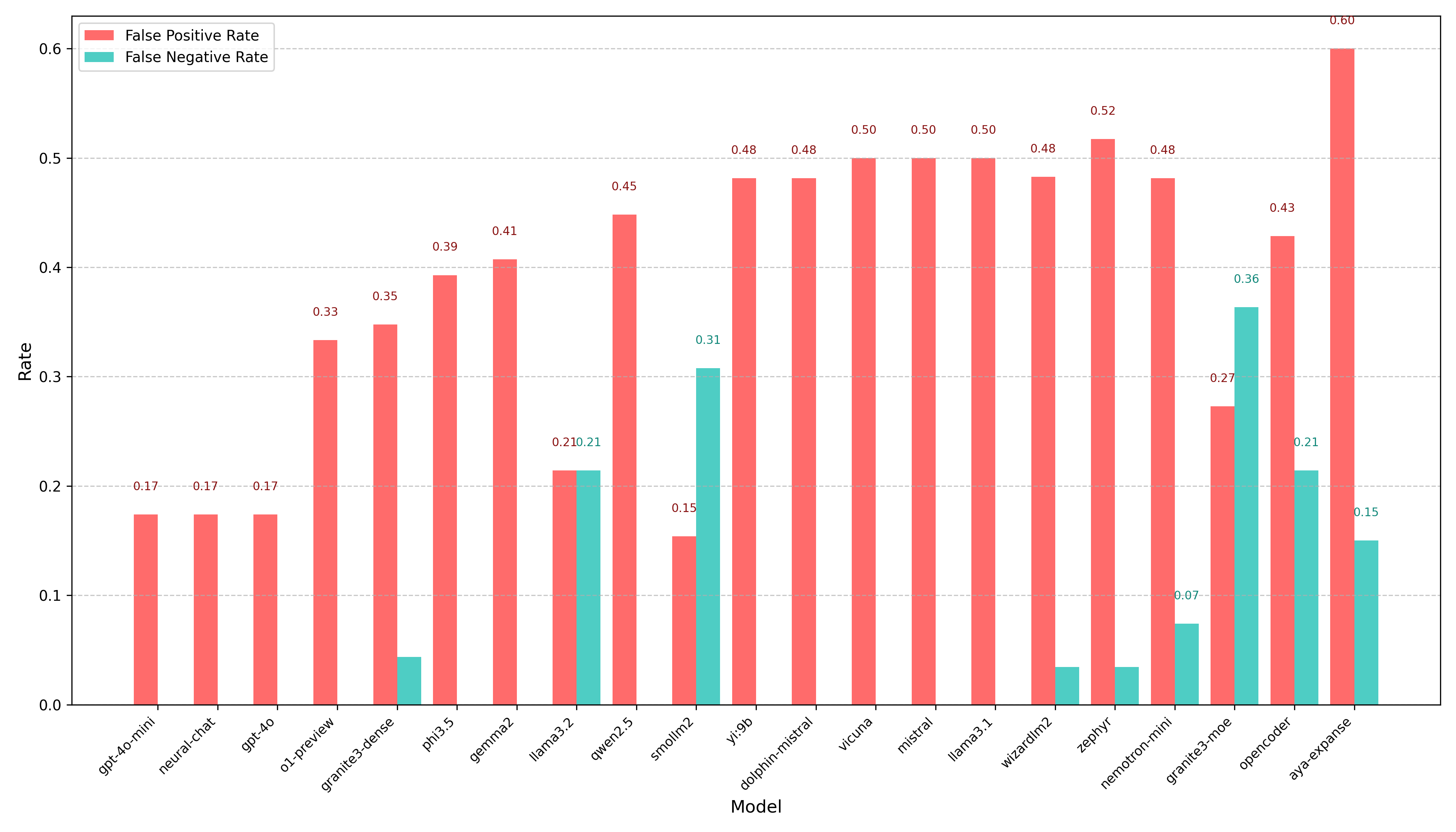

本研究探讨了大型语言模型(LLMs)在扩展动态评估(DA)方面的潜力。为了促进这项研究,我们首先开发了DynaWrite,一个基于微服务的模块化语法辅导应用程序,它支持多个LLM为英语学习者生成动态反馈。对21个LLM的初步测试表明,GPT-4o和neural chat在语言学习课堂中扩展DA方面具有最大的潜力。对这两个候选模型的进一步测试发现,它们在准确识别用户句子中的语法错误方面的能力相似。然而,GPT-4o在DA的质量方面始终优于neural chat,因为它能生成清晰、一致且逐步明确的提示。通过详细的性能测试,也证实了实时响应性和系统稳定性,GPT-4o表现出足够的速度和稳定性。这项研究表明,LLM可用于扩展动态评估,从而使动态评估能够传递给比传统师生环境中更大的群体。

🔬 方法详解

问题定义:论文旨在解决英语学习者语法学习中,传统动态评估方法因人力成本高昂而难以大规模应用的问题。现有方法依赖教师的直接指导,无法满足大量学习者的个性化需求,阻碍了动态评估的普及。

核心思路:论文的核心思路是利用大型语言模型(LLMs)的强大自然语言处理能力,自动生成针对学习者写作的动态反馈。通过LLM的智能提示和引导,模拟教师的动态评估过程,从而降低人力成本,实现动态评估的大规模应用。

技术框架:论文构建了一个名为DynaWrite的模块化、基于微服务的语法辅导应用程序。该应用支持多个LLM,允许用户输入英文句子,并由LLM进行语法错误检测和反馈生成。DynaWrite包含用户界面模块、LLM调用模块、反馈处理模块和性能监控模块。整体流程是:用户输入句子 -> DynaWrite调用LLM -> LLM生成反馈 -> DynaWrite呈现反馈给用户。

关键创新:论文的关键创新在于将大型语言模型应用于动态评估领域,并构建了一个可扩展的动态评估平台DynaWrite。与传统的基于规则或统计模型的语法检查器相比,LLM能够更准确地识别语法错误,并生成更自然、更具指导性的反馈。此外,DynaWrite的模块化设计使其易于集成不同的LLM,并进行性能评估和比较。

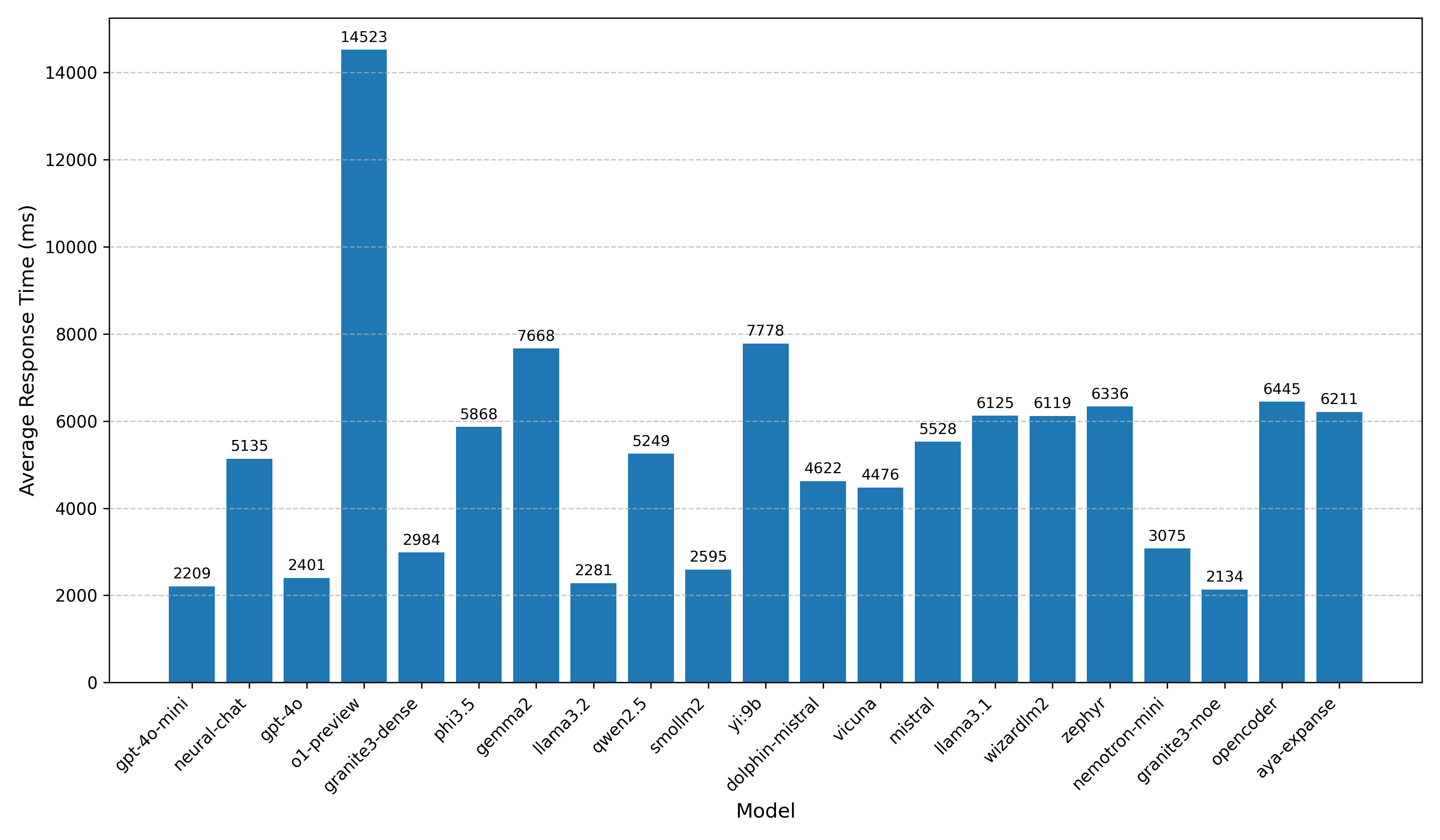

关键设计:论文的关键设计包括:1) 选择了GPT-4o和neural chat作为主要的LLM候选模型,并进行了详细的性能测试和比较;2) 设计了清晰、一致且逐步明确的提示生成策略,以提高反馈的有效性;3) 采用了微服务架构,以提高系统的可扩展性和稳定性;4) 进行了详细的性能测试,包括错误识别准确率、反馈质量、实时响应性和系统稳定性等指标。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GPT-4o在语法错误识别和反馈质量方面均优于neural chat。GPT-4o能够生成更清晰、更一致且逐步明确的提示,有效帮助学习者理解和纠正语法错误。性能测试还证实了GPT-4o具有足够的实时响应性和系统稳定性,能够满足大规模动态评估的需求。

🎯 应用场景

该研究成果可应用于在线英语学习平台、智能写作辅助工具、以及大规模语言测试等领域。通过集成DynaWrite或类似系统,可以为学习者提供个性化的语法辅导,提高写作水平。此外,该技术还有潜力应用于其他语言学习领域,例如口语练习和阅读理解。

📄 摘要(原文)

This study investigates the potential for Large Language Models (LLMs) to scale-up Dynamic Assessment (DA). To facilitate such an investigation, we first developed DynaWrite-a modular, microservices-based grammatical tutoring application which supports multiple LLMs to generate dynamic feedback to learners of English. Initial testing of 21 LLMs, revealed GPT-4o and neural chat to have the most potential to scale-up DA in the language learning classroom. Further testing of these two candidates found both models performed similarly in their ability to accurately identify grammatical errors in user sentences. However, GPT-4o consistently outperformed neural chat in the quality of its DA by generating clear, consistent, and progressively explicit hints. Real-time responsiveness and system stability were also confirmed through detailed performance testing, with GPT-4o exhibiting sufficient speed and stability. This study shows that LLMs can be used to scale-up dynamic assessment and thus enable dynamic assessment to be delivered to larger groups than possible in traditional teacher-learner settings.