LLM-Assisted Automated Deductive Coding of Dialogue Data: Leveraging Dialogue-Specific Characteristics to Enhance Contextual Understanding

作者: Ying Na, Shihui Feng

分类: cs.CL, cs.SI

发布日期: 2025-04-28

💡 一句话要点

提出LLM辅助的对话数据自动演绎编码框架,提升上下文理解精度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话数据分析 自动编码 大型语言模型 上下文理解 教育应用

📋 核心要点

- 现有方法难以有效处理对话数据中复杂的上下文信息,导致自动编码精度不足。

- 利用对话特有的交际行为和事件特征,结合角色提示和思维链,提升LLM对上下文的理解。

- 通过多LLM协作和上下文一致性检查,显著提升了自动编码的准确性,行为预测优于事件预测。

📝 摘要(中文)

对话数据是理解学习过程的关键来源,能深入了解学生如何参与协作讨论以及这些互动如何塑造他们的知识构建。大型语言模型(LLM)的出现为推进定性研究带来了有希望的机会,尤其是在对话数据的自动编码方面。然而,对话固有的上下文复杂性给这些模型带来了独特的挑战,特别是在理解和解释复杂的上下文信息方面。本研究通过开发一种新颖的LLM辅助对话数据自动编码方法来应对这些挑战。我们提出的框架的新颖之处在于:1) 我们使用角色提示和思维链方法,通过单独的提示,基于对话特定的特征(交际行为和交际事件)来预测话语的代码;2) 我们让包括GPT-4-turbo、GPT-4o、DeepSeek在内的多个LLM参与协作代码预测;3) 我们利用事件和行为之间的相互关系,使用GPT-4o实现一致性检查。特别是,我们的上下文一致性检查提供了显著的准确性提升。我们还发现,行为预测的准确性始终高于事件预测。本研究为提高对话数据自动编码的精度贡献了一个新的方法框架,并为解决对话分析中固有的上下文挑战提供了一个可扩展的解决方案。

🔬 方法详解

问题定义:论文旨在解决对话数据自动编码中,由于对话上下文复杂性导致的编码精度不足的问题。现有方法难以充分理解和利用对话的上下文信息,例如交际行为和事件之间的关系,从而影响编码的准确性和可靠性。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大上下文理解能力,并结合对话数据特有的交际行为和事件特征,设计专门的提示策略和一致性检查机制,从而提高自动编码的精度。通过将对话分解为更小的单元,并显式地建模单元之间的关系,LLM能够更好地理解对话的整体含义。

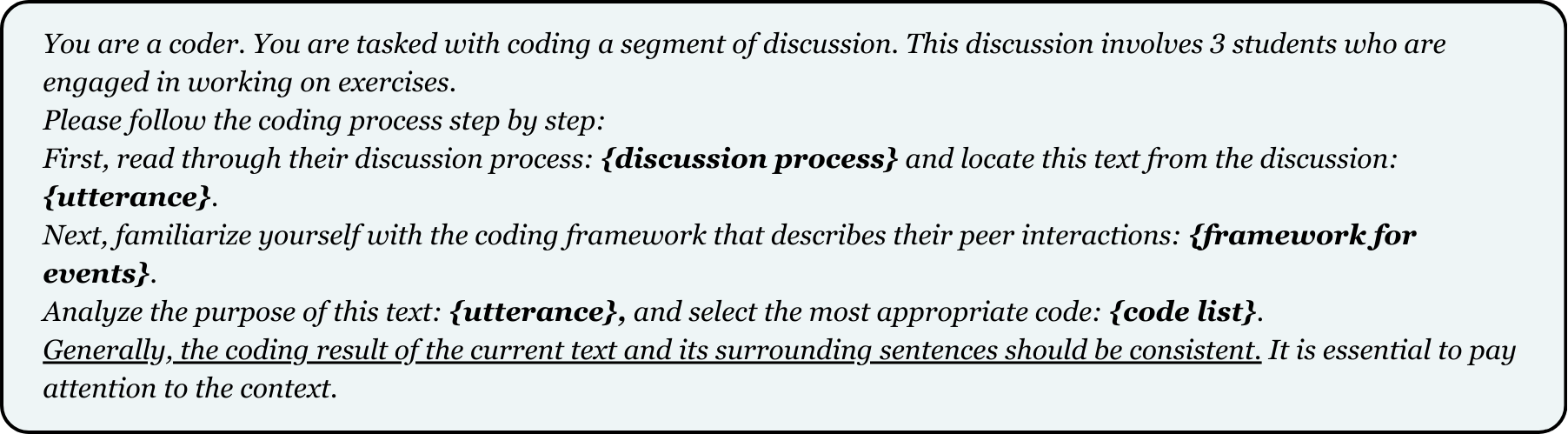

技术框架:该框架主要包含以下几个阶段:1) 特征提取:从对话数据中提取交际行为和交际事件等特征。2) 代码预测:使用不同的LLM(如GPT-4-turbo、GPT-4o、DeepSeek)基于提取的特征,通过角色提示和思维链方法,预测每个话语的代码。3) 一致性检查:利用事件和行为之间的相互关系,使用GPT-4o进行上下文一致性检查,纠正不一致的预测结果。4) 结果集成:将多个LLM的预测结果进行集成,得到最终的编码结果。

关键创新:该论文的关键创新在于:1) 对话特定特征的利用:显式地利用了对话数据特有的交际行为和事件特征,而不是直接将整个对话输入LLM。2) 多LLM协作:通过多个LLM的协作,可以提高编码的鲁棒性和准确性。3) 上下文一致性检查:通过检查事件和行为之间的一致性,可以有效地纠正LLM的错误预测。

关键设计:论文的关键设计包括:1) 角色提示:使用角色提示来引导LLM更好地理解对话参与者的角色和意图。2) 思维链:使用思维链方法来帮助LLM逐步推理,从而提高编码的准确性。3) 一致性检查规则:设计了一系列规则来检查事件和行为之间的一致性,例如,如果一个事件表示“提问”,那么相应的行为应该包含“请求信息”。具体的参数设置和损失函数等技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法通过上下文一致性检查,显著提升了自动编码的准确性。同时,行为预测的准确性始终高于事件预测,表明该方法在理解对话参与者的行为方面具有优势。具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可应用于教育领域,例如自动评估在线讨论质量、识别学生协作学习中的问题、个性化学习反馈等。此外,该方法还可以扩展到其他类型的对话数据分析,例如客户服务对话分析、医疗咨询对话分析等,具有广泛的应用前景。

📄 摘要(原文)

Dialogue data has been a key source for understanding learning processes, offering critical insights into how students engage in collaborative discussions and how these interactions shape their knowledge construction. The advent of Large Language Models (LLMs) has introduced promising opportunities for advancing qualitative research, particularly in the automated coding of dialogue data. However, the inherent contextual complexity of dialogue presents unique challenges for these models, especially in understanding and interpreting complex contextual information. This study addresses these challenges by developing a novel LLM-assisted automated coding approach for dialogue data. The novelty of our proposed framework is threefold: 1) We predict the code for an utterance based on dialogue-specific characteristics -- communicative acts and communicative events -- using separate prompts following the role prompts and chain-of-thoughts methods; 2) We engaged multiple LLMs including GPT-4-turbo, GPT-4o, DeepSeek in collaborative code prediction; 3) We leveraged the interrelation between events and acts to implement consistency checking using GPT-4o. In particular, our contextual consistency checking provided a substantial accuracy improvement. We also found the accuracy of act predictions was consistently higher than that of event predictions. This study contributes a new methodological framework for enhancing the precision of automated coding of dialogue data as well as offers a scalable solution for addressing the contextual challenges inherent in dialogue analysis.