WuNeng: Hybrid State with Attention

作者: Liu Xiao, Li Zhiyuan, Lin Yueyu

分类: cs.CL

发布日期: 2025-04-27

💡 一句话要点

WuNeng:融合RNN与注意力机制,提升大语言模型的表达能力和上下文连贯性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 注意力机制 RNN RWKV 混合头 上下文连贯性 序列建模 跨头交互

📋 核心要点

- 现有大语言模型在处理长序列时,上下文连贯性面临挑战,且KV缓存增大影响效率。

- WuNeng通过融合RNN(RWKV-7)和注意力机制,增强模型表征能力,提升上下文连贯性。

- 该方法在保证效率的同时,使模型在复杂推理和序列生成任务中表现出色,设立了新标准。

📝 摘要(中文)

WuNeng架构提出了一种新颖的方法,通过集成基于RNN的RWKV-7与先进的注意力机制来增强大型语言模型的表达能力和性能,其优先考虑增强上下文连贯性而非减少KV缓存大小。WuNeng基于Hymba的混合头概念,通过添加额外的RWKV-7状态驱动头来增强标准多头注意力,而不是替换现有头,从而丰富模型的表征能力。一种跨头交互技术促进了标准头、状态驱动头和新引入的中间头之间的动态协同作用,利用连接、加性调制和门控融合来实现强大的信息集成。此外,一种多token状态处理机制利用连续的RWKV-7状态来捕获复杂的、序列范围内的依赖关系,从而显著提高表达能力。值得注意的是,这些增强功能以最小的额外参数实现,确保了效率,同时使模型能够在复杂的推理和序列生成任务中表现出色。WuNeng为现代神经架构中表达能力和计算效率的平衡树立了新标准。

🔬 方法详解

问题定义:现有的大型语言模型在处理长序列时,难以维持长距离的上下文连贯性,并且随着序列长度的增加,KV缓存的大小也显著增加,导致计算效率降低。现有的注意力机制虽然能够捕捉序列中的依赖关系,但在建模长期依赖方面仍然存在局限性。

核心思路:WuNeng的核心思路是通过融合RNN(RWKV-7)的状态信息和注意力机制,利用RNN的循环特性来建模长距离依赖,同时利用注意力机制来关注序列中的关键信息。通过混合头的方式,将RNN的状态信息融入到注意力机制中,从而增强模型的表征能力和上下文连贯性。

技术框架:WuNeng架构主要包含以下几个模块:1) 标准多头注意力模块;2) RWKV-7状态驱动头模块;3) 中间头模块;4) 跨头交互模块;5) 多token状态处理模块。首先,标准多头注意力模块负责捕捉序列中的局部依赖关系。然后,RWKV-7状态驱动头模块利用RNN的状态信息来建模长距离依赖。中间头模块用于连接标准头和状态驱动头。跨头交互模块则负责融合不同头的信息,实现信息的有效传递和整合。最后,多token状态处理模块利用连续的RWKV-7状态来捕获复杂的序列依赖。

关键创新:WuNeng最重要的技术创新点在于混合头的设计和跨头交互机制。混合头的设计允许模型同时利用注意力机制和RNN的状态信息,从而增强模型的表征能力。跨头交互机制则促进了不同头之间的信息交流,使得模型能够更好地理解序列中的依赖关系。与现有方法相比,WuNeng不是简单地替换现有的注意力头,而是通过添加额外的状态驱动头来增强模型的表达能力,并且通过跨头交互机制实现了信息的有效融合。

关键设计:WuNeng的关键设计包括:1) 使用RWKV-7作为状态驱动头的RNN模型;2) 设计了连接、加性调制和门控融合等多种跨头交互方式;3) 采用多token状态处理机制,利用连续的RWKV-7状态来捕获复杂的序列依赖。具体参数设置和损失函数等细节在论文中可能未详细说明,属于未知信息。

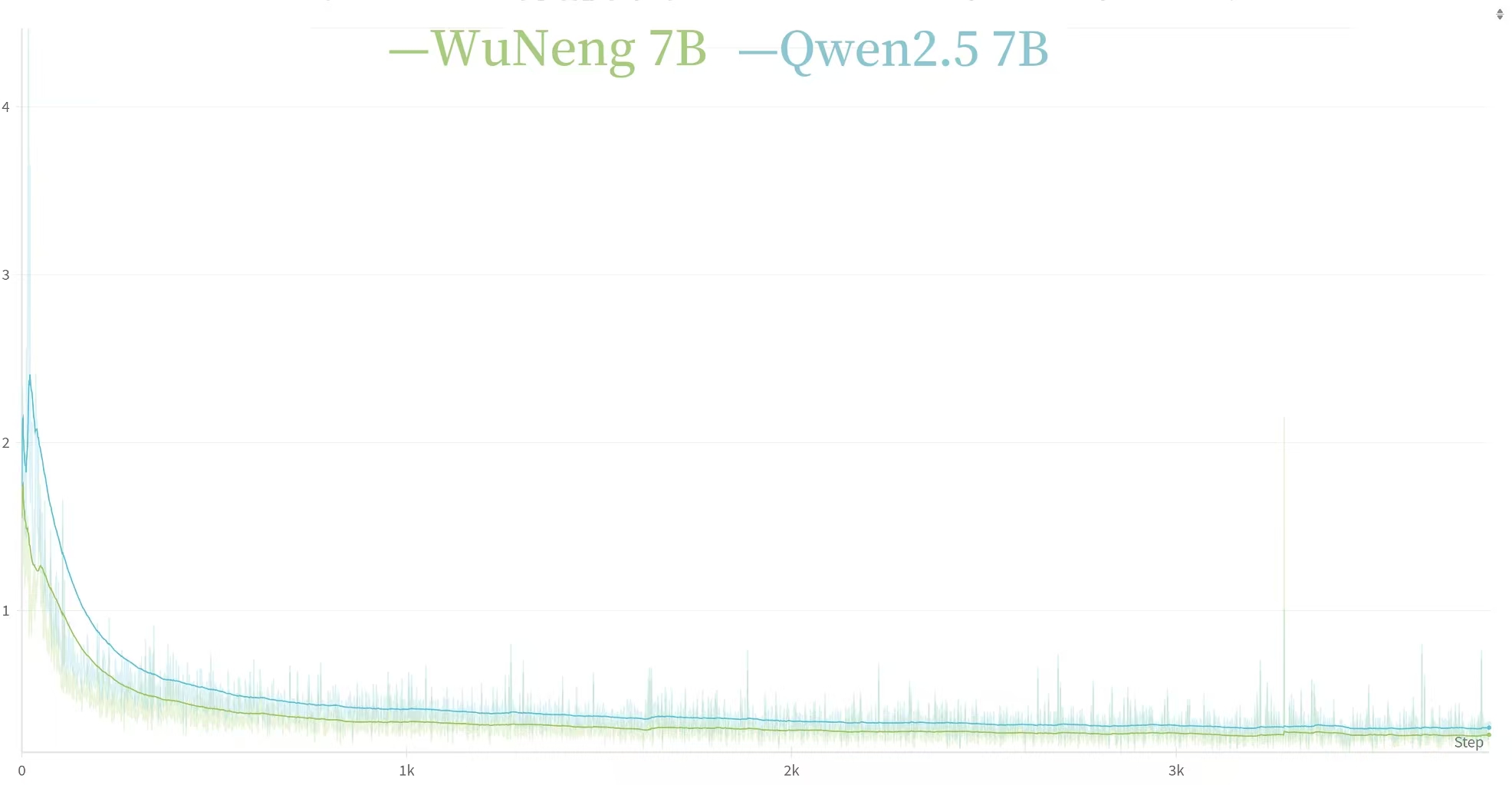

🖼️ 关键图片

📊 实验亮点

WuNeng在复杂的推理和序列生成任务中表现出色,证明了其在平衡表达能力和计算效率方面的优势。论文中提到,该方法以最小的额外参数实现了性能的显著提升,但具体的性能数据、对比基线和提升幅度等信息未在摘要中明确给出,属于未知信息。未来的研究可以进一步量化WuNeng在不同任务上的性能提升。

🎯 应用场景

WuNeng架构具有广泛的应用前景,可以应用于自然语言处理领域的各种任务,例如机器翻译、文本摘要、对话生成、代码生成等。其增强的上下文连贯性使得模型在处理长文本时能够更好地理解文本的含义,从而提高任务的性能。此外,WuNeng还可以应用于其他序列建模任务,例如语音识别、时间序列预测等。未来,WuNeng有望成为一种通用的序列建模架构,为各种人工智能应用提供强大的支持。

📄 摘要(原文)

The WuNeng architecture introduces a novel approach to enhancing the expressivity and power of large language models by integrating recurrent neural network (RNN)-based RWKV-7 with advanced attention mechanisms, prioritizing heightened contextual coherence over reducing KV cache size. Building upon the hybrid-head concept from Hymba, WuNeng augments standard multi-head attention with additional RWKV-7 state-driven heads, rather than replacing existing heads, to enrich the model's representational capacity. A cross-head interaction technique fosters dynamic synergy among standard, state-driven, and newly introduced middle heads, leveraging concatenation, additive modulation, and gated fusion for robust information integration. Furthermore, a multi-token state processing mechanism harnesses the continuous RWKV-7 state to capture intricate, sequence-wide dependencies, significantly boosting expressivity. Remarkably, these enhancements are achieved with minimal additional parameters, ensuring efficiency while empowering the model to excel in complex reasoning and sequence generation tasks. WuNeng sets a new standard for balancing expressivity and computational efficiency in modern neural architectures.