Efficient Reasoning for LLMs through Speculative Chain-of-Thought

作者: Jikai Wang, Juntao Li, Jianye Hou, Bowen Yan, Lijun Wu, Min Zhang

分类: cs.CL

发布日期: 2025-04-27 (更新: 2025-05-25)

🔗 代码/项目: GITHUB

💡 一句话要点

提出SCoT以降低大型语言模型推理延迟

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 推理优化 思维链 模型协作 轻量级模型 推理延迟 深度学习 语言模型

📋 核心要点

- 现有大型语言模型在推理时面临高延迟和高成本的问题,影响了其实际应用。

- 本文提出的推测性思维链(SCoT)通过大模型与小模型的协作,优化推理速度,提升效率。

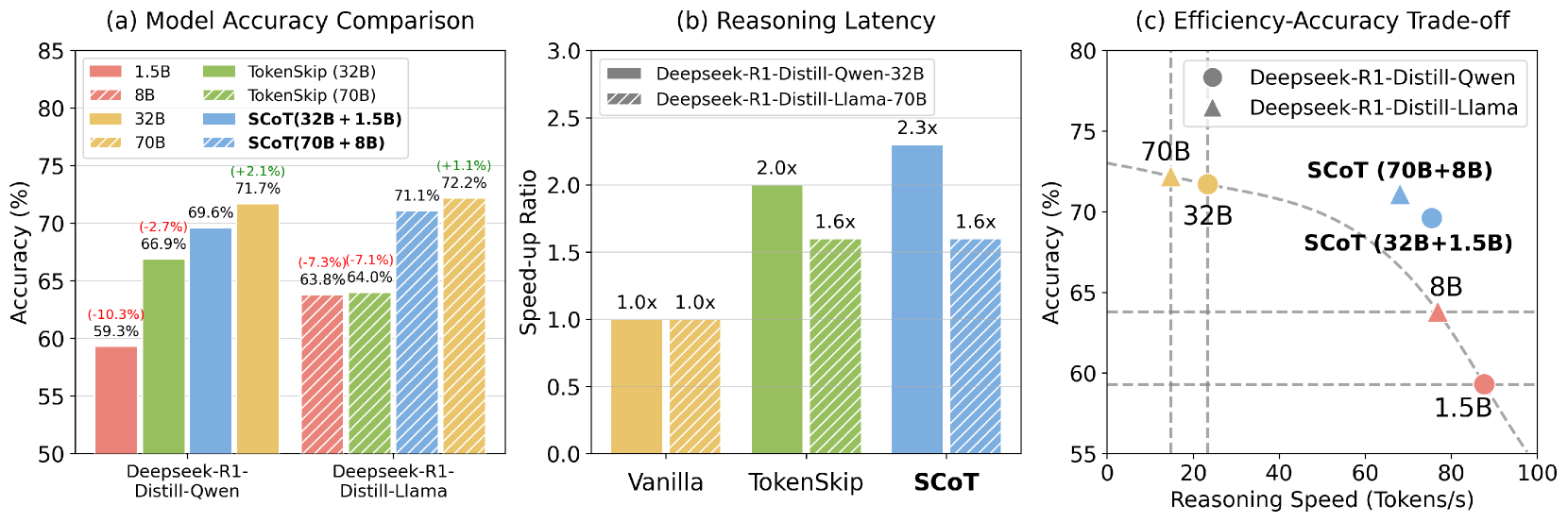

- 实验结果显示,SCoT在多个基准数据集上将推理延迟降低了48%至66%,并保持了高预测准确性。

📝 摘要(中文)

大型推理语言模型如OpenAI-o1和Deepseek-R1因其出色的任务解决能力而受到广泛关注。然而,模型庞大和思维链生成的冗长导致了显著的推理成本和响应延迟。现有的高效推理方法主要集中在减少模型参数或缩短思维链长度。本文提出了推测性思维链(SCoT),通过大模型与小模型的协作,从另一个角度降低推理延迟。SCoT使用轻量级草稿模型进行思维层级的草拟,然后选择最佳的思维草稿,并用目标模型纠正错误案例。实验结果表明,SCoT在多个数据集上显著降低了推理延迟,同时保持了接近目标模型的性能。

🔬 方法详解

问题定义:本文旨在解决大型语言模型推理过程中的高延迟和高成本问题。现有方法主要通过减少模型参数或缩短思维链长度来提高效率,但效果有限。

核心思路:论文提出的推测性思维链(SCoT)通过引入轻量级草稿模型进行思维草拟,结合目标模型进行错误修正,从而加速推理过程。

技术框架:SCoT的整体架构包括两个主要模块:轻量级草稿模型用于初步草拟思维链,目标模型用于选择最佳草稿并进行错误修正。该流程通过协作提高了推理速度和准确性。

关键创新:SCoT的核心创新在于通过大模型与小模型的协作,优化了思维链的生成过程,显著降低了推理延迟。这一方法与传统的单一模型推理方式有本质区别。

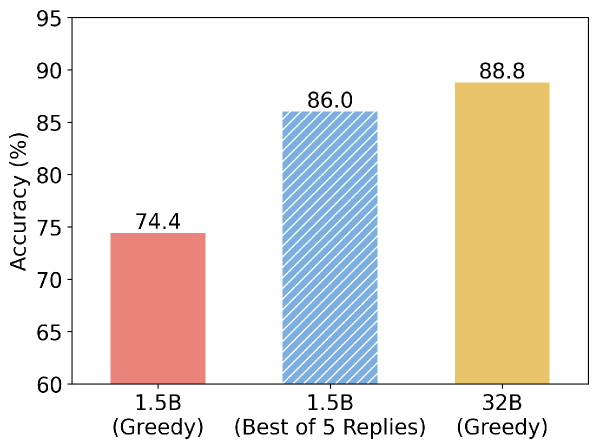

关键设计:在模型设计上,轻量级草稿模型的选择和草拟策略是关键,确保了草稿的质量和准确性。同时,目标模型的选择策略也经过优化,以保持复杂任务的预测准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SCoT在GSM8K、MATH、GaoKao、CollegeMath和Olympiad数据集上,推理延迟降低了48%至66%,在Deepseek-R1-Distill-Qwen-32B和Deepseek-R1-Distill-Llama-70B模型上,性能接近目标模型水平,显示出显著的提升效果。

🎯 应用场景

该研究的潜在应用领域包括教育、金融、医疗等需要快速推理和决策支持的场景。通过降低推理延迟,SCoT可以提升大型语言模型在实际应用中的响应速度和效率,具有重要的实际价值和未来影响。

📄 摘要(原文)

Large reasoning language models such as OpenAI-o1 and Deepseek-R1 have recently attracted widespread attention due to their impressive task-solving abilities. However, the enormous model size and the generation of lengthy thought chains introduce significant reasoning costs and response latency. Existing methods for efficient reasoning mainly focus on reducing the number of model parameters or shortening the chain-of-thought length. In this paper, we introduce Speculative Chain-of-Thought (SCoT), which reduces reasoning latency from another perspective by accelerated average reasoning speed through large and small model collaboration. SCoT conducts thought-level drafting using a lightweight draft model. Then it selects the best CoT draft and corrects the error cases with the target model. The proposed thinking behavior alignment improves the efficiency of drafting and the draft selection strategy maintains the prediction accuracy of the target model for complex tasks. Experimental results on GSM8K, MATH, GaoKao, CollegeMath and Olympiad datasets show that SCoT reduces reasoning latency by 48\%$\sim$66\% and 21\%$\sim$49\% for Deepseek-R1-Distill-Qwen-32B and Deepseek-R1-Distill-Llama-70B while achieving near-target-model-level performance. Our code is available at https://github.com/Jikai0Wang/Speculative_CoT.