SynLexLM: Scaling Legal LLMs with Synthetic Data and Curriculum Learning

作者: Ojasw Upadhyay, Abishek Saravanakumar, Ayman Ismail

分类: cs.CL, cs.LG

发布日期: 2025-04-26 (更新: 2025-04-29)

备注: 9 pages, 4 figures, 4 tables

💡 一句话要点

SynLexLM:利用合成数据和课程学习扩展法律领域大语言模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 法律大语言模型 合成数据 课程学习 法律文本分析 问答系统

📋 核心要点

- 法律领域大语言模型面临数据稀缺和通用预训练无法捕捉法律细微之处的挑战。

- SynLexLM 采用课程学习和合成数据增强相结合的方法,高效预训练法律领域大语言模型。

- 初步实验表明,该方法在法律基准测试中具有提升性能的潜力,并能增强法律文档分析。

📝 摘要(中文)

大型语言模型(LLM)功能强大,但通常需要在法律等专业领域进行广泛的微调和使用大型数据集。通用预训练可能无法捕捉法律细微之处,并且获取足够的法律数据具有挑战性。我们介绍 SynLexLM,这是一种有效预训练法律LLM的新方法。我们的方法采用课程学习,从简单到复杂的法律文本和查询逐步学习,并结合使用 Gemini Pro 等模型进行合成数据增强,以解决数据稀缺问题。我们的目标是在法律基准(BigLaw-Bench、EUR-Lex-Sum)上实现比传统模型和微调版本更高的性能。初步工作包括生成反映法律推理的合成问答对。这项工作旨在增强法律文档分析和研究工具,从而可能普及对高级法律AI的访问。

🔬 方法详解

问题定义:论文旨在解决法律领域大语言模型训练中数据稀缺的问题。现有方法依赖于通用预训练或有限的法律数据微调,无法充分捕捉法律文本的复杂性和细微差别,导致模型在法律任务上的表现不佳。

核心思路:论文的核心思路是利用课程学习和合成数据增强来解决法律数据稀缺的问题。课程学习允许模型从简单到复杂逐步学习法律知识,而合成数据增强则通过生成额外的法律数据来扩充训练集,从而提高模型的泛化能力。

技术框架:SynLexLM 的整体框架包含以下几个阶段:1) 使用 Gemini Pro 等模型生成合成法律问答对;2) 构建课程学习计划,将法律文本和查询按照难度排序;3) 使用合成数据和真实数据,按照课程学习计划逐步训练 LLM;4) 在法律基准测试集上评估模型性能。

关键创新:该方法的主要创新点在于结合了课程学习和合成数据增强,有效地解决了法律领域数据稀缺的问题。通过课程学习,模型可以更好地学习法律知识的层次结构,而合成数据增强则可以提高模型的鲁棒性和泛化能力。

关键设计:课程学习计划的设计至关重要,需要仔细选择法律文本和查询的难度指标。合成数据生成过程需要保证生成数据的质量和多样性,避免引入噪声或偏差。损失函数的设计需要考虑到法律任务的特点,例如,可以使用对比学习来提高模型对法律概念的区分能力。具体的参数设置和网络结构未知。

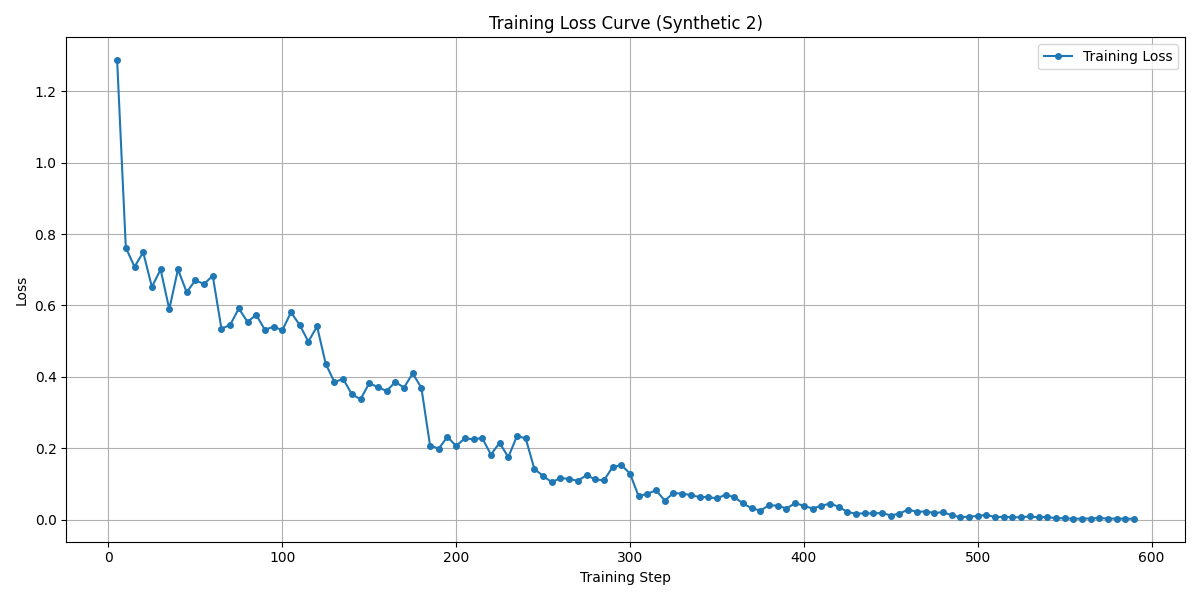

🖼️ 关键图片

📊 实验亮点

论文的初步实验结果表明,SynLexLM 在法律基准测试中具有提升性能的潜力。通过生成合成问答对,并结合课程学习,该方法能够有效地提高模型在法律任务上的表现。具体的性能数据和提升幅度未知,需要在后续工作中进一步验证。

🎯 应用场景

SynLexLM 有潜力应用于法律文档分析、法律研究工具和智能法律助手等领域。通过提高法律领域大语言模型的性能,该研究可以帮助律师、法官和法律研究人员更有效地处理法律信息,并可能促进法律服务的普及。

📄 摘要(原文)

Large Language Models (LLMs) are powerful but often require extensive fine-tuning and large datasets for specialized domains like law. General-purpose pre-training may not capture legal nuances, and acquiring sufficient legal data is challenging. We introduce SynLexLM, a novel approach to efficiently pre-train a legal LLM. Our method employs curriculum learning, progressing from simple to complex legal texts and queries, combined with synthetic data augmentation using models like Gemini Pro to address data scarcity. We aim to achieve improved performance on legal benchmarks (BigLaw-Bench, EUR-Lex-Sum) compared to traditional models and fine-tuned versions. Preliminary work involves generating synthetic QA pairs reflecting legal reasoning. This work aims to enhance legal document analysis and research tools, potentially democratizing access to advanced legal AI.