An Empirical Study on Prompt Compression for Large Language Models

作者: Zheng Zhang, Jinyi Li, Yihuai Lan, Xiang Wang, Hao Wang

分类: cs.CL, cs.AI

发布日期: 2025-04-24

备注: Accepted by Building Trust Workshop at ICLR 2025

🔗 代码/项目: GITHUB

💡 一句话要点

研究提示压缩方法以降低大语言模型计算成本并提升长文本处理性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 提示压缩 大语言模型 长文本处理 计算效率 模型性能

📋 核心要点

- 现有方法处理长提示时,计算复杂度和经济成本显著增加,限制了大语言模型的应用。

- 本文研究提示压缩,旨在减少提示长度,同时维持大语言模型的生成质量,降低计算成本。

- 实验表明,提示压缩在长文本场景下对大语言模型性能影响更大,适度压缩甚至能提升性能。

📝 摘要(中文)

本文研究了六种用于大语言模型(LLMs)的提示压缩方法,旨在减少提示长度,同时保持LLM的响应质量,从而降低计算复杂性和经济成本。我们对这些方法进行了全面的分析,涵盖了生成性能、模型幻觉、多模态任务的有效性以及词语省略分析等方面。我们在包括新闻、科学文章、常识问答、数学问答、长文本问答和VQA数据集在内的13个数据集上评估了这些方法。实验表明,与短文本相比,提示压缩对LLM在长文本中的性能影响更大。在Longbench评估中,适度的压缩甚至可以提高LLM的性能。代码和数据可在https://github.com/3DAgentWorld/Toolkit-for-Prompt-Compression 获取。

🔬 方法详解

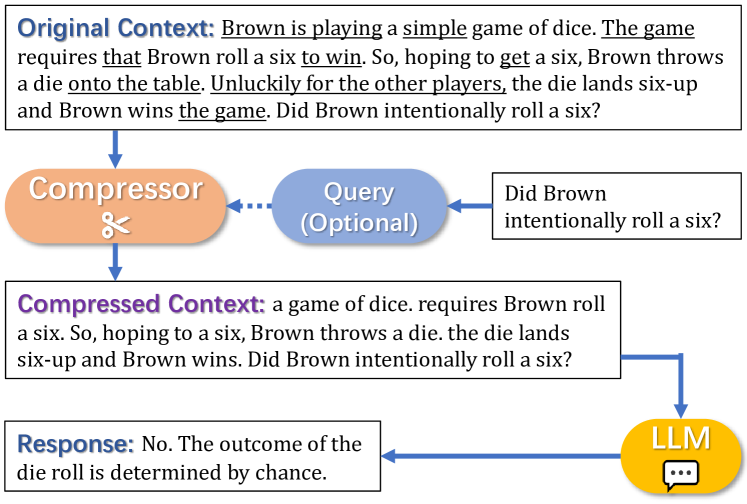

问题定义:论文旨在解决大语言模型(LLMs)在处理长提示时面临的计算复杂度和经济成本过高的问题。现有的方法在处理长文本时,由于提示长度的增加,导致计算资源消耗显著增加,推理速度变慢,并且可能影响模型的生成质量。因此,如何有效地压缩提示,在减少计算成本的同时保持或提升LLM的性能,是一个重要的研究问题。

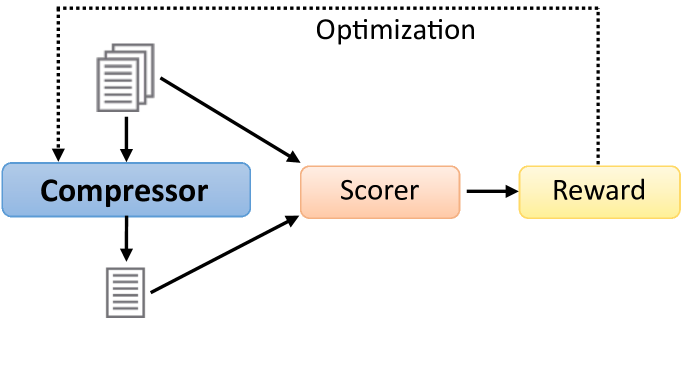

核心思路:论文的核心思路是通过提示压缩来减少输入LLM的文本长度,从而降低计算成本。作者研究了多种提示压缩方法,并分析了它们在不同任务和数据集上的表现。核心在于找到一种平衡,既能显著减少提示的长度,又能最大限度地保留原始提示中的关键信息,以确保LLM能够生成高质量的响应。

技术框架:论文的技术框架主要包括以下几个步骤:1) 选择和实现六种不同的提示压缩方法;2) 在13个不同的数据集上评估这些方法的性能,这些数据集涵盖了新闻、科学文章、常识问答、数学问答、长文本问答和VQA等多种任务;3) 对实验结果进行详细的分析,包括生成性能、模型幻觉、多模态任务的有效性以及词语省略分析等;4) 特别关注提示压缩对LLM在长文本处理中的影响。

关键创新:论文的关键创新在于对多种提示压缩方法进行了全面的实证研究,并分析了它们在不同任务和数据集上的表现。特别是在长文本处理方面,论文发现适度的提示压缩甚至可以提高LLM的性能,这与直觉上认为压缩会降低性能的观点不同。此外,论文还对压缩方法对模型幻觉的影响进行了分析,为选择合适的压缩方法提供了指导。

关键设计:论文研究了六种提示压缩方法,具体方法细节未知。实验中,作者在13个数据集上进行了评估,并使用了Longbench进行长文本性能评估。具体的参数设置、损失函数和网络结构等技术细节未在摘要中详细说明,需要查阅原文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提示压缩对LLM在长文本中的性能影响更大。在Longbench评估中,适度的压缩甚至可以提高LLM的性能。这表明,在处理长文本时,并非提示越长越好,适当的压缩可以去除冗余信息,提高模型的效率和准确性。具体的性能提升幅度未知,需要查阅原文。

🎯 应用场景

该研究成果可应用于各种需要使用大语言模型的场景,尤其是在处理长文本输入时,例如文档摘要、信息检索、智能客服等。通过提示压缩,可以显著降低计算成本,提高推理速度,并有可能提升模型性能。该研究为大语言模型的实际应用提供了有价值的参考。

📄 摘要(原文)

Prompt engineering enables Large Language Models (LLMs) to perform a variety of tasks. However, lengthy prompts significantly increase computational complexity and economic costs. To address this issue, we study six prompt compression methods for LLMs, aiming to reduce prompt length while maintaining LLM response quality. In this paper, we present a comprehensive analysis covering aspects such as generation performance, model hallucinations, efficacy in multimodal tasks, word omission analysis, and more. We evaluate these methods across 13 datasets, including news, scientific articles, commonsense QA, math QA, long-context QA, and VQA datasets. Our experiments reveal that prompt compression has a greater impact on LLM performance in long contexts compared to short ones. In the Longbench evaluation, moderate compression even enhances LLM performance. Our code and data is available at https://github.com/3DAgentWorld/Toolkit-for-Prompt-Compression.