EasyEdit2: An Easy-to-use Steering Framework for Editing Large Language Models

作者: Ziwen Xu, Shuxun Wang, Kewei Xu, Haoming Xu, Mengru Wang, Xinle Deng, Yunzhi Yao, Guozhou Zheng, Huajun Chen, Ningyu Zhang

分类: cs.CL, cs.AI, cs.CV, cs.HC, cs.LG

发布日期: 2025-04-21 (更新: 2025-09-14)

备注: EMNLP 2025 System Demonstrations. Demo: https://www.youtube.com/watch?v=AkfoiPfp5rQ; code: https://github.com/zjunlp/EasyEdit

🔗 代码/项目: GITHUB

💡 一句话要点

EasyEdit2:一种易于使用的大语言模型行为引导框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 模型编辑 行为引导 引导向量 可调节性

📋 核心要点

- 现有方法难以在不修改模型参数的情况下灵活控制LLM的行为,限制了其在各种场景下的应用。

- EasyEdit2通过生成和应用引导向量,在测试时干预LLM的行为,无需修改模型参数,实现即插即用的可调节性。

- 实验结果表明,EasyEdit2在不同LLM上能够有效地引导模型的安全性、情感、推理等多种行为。

📝 摘要(中文)

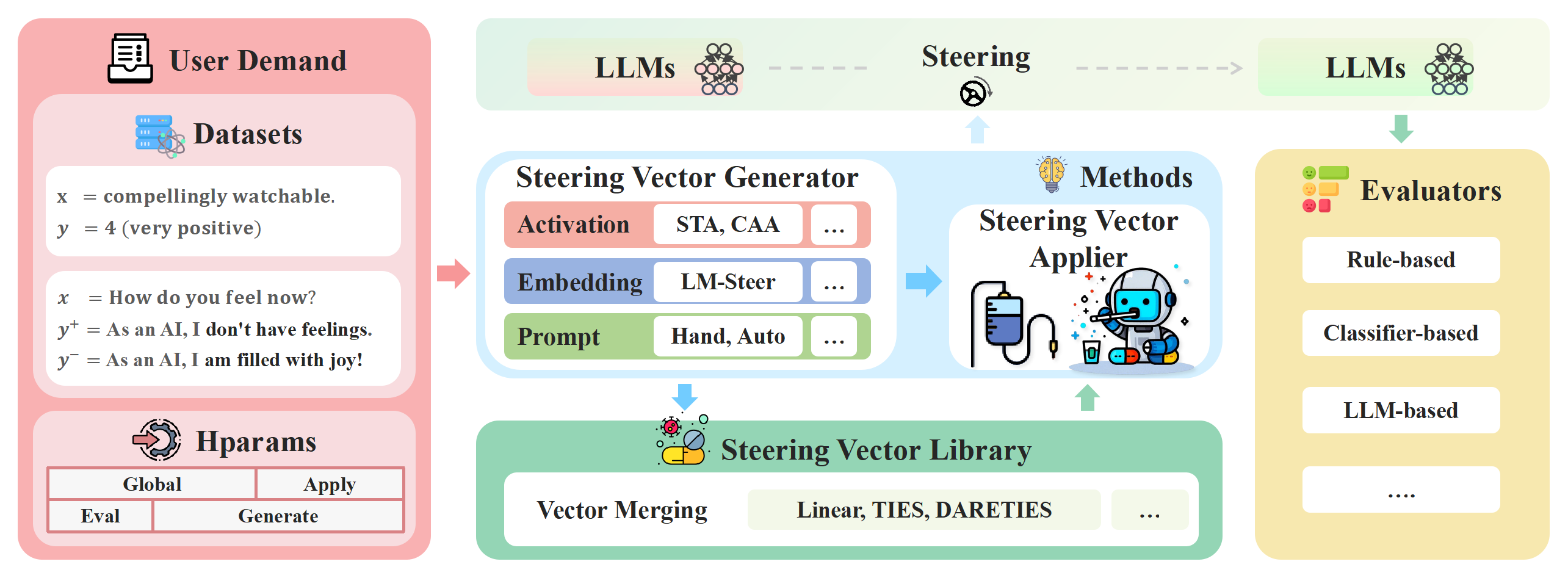

本文介绍EasyEdit2,一个旨在为控制大型语言模型(LLM)行为提供即插即用可调节性的框架。EasyEdit2支持广泛的测试时干预,包括安全性、情感、个性、推理模式、事实性和语言特征。与它的前身不同,EasyEdit2采用了一种专门为无缝模型引导而设计的新架构。它包括诸如引导向量生成器和引导向量应用器等关键模块,这些模块能够自动生成和应用引导向量,从而在不修改模型参数的情况下影响模型的行为。EasyEdit2的主要优势之一是其易用性——用户不需要广泛的技术知识。只需一个示例,他们就可以有效地引导和调整模型的响应,从而使精确控制既可访问又高效。经验表明,我们报告了不同LLM上的模型引导性能,证明了这些技术的有效性。我们已经在GitHub上发布了源代码,并提供了一个演示notebook。此外,我们还在YouTube上提供了一个演示视频,以进行快速介绍。

🔬 方法详解

问题定义:现有的大语言模型(LLM)虽然强大,但在实际应用中,用户往往需要根据特定场景调整模型的行为,例如控制输出的情感倾向、确保安全性、或引导其遵循特定的推理模式。然而,微调整个模型参数成本高昂,且容易引入副作用。因此,需要一种能够在不修改模型参数的前提下,灵活、高效地控制LLM行为的方法。

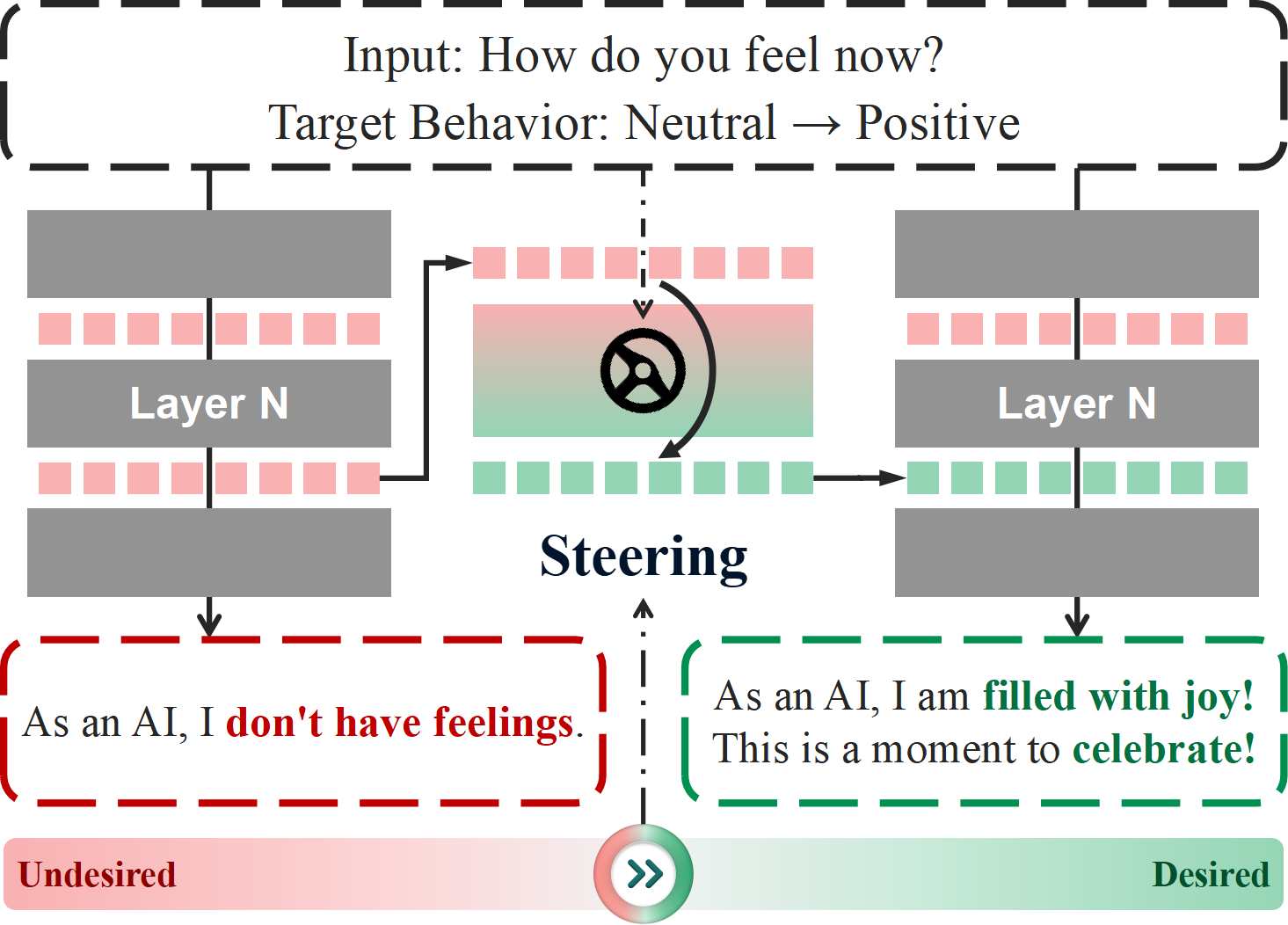

核心思路:EasyEdit2的核心思路是利用“引导向量”(Steering Vector)来影响LLM的输出。引导向量本质上是在模型的隐空间中添加一个偏移量,从而改变模型的行为。这种方法类似于在物理空间中施加一个力来改变物体的运动轨迹。通过精心设计引导向量的生成和应用方式,可以在不改变模型本身的情况下,实现对模型行为的精确控制。

技术框架:EasyEdit2的整体架构包含两个主要模块:引导向量生成器和引导向量应用器。首先,用户提供一个或少量示例,这些示例描述了期望的模型行为。引导向量生成器基于这些示例,自动生成一个引导向量。然后,引导向量应用器将该向量应用到LLM的特定层,从而影响模型的输出。整个过程无需修改LLM的参数,实现了即插即用的可调节性。

关键创新:EasyEdit2的关键创新在于其引导向量的自动生成和应用机制。与手动设计引导向量的方法相比,EasyEdit2能够根据用户提供的示例,自动学习到合适的引导向量,大大降低了使用门槛。此外,EasyEdit2的架构设计使得引导向量可以灵活地应用于不同的LLM,具有良好的通用性。

关键设计:引导向量生成器可以使用多种方法实现,例如,可以通过计算期望行为和原始行为在隐空间中的差异来生成引导向量。引导向量应用器则需要在LLM的特定层添加引导向量。具体选择哪一层以及如何添加,需要根据具体的LLM和期望的行为进行调整。此外,还可以引入一些正则化项,以防止引导向量过大,影响模型的整体性能。

🖼️ 关键图片

📊 实验亮点

论文报告了在不同LLM上的实验结果,证明了EasyEdit2的有效性。实验表明,使用EasyEdit2可以在不显著降低模型性能的前提下,有效地引导模型的安全性、情感、推理等多种行为。例如,通过引导向量,可以显著降低模型生成有害内容的概率,同时保持模型生成流畅、自然的文本。

🎯 应用场景

EasyEdit2具有广泛的应用前景。例如,可以用于构建更加安全的对话系统,避免模型生成有害或不当的内容。可以用于个性化推荐系统,根据用户的偏好调整模型的输出风格。还可以用于教育领域,引导模型生成更具启发性的教学内容。此外,EasyEdit2还可以用于快速修复模型中的错误行为,提高模型的可靠性。

📄 摘要(原文)

In this paper, we introduce EasyEdit2, a framework designed to enable plug-and-play adjustability for controlling Large Language Model (LLM) behaviors. EasyEdit2 supports a wide range of test-time interventions, including safety, sentiment, personality, reasoning patterns, factuality, and language features. Unlike its predecessor, EasyEdit2 features a new architecture specifically designed for seamless model steering. It comprises key modules such as the steering vector generator and the steering vector applier, which enable automatic generation and application of steering vectors to influence the model's behavior without modifying its parameters. One of the main advantages of EasyEdit2 is its ease of use-users do not need extensive technical knowledge. With just a single example, they can effectively guide and adjust the model's responses, making precise control both accessible and efficient. Empirically, we report model steering performance across different LLMs, demonstrating the effectiveness of these techniques. We have released the source code on GitHub at https://github.com/zjunlp/EasyEdit along with a demonstration notebook. In addition, we provide a demo video at https://www.youtube.com/watch?v=AkfoiPfp5rQ for a quick introduction.