Retrieval Augmented Generation Evaluation in the Era of Large Language Models: A Comprehensive Survey

作者: Aoran Gan, Hao Yu, Kai Zhang, Qi Liu, Wenyu Yan, Zhenya Huang, Shiwei Tong, Guoping Hu

分类: cs.CL

发布日期: 2025-04-21

备注: 18 pages, 5 figures

💡 一句话要点

全面综述大语言模型时代检索增强生成(RAG)的评估方法与框架。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 RAG评估 大型语言模型 自然语言处理 评估框架 数据集 综述研究

📋 核心要点

- 现有RAG评估方法难以应对LLM时代动态知识和混合架构带来的挑战,缺乏系统性的梳理。

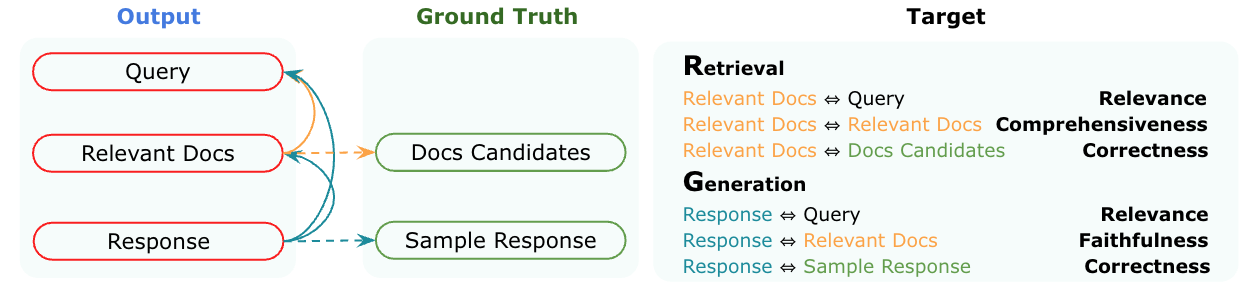

- 本文全面综述RAG评估方法,涵盖系统性能、事实准确性、安全性和计算效率等多个维度。

- 论文整理了RAG评估数据集和框架,并对高影响力研究进行元分析,为RAG发展提供参考。

📝 摘要(中文)

检索增强生成(RAG)通过整合大型语言模型(LLM)与外部信息检索,彻底改变了自然语言处理,实现了跨多种应用的准确、最新和可验证的文本生成。然而,由于RAG系统结合了检索和生成组件的混合架构,以及对LLM时代动态知识源的依赖,评估RAG系统面临独特的挑战。本文对RAG评估方法和框架进行了全面综述,系统地回顾了传统和新兴的评估方法,涵盖了LLM时代系统性能、事实准确性、安全性和计算效率等方面。我们还整理和分类了RAG特定的数据集和评估框架,并对高影响力RAG研究中的评估实践进行了元分析。据我们所知,这项工作代表了对RAG评估最全面的综述,弥合了传统方法和LLM驱动方法之间的差距,并为推进RAG开发提供了关键资源。

🔬 方法详解

问题定义:RAG系统的评估面临着独特的挑战,因为它们结合了检索和生成两个组件,并且依赖于大型语言模型(LLM)时代不断变化的知识源。现有的评估方法可能无法充分捕捉RAG系统的复杂性,例如,如何衡量检索到的信息的质量对最终生成结果的影响,以及如何评估RAG系统在面对新知识时的适应能力。此外,事实准确性、安全性和计算效率等方面的评估也需要专门的方法。

核心思路:本文的核心思路是对现有的RAG评估方法进行全面的梳理和分类,并分析它们的优缺点。通过对传统评估方法和LLM驱动的评估方法进行对比,找出适用于不同场景的评估指标和框架。此外,论文还对RAG特定的数据集和评估框架进行了整理,为研究人员提供了一个全面的资源。

技术框架:本文主要是一个综述性的工作,没有提出新的技术框架。它主要通过以下几个步骤来完成:1) 收集和整理现有的RAG评估方法;2) 对这些方法进行分类,例如按照评估指标、评估对象等进行分类;3) 分析这些方法的优缺点,并指出它们适用的场景;4) 整理RAG特定的数据集和评估框架;5) 对高影响力的RAG研究进行元分析,总结评估实践。

关键创新:本文的主要创新在于其全面性和系统性。据作者所知,这是对RAG评估方法最全面的综述,它弥合了传统方法和LLM驱动方法之间的差距,并为RAG开发提供了一个关键资源。此外,本文还整理了RAG特定的数据集和评估框架,为研究人员提供了便利。

关键设计:本文没有涉及具体的技术细节,因为它主要是一个综述性的工作。但是,论文中对各种评估指标和框架的描述可以为研究人员提供参考,例如,如何选择合适的评估指标来衡量RAG系统的性能,以及如何设计实验来评估RAG系统的各个方面。

🖼️ 关键图片

📊 实验亮点

该论文是对RAG评估方法最全面的综述,涵盖了传统和LLM驱动的方法,并整理了RAG特定的数据集和评估框架。通过对高影响力RAG研究的元分析,总结了评估实践,为RAG研究人员提供了宝贵的参考资源。该研究为RAG系统的评估和优化提供了指导,有助于提高RAG系统的性能。

🎯 应用场景

该研究成果可应用于各种需要利用外部知识进行文本生成的场景,例如问答系统、文档摘要、内容创作等。通过选择合适的评估方法,可以更好地评估和优化RAG系统的性能,提高生成文本的准确性、可靠性和安全性。该研究还有助于推动RAG技术的发展,使其在更多领域得到应用。

📄 摘要(原文)

Recent advancements in Retrieval-Augmented Generation (RAG) have revolutionized natural language processing by integrating Large Language Models (LLMs) with external information retrieval, enabling accurate, up-to-date, and verifiable text generation across diverse applications. However, evaluating RAG systems presents unique challenges due to their hybrid architecture that combines retrieval and generation components, as well as their dependence on dynamic knowledge sources in the LLM era. In response, this paper provides a comprehensive survey of RAG evaluation methods and frameworks, systematically reviewing traditional and emerging evaluation approaches, for system performance, factual accuracy, safety, and computational efficiency in the LLM era. We also compile and categorize the RAG-specific datasets and evaluation frameworks, conducting a meta-analysis of evaluation practices in high-impact RAG research. To the best of our knowledge, this work represents the most comprehensive survey for RAG evaluation, bridging traditional and LLM-driven methods, and serves as a critical resource for advancing RAG development.